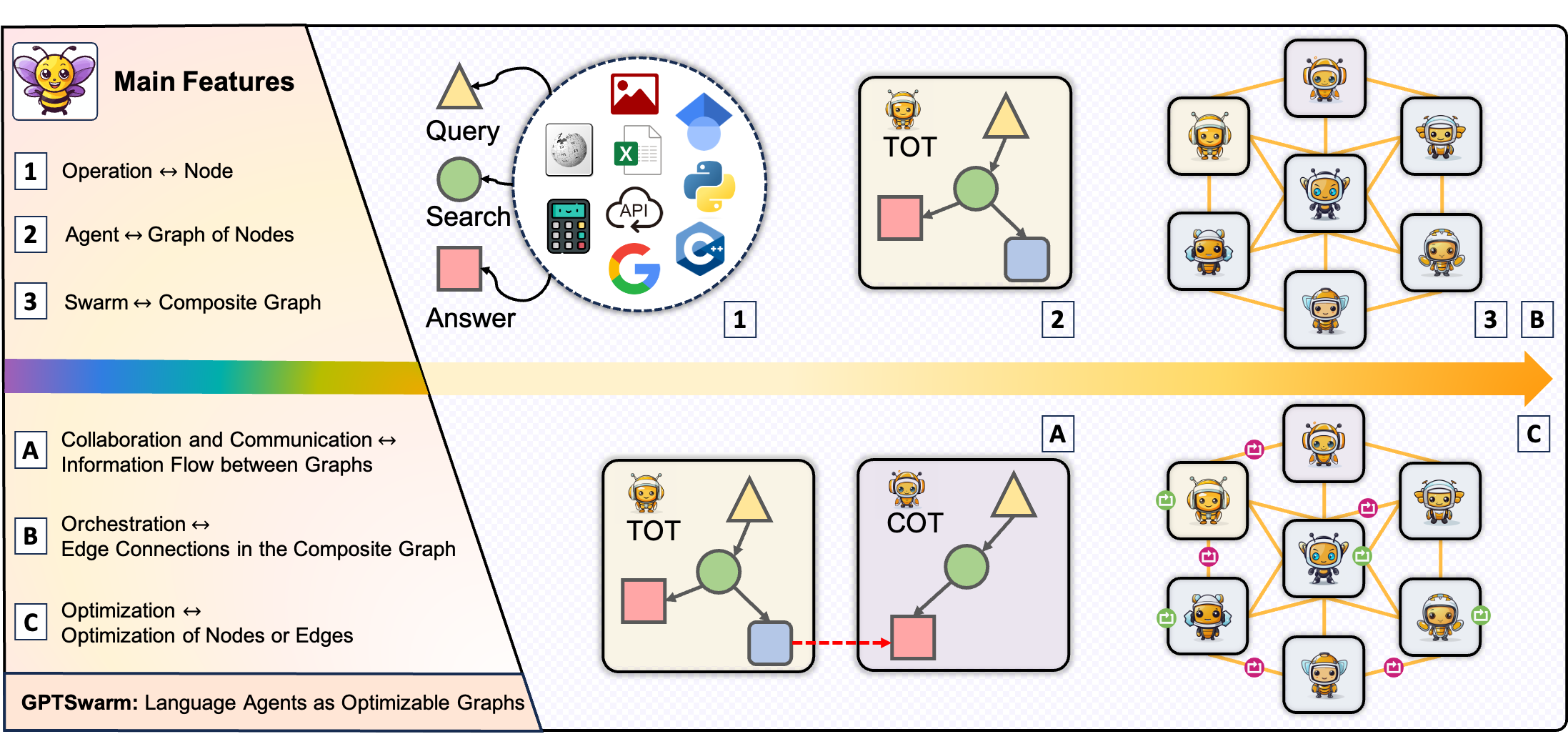

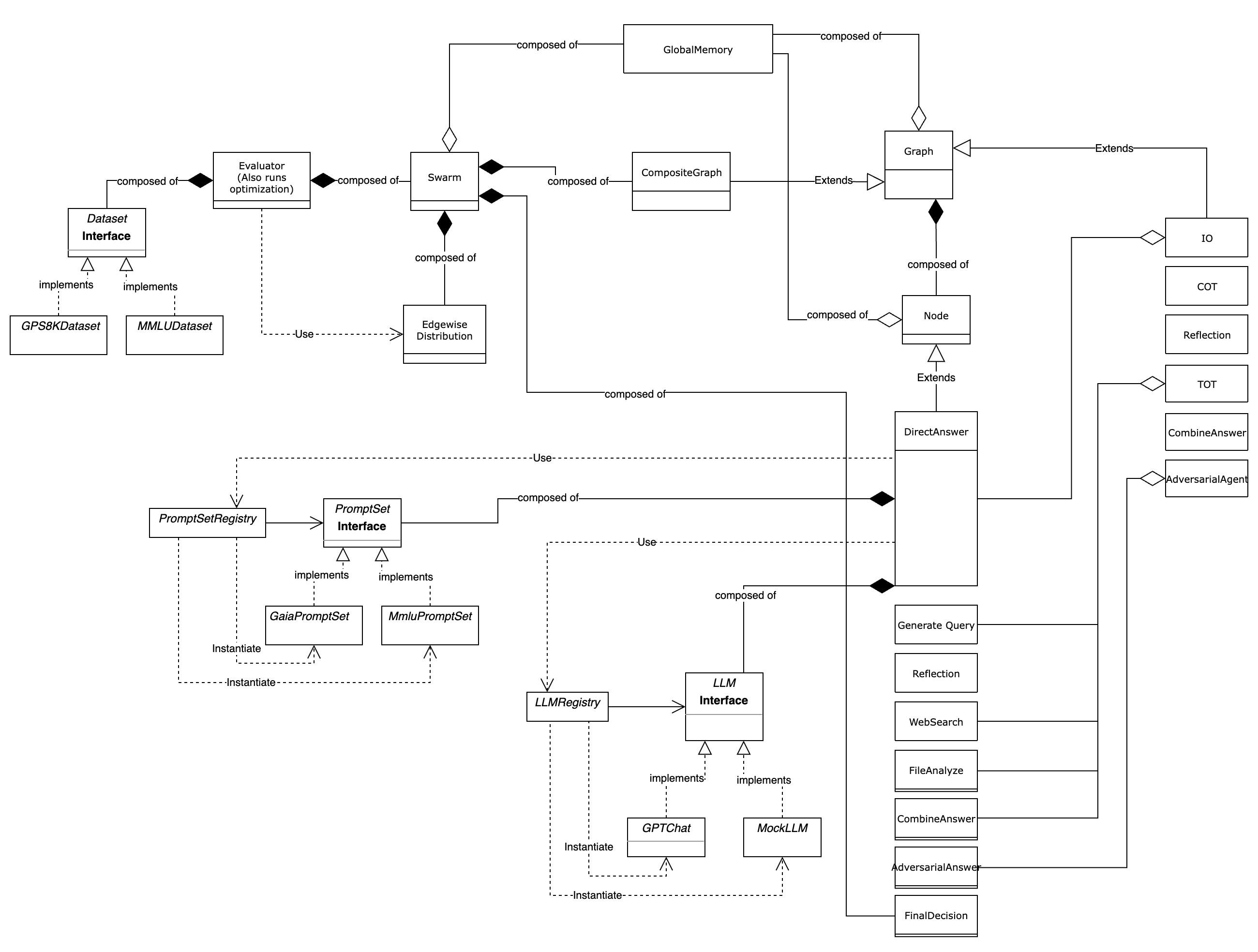

? GPTSWARMは、LLMベースのエージェント向けのグラフベースのフレームワークであり、2つの高レベル機能を提供します。

粒状レベルでは、GPTSWARMは次のコンポーネントを含むライブラリです。

| モジュール | 説明 |

|---|---|

| swarm.environment | ドメイン固有の操作、エージェント、ツール、およびタスク |

| swarm.graph | エージェントグラフと群れコンポジットグラフを作成および実行するためのグラフ関連機能 |

| swarm.llm | LLMバックエンドを選択し、運用コストを計算するためのインターフェイス |

| swarm.memory | インデックスベースのメモリ |

| swarm.optimizer | エージェントのパフォーマンスを向上させるように設計された最適化アルゴリズム |

? [10/12]尊敬? Openaiの群れ、しかし? Gptswarmは、それを考慮するとより良い選択肢です。群れのインテリジェンス?。

[08/07]ミンシェンは、上海AIラボとの招待されたセミナーに出席しました。

[07/25]ルイとフランチェスコは、ICML 2024で口頭でのプレゼンテーションを行いました。

[07/17] MingchenはGptswarmをメタに導入しました。

[07/05] MingchenはWaicに招待された講演をしました。

[06/21]ミンシェンはIA-CASに招待された講演を行いました。

[06/20]ドミトリイは招待された講演をSberbankに与えました。

[06/03] Sdaiaは、5時間のセミナーにGptswarmチーム(Wenyi、Francesco、Dmitrii)を招待しました。

[06/02] GPTSWARMは、ICML2024によって口頭発表(上位1.5%、9,473で144)として選択されています!おめでとう!

[05/01] GPTSWARMはICML2024によって受け入れられています。

[04/18]ミンシェンは、招待された講演をバイテダンスに与えました。

[03/20] MingchenはHuaweiに招待された講演を行いました。

[03/13]ミンシェンとのMittr China独占インタビュー。

[03/01] Gptswarmは今すぐPIP経由でインストールできます: pip install gptswarm

[02/27]学術論文:最適化可能なグラフとしての言語エージェントがリリースされます。

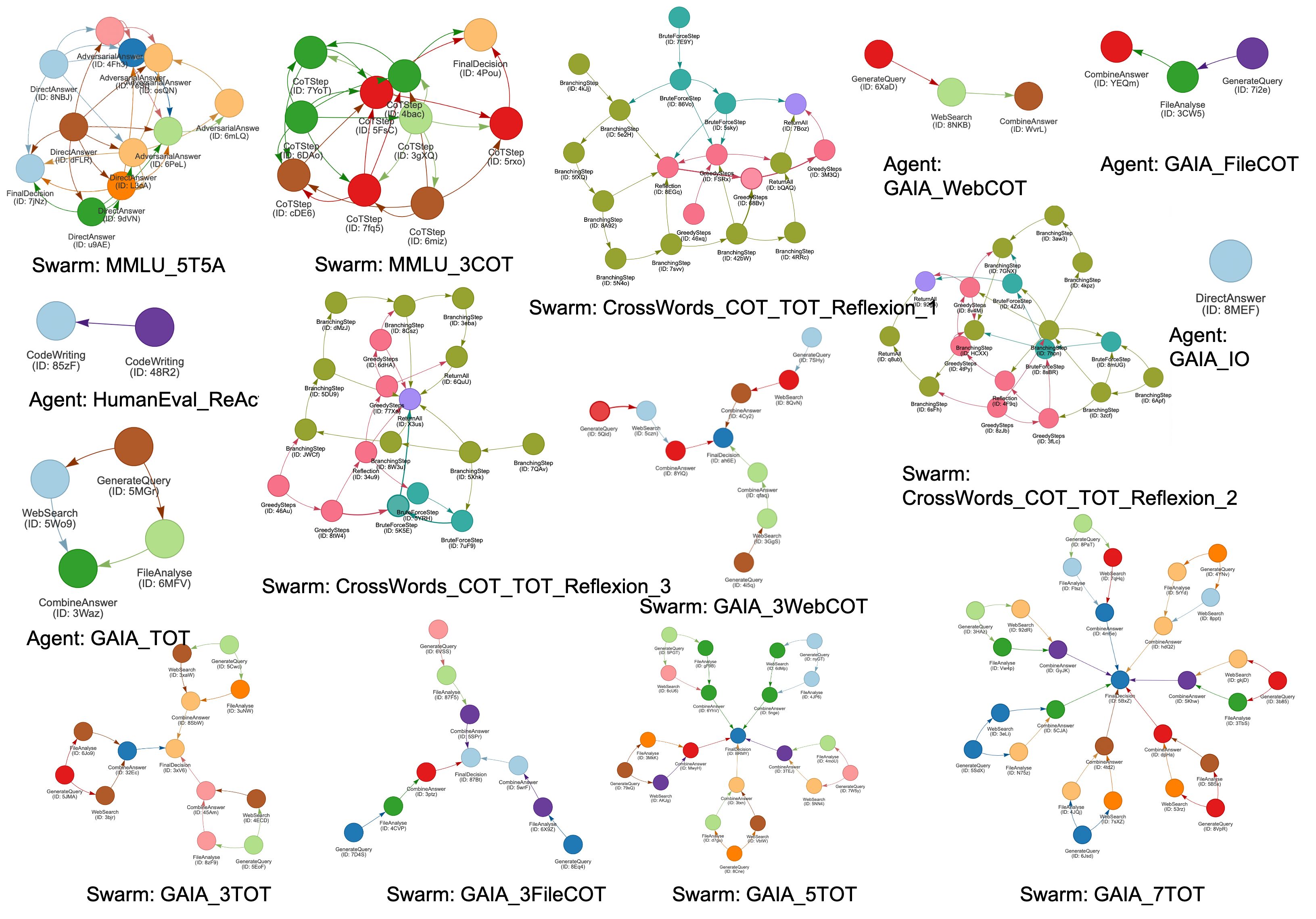

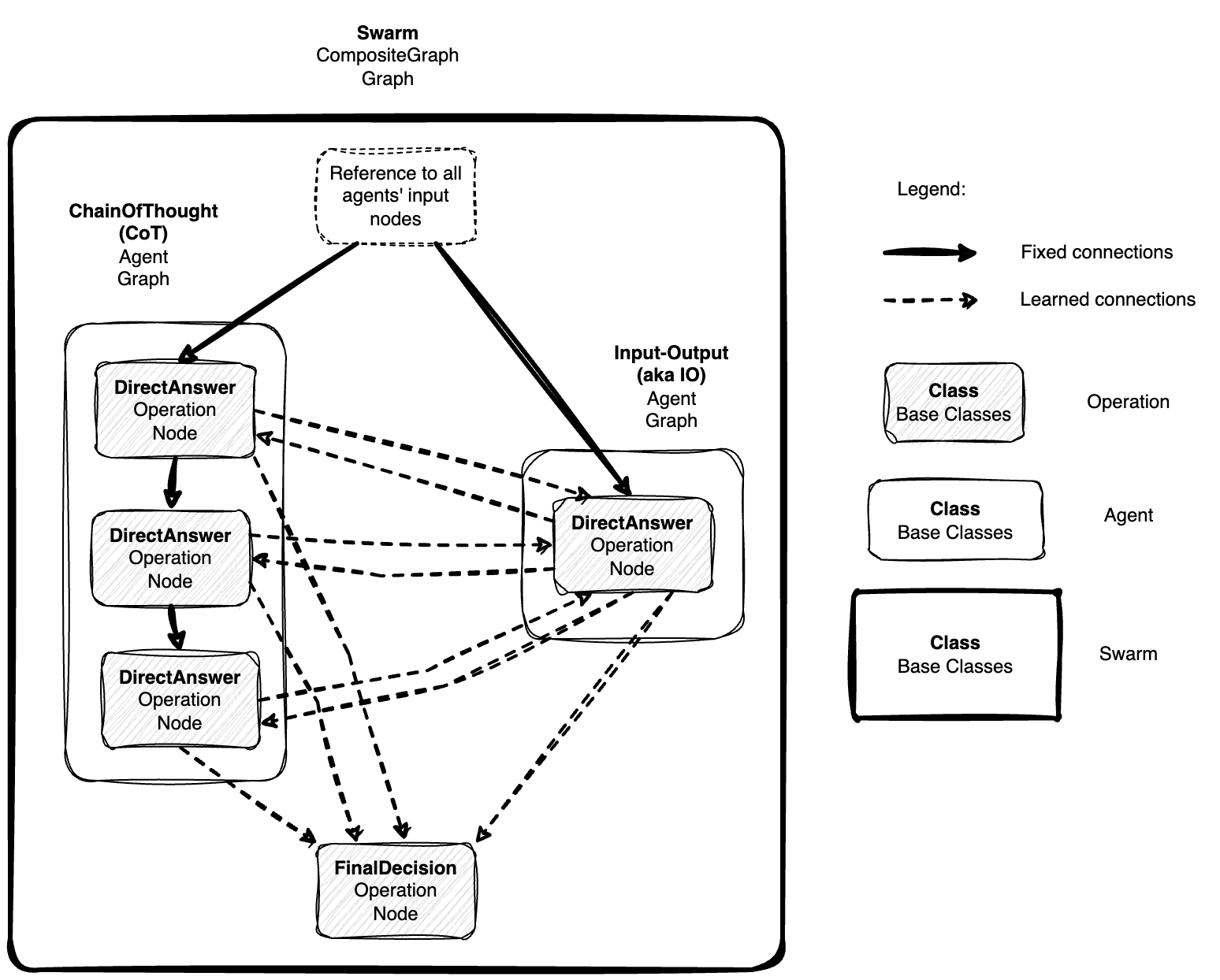

ベンチマークスコアの改善に向けてEDGE確率を更新するEDGE最適化プロセスを以下に示します。エージェント内ではエッジが固定されているのに対し、エージェント間接続はエッジプルーニング(値0、青)または作成(値1、赤)のいずれかに最適化されていることに注意してください。

レポをクローンします

git clone https://github.com/metauto-ai/GPTSwarm.git

cd GPTSwarm/パッケージをインストールします

conda create -n swarm python=3.10

conda activate swarm

pip install poetry

poetry install

apiキーを.env.templateに追加し、その名前を.envに変更する必要があります

OPENAI_API_KEY = "" # for OpenAI LLM backend

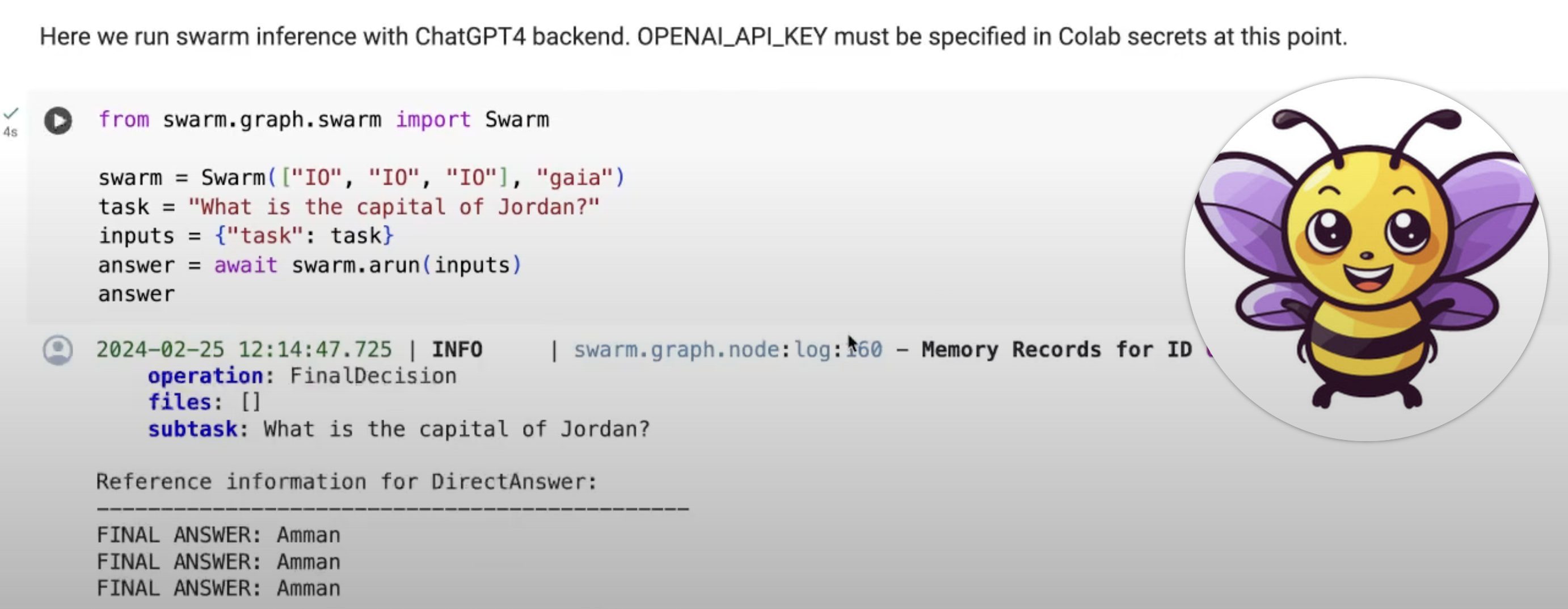

SEARCHAPI_API_KEY = "" # for Web SearchGptswarmを始めるのは簡単です。事前定義された群れをすばやく実行します

from swarm . graph . swarm import Swarm

swarm = Swarm ([ "IO" , "IO" , "IO" ], "gaia" )

task = "What is the capital of Jordan?"

inputs = { "task" : task }

answer = await swarm . arun ( inputs )または、ファイルアナライザーなどのツールを使用する

from swarm . graph . swarm import Swarm

swarm = Swarm ([ "IO" , "TOT" ], "gaia" )

task = "Tell me more about this image and summarize it in 3 sentences."

files = [ "./datasets/demos/js.png" ]

inputs = { "task" : task , "files" : files }

danswer = swarm . run ( inputs )Colabで最小限の群れの例をご覧ください。

ここでカスタムエージェントを作成し、ここで群れを実行する方法をご覧ください。

デモノートブックの実行方法に関するYouTubeビデオは次のとおりです。

私たちのフレームワークのより高度な使用については、実験をご覧ください。

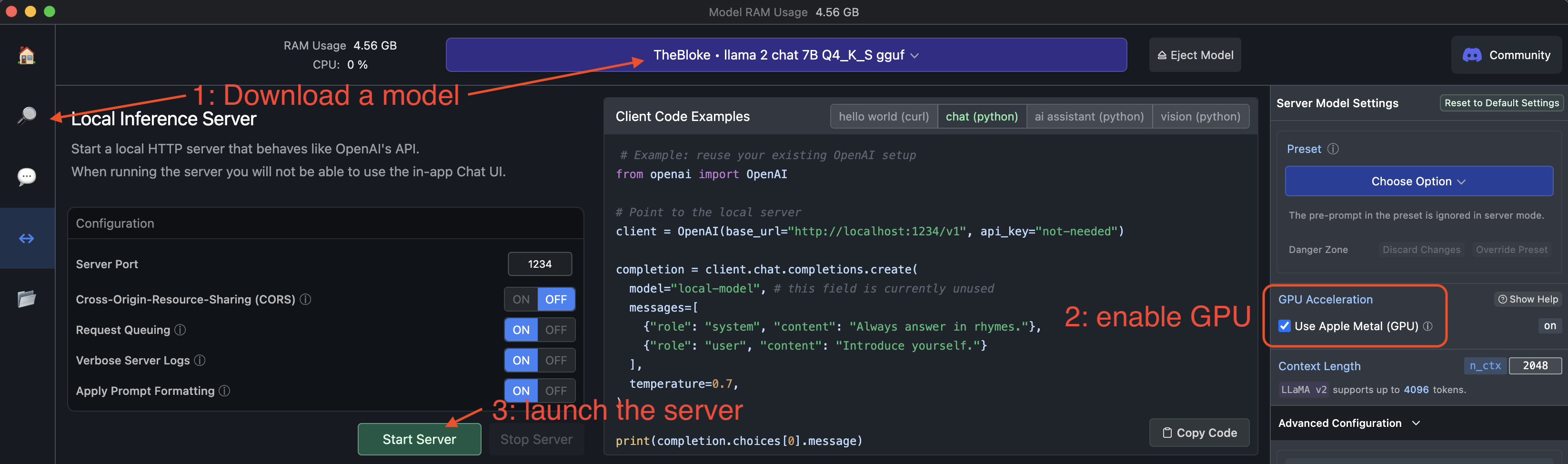

LM Studio経由でローカルLM推論をサポートしています。 MacまたはWindows用のデスクトップアプリをダウンロードして、Huggingfaceリポジトリからモデルを選択してサーバーを開始します。 GPTSWARMコードでmodel_name='lmstudio'を使用して、ローカルLLMで実行します。

貢献に興味がある場合は、開発者ドキュメントをお読みください。

ライブラリが便利または面白いと思われる場合は、私たちの論文を引用してください。

@inproceedings{zhugegptswarm,

title={GPTSwarm: Language Agents as Optimizable Graphs},

author={Zhuge, Mingchen and Wang, Wenyi and Kirsch, Louis and Faccio, Francesco and Khizbullin, Dmitrii and Schmidhuber, J{"u}rgen},

booktitle={Forty-first International Conference on Machine Learning}

}