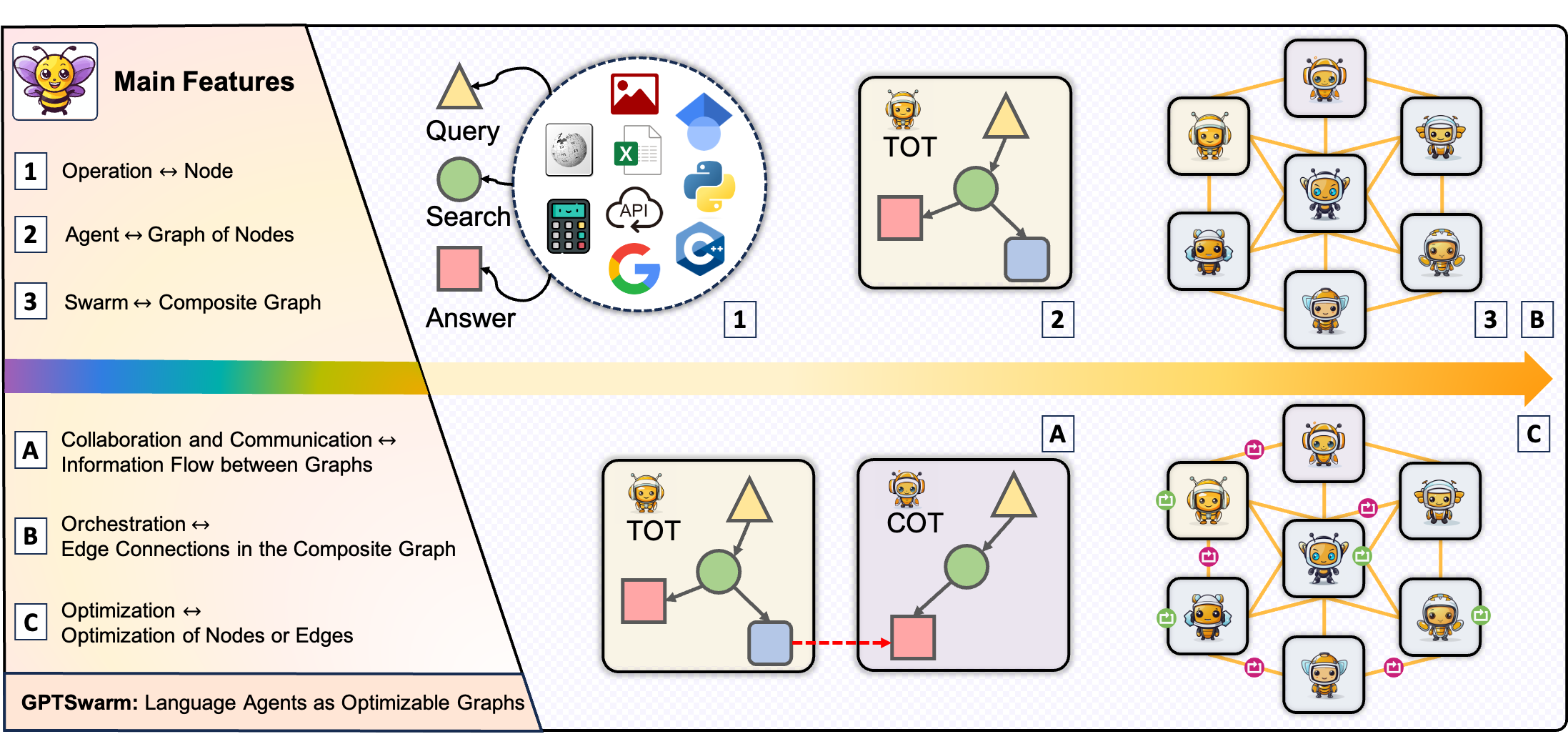

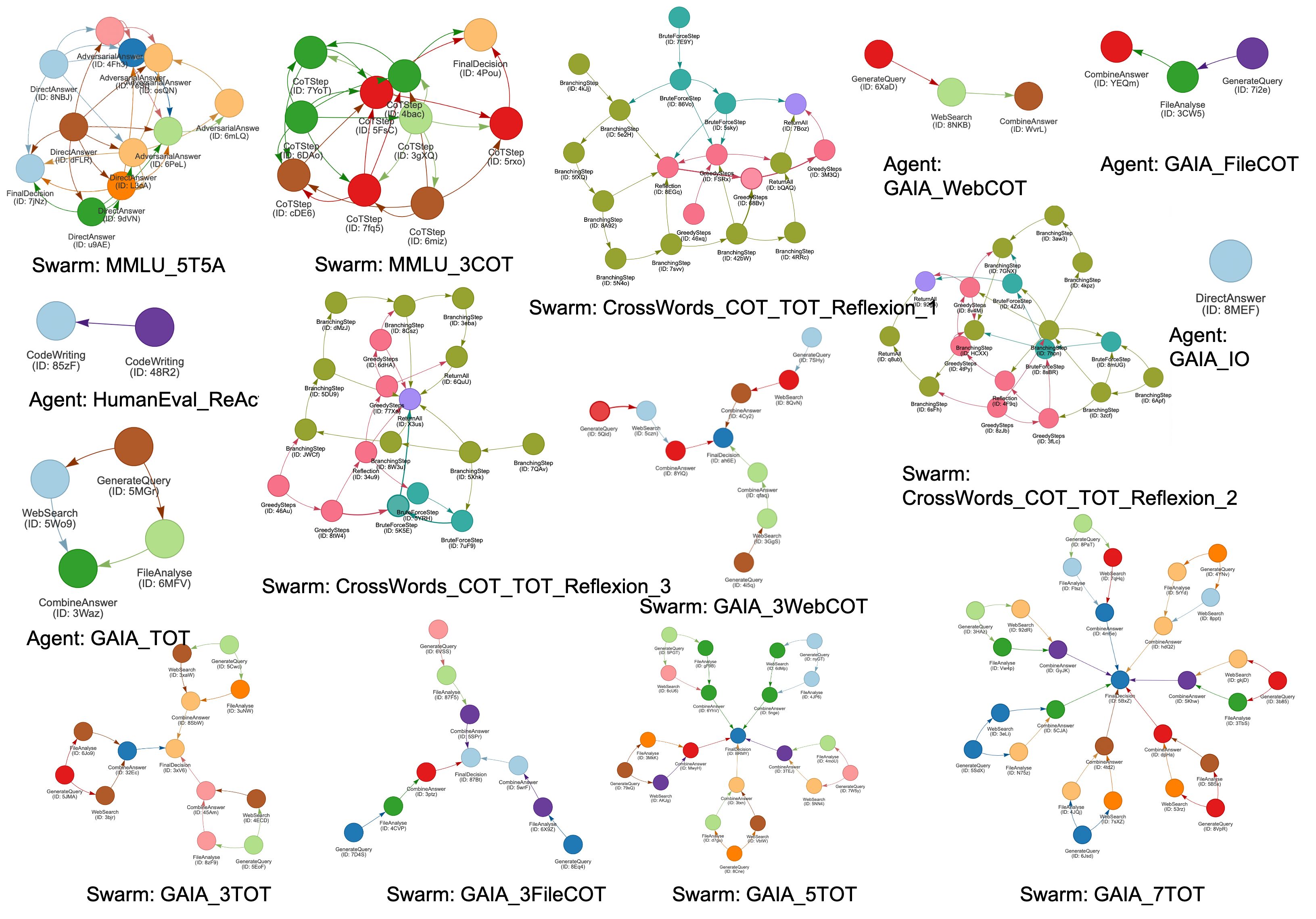

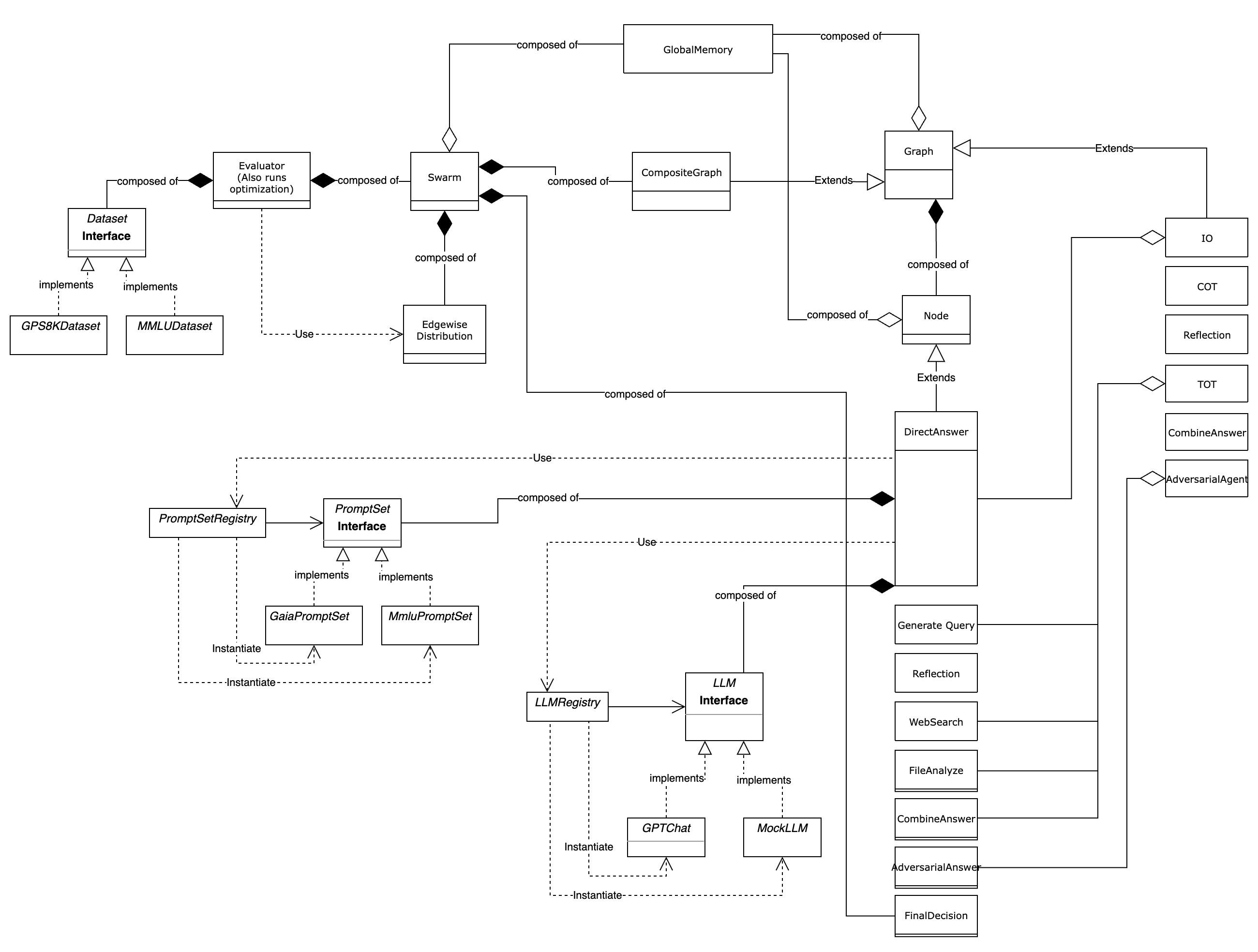

? GPTSwarm est un cadre basé sur des graphiques pour les agents basés sur LLM, offrant deux fonctionnalités de haut niveau:

Au niveau granulaire, GPTSwarm est une bibliothèque qui comprend les composants suivants:

| Module | Description |

|---|---|

| essaim.environment | Opérations, agents, outils et tâches spécifiques au domaine |

| swarm.graph | Fonctions liées aux graphiques pour créer et exécuter des graphiques d'agent et des graphiques composites d'essaim |

| swarm.llm | Interface pour sélectionner les backends LLM et calculer leurs coûts opérationnels |

| essaim.Memory | Mémoire basée sur l'index |

| swarm.optimizer | Algorithmes d'optimisation conçus pour améliorer les performances des agents et l'efficacité globale de l'essaim |

? [10/12] Respect? L'essaim d'Openai, mais? GPTSwarm est la meilleure option si considérez le? Swarm Intelligence ?.

[08/07] Mingchen a assisté à un séminaire invité avec Shanghai Ai Lab.

[07/25] Louis et Francesco ont fait la présentation orale dans ICML 2024.

[07/17] Mingchen a introduit GPTSwarm à Meta.

[07/05] Mingchen a donné une conversation invitée à WAIC.

[06/21] Mingchen a donné une conversation invitée à IA-Cas.

[06/20] Dmitrii a donné une conférence invitée à Sberbank.

[06/03] SDAIA a invité l'équipe GPTSWARM (Wenyi, Francesco, Dmitrii) pour un séminaire de 5 heures.

[06/02] GPTSWARM a été sélectionné comme présentation orale (1,5% supérieur, 144 en 9 473) par ICML2024! Félicitations!

[05/01] GPTSWARM a été accepté par ICML2024.

[04/18] Mingchen a donné le discours invité à Bytedance.

[03/20] Mingchen a donné le discours invité à Huawei.

[03/13] Entretien exclusif de Mittr China avec Mingchen.

[03/01] GPTSWARM peut être installé via PIP Now: pip install gptswarm

[02/27] Notre article académique: les agents linguistiques en tant que graphiques optimisables sont publiés.

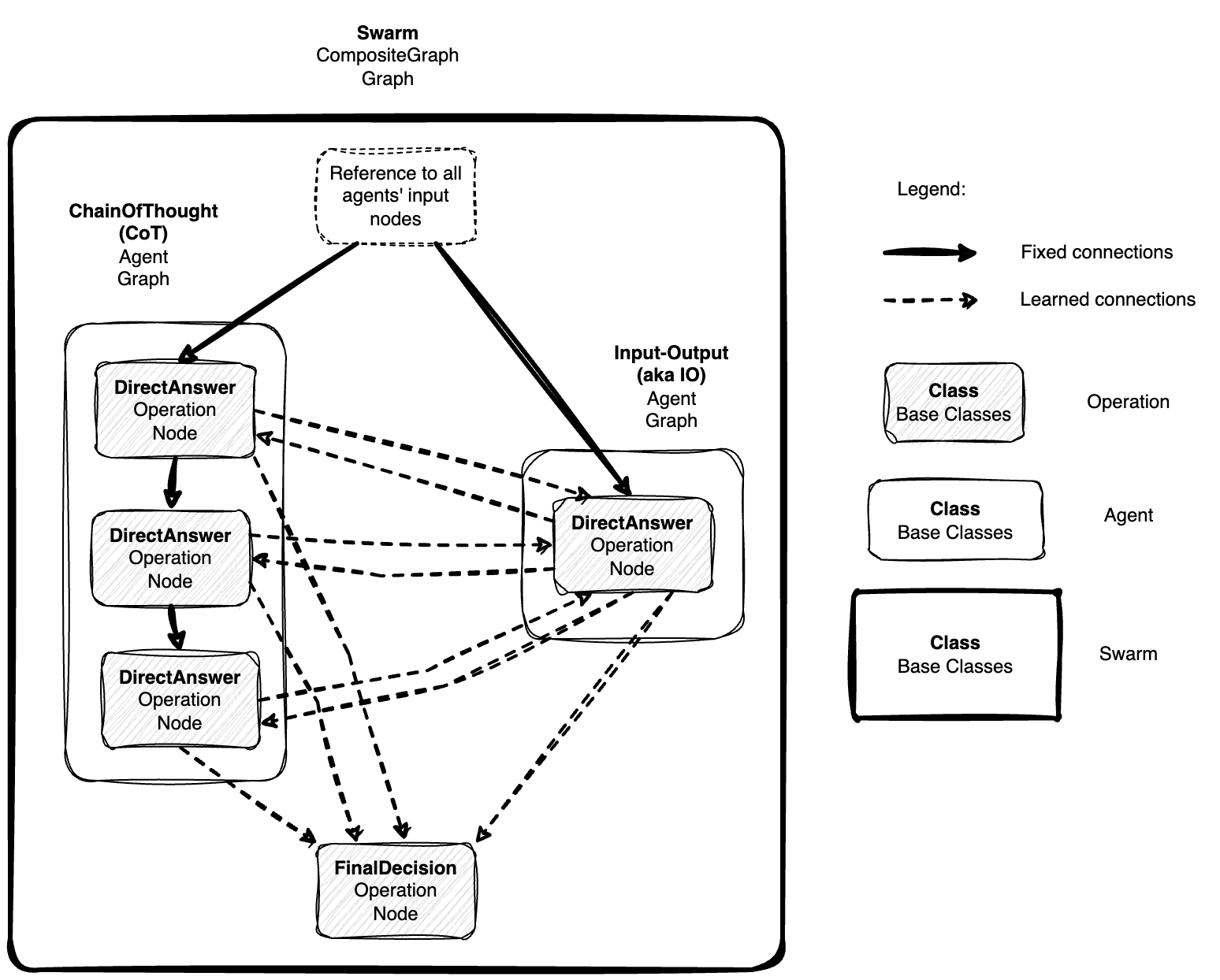

Voici le processus d'optimisation des bords qui met à jour les probabilités Edge vers l'amélioration du score de référence. Notez que dans un agent, les bords sont fixes, tandis que les connexions inter-agents sont optimisées vers l'élagage des bords (valeur 0, bleu) ou la création (valeur 1, rouge).

Cloner le repo

git clone https://github.com/metauto-ai/GPTSwarm.git

cd GPTSwarm/Installer des packages

conda create -n swarm python=3.10

conda activate swarm

pip install poetry

poetry install

Vous devez ajouter des touches API dans .env.template et changer son nom en .env

OPENAI_API_KEY = "" # for OpenAI LLM backend

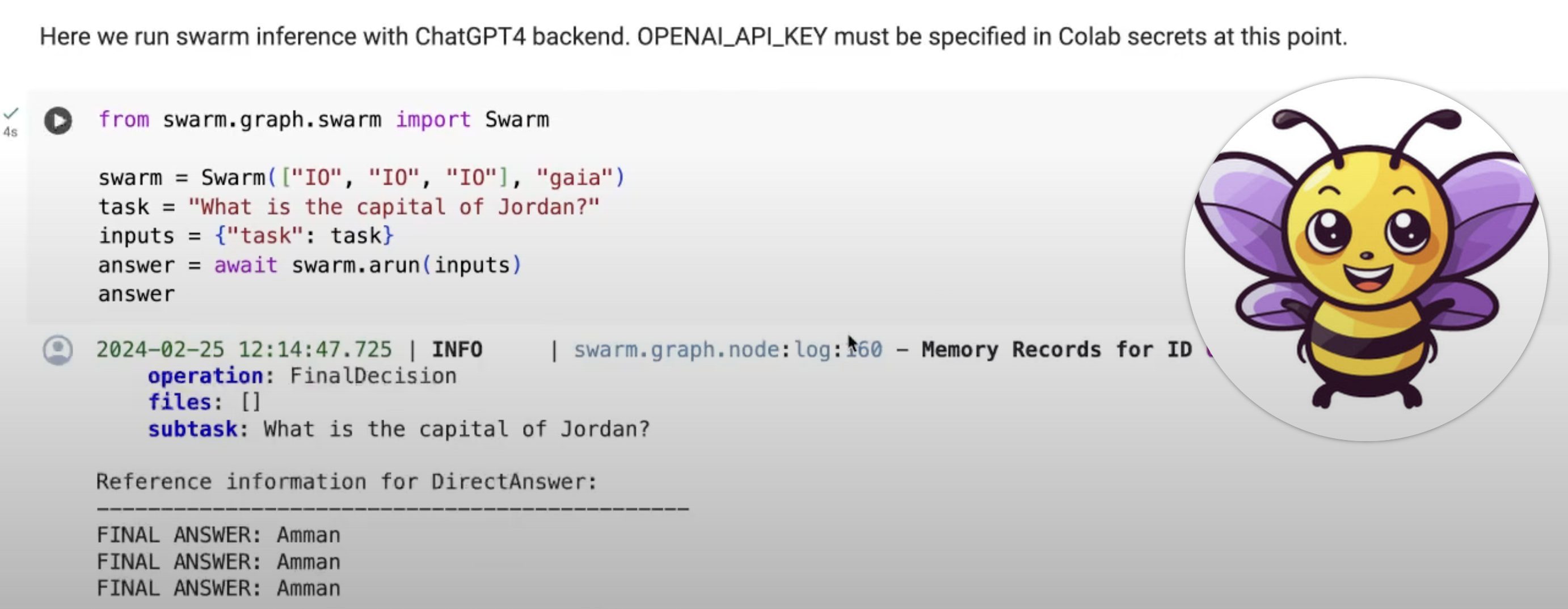

SEARCHAPI_API_KEY = "" # for Web SearchIl est facile de commencer avec GPTSwarm. Exécuter rapidement un essaim prédéfini

from swarm . graph . swarm import Swarm

swarm = Swarm ([ "IO" , "IO" , "IO" ], "gaia" )

task = "What is the capital of Jordan?"

inputs = { "task" : task }

answer = await swarm . arun ( inputs )ou utilisez des outils, tels que l'analyseur de fichiers

from swarm . graph . swarm import Swarm

swarm = Swarm ([ "IO" , "TOT" ], "gaia" )

task = "Tell me more about this image and summarize it in 3 sentences."

files = [ "./datasets/demos/js.png" ]

inputs = { "task" : task , "files" : files }

danswer = swarm . run ( inputs )Découvrez l'exemple d'essaim minimal dans Colab ici :.

Voyez comment créer un agent personnalisé et exécutez un essaim avec lui ici :.

Voici une vidéo YouTube sur la façon d'exécuter les cahiers de démonstration:

Voir nos expériences pour une utilisation plus avancée de notre cadre.

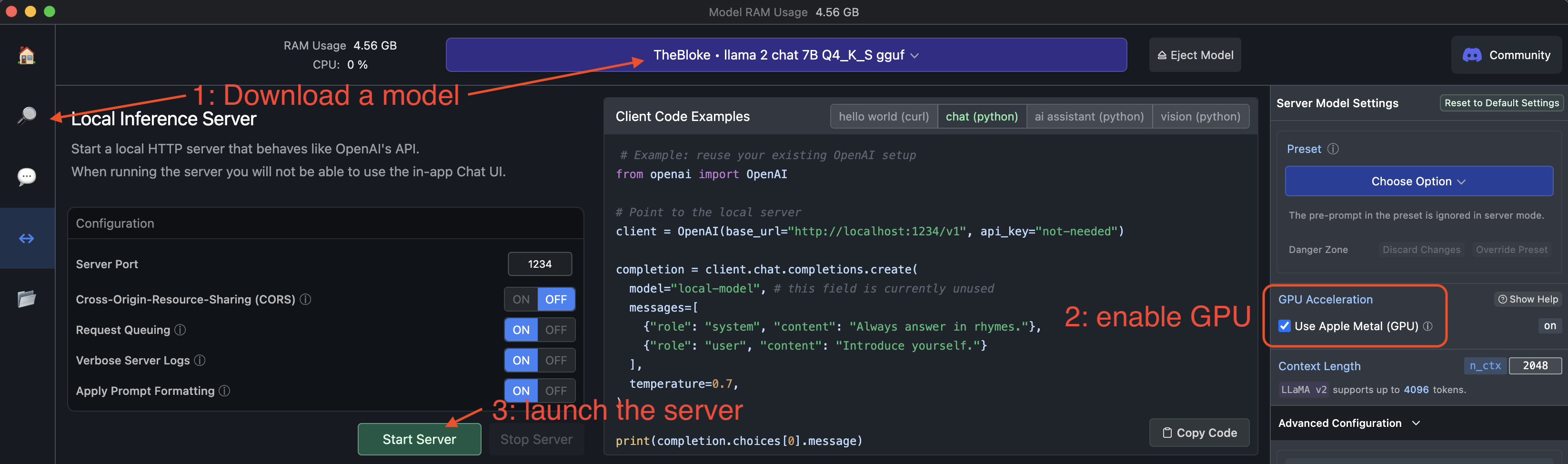

Nous soutenons l'inférence LM locale via LM Studio. Téléchargez leur application de bureau pour Mac ou Windows, choisissez un modèle dans le référentiel HuggingFace et démarrez le serveur. Utilisez model_name='lmstudio' dans le code GPTSWARM pour exécuter avec le LLM local.

Veuillez lire notre document de développeur si vous souhaitez contribuer.

Veuillez citer notre article si vous trouvez la bibliothèque utile ou intéressante.

@inproceedings{zhugegptswarm,

title={GPTSwarm: Language Agents as Optimizable Graphs},

author={Zhuge, Mingchen and Wang, Wenyi and Kirsch, Louis and Faccio, Francesco and Khizbullin, Dmitrii and Schmidhuber, J{"u}rgen},

booktitle={Forty-first International Conference on Machine Learning}

}