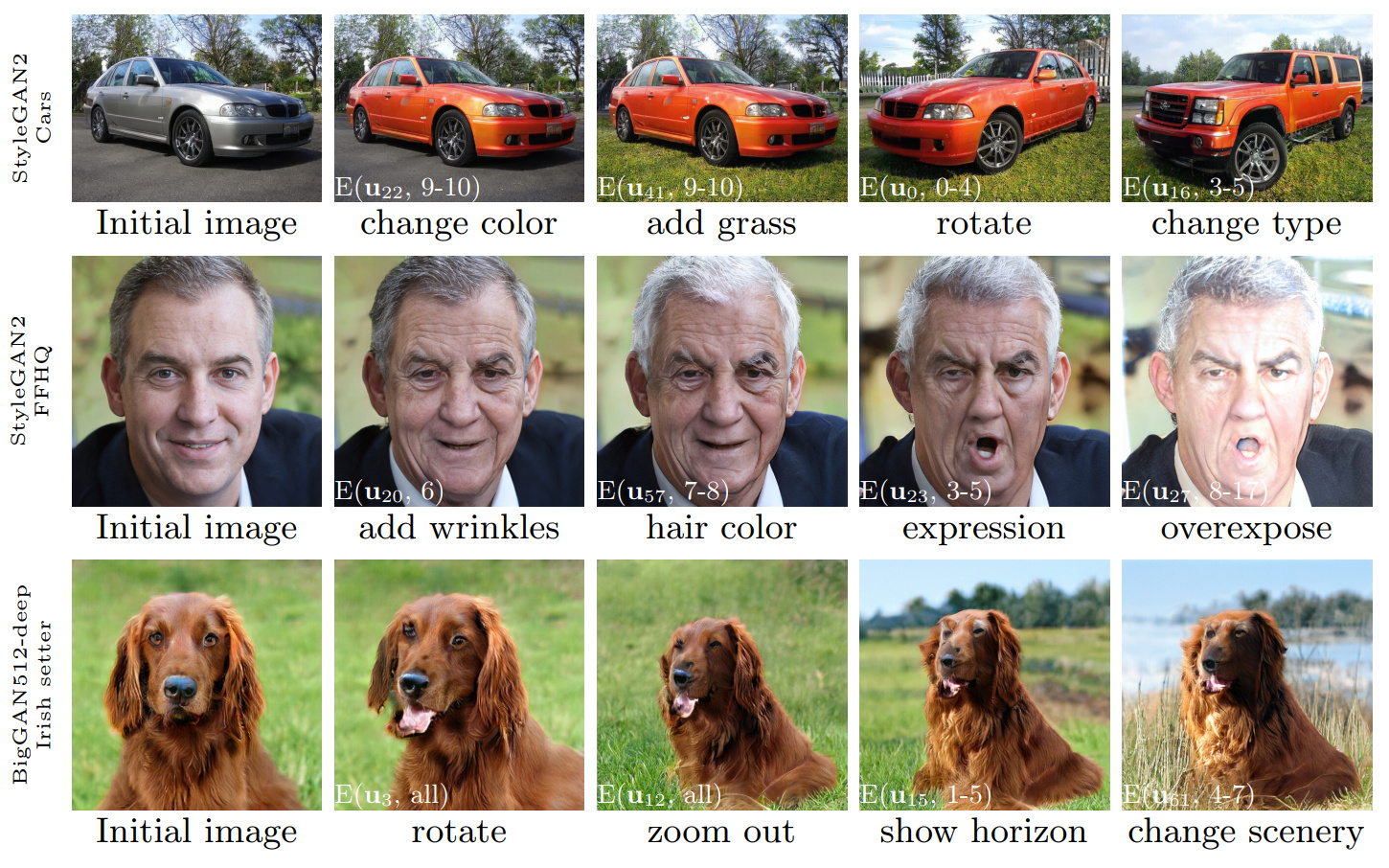

Gambar 1: Urutan pengeditan gambar yang dilakukan menggunakan kontrol yang ditemukan dengan metode kami, diterapkan pada tiga GAN yang berbeda. Inset putih menentukan pengeditan khusus menggunakan notasi yang dijelaskan dalam Bagian 3.4 ('Edit Lapisan-bijaksana').

Ganspace: Menemukan kontrol GAN yang dapat ditafsirkan

Erik Härkönen 1,2 , Aaron Hertzmann 2 , Jaakko Lehtinen 1,3 , Sylvain Paris 2

1 Universitas Aalto, 2 Adobe Research, 3 Nvidia

https://arxiv.org/abs/2004.02546Abstrak: Makalah ini menjelaskan teknik sederhana untuk menganalisis jaringan permusuhan generatif (GANS) dan membuat kontrol yang dapat ditafsirkan untuk sintesis gambar, seperti perubahan sudut pandang, penuaan, pencahayaan, dan waktu hari. Kami mengidentifikasi arah laten penting berdasarkan analisis komponen utama (PCA) yang diterapkan dalam ruang aktivasi. Kemudian, kami menunjukkan bahwa pengeditan yang dapat ditafsirkan dapat didefinisikan berdasarkan aplikasi lapisan-bijaksana dari arah edit ini. Selain itu, kami menunjukkan bahwa Biggan dapat dikendalikan dengan input lapisan bijaksana dengan cara seperti StyleGan. Pengguna dapat mengidentifikasi sejumlah besar kontrol yang dapat ditafsirkan dengan mekanisme ini. Kami menunjukkan hasil pada GAN dari berbagai dataset.

Video: https://youtu.be/jdticda_eai

Lihat instruksi pengaturan.

Repositori ini mencakup versi Biggan, StyleGan, dan StyleGan2 yang dimodifikasi untuk mendukung vektor laten per-lapisan.

Eksplorasi model interaktif

# Explore BigGAN-deep husky

python interactive.py --model=BigGAN-512 --class=husky --layer=generator.gen_z -n=1_000_000

# Explore StyleGAN2 ffhq in W space

python interactive.py --model=StyleGAN2 --class=ffhq --layer=style --use_w -n=1_000_000 -b=10_000

# Explore StyleGAN2 cars in Z space

python interactive.py --model=StyleGAN2 --class=car --layer=style -n=1_000_000 -b=10_000

# Apply previously saved edits interactively

python interactive.py --model=StyleGAN2 --class=ffhq --layer=style --use_w --inputs=out/directions

Visualisasikan komponen utama

# Visualize StyleGAN2 ffhq W principal components

python visualize.py --model=StyleGAN2 --class=ffhq --use_w --layer=style -b=10_000

# Create videos of StyleGAN wikiart components (saved to ./out)

python visualize.py --model=StyleGAN --class=wikiart --use_w --layer=g_mapping -b=10_000 --batch --video

Opsi

Command line paramaters:

--model one of [ProGAN, BigGAN-512, BigGAN-256, BigGAN-128, StyleGAN, StyleGAN2]

--class class name; leave empty to list options

--layer layer at which to perform PCA; leave empty to list options

--use_w treat W as the main latent space (StyleGAN / StyleGAN2)

--inputs load previously exported edits from directory

--sigma number of stdevs to use in visualize.py

-n number of PCA samples

-b override automatic minibatch size detection

-c number of components to keep

Semua angka yang disajikan dalam makalah utama dapat diciptakan kembali menggunakan buku catatan Jupyter yang disertakan:

figure_teaser.ipynbfigure_pca_illustration.ipynbfigure_pca_cleanup.ipynbfigure_style_content_sep.ipynbfigure_supervised_comp.ipynbfigure_biggan_style_resampling.ipynbfigure_edit_zoo.ipynb models/wrappers.py menggunakan antarmuka BaseModel .get_model() di models/wrappers.py . Dimungkinkan untuk mengimpor bobot StyleGan dan StyleGan2 terlatih dari TensorFlow ke Ganspace.

conda install tensorflow-gpu=1.* .__init__() , load_model() dalam models/wrappers.py di bawah kelas stylegan.checkpoints/stylegan2/<dataset>_<resolution>.pt .__init__() , download_checkpoint() dalam models/wrappers.py di bawah kelas styleGan2. Kami ingin mengucapkan terima kasih:

@inproceedings{härkönen2020ganspace,

title = {GANSpace: Discovering Interpretable GAN Controls},

author = {Erik Härkönen and Aaron Hertzmann and Jaakko Lehtinen and Sylvain Paris},

booktitle = {Proc. NeurIPS},

year = {2020}

}

Kode repositori ini dirilis di bawah lisensi Apache 2.0.

Direktori netdissect adalah turunan dari proyek diseksi GAN, dan disediakan di bawah lisensi MIT.

models/biggan dan models/stylegan2 disediakan di bawah lisensi MIT.