Récemment, Arcee Spark, un modèle de langage à grande échelle basé sur Qwen2, est né. Avec sa longueur de contexte de 128 000 jetons et son réglage précis sur 1,8 million d'échantillons de données, il a fait des vagues dans le domaine de l'intelligence artificielle. Arcee Spark affiche de solides performances et se démarque dans plusieurs tests de référence, dépassant même GPT-3.5, qui établit sans aucun doute une nouvelle référence pour le développement de grands modèles de langage. Son échelle de paramètres 7B reflète également son amélioration significative en termes de vitesse et de performances.

Récemment, Arcee Spark, un modèle basé sur Qwen2, a été affiné sur 1,8 million d'échantillons de données et dispose de 128 000 jetons de contexte. La sortie d'Arcee Spark a suscité une large attention, notamment parmi les praticiens du domaine de l'intelligence artificielle.

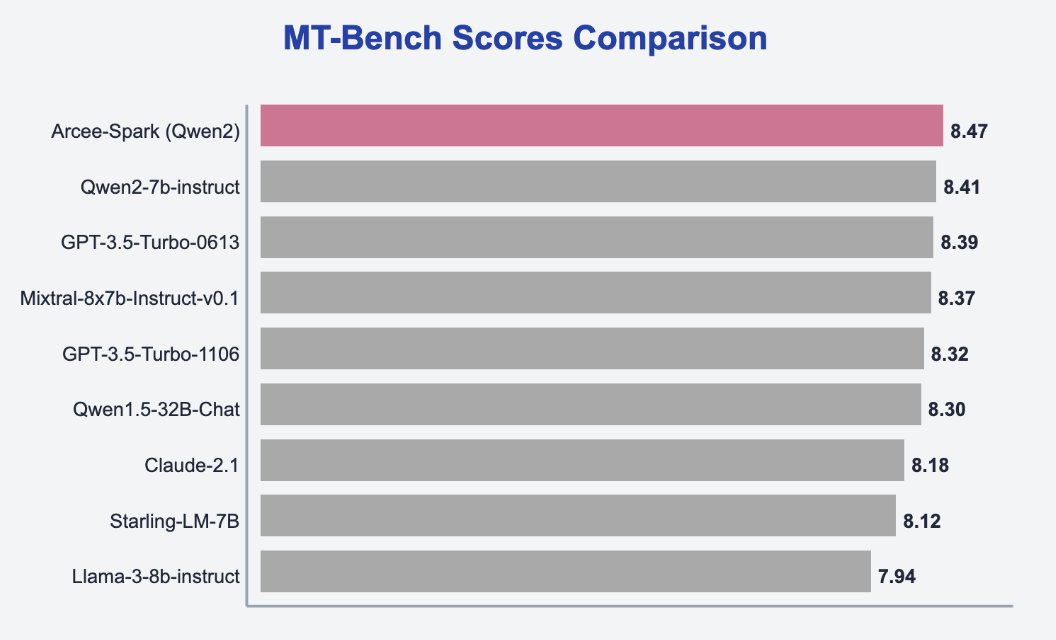

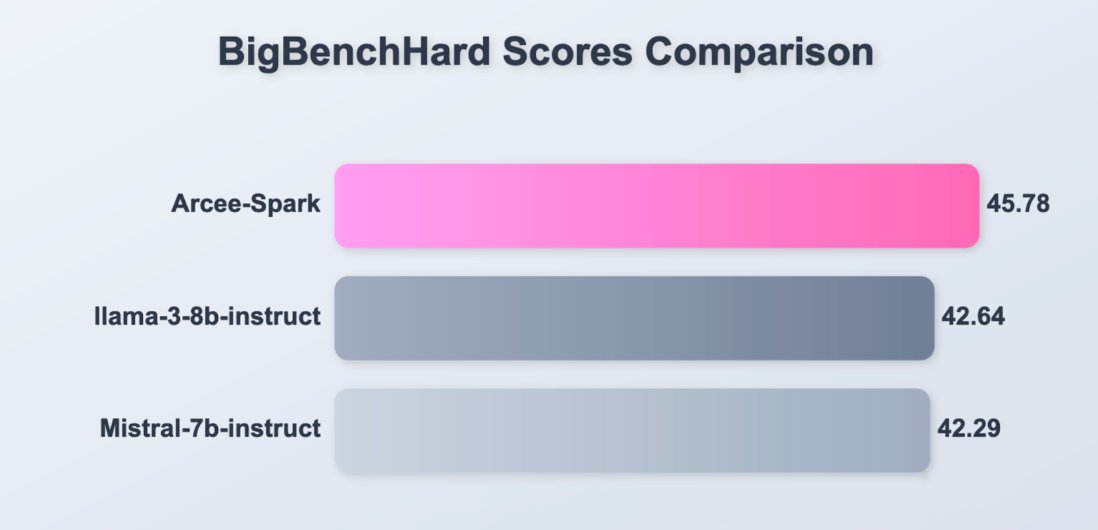

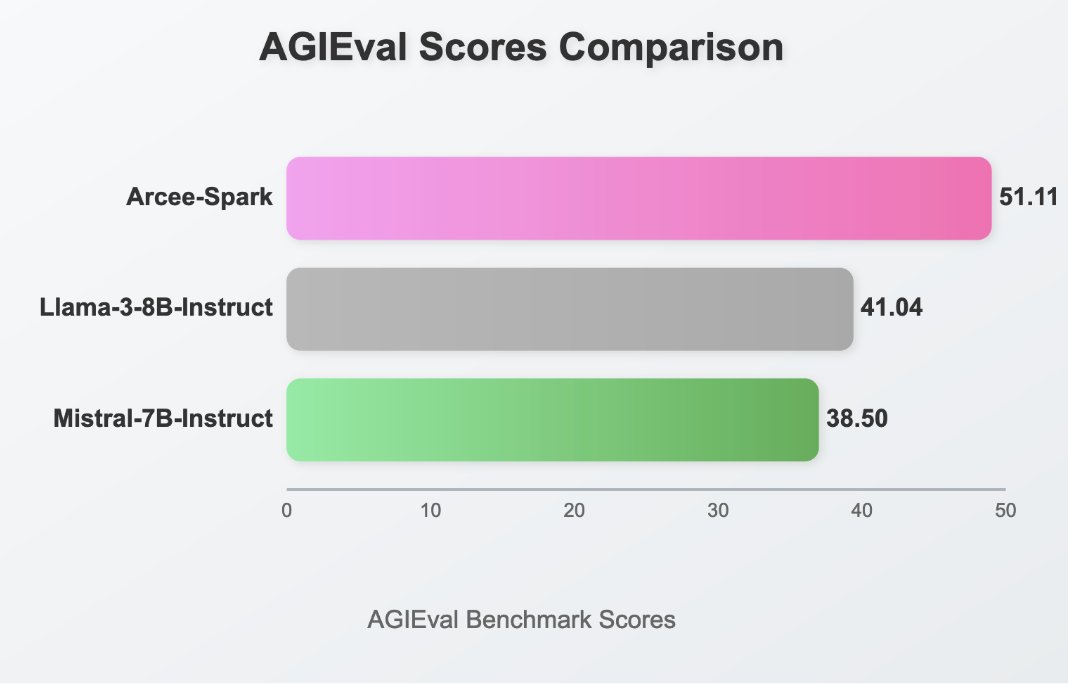

Il fonctionne bien dans des benchmarks tels que MT-Bench, obtenant les scores les plus élevés parmi des modèles similaires et dépassant même GPT-3.5 sur plusieurs tâches. Il est entendu qu'Arcee Spark est un modèle de paramètres 7B et une version plus rapide et plus puissante de Qwen2.

L’émergence d’Arcee Spark représente non seulement une avancée significative dans la technologie des modèles de langage à grande échelle, mais indique également la possibilité d’une orientation future du développement de la technologie de l’IA. Ses performances puissantes et sa vitesse de fonctionnement efficace apporteront des perspectives d'application plus larges à tous les horizons, et il vaut la peine d'attendre avec impatience des recherches et des applications plus approfondies.