Vor kurzem wurde Arcee Spark geboren, ein groß angelegtes Sprachmodell auf Basis von Qwen2. Mit seiner Kontextlänge von 128.000 Token und der Feinabstimmung auf 1,8 Millionen Beispieldaten hat es im Bereich der künstlichen Intelligenz für Aufsehen gesorgt. Arcee Spark zeigt eine starke Leistung und sticht in mehreren Benchmark-Tests heraus und übertrifft sogar GPT-3.5, was zweifellos einen neuen Maßstab für die Entwicklung umfangreicher Sprachmodelle setzt. Seine 7B-Parameterskala spiegelt auch die deutliche Verbesserung von Geschwindigkeit und Leistung wider.

Kürzlich wurde ein Qwen2-basiertes Modell Arcee Spark anhand von 1,8 Millionen Beispieldaten verfeinert und verfügt über 128.000 Token-Kontext. Die Veröffentlichung von Arcee Spark hat große Aufmerksamkeit erregt, insbesondere unter Praktikern im Bereich der künstlichen Intelligenz.

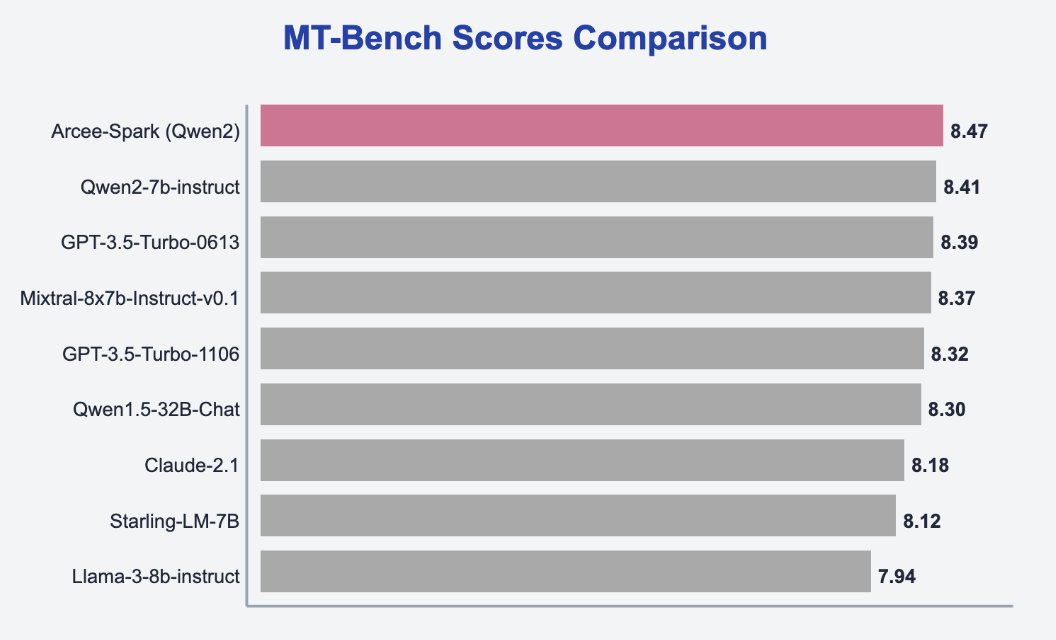

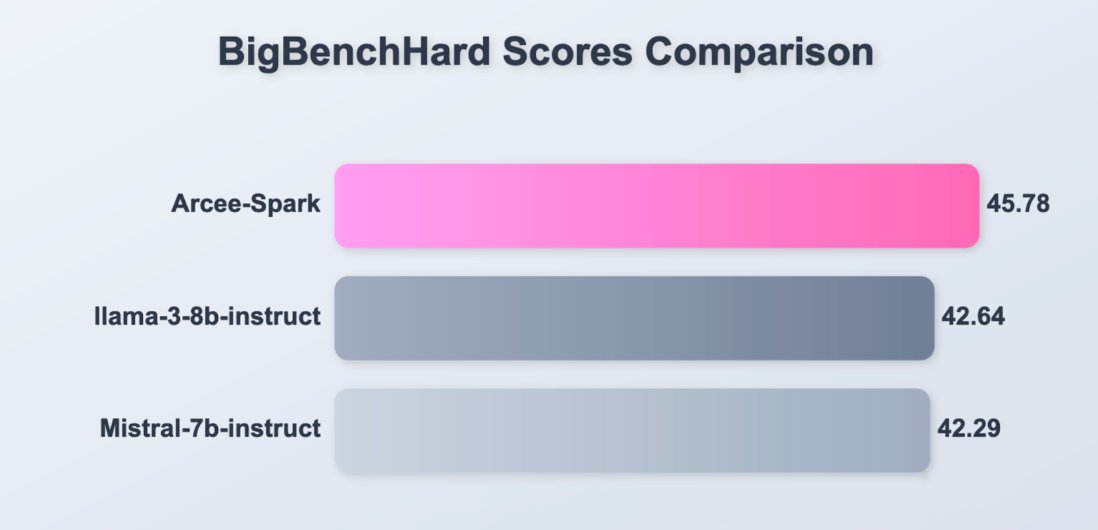

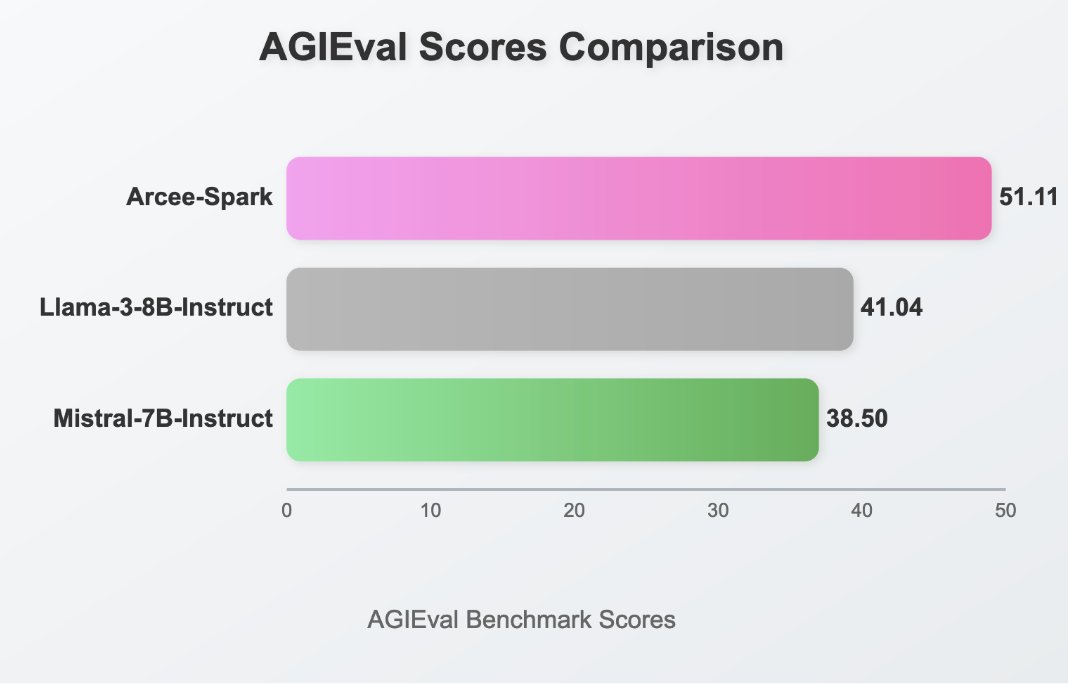

In Benchmarks wie MT-Bench schneidet es gut ab, erreicht die höchsten Werte unter ähnlichen Modellen und übertrifft bei mehreren Aufgaben sogar GPT-3.5. Es versteht sich, dass Arcee Spark ein 7B-Parametermodell und eine schnellere und leistungsfähigere Version von Qwen2 ist.

Das Aufkommen von Arcee Spark stellt nicht nur einen bedeutenden Fortschritt in der groß angelegten Sprachmodelltechnologie dar, sondern weist auch auf die Möglichkeit der zukünftigen Entwicklungsrichtung der KI-Technologie hin. Seine starke Leistung und effiziente Betriebsgeschwindigkeit werden breitere Anwendungsaussichten in allen Lebensbereichen eröffnen, und es lohnt sich, sich auf weitere eingehende Forschung und Anwendungen zu freuen.