? Coala: agentes de idiomas impresionantes

Una compilación de agentes lingüísticos que utilizan el marco de arquitecturas cognitivas para agentes lingüísticos (? Coala) .

- Documento de Coola (16 páginas de contenido principal): https://arxiv.org/abs/2309.02427

- Tweet de carbona (6 hilos): https://twitter.com/shunyuyao12/status/1699396834983362690

- Archivo de bibtex de Coala con más de 300 citas relacionadas: Coala.bib

- Cita de Coola Bibtex Si encuentra útil nuestro trabajo/recursos:

@misc { sumers2023cognitive ,

title = { Cognitive Architectures for Language Agents } ,

author = { Theodore Sumers and Shunyu Yao and Karthik Narasimhan and Thomas L. Griffiths } ,

year = { 2023 } ,

eprint = { 2309.02427 } ,

archivePrefix = { arXiv } ,

primaryClass = { cs.AI }

}? Descripción general del carbón

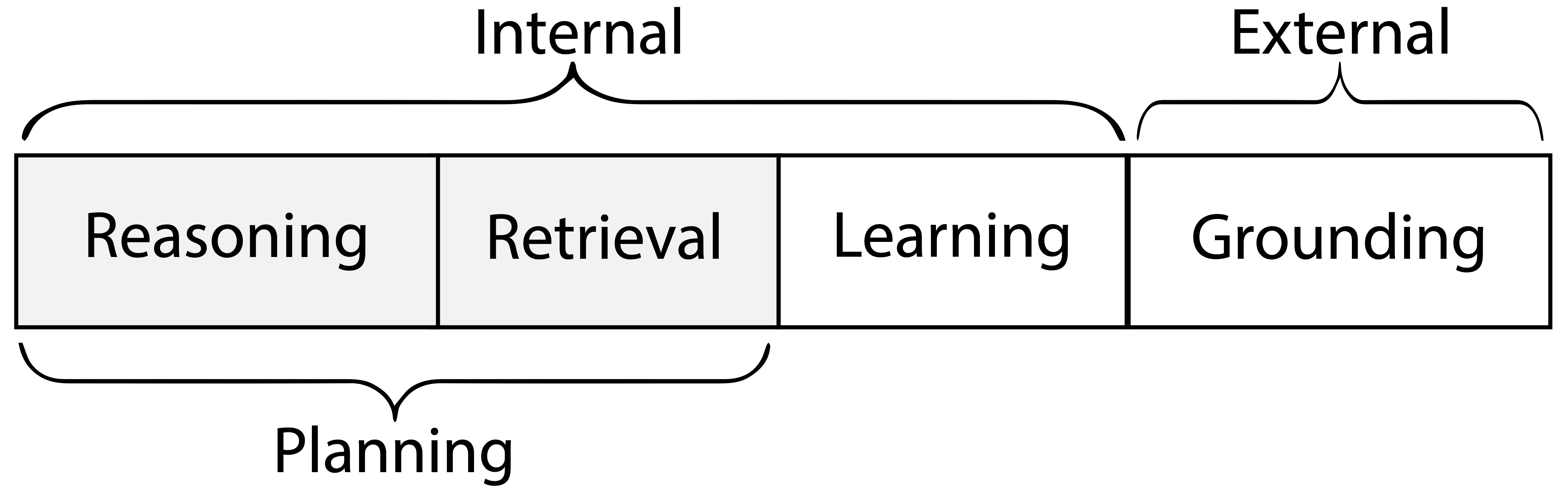

Coala especifica cuidadosamente un agente de idiomas que comienza con su espacio de acción , que tiene 2 partes:

- Acciones externas para interactuar con entornos externas ( conexión a tierra )

- Acciones internas para interactuar con recuerdos internos ( razonamiento , recuperación , aprendizaje )

- Un agente de idiomas tiene una memoria de trabajo a corto plazo y varios recuerdos (opcionales) a largo plazo (episódico para la experiencia, semántico para el conocimiento, procedimiento para código/LLM)

- Razonamiento = actualizar la memoria de trabajo (con LLM)

- Recuperación = leer memoria a largo plazo

- Aprendizaje = escribir memoria a largo plazo

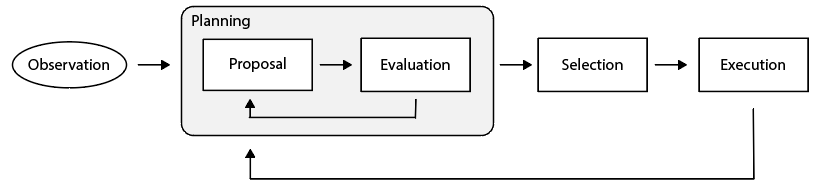

Entonces, ¿cómo elige un agente de idiomas qué acción tomar? Sus acciones se estructuran en los ciclos de toma de decisiones , y cada ciclo tiene dos etapas:

- Planificación : el agente aplica acciones de razonamiento/recuperación para (iterativamente) proponer y evaluar acciones, luego seleccione una acción de aprendizaje/base.

- Ejecución : la acción de aprendizaje/puesta en marcha seleccionada se ejecuta para afectar la memoria interna o el mundo externo.

Para comprender más, lea la Sección 4 de nuestro artículo.

Papeles

A continuación se muestra solo un subconjunto de documentos raspados de Coala.bib más solicitudes extraídas, con etiquetas de espacio de acción potencialmente incorrectas. La fecha se basa en ARXIV V1. No representan todo el trabajo de agentes de idiomas, y planeamos agregar más trabajo pronto (aplique las solicitudes de bienvenida) y tenemos etiquetas para el trabajo altamente citado.

- (2021-10) Cadenas de IA: interacción Human-AI transparente y controlable al encadenar las indicaciones del modelo de lenguaje grandes (razonamiento)

- (2021-10) SILG: el marco de referencia de base simbólica de lingües simbólicos de múltiples versiones (entorno)

- (2022-01) Modelos de lenguaje como planificadores de disparo cero: extracción de conocimiento procesable para agentes encarnados (conexión a tierra)

- (2022-03) PromptChainer: encadenamiento del modelo de lenguaje grande a través de la programación visual (conexión a tierra)

- (2022-03) ScienceWorld: ¿Es su agente más inteligente que un estudiante de quinto grado? (ambiente)

- (2022-04) Haga lo que pueda, no como yo digo: lenguaje de conexión a tierra en posibilidades robóticas (puesta a tierra)

- (2022-04) Modelos socráticos: componer razonamiento multimodal de disparo cero con lenguaje (conexión a tierra)

- (2022-07) Webshop: hacia la interacción web escalable del mundo real con agentes de lenguaje fundamentados (entorno)

- (2022-09) ProgPrompt: Generación de planes de tareas de robot situados utilizando modelos de idiomas grandes (conexión a tierra)

- (2022-10) Información descompuesta: un enfoque modular para resolver tareas complejas (razonamiento)

- (2022-10) Ojo de la mente: razonamiento del modelo de lenguaje fundamentado a través de la simulación (conexión a tierra)

- (2022-10) Reaccionar: sinergizando razonamiento y actuación en modelos de idiomas (base, razonamiento)

- (2022-11) Los modelos de idiomas grandes son ingenieros de inmediato a nivel humano (razonamiento)

- (2022-12) LLM-Planner: Planificación de pocos disparos para agentes incorporados con grandes modelos de idiomas (conexión a tierra)

- (2022-12) No genere, discriminan: una propuesta para modelos de lenguaje de base a entornos del mundo real (conexión a tierra)

- (2023-02) La cadena de retrospectiva alinea los modelos de idiomas con retroalimentación (aprendizaje)

- (2023-02) Describa, explique, planifique y seleccione: La planificación interactiva con modelos de idiomas grandes permite agentes de tareas múltiples del mundo abierto (conexión a tierra, razonamiento)

- (2023-02) Formador de herramientas: los modelos de idiomas pueden enseñarse a usar herramientas (conexión a tierra)

- (2023-03) Modelos de base para la toma de decisiones: problemas, métodos y oportunidades (encuesta)

- (2023-03) HuggingGPT: Resolver tareas de IA con ChatGPT y sus amigos en la cara de abrazo (tierra)

- (2023-03) Palm-E: un modelo de lenguaje multimodal incorporado (conexión a tierra)

- (2023-03) Reflexión: Agentes lingüísticos con aprendizaje de refuerzo verbal (base, razonamiento, aprendizaje)

- (2023-03) AutoRefino: Refinamiento iterativo con autosuficiencia (razonamiento)

- (2023-03) Generación de códigos de autoplanning con modelos de idiomas grandes (razonamiento)

- (2023-04) Agentes generativos: simulacros interactivos del comportamiento humano (base, razonamiento, recuperación, aprendizaje)

- (2023-04) Capacidades de investigación científica autónoma emergente de modelos de idiomas grandes (base, razonamiento)

- (2023-04) LLM+P: Empoderar modelos de idiomas grandes con competencia de planificación óptima (base, razonamiento)

- (2023-04) Refinador: retroalimentación de razonamiento sobre representaciones intermedias (razonamiento)

- (2023-04) Enseñar modelos de idiomas grandes a sí mismo (razonamiento)

- (2023-04) Genegpt: Aumento de modelos de idiomas grandes con herramientas de dominio para mejorar el acceso a la información biomédica (base, razonamiento)

- (2023-05) Crítico: los modelos de idiomas grandes pueden autocorregarse con una crítica interactiva para herramientas (base, razonamiento, recuperación)

- (2023-05) Aumento de agentes autotélicos con grandes modelos de idiomas (base, razonamiento, recuperación, aprendizaje)

- (2023-05) ChatCot: razonamiento de la cadena de pensamiento de herramienta en los modelos de idiomas grandes basados en chat (base, razonamiento)

- (2023-05) Toolkengpt: Aumento de modelos de lenguaje congelado con herramientas masivas a través de integridades de herramientas (base, razonamiento)

- (2023-05) La descomposición mejora el razonamiento a través de la decodificación guiada por autoevaluación (razonamiento)

- (2023-05) Fomentar el pensamiento divergente en modelos de idiomas grandes a través del debate de múltiples agentes (base, razonamiento)

- (2023-05) Mejora de la fáctica y el razonamiento en los modelos de idiomas a través del debate multiagente (fundamento, razonamiento)

- (2023-05) Adaplanner: Planificación adaptativa a partir de comentarios con modelos de idiomas (base, recuperación, aprendizaje)

- (2023-05) Preparación de planificación y resuelto: Mejora del razonamiento de la cadena de pensamiento cero por modelos de idiomas grandes (razonamiento)

- (2023-05) Rewoo: Razonamiento de desacoplamiento de observaciones para modelos de lenguaje aumentado eficientes (base, razonamiento)

- (2023-05) Swiftsage: un agente generativo con un pensamiento rápido y lento para tareas interactivas complejas (conexión a tierra, razonamiento)

- (2023-05) Árbol de pensamientos: resolución deliberada de problemas con modelos de idiomas grandes (razonamiento)

- (2023-05) Voyager: un agente incorporado abierto con modelos de idiomas grandes (base, razonamiento, recuperación, aprendizaje)

- (2023-06) Intercode: estandarización y comparación de evaluación comparativa de codificación interactiva con retroalimentación de ejecución (base, razonamiento)

- (2023-06) Toolqa: un conjunto de datos para la respuesta de las preguntas de LLM con herramientas externas (conexión a tierra)

- (2023-06) Mind2Web: hacia un agente generalista para la web (entorno)

- (2023-06) RESTGPT: Conectación de modelos de idiomas grandes con API RESTful del mundo real (conexión a tierra, razonamiento)

- (2023-06) Toolalpaca: aprendizaje de herramientas generalizadas para modelos de idiomas con 3000 casos simulados (base, razonamiento)

- (2023-07) Un webagent del mundo real con planificación, comprensión de contexto largo y síntesis de programas (fundamento, razonamiento)

- (2023-07) RT-2: Los modelos de acción-idioma de visión transfieren el conocimiento web al control robótico (conexión a tierra)

- (2023-07) Roco: colaboración dialéctica de múltiples robots con modelos de idiomas grandes (puesta a tierra)

- (2023-07) Robots que solicitan ayuda: alineación de incertidumbre para planificadores de modelos de idiomas grandes (puesta a tierra)

- (2023-07) S $^3 $: Sistema de simulación de red social con grandes agentes empoderados con el modelo de lenguaje (base, razonamiento)

- (2023-07) TOOLLLM: Facilitar modelos de idiomas grandes para dominar más de 16000 API del mundo real (base, razonamiento, recuperación)

- (2023-07) Comprender los beneficios y desafíos del uso de agentes conversacionales basados en modelos de lenguaje para el apoyo de bienestar mental (base)

- (2023-07) Desatar la sinergia cognitiva en modelos de idiomas grandes: un agente de resolución de tareas a través de la autocolaboración multipersona (base, razonamiento)

- (2023-07) Webarena: un entorno web realista para construir agentes autónomos (entorno)

- (2023-08) Agentbench: Evaluación de LLM como agentes (entorno)

- (2023-08) Agentverse: Facilitar la colaboración de múltiples agentes y explorar comportamientos emergentes en agentes (medio ambiente)

- (2023-08) Autógeno: habilitando aplicaciones LLM de próxima generación a través del marco de conversación de múltiples agentes (base, razonamiento)

- (2023-08) CGMI: Marco de interacción general configurable de múltiples agentes (conexión a tierra, razonamiento)

- (2023-08) Chateval: Hacia mejores evaluadores basados en LLM a través del debate de múltiples agentes (base, razonamiento)

- (2023-08) Razonamiento acumulativo con grandes modelos de idiomas (razonamiento)

- (2023-08) Expertar: los agentes de LLM son estudiantes experimentales (conexión a tierra, razonamiento, recuperación, aprendizaje)

- (2023-08) GPT-in-the-Loop: toma de decisiones adaptativas para sistemas multiagente (base, razonamiento)

- (2023-08) Gentopia: una plataforma de colaboración para LLMS (entorno) acompañados de herramientas (entorno)

- (2023-08) Metagpt: Meta Programming para el marco colaborativo de múltiples agentes (conexión a tierra, razonamiento)

- (2023-08) Proagent: construcción de IA cooperativa proactiva con modelos de idiomas grandes (base, razonamiento)

- (2023-08) Reformador: agentes retrospectivos de lenguaje grande con optimización de gradiente de políticas (base, razonamiento, aprendizaje)

- (2023-08) Sapien: agentes virtuales afectivos alimentados por modelos de idiomas grandes (base, razonamiento)

- (2023-08) Integración sinérgica de modelos de idiomas grandes y arquitecturas cognitivas para AI robusta: un análisis exploratorio (base, razonamiento, recuperación, aprendizaje)

- (2023-09) Tora: un agente de razonamiento integrado en herramientas para la resolución de problemas matemáticos (base, razonamiento, aprendizaje)

- (2023-09) Identificar los riesgos de los agentes de LM con una caja de arena (entorno) emulada por LM

- (2023-09) Agente de sospecha: Jugar juegos de información imperfectos con teoría de la mente consciente de GPT-4 (base, razonamiento)

- (2024-01) Autocontraste: mejor reflexión a través de perspectivas de resolución inconsistentes (razonamiento, reflexión)

- (2024-02) Agente-Pro: Aprender a evolucionar a través de la reflexión y optimización a nivel de política (razonamiento, reflexión, aprendizaje)

- (2024-03) LLM3: Tareas basadas en modelos de idiomas grandes y planificación de movimiento con razonamiento de falla de movimiento. (Planificación, razonamiento)

- (2024-04) Empoderar el descubrimiento biomédico con agentes de IA (Científico de IA, investigación biomédica)

- (2024-05) Timechara: Evaluación de la alucinación de carácter de punto en el tiempo de los modelos de idiomas grandes (razonamiento, recuperación)

(Más que se agregará pronto. Solicite la solicitud de bienvenida).

Recursos

- Agentes autónomos alimentados con LLM (Lil'log)

- LLM-AGENTS-PAPERS

- LlmagentPapers

- AGENT ARRIBA DE LLM

(Más que se agregará pronto. Solicite la solicitud de bienvenida).