Laboratorio de transformadores

Descargar, interactuar y modelos Finetune localmente.

Explore los documentos »

Ver demostración · Informe errores · Sugerir características · Unirse a Discord · Siga en Twitter

Nota: Transformer Lab se está trabajando activamente. Únase a nuestra discordia o síganos en Twitter para obtener actualizaciones. ¡Las preguntas, los comentarios y las contribuciones son altamente valorados!

Descargar ahora

Sobre el proyecto

Transformer Lab es una aplicación que permite a cualquiera experimentar con modelos de idiomas grandes.

Respaldado por Mozilla

Transformer Lab se enorgullece de recibir el apoyo de Mozilla a través del programa Mozilla Builders

Características

Transformer Lab le permite:

- ? Descarga de un solo clic cientos de modelos populares :

- Llama3, Phi3, Mistral, Mixtral, Gemma, Command-R y docenas más

- ⬇ Descargue cualquier LLM de Huggingface

- ? Finetune / entrenar en diferentes hardware

- Finetune usando MLX en Apple Silicon

- Finetune usando Huggingface en GPU

- ⚖️ RLHF y optimización de preferencias

- Dpo

- Orpo

- Simpo

- Modelado de recompensas

- Trabajar con LLM en los sistemas operativos :

- Aplicación de Windows

- Aplicación MacOS

- Linux

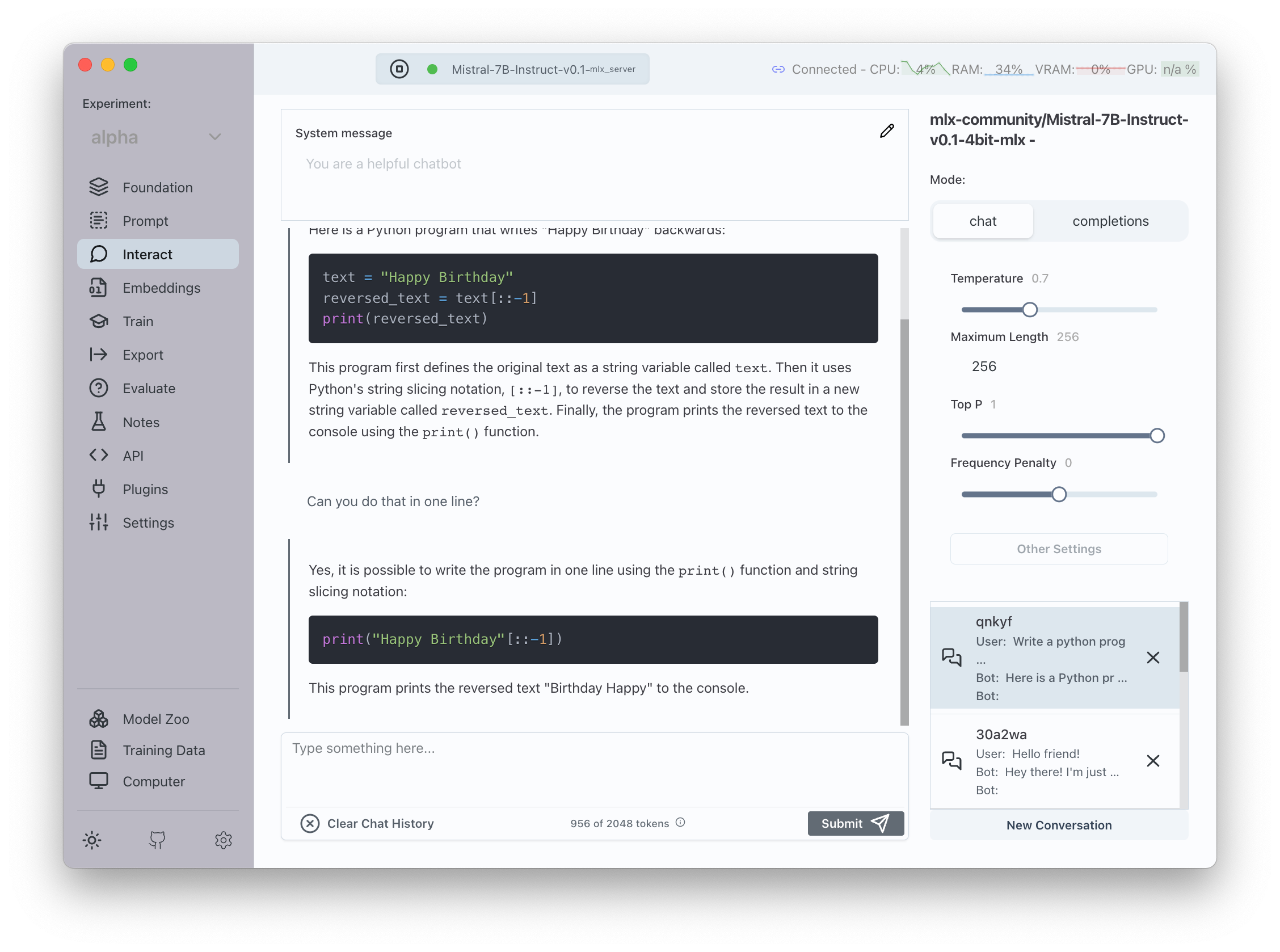

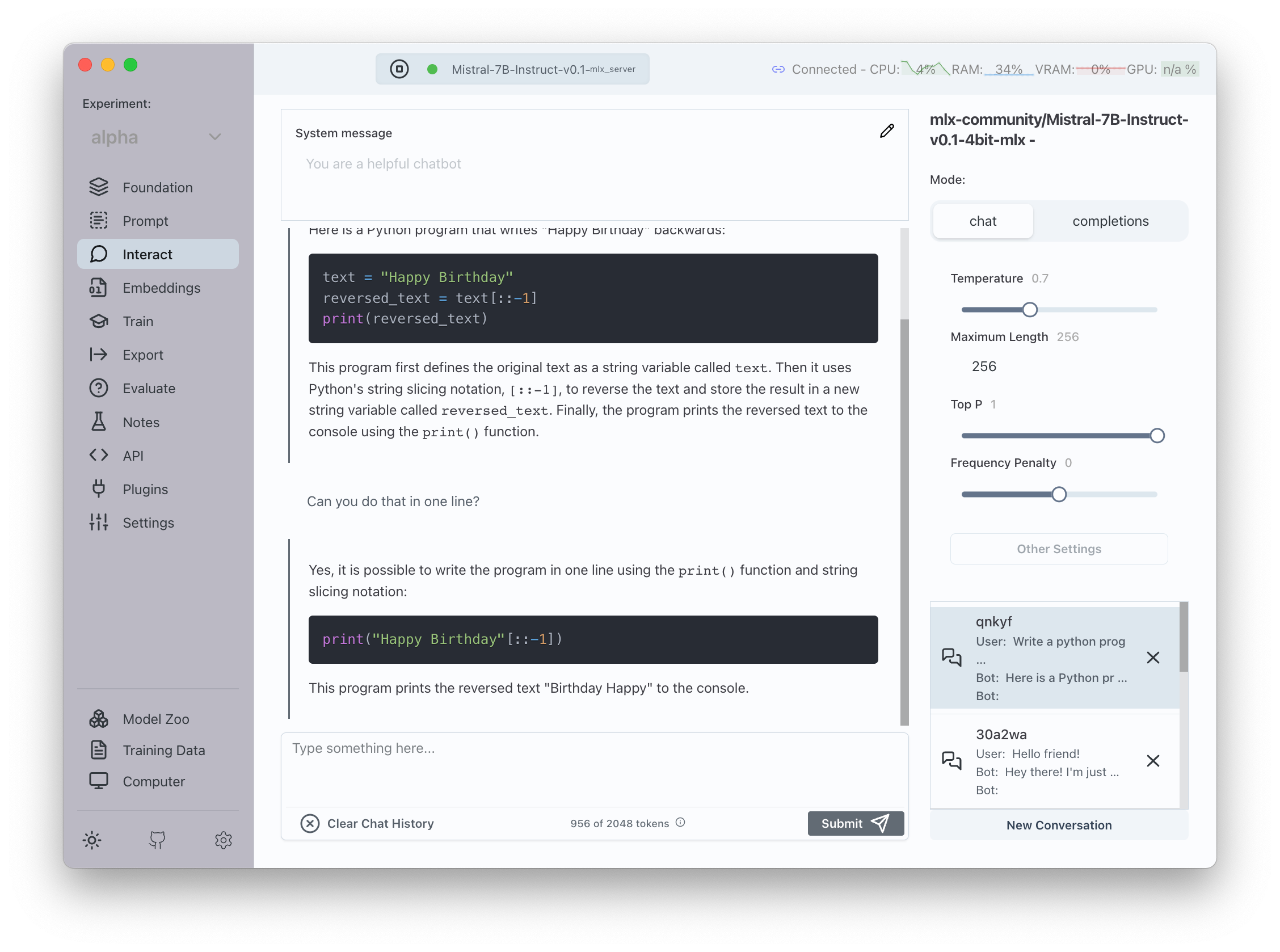

- Chatear con modelos

- Charlar

- Finalización

- Preset (plantado) indicaciones

- Historia de chat

- Parámetros de generación de ajuste

- Inferencia por lotes

- Uso de herramientas / llamadas de función (en alfa)

- ? Use diferentes motores de inferencia

- MLX en el silicio de manzana

- Huggingface Transformers

- vllm

- LLAMA CPP

- ? ? Evaluar modelos

- RAG (Retreival Aummented Generation)

- Arrastre y suelte la interfaz de usuario

- Funciona en Apple MLX, Transformers y otros motores

- ? Construir conjuntos de datos para capacitación

- Extraer de cientos de conjuntos de datos comunes disponibles en Huggingface

- Proporcione su propio conjunto de datos utilizando arrastrar y soltar

- ? Calcular incrustaciones

- ? API de descanso completo

- ? Ejecutar en la nube

- Puede ejecutar la interfaz de usuario en su escritorio/computadora portátil mientras el motor se ejecuta en una máquina remota o en la nube

- O puede ejecutar todo localmente en una sola máquina

- ? Convertir modelos en plataformas

- Convertir de/a Huggingface, MLX, Gguf

- ? Soporte de complemento

- Extraer fácilmente de una biblioteca de complementos existentes

- Escriba sus propios complementos para extender la funcionalidad

- ? Editor de código de Mónaco incrustado

- Editar complementos y ver lo que está sucediendo detrás de escena

- Edición rápida

- Editar fácilmente mensajes del sistema o plantillas de inmediato

- Registros de inferencia

- Mientras realiza inferencia o trapo, vea un registro de las consultas en bruto enviadas al LLM

Y puede hacer lo anterior, a través de una simple GUI multiplataforma.

Empezando

Haga clic aquí para descargar Transformer Lab.

Lea esta página para aprender a instalar y usar.

Construido con

Desarrolladores

Edificio desde cero

Para construir la aplicación usted mismo, tire de este repositorio y siga los pasos a continuación:

Embalaje para la producción

Para empaquetar aplicaciones para la plataforma local:

Licencia

Distribuido bajo la licencia AGPL V3. Consulte LICENSE.txt para obtener más información.

Referencia

Si encontró útil el laboratorio de transformadores en su investigación o aplicaciones, cite con el siguiente bibtex:

@software{transformerlab,

author = {Asaria, Ali},

title = {Transformer Lab: Experiment with Large Language Models},

month = December,

year = 2023,

url = {https://github.com/transformerlab/transformerlab-app}

}

Contacto

- @aliasaria - Ali Asasria

- @DadMobile - Tony Salomone