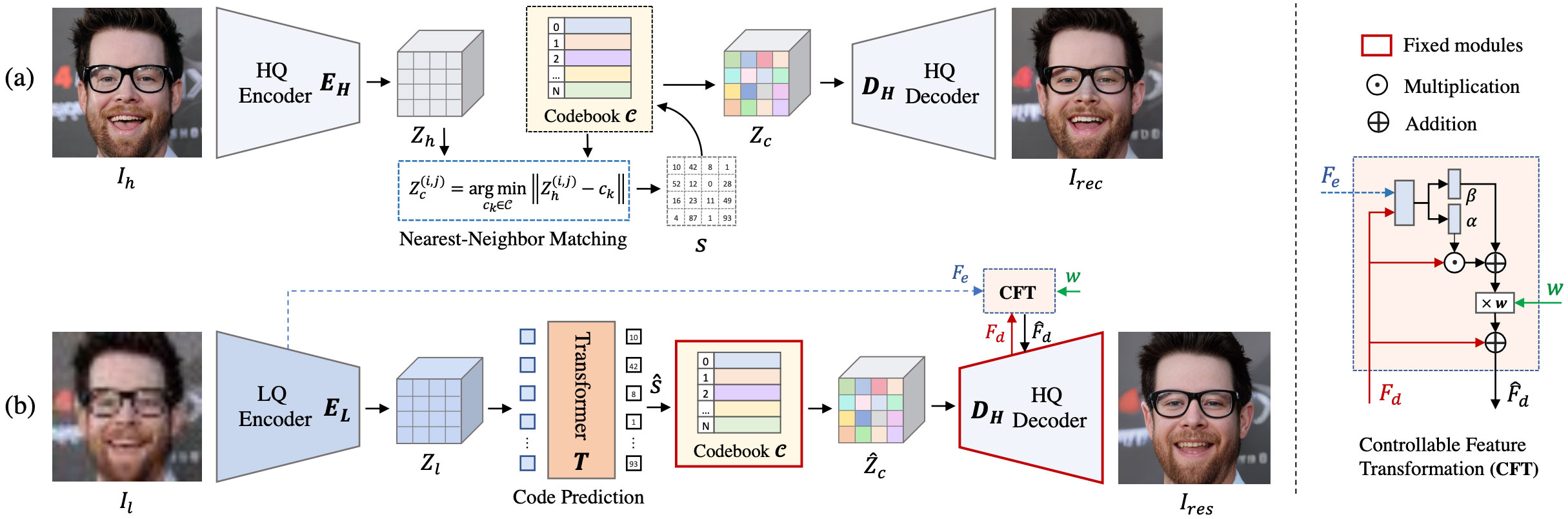

Papel | Página del proyecto | Video

Shangchen Zhou, Kelvin CK Chan, Chongyi Li, Chen Change Loy

S-LAB, Nanyang Technological University

Si CodeFormer es útil para sus imágenes o proyectos, ayude a protagonizar este repositorio. ¡Gracias! ?

dlib como una nueva opción de detector de cara, produce una identidad facial más precisa.--input_path [YOUR_VIDEO.mp4] . ¡Pruébelo para mejorar sus videos! ?

requirements.txt # git clone this repository

git clone https://github.com/sczhou/CodeFormer

cd CodeFormer

# create new anaconda env

conda create -n codeformer python=3.8 -y

conda activate codeformer

# install python dependencies

pip3 install -r requirements.txt

python basicsr/setup.py develop

conda install -c conda-forge dlib (only for face detection or cropping with dlib)

Descargue los modelos previos a la pretrada FACELIB y DLIB de [Lanzamientos | Google Drive | Onedrive] a la carpeta weights/facelib . Puede descargar manualmente los modelos previos a la aparición o descargar ejecutando el siguiente comando:

python scripts/download_pretrained_models.py facelib

python scripts/download_pretrained_models.py dlib (only for dlib face detector)

Descargue los modelos previos a la formación de código de código de [Liberturas | Google Drive | OneDrive] a la carpeta weights/CodeFormer . Puede descargar manualmente los modelos previos a la aparición o descargar ejecutando el siguiente comando:

python scripts/download_pretrained_models.py CodeFormer

Puede colocar las imágenes de prueba en la carpeta inputs/TestWhole . Si desea probar en caras recortadas y alineadas, puede colocarlas en la carpeta inputs/cropped_faces . Puede obtener las caras recortadas y alineadas ejecutando el siguiente comando:

# you may need to install dlib via: conda install -c conda-forge dlib

python scripts/crop_align_face.py -i [input folder] -o [output folder]

[Nota] Si desea comparar CodeFormer en su artículo, ejecute el siguiente comando que indique --has_aligned (para la cara recortada y alineada), ya que el comando para toda la imagen implicará un proceso de fusión de fondo de espalda que puede dañar la textura del cabello en el límite, lo que conduce a una comparación injusta.

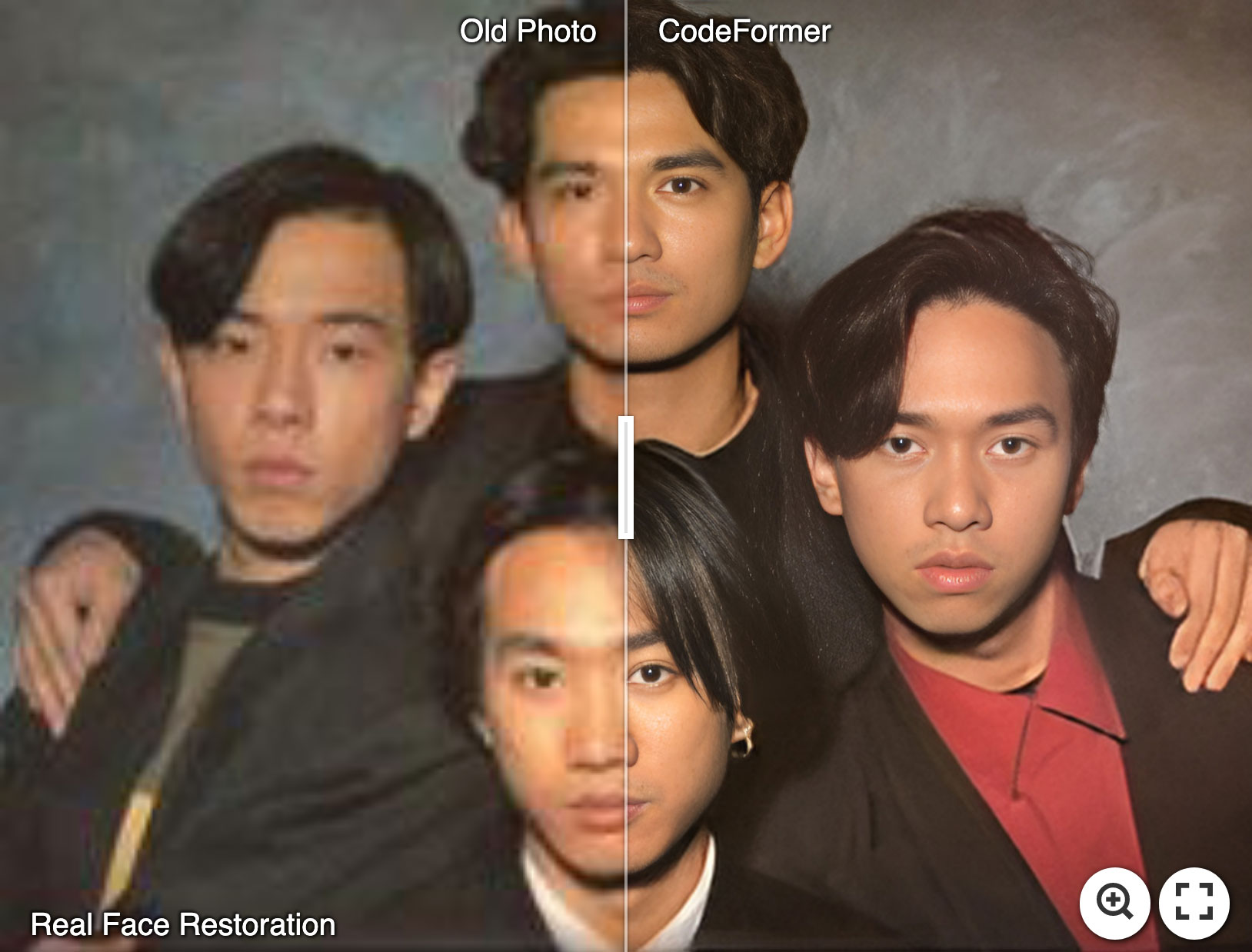

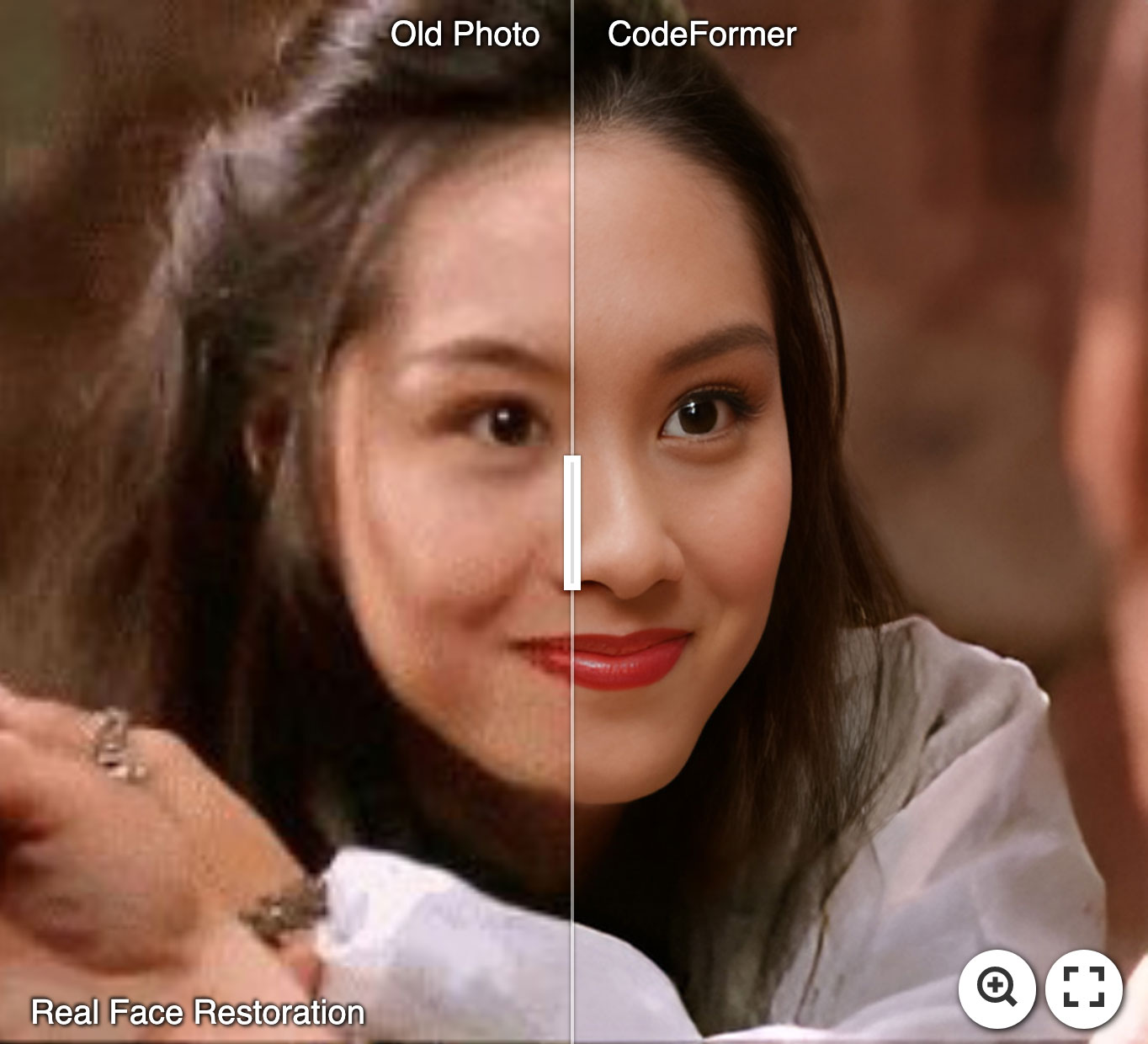

El peso de la fidelidad se encuentra en [0, 1]. En general, W más pequeño tiende a producir un resultado de mayor calidad, mientras que W más grande produce un resultado de mayor fidelidad. Los resultados se guardarán en la carpeta de results .

? Restauración facial (cara recortada y alineada)

# For cropped and aligned faces (512x512)

python inference_codeformer.py -w 0.5 --has_aligned --input_path [image folder]|[image path]

? ️ Mejora de imagen completa

# For whole image

# Add '--bg_upsampler realesrgan' to enhance the background regions with Real-ESRGAN

# Add '--face_upsample' to further upsample restorated face with Real-ESRGAN

python inference_codeformer.py -w 0.7 --input_path [image folder]|[image path]

? Mejora de video

# For Windows/Mac users, please install ffmpeg first

conda install -c conda-forge ffmpeg

# For video clips

# Video path should end with '.mp4'|'.mov'|'.avi'

python inference_codeformer.py --bg_upsampler realesrgan --face_upsample -w 1.0 --input_path [video path]

? Colorización de la cara (cara recortada y alineada)

# For cropped and aligned faces (512x512)

# Colorize black and white or faded photo

python inference_colorization.py --input_path [image folder]|[image path]

? Enlaza de la cara (cara recortada y alineada)

# For cropped and aligned faces (512x512)

# Inputs could be masked by white brush using an image editing app (e.g., Photoshop)

# (check out the examples in inputs/masked_faces)

python inference_inpainting.py --input_path [image folder]|[image path]

Los comandos de capacitación se pueden encontrar en los documentos: inglés |简体中文.

Si nuestro trabajo es útil para su investigación, considere citar:

@inproceedings{zhou2022codeformer,

author = {Zhou, Shangchen and Chan, Kelvin C.K. and Li, Chongyi and Loy, Chen Change},

title = {Towards Robust Blind Face Restoration with Codebook Lookup TransFormer},

booktitle = {NeurIPS},

year = {2022}

}

Este proyecto tiene licencia bajo la Licencia NTU S-LAB 1.0. La redistribución y el uso deben seguir esta licencia.

Este proyecto se basa en Basicsr. Algunos códigos se traen de los transformadores de desatado, Yolov5-Face y Facexlib. También adoptamos REAL-ESRGAN para apoyar la mejora de la imagen de fondo. Gracias por sus increíbles obras.

Si tiene alguna pregunta, no dude en comunicarse conmigo en [email protected] .