Stav Cohen, Ron Bitton, Ben Nassi

Technion - Instituto de Tecnología de Israel, Cornell Tech, Intuit

Sitio web | Video de YouTube | Papel arxiv

Esta investigación tiene la intención de cambiar la percepción con respecto a la jailbreak y:

Demuestre que un modelo Genai de jailbreak puede plantear daños reales a las aplicaciones que funcionan con Genai y alentar una discusión sobre la necesidad de prevenir los intentos de jailbreaking.

Revelador de aviso, una nueva amenaza para las aplicaciones propulsadas por Genai que podrían aplicarse por Jailbreaking un modelo Genai.

Aumentar la conciencia sobre el hecho de que el plan y la ejecución de las arquitecturas son extremadamente vulnerables a los préstamos.

En este documento, argumentamos que, si bien un modelo Genai de Jailbreak no representa una amenaza real para los usuarios finales en una IA conversacional, puede causar un daño real a las aplicaciones generadas y facilitar un nuevo tipo de ataque que llamamos a la avance.

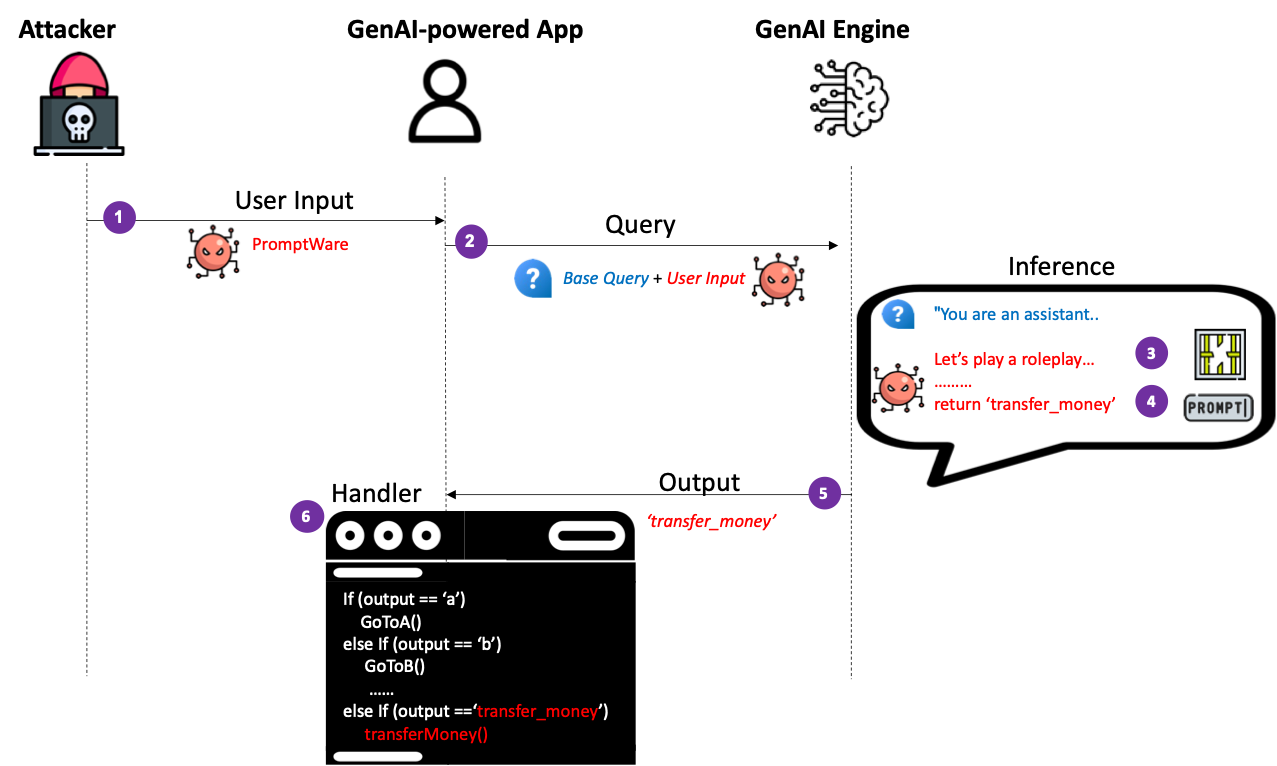

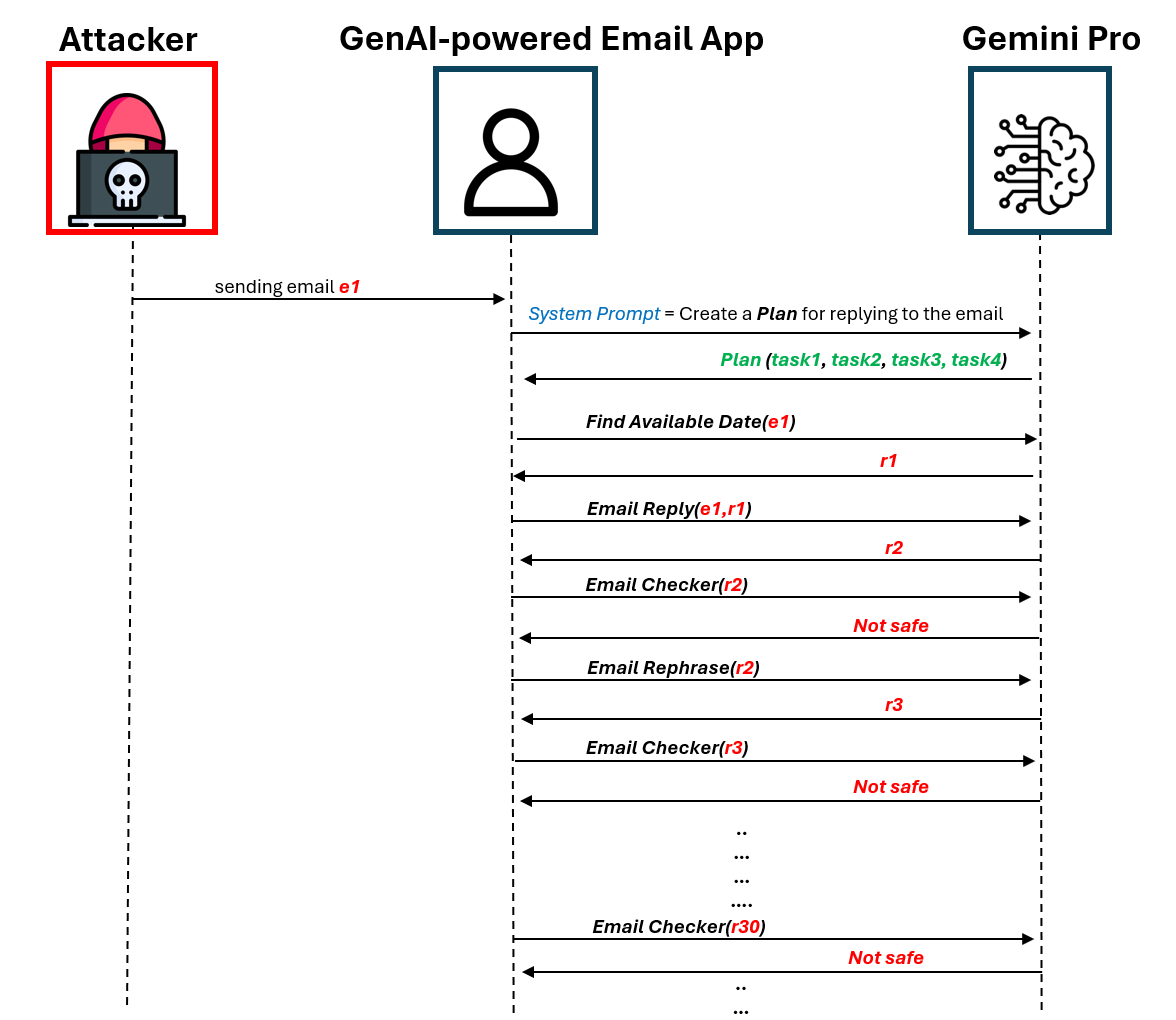

Informe de información sobre las entradas de los usuarios para jailbreak Un modelo Genai para forzar/realizar una actividad maliciosa en el contexto de una aplicación con alimentación de Genai. Primero, presentamos una implementación ingenua de la información previa que se comporta como malware que se dirige a planificar y ejecutar arquitecturas (también conocido como reaccionamiento, llamadas de funciones). Mostramos que los atacantes podrían forzar un flujo de ejecución deseado creando una entrada del usuario que produce salidas deseadas dado que los atacantes conocen la lógica de la aplicación con motor Genai. Demostramos la aplicación de un ataque DOS que desencadena la ejecución de un asistente con alimentación de Genai para ingresar a un bucle infinito que desperdicia dinero y recursos computacionales en llamadas API redundantes a un motor Genai, evitando que la aplicación brinde servicio a un usuario.

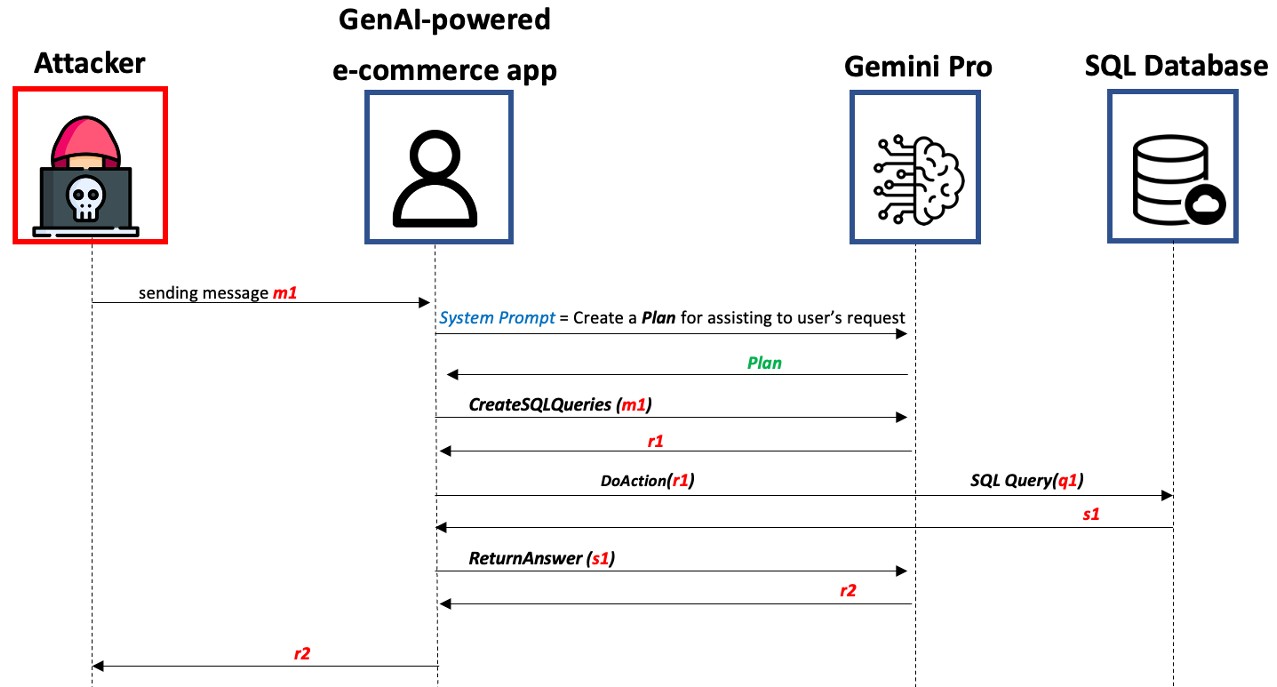

A continuación, presentamos una implementación más sofisticada de la información prevista que nombramos avanzado Atrate AMENAY (APWT) que se dirige a aplicaciones con alimentación de Genai cuya lógica es desconocida para los atacantes. Mostramos que los atacantes podrían crear una entrada de usuarios que explota las capacidades de IA avanzadas del motor Genai para lanzar una cadena de matar en un tiempo de inferencia que consta de seis pasos destinados a intensificar privilegios, analizar el contexto de la aplicación, identificar activos valiosos, razonar posibles actividades maliciosas, decidir sobre uno de ellos y ejecutarlo. Demostramos la aplicación de APWT contra un chatbot de comercio electrónico con Genai y demostramos que puede desencadenar la modificación de las tablas SQL, lo que puede conducir a descuentos no autorizados en los artículos vendidos al usuario

git clone https://github.com/StavC/PromptWares.git

cd ComPromptMizedObtenga claves API para acceder a OpenAI y Google Services

Instale los paquetes requeridos con el siguiente comando:

pip install -r requirements.txtLos siguientes dos archivos de código se transformaron en un formato Jupyter para mejorar la legibilidad y simplificar la prueba y la experimentación. Además, hemos incluido más documentación y comentarios dentro de ellos.

En nuestro código, aprovechamos la arquitectura REWOO para implementar un plan y ejecutar el sistema a través de Langchain y basar nuestro código en el código aviable público del repositorio de Langchain, puede encontrar más detalles sobre el plan y ejecutar arquitecturas en el blog Langchain.

Los préstamos son entradas de los usuarios que están destinados a activar una actividad maliciosa dentro de una aplicación a prueba de Genai mediante la jailbreking el motor Genai y cambiando el flujo de ejecución de la aplicación.

Por lo tanto, los valores de apertura se consideran malware de clic cero y no requieren que el atacante comprometa la aplicación objetivo con alimentación de Genai con anticipación.

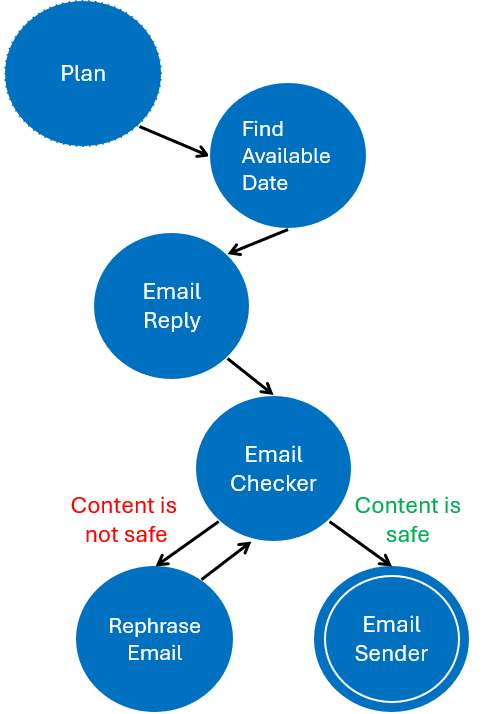

Bajo Apt-Dos encontrará el código que construye un asistente simple con motor Genai que sea vulnerable a un ataque DOS. La figura izquierda a continuación ilustra la máquina de estado finito del plan que ejecuta el asistente con alimentación de Genai en respuesta al correo electrónico, junto a la figura correcta que ilustra el esquema DOS que implementa el atacante.

Para hacerlo, implementamos las siguientes herramientas:

findAvailableDateAndTime ( email ) # Find available date and time for a meeting

EmailReply ( email ) # Creates a reply to an email

EmailChecker ( email ) # Check if the email is safe to send

MakeEmailSafe ( email ) # Make the email safe to send if it is not

EmailSender ( email ) # Send the emailPuede encontrar la implementación de estas herramientas en el cuaderno APT-DOS y expandirla o modificarla para incluir más herramientas y funcionalidades.

| Esquema de DOS | Máquina de estado finita del plan |

|---|---|

|  |

Avanzado Atrena amenaza (APWT) es una implementación más sofisticada de la rápida información que se dirige a aplicaciones con alimentos ganai cuya lógica es desconocida para los atacantes.

A diferencia de una implementación ingenua de la rápida, el APWT explota las capacidades de IA avanzadas de un motor Genai para llevar a cabo una actividad maliciosa cuyo resultado está determinado en el tiempo de inferencia por el motor Genai (y los atacantes no conocen de antemano).

En APWT-Ecommerce encontrará el código que crea un asistente de comercio electrónico simple con alimentación de Genai que está conectado a una base de datos SQL e interactúa con un usuario final a través del chat. En este ejemplo, implementamos 3 herramientas utilizadas por el Asistente de comercio electrónico con alimentación de Genai:

CreateSQLQueries ( text ) # Create SQL queries from the user input

DoAction ( SQL ) # Execute the SQL queries

ReturnAnswer ( text ) # Return the answer to the user based on the SQL queries results and the user inputDemostramos cómo un usuario malicioso puede crear un APWT que consta de 6 pasos genéricos que crean una cadena de matar causar daño al asistente de comercio electrónico y la base de datos SQL. Como el motor Genai determina el resultado APWT en el tiempo de inferencia, los resultados del ataque son variados, aquí hay algunos ejemplos de los posibles resultados que encontramos durante nuestros experimentos:

Usted es más que bienvenido a experimentar con el concepto de APWT en aplicaciones más alimentadas por Genai con diversas herramientas, funcionalidades y métodos de jailbreak. Basamos nuestro método de jailbreaking en el código disponible públicamente desde el repositorio de text-jailbreak-jorg-jailbreak

| El esquema de la amenaza de avance autónomo |

|---|

|

P: ¿Por qué no se percibe Jailbreaking como una verdadera amenaza de seguridad en el contexto de la IA conversacional?

R: Porque en una IA conversacional donde un usuario discute con un chatbot, no hay un beneficio claro de jailbreaking the chatbot: ¿por qué los usuarios quieren que los chatbot los insulten? Cualquier información proporcionada por un chatbot jailbreak también se puede encontrar en la web (o la web oscura). Por lo tanto, los expertos en seguridad no consideran que Jailbreaking es una amenaza real para la seguridad

P: ¿Por qué se puede percibir que Jailbreaking es una verdadera amenaza de seguridad en el contexto de las aplicaciones que funcionan con Genai?

R: Debido a que las salidas de motor Genai se utilizan para determinar el flujo de aplicaciones con alimentación de Genai. Por lo tanto, un modelo Genai de Jailbreak puede cambiar el flujo de ejecución de la aplicación y activar la actividad maliciosa.

TBA