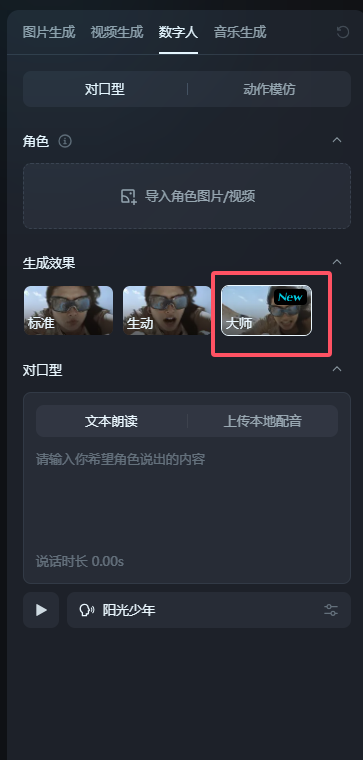

Die Omnihuman-1-Funktion von Bytedance wurde nun offiziell für die Verwendung auf der IMENG-Plattform eröffnet. Kürzlich kündigte Jimeng AI den vollständigen Start des digitalen menschlichen Mastermodus an. Mit dieser innovativen Funktion können Benutzer automatisch erweiterte digitale Menschen mit natürlichen Bewegungen und realistischen Ausdrücken generieren, indem nur ein Foto und ein Audio hochgeladen werden. Im Gegensatz zum traditionellen Modell erfordert das Master -Modell keine Eingabe komplexer Eingabeaufforderungen, die den Schwellenwert für die digitale Erstellung von Menschen erheblich reduzieren und es mehr Benutzer erlauben, sich problemlos zu starten.

Der Start dieser Funktion verringert nicht nur die Schwierigkeit der Schöpfung der digitalen Menschen stark, sondern verbessert auch die Schöpfungsfreiheit erheblich. Die Animationsleistung der neuen Generation digitaler Menschen ist besonders erstaunlich, das Problem starrer Modelle in der Vergangenheit vollständig loszuwerden und Benutzern ein reibungsloseres und natürlicheres visuelles Erlebnis zu bieten. Egal, ob es sich um Mimik oder Körperbewegungen handelt, sie haben ein beispielloses Maß an Realität erreicht.

Der größte Highlight des Master-Modus ist, dass er die Einschränkung durchbricht, dass traditionelle digitale Menschen nur Kopfbewegungen vorantreiben und die natürliche Generation von Ganzkörperbewegungen erkennen. Dies bedeutet, dass die von Benutzern erstellten digitalen Personen keine einzige "große Puppe" mehr sind, sondern eine vollständige Körpersprache haben. Nach dem Feedback der aktuellen Community -Nutzer zu urteilen, funktioniert diese Funktion besonders gut in komplexen Szenen wie Sprache, Gesang und Tanzen und zeigt ein starkes Anwendungspotenzial.

Um diese Funktion zu testen, lud der Editor ein Foto von Nezha hoch und fügte ein Audio hinzu. Die erzeugten Effekte sind überraschend, mit glatten und natürlichen Bewegungen und lebendigen Ausdrücken, die ideal für die Erstellung von Lippensynchronisierungen oder digitalen Dozenten sind. Derzeit unterstützt der Master -Modus das Hochladen von Audio bis zu 15 Sekunden, was ausreicht, um den Anforderungen der meisten kurzen Videokreationen zu erfüllen.

Diese Funktion ist zweifellos ein großer Segen für kurze Video -Schöpfer, virtuelle Anker und Werbemacher. Es reduziert nicht nur die Produktionskosten stark, sondern hilft Benutzern auch, ausdrucksvollere und attraktivere Inhalte zu produzieren. Unabhängig davon, ob es Live -Inhalte für virtuelle Anker produziert oder Werbung lebendige digitale menschliche Rollen hinzufügt, kann das Master -Modell die Effizienz und Qualität erheblich verbessern.

Darüber hinaus geht das Potenzial des Master -Modus weit darüber hinaus. Angesichts der kontinuierlichen Weiterentwicklung der Technologie wird es wahrscheinlich zu einer leistungsstarken Engine für die digitale Technologie von AI, um breitere Felder wie Film und Fernsehen, Spiele usw. zu betreten. In Zukunft sehen wir vielleicht Filme mit Digital Man oder eine immersive Welt, die von Digital Man NPCs dominiert wird. All dies lässt die Menschen darauf freuen, und die Zukunft der digitalen menschlichen Technologie wird zweifellos noch aufregender sein.