Effizientes Erzeugen von hochwertigen langen Videos war schon immer eine große Herausforderung im Bereich Computer Vision. Meta-AI-Forscher schlugen eine schulischfreie Beschleunigungsmethode vor, die als Adacache als Reaktion auf die langsame Inferenz vorhandener Diffusionstransformatormodelle (DITs) bezeichnet wird. Adacache verwendet clever Video -Inhaltsunterschiede, passt Caching -Strategien für jedes Video an und führt ein Bewegungsregulierungsschema ein, um Computerressourcen dynamisch auf der Grundlage von Videobewegungsinhalten zuzuweisen, wodurch die Inferenzgeschwindigkeit erheblich verbessert wird und gleichzeitig die Qualität der Generation sicherstellt.

Das Generieren von hochwertigem und zeitkontinuierlichem Video erfordert viele Rechenressourcen, insbesondere für längere Zeitspannen. Obwohl die neuesten Diffusionstransformator -Modelle (DITs) in der Videogenerierung erhebliche Fortschritte erzielt haben, wird diese Herausforderung aufgrund ihrer Abhängigkeit von größeren Modellen und komplexeren Aufmerksamkeitsmechanismen durch das langsamere Denken verschärft. Um dieses Problem zu lösen, schlugen Forscher von Meta AI eine trainingfreie Methode mit dem Namen Adacache vor, um Video-Dits zu beschleunigen.

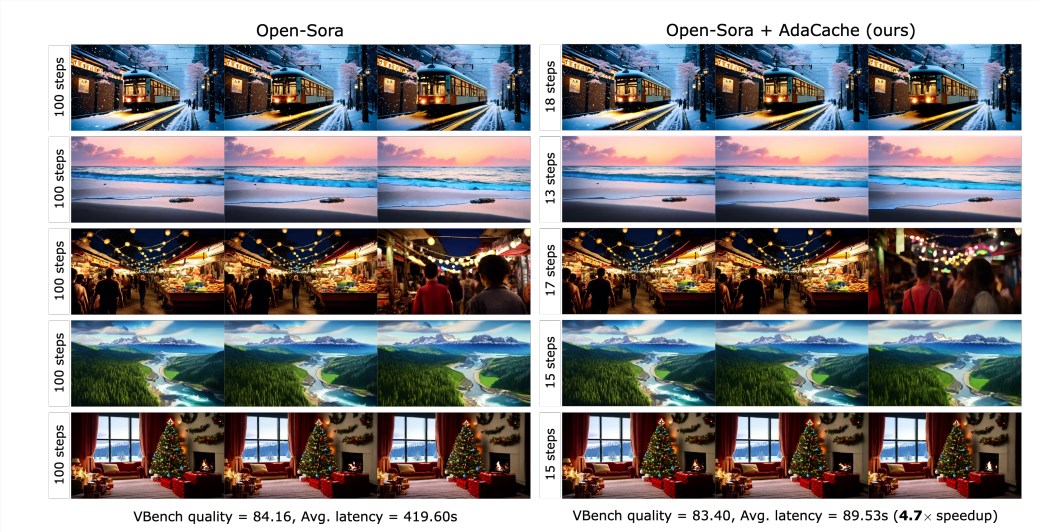

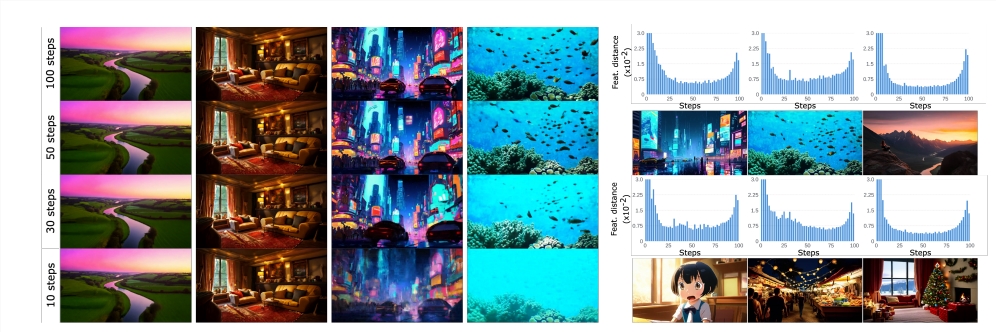

Die Kernidee von Adacache basiert auf der Tatsache, dass „nicht alle Videos dieselben sind“, was bedeutet, dass einige Videos weniger denoisine Schritte als andere erfordern, um angemessene Qualität zu erreichen. Basierend auf dieser Methode zwischengespeichert die Methode nicht nur die Berechnungsergebnisse während des Diffusionsprozesses, sondern entwirft auch eine individuelle Cache-Strategie für jede Videogenerierung, wodurch der Kompromiss zwischen Qualität und Latenz maximiert wird.

Die Forscher führten ferner ein Motion Regularization (MORG) -Scheme ein, in dem Videoinformationen in Adacache verwendet werden, um die Zuordnung von Rechenressourcen basierend auf dem Bewegungsinhalt zu steuern. Da Videosequenzen, die hochfrequente Texturen und große Mengen an Bewegungsinhalten enthalten, mehr Diffusionsschritte erfordern, um angemessene Qualität zu erreichen, kann Morg besser Computerressourcen zuweisen.

Experimentelle Ergebnisse zeigen, dass Adacache die Inferenzgeschwindigkeit (z. B. in Open -SORA720P -2 -Videogenerierung) erheblich verbessern kann, ohne die Generationsqualität zu beeinträchtigen. Darüber hinaus verfügt Adacache über gute Generalisierungsfunktionen und kann auf verschiedene Video-DIT-Modelle wie Open-Sora, Open-Sora-Plan und Latte angewendet werden. Adacache hat im Vergleich zu anderen Trainingsfreien Beschleunigungsmethoden wie ∆-dit, T-Gate und PAB erhebliche Vorteile von Geschwindigkeit und Qualität im Vergleich zu anderen Trainingsfreien Beschleunigungsmethoden.

Benutzerforschung zeigt, dass Benutzer im Vergleich zu anderen Methoden Adacache-generierte Videos bevorzugen und glauben, dass ihre Qualität mit dem Benchmark-Modell vergleichbar ist. Diese Studie bestätigt die Wirksamkeit von Adacache und leistet einen wichtigen Beitrag zum Bereich der effizienten Videogenerierung. Meta AI ist der Ansicht, dass Adacache weit verbreitet werden kann und die Popularisierung der langen Videogenerierung von hoher Fidelity fördern kann.

Papier: https://arxiv.org/abs/2411.02397

Projekt Homepage:

https://adacache-dit.github.io/

Github:

https://github.com/adacache-dit/adacache

Kurz gesagt, Adacache bietet als effiziente Beschleunigungsmethode der Videogenerierung neue Möglichkeiten für die Erzeugung von langen Videos mit hohem Fidelity, und die erhebliche Leistungsverbesserung und die gute Benutzererfahrung bieten es in zukünftigen Anwendungen umfassende Aussichten. Diese Forschung von Meta AI hat wichtige Durchbrüche auf dem Gebiet der effizienten Videogenerierung gebracht.