Erstellen einer Chat -Anwendung, mit der mehrere Dateien mithilfe von LlamaNdex, OpenAI und Streamlit verarbeitet werden können

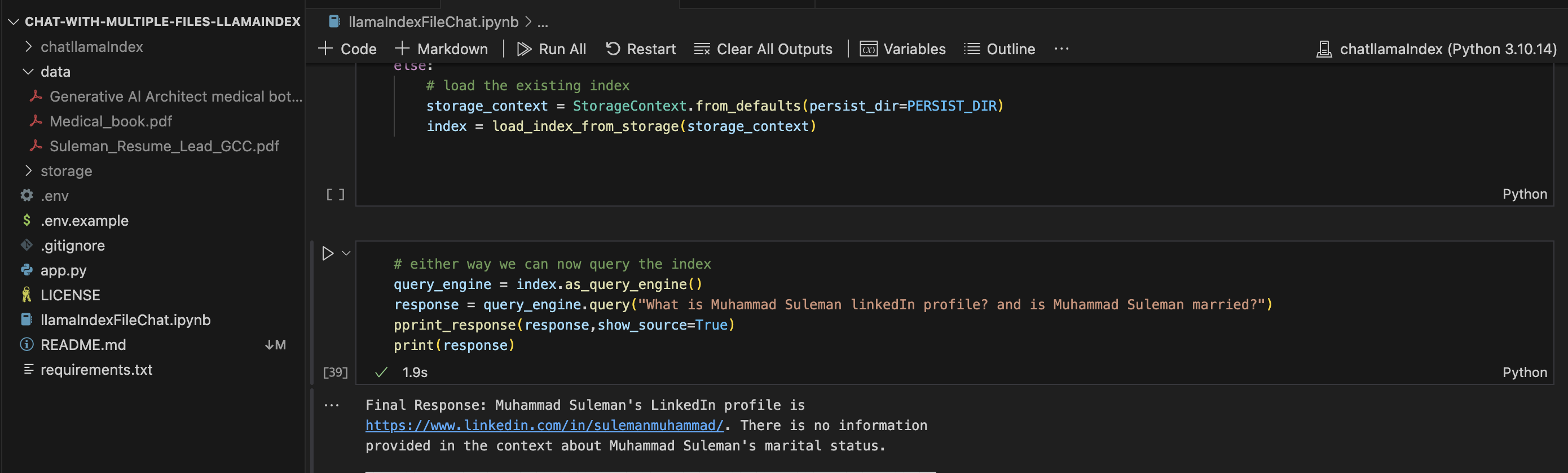

Dieses Repository enthält eine Chat-Anwendung, mit der Benutzer mehrere Dateien hochladen, diese Dateien zum Extrahieren von Informationen verarbeitet und anschließend ein KI-Modell (OpenAIs GPT-4) verwendet, um Fragen zu beantworten oder Erkenntnisse basierend auf dem Inhalt der Dateien zu geben. Die Anwendung wird unter Verwendung von Streamlit für die Front-End-Schnittstelle, llamaNdex für die Indexierung und Suche nach den Inhalten und das OpenAI für die natürlichen Sprachverarbeitungsfunktionen erstellt.

streamlitopenai -Bibliothekllama-index -Bibliothek Klonen Sie das Repository:

git clone https://github.com/leodeveloper/Chat-with-multiple-files-llamaindex

cd Chat-with-multiple-files-llamaindexInstallieren Sie die erforderlichen Python -Pakete:

pip install streamlit openai llama-indexRichten Sie Ihren OpenAI -API -Schlüssel ein:

Rufen Sie Ihren API -Schlüssel bei OpenAI und stellen Sie sie als Umgebungsvariable fest oder ersetzen Sie 'YOUR_OPENAI_API_KEY' im Skript durch Ihren tatsächlichen API -Schlüssel.

export OPENAI_API_KEY= ' your-api-key ' Beiträge sind willkommen! Bitte senden Sie eine Pull -Anfrage oder öffnen Sie ein Problem, um Änderungen oder Verbesserungen zu besprechen.

Dieses Projekt ist unter der MIT -Lizenz lizenziert. Weitere Informationen finden Sie in der Lizenzdatei.

Bei Fragen oder Vorschlägen wenden Sie sich bitte an [[email protected]].