Eine autonome Pipeline zum Ändern von Stimmen mithilfe eines beliebigen RVC v2-trainierten KI-Sprachmodells. Mit diesem Tool kann die Sprachkonvertierung auf jeden Audioeingang angewendet werden.

WebUI wird ständig weiterentwickelt und getestet, aber Sie können es jetzt lokal ausprobieren!

Installieren und ziehen Sie alle neuen Anforderungen und Änderungen, indem Sie ein Befehlszeilenfenster im RVC-v2-UI Verzeichnis öffnen und die folgenden Befehle ausführen.

pip install -r requirements.txt git pull

Für Colab-Benutzer klicken Sie einfach in der oberen Navigationsleiste des Colab-Notizbuchs auf Runtime und im Dropdown-Menü auf Disconnect and delete runtime . Befolgen Sie dann die Anweisungen im Notebook, um die Web-Benutzeroberfläche auszuführen.

(Hoffentlich bald)

Befolgen Sie die Anweisungen hier, um Git auf Ihrem Computer zu installieren. Befolgen Sie auch diese Anleitung, um Python VERSION 3.9 zu installieren, falls Sie dies noch nicht getan haben. Die Verwendung anderer Python-Versionen kann zu Abhängigkeitskonflikten führen.

Alternativ können Sie pyenv verwenden, um Python-Versionen zu verwalten:

Installieren Sie pyenv gemäß den Anweisungen hier.

Installieren Sie Python 3.9:

pyenv install 3.9

Legen Sie es als Ihre lokale Python-Version fest:

pyenv local 3.9

Befolgen Sie die Anweisungen hier, um ffmpeg auf Ihrem Computer zu installieren.

Öffnen Sie ein Befehlszeilenfenster und führen Sie diese Befehle aus, um das gesamte Repository zu klonen, eine virtuelle Umgebung zu erstellen und die zusätzlich erforderlichen Abhängigkeiten zu installieren.

git clone https://github.com/PseudoRAM/RVC-v2-UI cd RVC-v2-UI

pyenv exec python -m venv venv

python -m venv venv

venvScriptsactivate

source venv/bin/activate

pip install -r requirements.txt

Führen Sie den folgenden Befehl aus, um das erforderliche Hubert-Basismodell herunterzuladen.

python src/download_models.py

Führen Sie den folgenden Befehl aus, um die RVC Voice Changer-WebUI auszuführen.

python src/webui.py

| Flagge | Beschreibung |

|---|---|

-h , --help | Zeigen Sie diese Hilfemeldung an und beenden Sie den Vorgang. |

--share | Erstellen Sie eine öffentliche URL. Dies ist nützlich, um die Web-Benutzeroberfläche auf Google Colab auszuführen. |

--listen | Machen Sie die Web-Benutzeroberfläche von Ihrem lokalen Netzwerk aus erreichbar. |

--listen-host LISTEN_HOST | Der Hostname, den der Server verwenden wird. |

--listen-port LISTEN_PORT | Der Überwachungsport, den der Server verwenden wird. |

Sobald die folgende Ausgabemeldung Running on local URL: http://127.0.0.1:7860 angezeigt wird, können Sie auf den Link klicken, um eine Registerkarte mit der WebUI zu öffnen.

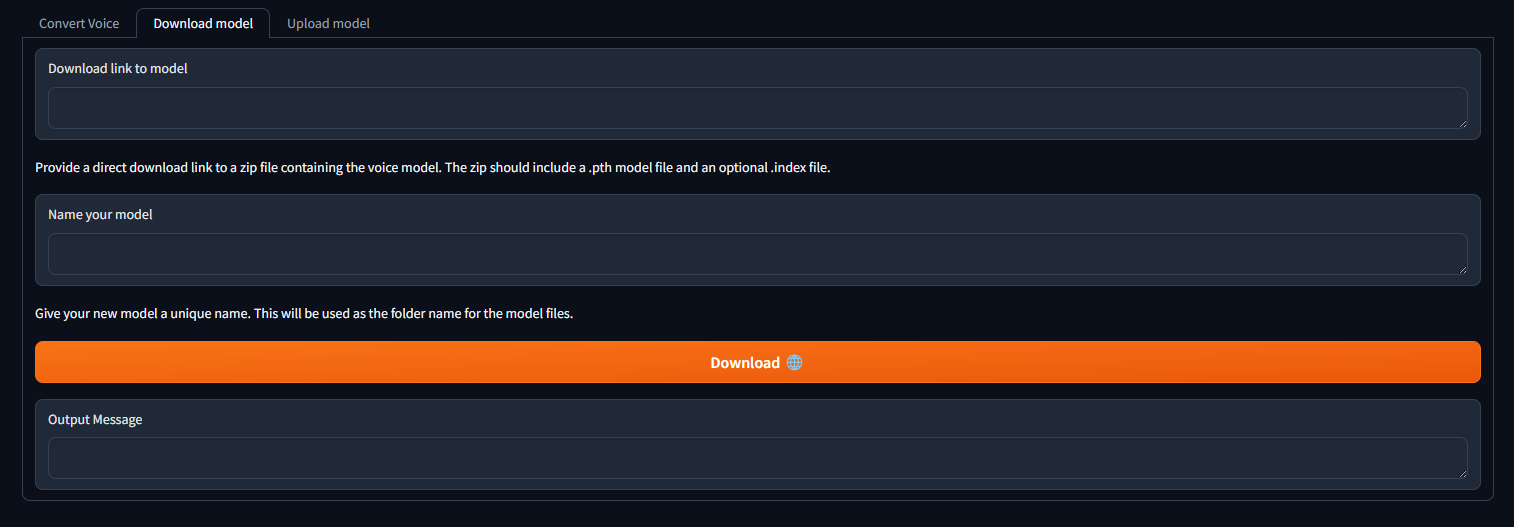

Navigieren Sie zur Registerkarte Download model , fügen Sie den Download-Link zum RVC-Modell ein und geben Sie ihm einen eindeutigen Namen. Sie können im AI Hub Discord suchen, wo bereits trainierte Sprachmodelle zum Download verfügbar sind. Sehen Sie sich bitte die Beispiele an, wie der Download-Link aussehen sollte. Die heruntergeladene ZIP-Datei sollte die .pth-Modelldatei und eine optionale .index-Datei enthalten.

Sobald die beiden Eingabefelder ausgefüllt sind, klicken Sie einfach auf Download ! Sobald die Ausgabemeldung lautet [NAME] Model successfully downloaded! , Sie sollten es auf der Registerkarte Convert Voice verwenden können, nachdem Sie auf die Schaltfläche „Modelle aktualisieren“ geklickt haben!

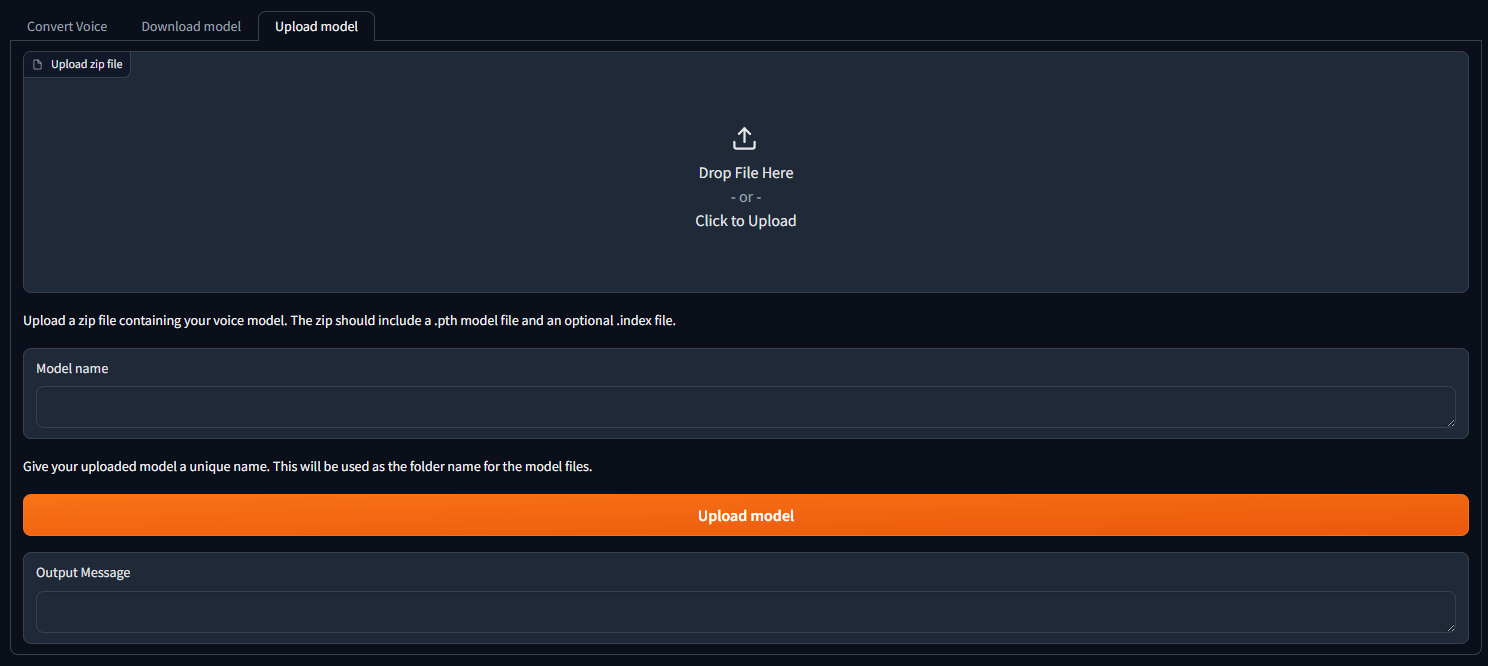

Für Personen, die RVC v2-Modelle lokal trainiert haben und diese zur Sprachkonvertierung verwenden möchten. Navigieren Sie zur Registerkarte Upload model und befolgen Sie die Anweisungen. Sobald die Ausgabemeldung lautet [NAME] Model successfully uploaded! , Sie sollten es auf der Registerkarte Convert Voice verwenden können, nachdem Sie auf die Schaltfläche „Modelle aktualisieren“ geklickt haben!

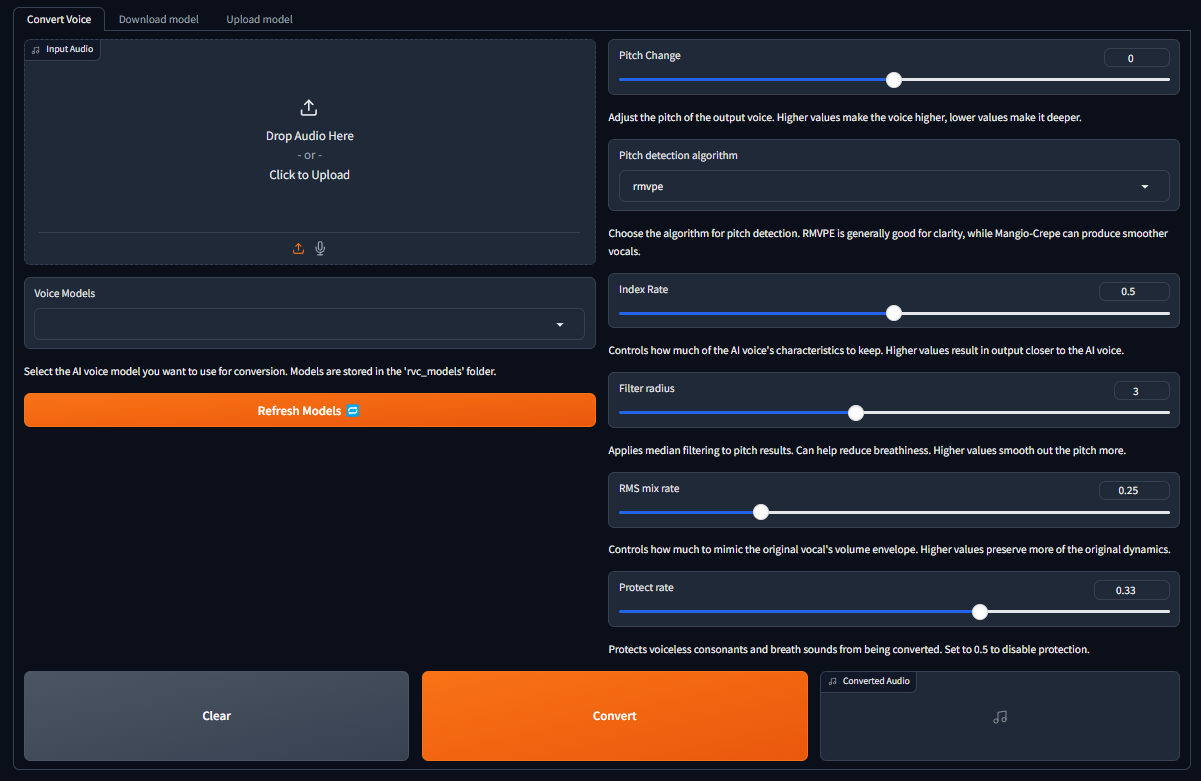

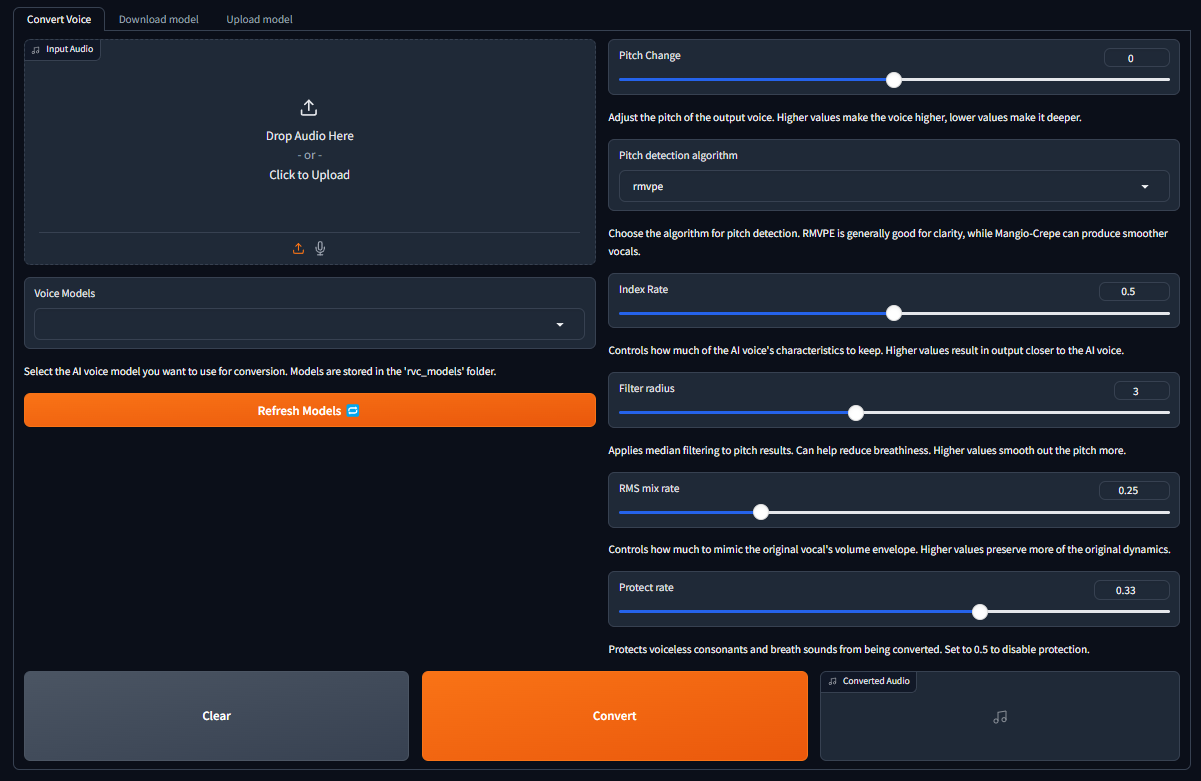

Wählen Sie im Dropdown-Menü „Sprachmodelle“ das zu verwendende Sprachmodell aus. Klicken Sie auf Refresh Models wenn Sie die Dateien manuell zum Verzeichnis rvc_models hinzugefügt haben, um die Liste zu aktualisieren.

Laden Sie im Feld „Eingabeaudio“ Ihre Audiodatei hoch.

Passen Sie die Tonhöhe nach Bedarf an. Dadurch ändert sich die Tonhöhe der ausgegebenen Stimme.

Weitere erweiterte Optionen für die Sprachkonvertierung können angezeigt werden, indem Sie zum Erweitern auf den Akkordeonpfeil klicken.

Sobald alle Optionen ausgefüllt sind, klicken Sie auf Convert und die von der KI generierte Stimme sollte je nach GPU in wenigen Augenblicken erscheinen.

Führen Sie den folgenden Befehl aus, um die Sprachkonvertierungspipeline über die Befehlszeile auszuführen:

python src/main.py <input_audio> <rvc_model> [pitch] [f0_method] [index_rate] [filter_radius] [rms_mix_rate] [protect]

| Parameter | Beschreibung |

|---|---|

input_audio | Pfad zur Eingabe-Audiodatei. |

rvc_model | Name des zu verwendenden RVC-Modells. |

pitch | (Optional) Tonhöhenänderung in Halbtönen. Der Standardwert ist 0. |

f0_method | (Optional) Tonhöhenerkennungsalgorithmus. Optionen: „rmvpe“ (Standard) oder „Mangio-Crêpe“. |

index_rate | (Optional) Indexrate für die Sprachkonvertierung. Der Standardwert ist 0,5. Bereich: 0 bis 1. |

filter_radius | (Optional) Filterradius für die Medianfilterung. Der Standardwert ist 3. Bereich: 0 bis 7. |

rms_mix_rate | (Optional) RMS-Mischrate. Der Standardwert ist 0,25. Bereich: 0 bis 1. |

protect | (Optional) Schützen Sie die Rate, um einige ursprüngliche Sprachmerkmale beizubehalten. Der Standardwert ist 0,33. Bereich: 0 bis 0,5. |

Beispielverwendung:

python src/main.py "path/to/input/audio.wav" "JohnDoe" 2 rmvpe 0.7 3 0.3 0.35

Dieser Befehl konvertiert die Stimme in „audio.wav“ unter Verwendung des „JohnDoe“-RVC-Modells und erhöht die Tonhöhe um 2 Halbtöne unter Verwendung des „rmvpe“-Tonhöhenerkennungsalgorithmus mit einer Indexrate von 0,7, einem Filterradius von 3 und einer RMS-Mischung Rate von 0,3 und Schutzrate von 0,35.

Entpacken Sie (falls erforderlich) die .pth und .index Dateien und übertragen Sie sie in einen neuen Ordner im Verzeichnis rvc_models. Jeder Ordner sollte nur eine .pth und eine .index Datei enthalten.

Die Verzeichnisstruktur sollte etwa so aussehen:

├── rvc_models │ ├── John │ │ ├── JohnV2.pth │ │ └── added_IVF2237_Flat_nprobe_1_v2.index │ ├── May │ │ ├── May.pth │ │ └── added_IVF2237_Flat_nprobe_1_v2.index │ ├── MODELS.txt │ └── hubert_base.pt ├── voice_output └── src

Die Verwendung der konvertierten Stimme für die folgenden Zwecke ist untersagt.

Kritik oder Angriff auf Einzelpersonen.

Befürwortung oder Ablehnung bestimmter politischer Positionen, Religionen oder Ideologien.

Öffentliches Zurschaustellen stark anregender Gesichtsausdrücke ohne entsprechende Zoneneinteilung.

Verkauf von Sprachmodellen und generierten Sprachclips.

Nachahmung der Identität des ursprünglichen Besitzers der Stimme mit böswilliger Absicht, anderen zu schaden/zu verletzen.

Betrügerische Zwecke, die zu Identitätsdiebstahl oder betrügerischen Telefonanrufen führen.

Ich hafte nicht für direkte, indirekte, Folge-, Neben- oder Sonderschäden, die sich aus der Nutzung/dem Missbrauch oder der Unmöglichkeit der Nutzung dieser Software ergeben oder in irgendeiner Weise damit verbunden sind.