في مجال توليد الفيديو ، تم اعتبار Openai Sora بمثابة معيار في الصناعة لتكاليف التدريب المرتفعة والأداء الممتاز. ومع ذلك ، أعلنت شركة Luchen Technology مؤخرًا عن المصدر المفتوح لنموذج توليد الفيديو Open-Sora2.0 ، والذي تسبب بلا شك في إحساس كبير في هذه الصناعة. سرعان ما أصبح Open-SORA2.0 محورًا جديدًا لتكنولوجيا توليد الفيديو مع تكلفة التدريب المنخفضة للغاية وأدائها بالقرب من النماذج العليا.

تبلغ تكلفة تدريب Open-SORA2.0 فقط 200،000 دولار أمريكي ، وهو ما يعادل استثمار 224 وحدات معالجة الرسومات ، لكنها نجحت في تدريب نموذج لتوليد الفيديو على المستوى التجاري مع 11 مليار معلمة. لا يوضح هذا الإنجاز الاختراقات التكنولوجية لـ Luchen Technology فحسب ، بل يوفر أيضًا إمكانيات جديدة إلى مجال توليد الفيديو.

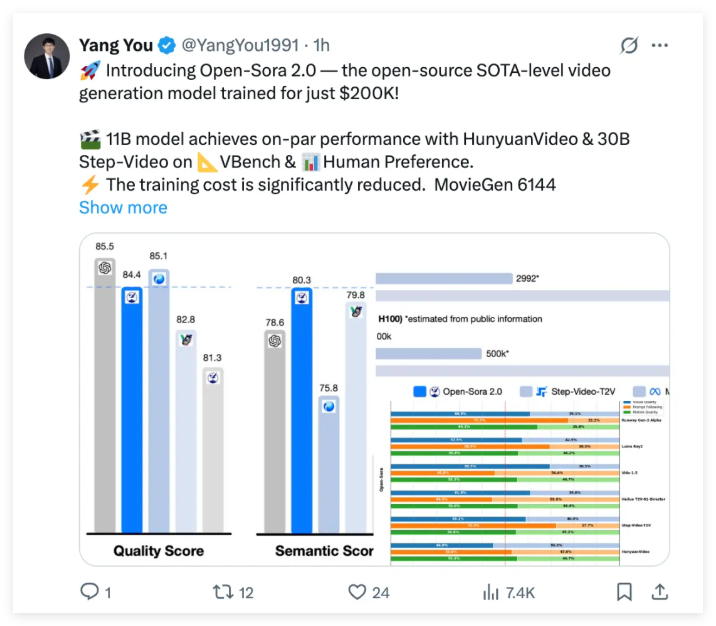

على الرغم من أن Open-SORA2.0 يكلف أقل بكثير من Openai Sora ، إلا أن أدائها لا يقل عن ذلك. قامت Open-Sora2.0 بأداء مثيرة للإعجاب في اختبارات VBENCH وتفضيلات المستخدم ، ويمكن أن تتنافس مع نماذج مصداقية مغلقة تكلف ملايين الدولارات للتدريب على مقاييس رئيسية متعددة. خاصة في تقييم VBench ، ضاقت فجوة الأداء بين Open-Sora2.0 و Openai Sora بشكل كبير من 4.52 ٪ السابقة إلى 0.69 ٪ فقط ، مما حقق تقريبًا أداء شامل.

الأمر الأكثر إثارة هو أن درجات Open-SORA2.0 تتجاوز حتى Hunyuanvideo Tencent في Vbench ، مما يدل على قوته القوية في تقنية توليد الفيديو. هذا الإنجاز لا يثبت فقط المزايا التكنولوجية لـ Open-SORA2.0 ، ولكن أيضًا يضع معيارًا جديدًا لتكنولوجيا توليد الفيديو مفتوح المصدر.

في مراجعة تفضيلات المستخدم ، يحتوي Open-Sora2.0 على الأقل على مؤشرين يتجاوزان نموذج SOTA Open SOTA Hunyuanvideo ومدرج نموذج الأعمال Gen-3Alpha في الأبعاد الرئيسية الثلاثة للأداء البصري واتساق النص وأداء الإجراء. يعمل هذا الإنجاز على توحيد موقع Open-SORA2.0 الرائد في مجال توليد الفيديو.

السبب في أن Open-SORA2.0 يمكن أن يحقق مثل هذا الأداء العالي بتكلفة منخفضة يرجع إلى سلسلة من الابتكارات التكنولوجية واستراتيجيات التحسين. بادئ ذي بدء ، يواصل Open-SORA2.0 فكرة التصميم الخاصة بـ Open-Sora1.2 ، وتبني إطار تدريب ثلاثي الأبعاد ومتطابقة التدفق ، ويقدم آلية انتباه كاملة ثلاثية الأبعاد لزيادة تحسين جودة توليد الفيديو.

من أجل متابعة تحسين التكلفة النهائية ، يبدأ Open-SORA2.0 من جوانب متعددة: يضمن فحص البيانات الصارم إدخال بيانات التدريب عالي الجودة ، يتم إعطاء الأولوية للتدريب منخفض الدقة لتعلم معلومات الحركة بكفاءة ، ويتم إعطاء الأولوية لمهمينات الفيديو الرسم البياني للتدريب على تسريع التقارب النموذجي ، واعتماد مخطط فعال للتدريب المتوازي.

تشير التقديرات إلى أن تكلفة التدريب الواحد لأكثر من 10B نماذج فيديو مفتوحة المصدر في السوق غالبًا ما تكون ملايين الدولارات ، في حين أن Open-SORA2.0 يقلل من هذه التكلفة بمقدار 5-10 مرات. هذا الاختراق لا يقلل فقط من عتبة توليد الفيديو عالي الجودة ، ولكن يمنح أيضًا المزيد من المطورين الفرصة للمشاركة في البحث وتطوير تقنية توليد الفيديو.

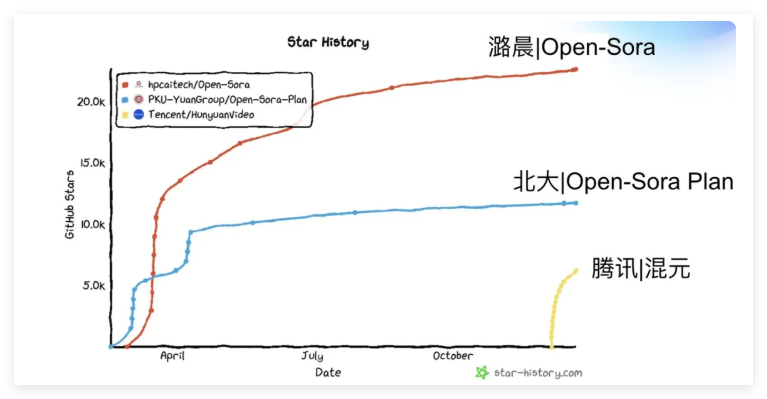

الأمر الأكثر جدارة هو أن Open-SORA2.0 ليس فقط رمز النموذج والأوزان مفتوح المصدر ، ولكن أيضًا رمز التدريب المفتوح للعملية الكاملة ، والذي سيعزز بلا شك بشكل كبير تطوير النظام الإيكولوجي مفتوح المصدر بالكامل. تلقى عدد الاستشهادات الورقية الأكاديمية لـ Open-Sora2.0 ما يقرب من 100 اقتباس في غضون نصف عام ، حيث احتل المرتبة الأولى في تصنيف التأثير المفتوح المصدر العالمي ، ليصبح أحد أكثر مشاريع توليد الفيديو مفتوحة في العالم.

يستكشف فريق Open-SORA2.0 أيضًا بنشاط تطبيق Autoencoder للفيديو نسبة الضغط العالي لتقليل تكاليف الاستدلال بشكل كبير. لقد قاموا بتدريب مشفر تلقائي للفيديو مع نسبة ضغط عالية (4 × 32 × 32) لتقصير وقت الاستدلال لتوليد 768 بكسل و 5 ثوان في بطاقة واحدة من ما يقرب من 30 دقيقة إلى 3 دقائق ، وزادت السرعة بمقدار 10 مرات. هذا الابتكار يعني أنه يمكننا إنشاء محتوى فيديو عالي الجودة بشكل أسرع في المستقبل.

طراز توليد الفيديو مفتوح المصدر مفتوح SORA2.0 الذي تم إطلاقه بواسطة Luchen Technology ، مع خصائصه منخفضة التكلفة وعالية الأداء وشاملة المصادر المفتوحة ، يجلب بلا شك اتجاه "تكافؤ" قوي إلى مجال توليد الفيديو. لم يضيق ظهورها الفجوة مع نماذج المصدر المغلقة العلوية فحسب ، بل خفضت أيضًا عتبة توليد الفيديو عالي الجودة ، مما يسمح لمزيد من المطورين بالمشاركة والترويج بشكل مشترك لتطوير تقنية توليد الفيديو.

مستودع GitHub Open Source: https://github.com/hpcaitech/open-sora

التقرير الفني: https://github.com/hpcaitech/open-sora-demo/blob/main/paper/open_sora_2_tech_report.pdf