Downcodes小編獲悉,一款名為Molmo的開源多模態人工智慧模型近期引發廣泛關注。它基於Qwen2-72B,並利用OpenAI的CLIP作為視覺處理引擎,以其高效的性能和創新的指向功能,在多模態AI領域展現出強大的競爭力,甚至挑戰了傳統商業模型的領先地位。其小巧的設計不僅提升了效率,也增強了部署彈性,為AI應用帶來了更多可能性。

近日,一款名為Molmo的開源多模態人工智慧模型引起了業界廣泛關注。這個由Qwen2-72B為基礎、借助OpenAI的CLIP作為視覺處理引擎的AI系統,正以其出色的性能和創新的功能挑戰傳統商業模型的霸主地位。

Molmo的突出特點在於其高效能的性能表現。儘管體積相對較小,但它在處理能力上可以與規模大十倍的競爭對手相媲美。這種小而精的設計理念不僅提高了模型的效率,也為其在各種應用場景中的部署提供了更大的靈活性。

與傳統多模態模型相比,Molmo的創新之處在於其引入的指向功能。這項特性使得模型能夠與現實和虛擬環境進行更深入的互動,為人機互動和擴增實境等應用開啟了新的可能性。這種設計不僅提升了模型的實用性,也為未來AI與真實世界的深度融合奠定了基礎。

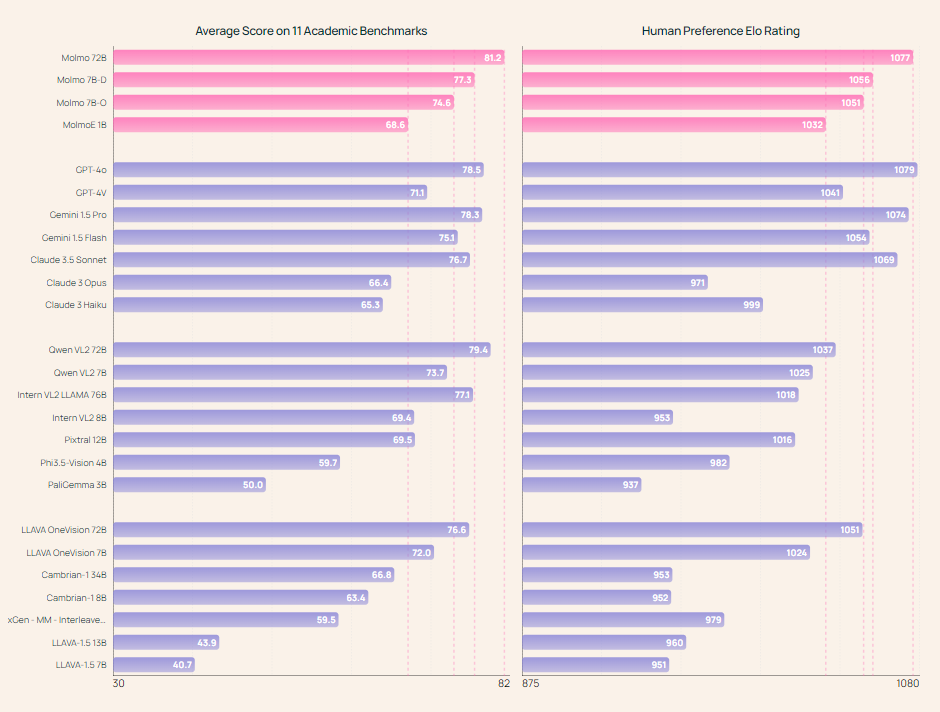

在性能評估方面,Molmo-72B的表現特別亮眼。它在多個學術基準測試中創下新紀錄,在人類評估中僅次於GPT-4o,排名第二。這項成績充分證明了Molmo在實際應用上的卓越表現。

Molmo的另一個亮點是其開源性質。模型的權重、程式碼、資料和評估方法均對外公開,這不僅體現了開源精神,也為整個AI社群的發展做出了重要貢獻。這種開放態度將有助於推動AI技術的快速迭代和創新。

在具體功能方面,Molmo展現出全面的能力。它不僅能產生高品質的圖像描述,還能精準理解圖像內容,回答相關問題。在多模態互動方面,Molmo支援文字和圖像的同時輸入,並能透過2D指向互動來增強與視覺內容的互動性。這些功能大大拓展了AI在實際應用上的可能性。

Molmo的成功很大程度上歸功於其高品質的訓練資料。研發團隊採用了創新的資料收集方法,透過語音描述影像來獲得更詳細的內容資訊。這種方法不僅避免了文字描述常見的簡略問題,還收集了大量高品質、多樣化的訓練資料。

在多樣性方面,Molmo的資料集涵蓋廣泛的場景和內容,支援多種使用者互動方式。這使得Molmo在特定任務上表現出色,例如回答影像相關問題、改善OCR任務等。

值得一提的是,Molmo在與其他模型的對比中表現優異,尤其是在學術基準測試和人類評估中。這不僅證明了Molmo的實力,也為AI評估方法提供了新的參考。

Molmo的成功再次證明,在AI開發中,數據品質比數量更為重要。僅用不到100萬對圖像文字的數據,Molmo就展現了驚人的訓練效率和性能。這為未來AI模型的發展提供了新的思路。

專案網址:https://molmo.allenai.org/blog

總而言之,Molmo憑藉其高效的性能、創新的指向功能以及開源的特性,在多模態人工智慧領域展現出了巨大的潛力,為未來AI發展提供了新的方向和思路。 Downcodes小編期待其在更多領域的應用與進一步發展。