該倉庫是LTSF線性的官方Pytorch實施:“變形金剛有效的時間序列預測?”。

[2024/01/28]我們的模型已包含在神經Forecast中。特別感謝撰稿人@cchallu!

[2022/11/23]接受了三個強項接受AAAI 2023!我們還發布了長期時間序列的基準預測,以進行進一步研究。

[2022/08/25]我們對論文進行了全面的分析,以了解為什麼現有的LTSF-Transformers在LTSF問題上無法正常工作!

[2022/08/25]除了dlinear,我們很高興在紙張和該倉庫中添加兩個線性模型。現在我們有一個LTSF線性家庭!

[2022/08/25]我們更新了LTSF-Linear的一些腳本。

除LTSF線性外,我們還提供了五個重要的預測變壓器,以重新實現本文中的結果。

我們在./scripts中提供所有實驗腳本文件:

| 文件 | 解釋 |

|---|---|

| exp-longforecasting | 長期時間序列預測任務 |

| Exp-lookbackwindow | 研究不同的外觀窗口尺寸的影響 |

| 展示 | 研究不同嵌入策略的影響 |

此代碼只是基於自動配置器的代碼庫構建。我們非常感謝以下GitHub存儲庫的寶貴代碼庫或數據集:

AutoFormer,Informer和Transferer的實現來自https://github.com/thuml/autoformer

FedFormer的實現來自https://github.com/maziqing/fedformer

pyraformer的實現來自https://github.com/alipay/pyraformer

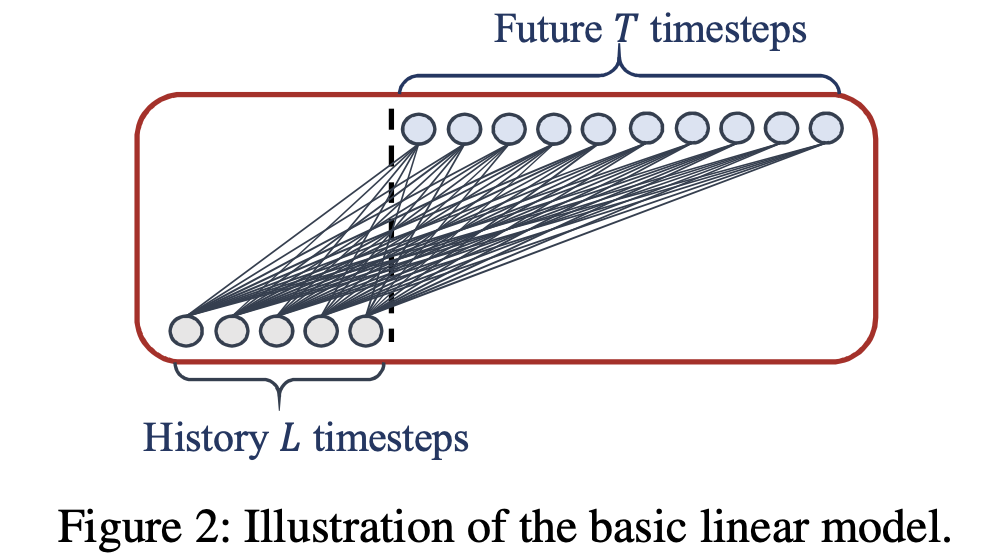

LTSF線性是一組線性模型。

LTSF線性是一組線性模型。

儘管LTSF線性很簡單,但它具有一些令人信服的特徵:

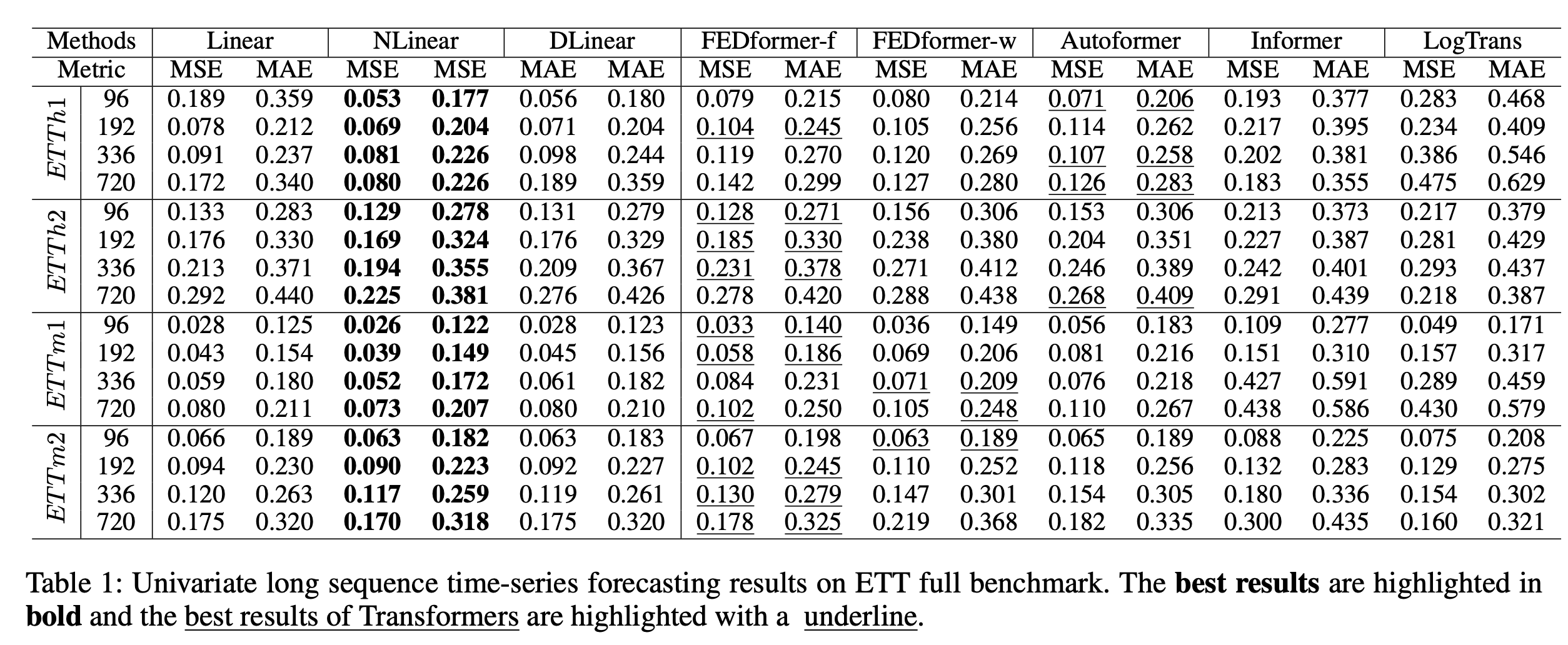

單變量預測: 多元預測:

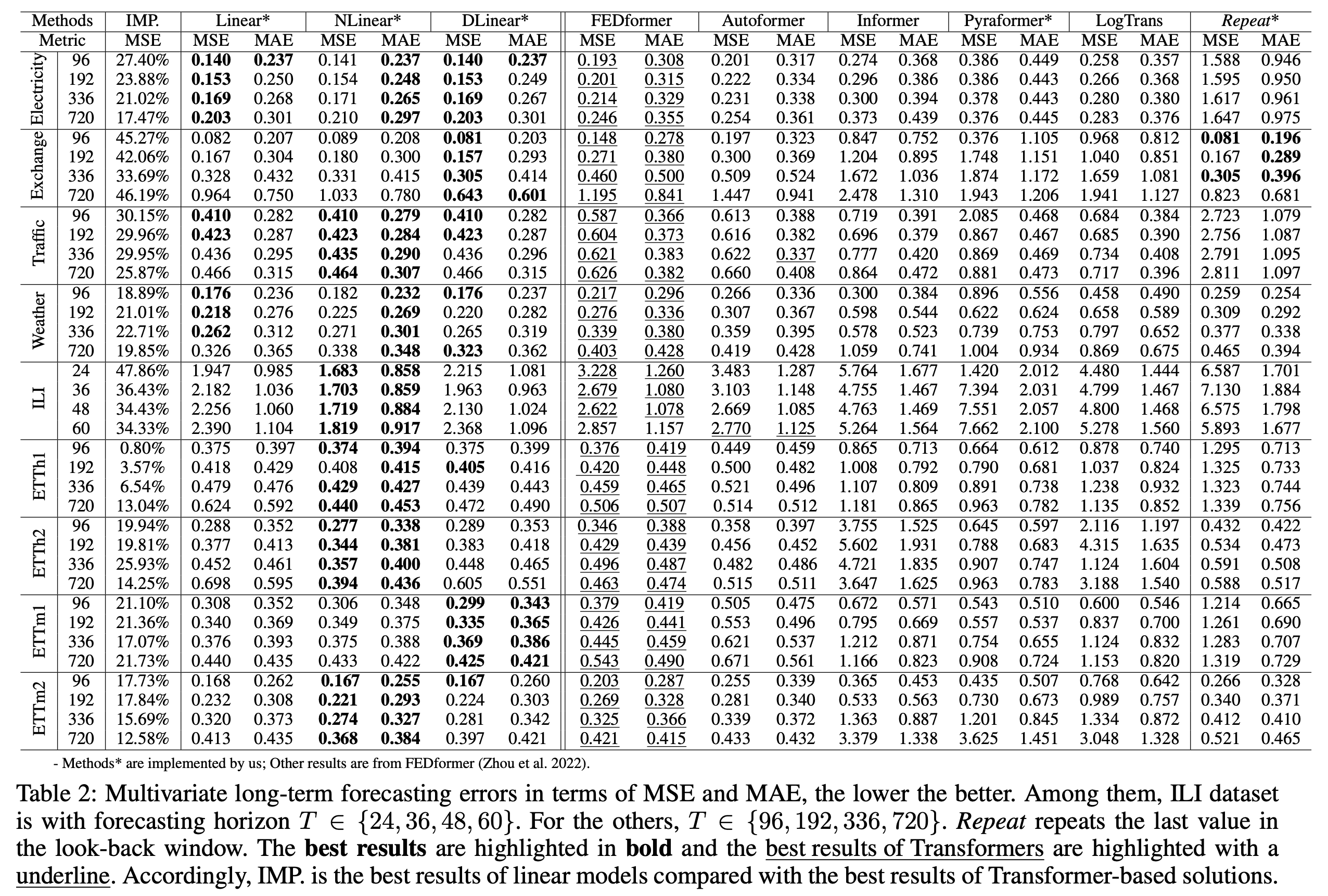

多元預測: LTSF線性的表現優於所有基於變壓器的方法的大幅度。

LTSF線性的表現優於所有基於變壓器的方法的大幅度。

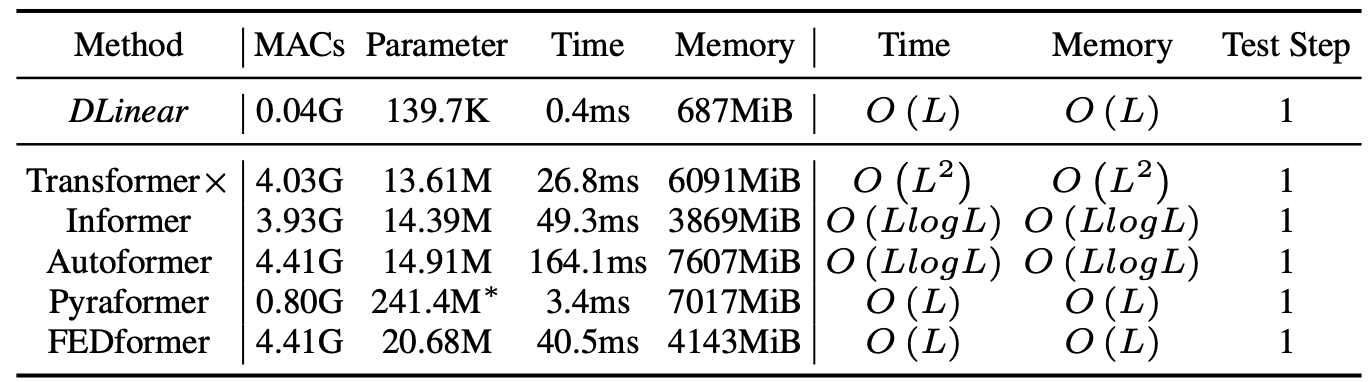

將方法效率與外觀背面窗口尺寸96和預測步驟720進行比較。 MAC是多功能操作的數量。我們使用dlinear進行比較,因為它在LTSF線性中具有雙重成本。推理時間平均為5。

將方法效率與外觀背面窗口尺寸96和預測步驟720進行比較。 MAC是多功能操作的數量。我們使用dlinear進行比較,因為它在LTSF線性中具有雙重成本。推理時間平均為5。

首先,請確保您已經安裝了Conda。然後,我們的環境可以通過:

conda create -n LTSF_Linear python=3.6.9

conda activate LTSF_Linear

pip install -r requirements.txt

您可以從AutoFormer提供的Google Drive獲得所有9個基準。所有數據集都是經過精心處理的,可以輕鬆使用。

mkdir dataset

請將它們放在./dataset目錄中

scripts/中,我們提供模型實現dlinear/autoFormer/Informer/TransfererFEDformer/scripts/ ,我們提供FedFormer實施Pyraformer/scripts/ ,我們提供了pyraformer實現例如:

要在Exchange-rate數據集上訓練LTSF線性,您可以使用腳本scripts/EXP-LongForecasting/Linear/exchange_rate.sh :

sh scripts/EXP-LongForecasting/Linear/exchange_rate.sh

默認情況下,它將開始訓練dlinear,結果將顯示在logs/LongForecasting中。您可以在腳本中指定模型的名稱。 (線性,dlinear,nlinear)

所有有關在長期預測任務上使用ltsf linear的腳本都是在scripts/EXP-LongForecasting/Linear/中,您可以以類似的方式運行它們。腳本中的默認外觀窗口為336,LTSF線性通常可以通過紙張中的較長的外觀窗口獲得更好的結果。

關於外觀背回窗口大小以及對FedFormer和pyraformer的長期預測的腳本分別在FEDformer/scripts和Pyraformer/scripts中。要運行它們,您需要首先使用cd FEDformer或cd Pyraformer 。然後,您可以使用SH以類似的方式運行它們。日誌將存儲在logs/中。

scripts/EXP-LongForecasting/Linear/ the 5min-20min中的每個實驗。對於其他變壓器腳本,由於我們將所有相關實驗放在一個腳本文件中,因此直接運行它們將每天需要8個小時。您可以保持您感興趣的實驗並對其他人發表評論。

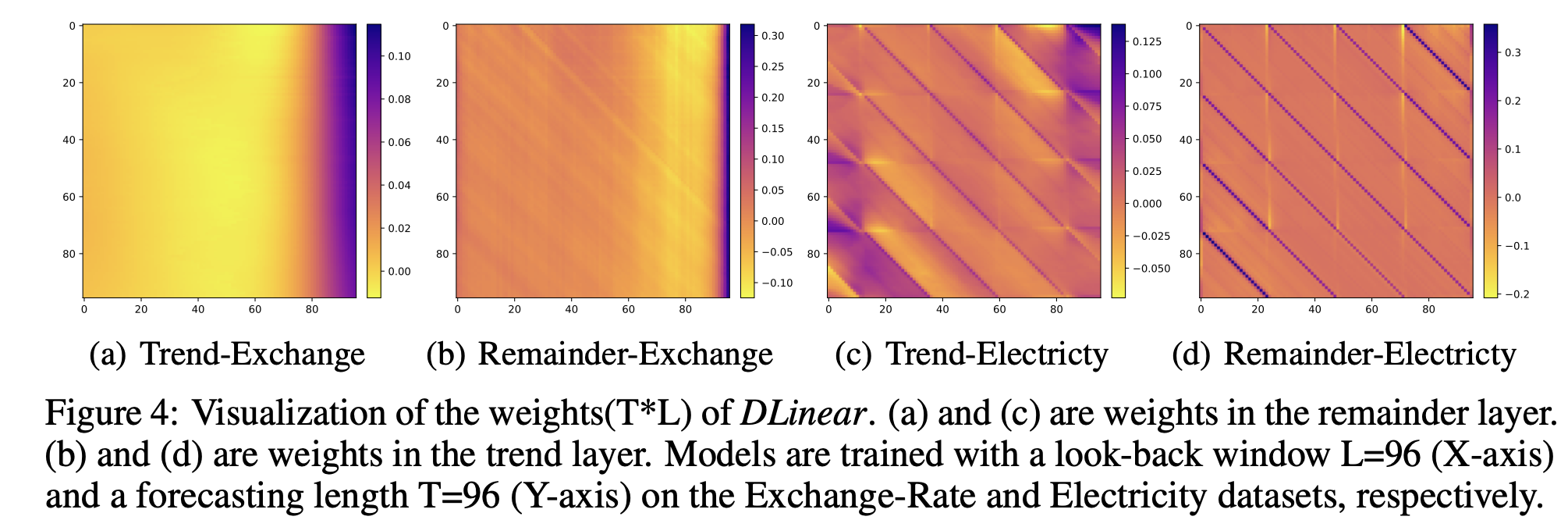

如我們的論文所示,LTSF線性的權重可以揭示數據的某些特徵,即周期性。例如,我們提供了weight_plot.py中dlinear的重量可視化。要運行可視化,您需要輸入dlinear的模型路徑(model_name)(默認情況下為./checkpoint中的模型目錄)。為了獲得平滑清晰的模式,您可以使用我們在線性模型文件中提供的初始化。

如果您發現此存儲庫對您的工作有用,請考慮以下內容:

@inproceedings { Zeng2022AreTE ,

title = { Are Transformers Effective for Time Series Forecasting? } ,

author = { Ailing Zeng and Muxi Chen and Lei Zhang and Qiang Xu } ,

journal = { Proceedings of the AAAI Conference on Artificial Intelligence } ,

year = { 2023 }

}請記住,如果您在實驗中使用了所有數據集並比較所有數據集。