vits japros webui

1.0.0

bert-vits2参考文章:https://zenn.dev/litagin/articles/b1ddc1da5ea2b3

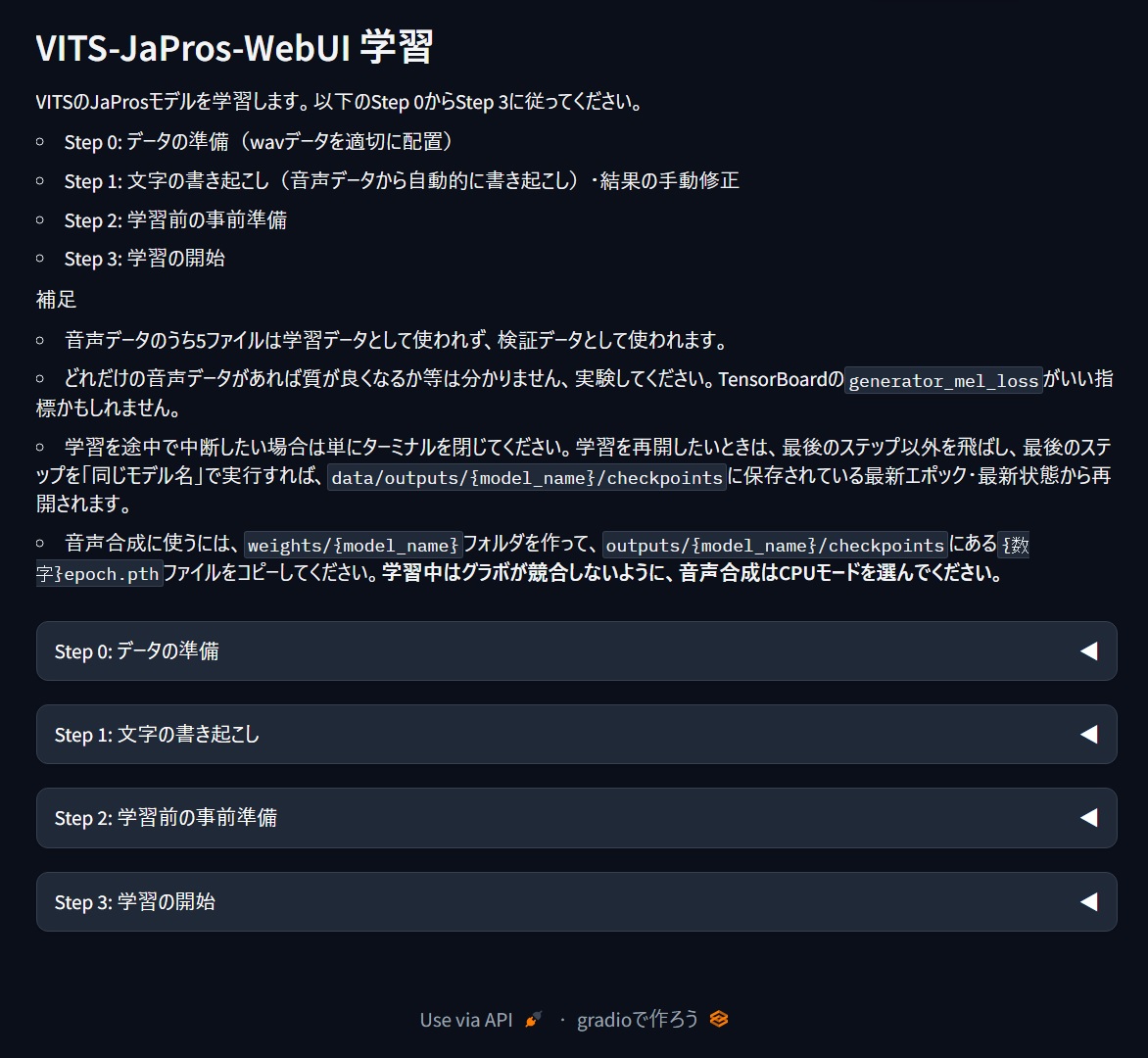

这是一个用于窗口的WebUI,可让您学习日本VITS模型,并允许您用口音合成语音。如果您只有语音综合,即使没有图形卡也可以使用它。

?语音综合演示

| 语音综合 | 学习 |

|---|---|

|  |

pyopenjtalk_prosody ,其中添加了强调符号。在这种情况下,我正在使用pyopenjtalk_prosody训练G2P的模型,并为方便起见(Bing-Chan的建议)。

pyopenjtalk_prosody还处理诸如重音之类的符号,因此您可以使用它们来控制口音(ハ➚シハ➘シ)。

| 象征 | 角色 | 例子 |

|---|---|---|

[ | 重音从这里升起(图像➚) | 您好→コ[ンニチワ |

] | 口音从这里掉下来(图像➘) | 京都→キョ]オト |

(半宽空间) | 剪切诗(以某种方式一块蛋糕) | ソ[レワ ム[ズカシ]イ |

、 | 姿势(屏住呼吸)。当您想做一个短姿势时,请使用它。 | ハ]イ、ソ[オ オ[モイマ]ス |

? | 我将其添加到问题的结尾。 | キ[ミワ ダ]レ? |

这使您可以在本地Windows环境中训练,负载和语音综合JAPROS模型。

config.yaml中,它也应该有效我已经确认它在Windows 11上使用Python 3.10在RTX 4070上有效。

git clone https://github.com/litagin02/vits-japros-webui.gitsetup.bat 。 Setup complete.看起来,你完成了。webui_train.batpth文件,然后双击webui_infer.batupdate.bat有关更多信息,如果您不需要WebUI,请单击此处。

对于模型,在weights目录中创建一个子目录,然后将{数字}epoch.pth文件放入其中。如果您使用的是外部模型(仅与pyopenjtalk_prosody在vits中与ESPNET兼容的模型),请在研究时还包括config.yaml 。

weights

├── model1

│ └── 100epoch.pth

|── model2

│ ├── 50epoch.pth

│ └── config.yaml

...

os.uname和符号链接创建位置进行修改)。