*****新:Stargan V2可在https://github.com/clovaai/stargan-v2 *****上找到

该存储库提供了以下论文的官方Pytorch实施:

Stargan:用于多域图像到图像翻译的统一生成对抗网络

Yunjey Choi 1,2 ,Minje Choi 1,2 ,Munyoung Kim 2,3 ,Jung-Woo HA 2 ,Sung Kim 2,4 ,Jaegul Choo 1,2

1韩国大学,Naver Corp. 2 Clova AI研究。

3新泽西学院,香港科学技术大学4

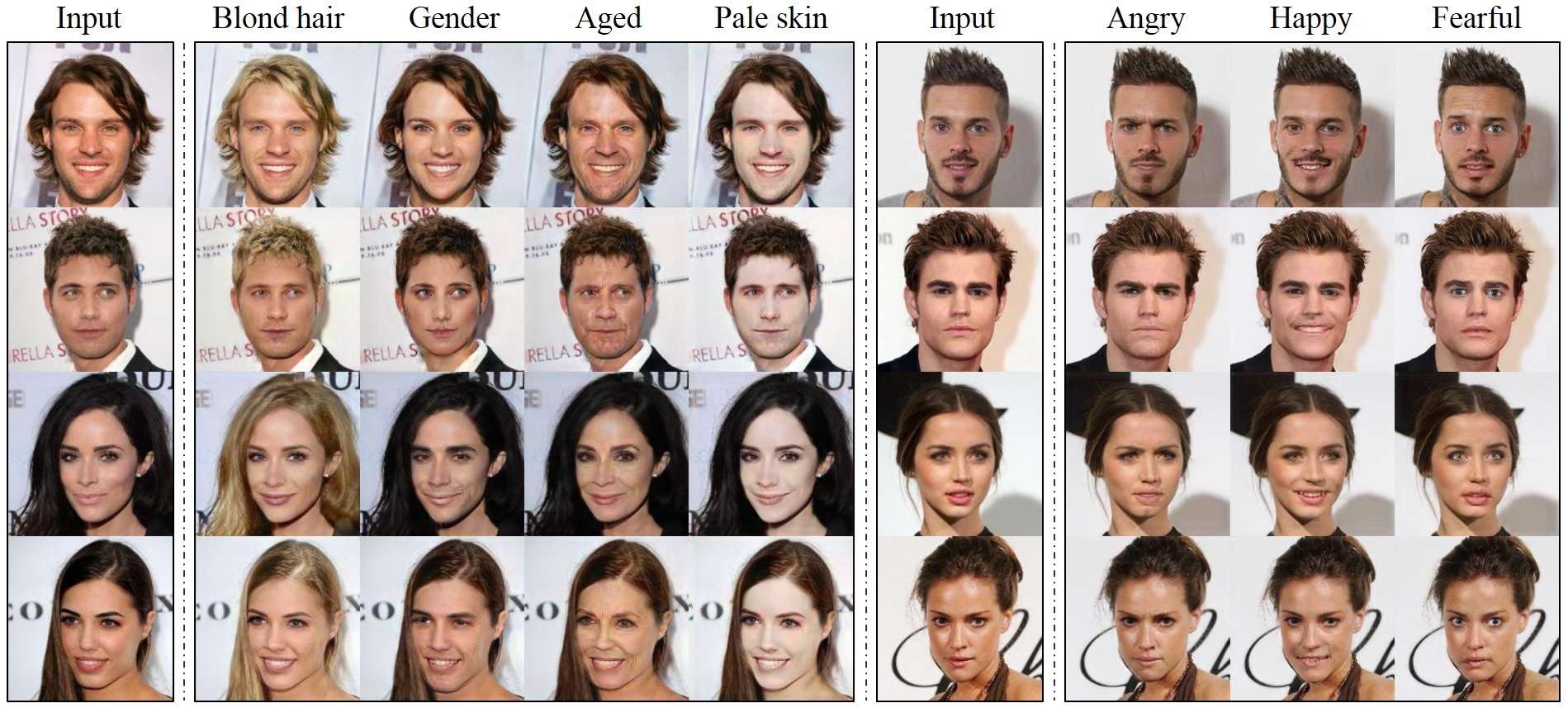

https://arxiv.org/abs/1711.09020摘要:最近的研究表明,在两个领域的图像到图像翻译方面取得了显着成功。但是,现有方法在处理两个以上的域时具有有限的可扩展性和鲁棒性,因为应针对每对图像域独立构建不同的模型。为了解决此限制,我们提出了Stargan,这是一种新颖且可扩展的方法,可以仅使用单个模型对多个域进行图像到图像翻译。这样的统一模型体系结构允许同时培训单个网络中具有不同域的多个数据集。与现有模型相比,这导致了Stargan翻译图像的卓越质量,以及将输入图像灵活地转换为任何所需目标域的新型能力。我们从经验上证明了方法对面部属性转移和面部表达综合任务的有效性。

要下载Celeba数据集:

git clone https://github.com/yunjey/StarGAN.git

cd StarGAN/

bash download.sh celeba要下载RAFD数据集,您必须从Radboud Faces数据库网站请求访问数据集。然后,您需要如下所述创建一个文件夹结构。

要在Celeba上训练Stargan,请在下面运行培训脚本。请参阅此处,以获取Celeba数据集中的可选属性列表。如果更改selected_attrs参数,则还应相应地更改c_dim参数。

# Train StarGAN using the CelebA dataset

python main.py --mode train --dataset CelebA --image_size 128 --c_dim 5

--sample_dir stargan_celeba/samples --log_dir stargan_celeba/logs

--model_save_dir stargan_celeba/models --result_dir stargan_celeba/results

--selected_attrs Black_Hair Blond_Hair Brown_Hair Male Young

# Test StarGAN using the CelebA dataset

python main.py --mode test --dataset CelebA --image_size 128 --c_dim 5

--sample_dir stargan_celeba/samples --log_dir stargan_celeba/logs

--model_save_dir stargan_celeba/models --result_dir stargan_celeba/results

--selected_attrs Black_Hair Blond_Hair Brown_Hair Male Young在Rafd上训练Stargan:

# Train StarGAN using the RaFD dataset

python main.py --mode train --dataset RaFD --image_size 128

--c_dim 8 --rafd_image_dir data/RaFD/train

--sample_dir stargan_rafd/samples --log_dir stargan_rafd/logs

--model_save_dir stargan_rafd/models --result_dir stargan_rafd/results

# Test StarGAN using the RaFD dataset

python main.py --mode test --dataset RaFD --image_size 128

--c_dim 8 --rafd_image_dir data/RaFD/test

--sample_dir stargan_rafd/samples --log_dir stargan_rafd/logs

--model_save_dir stargan_rafd/models --result_dir stargan_rafd/results在Celeba和Rafd上训练Stargan:

# Train StarGAN using both CelebA and RaFD datasets

python main.py --mode=train --dataset Both --image_size 256 --c_dim 5 --c2_dim 8

--sample_dir stargan_both/samples --log_dir stargan_both/logs

--model_save_dir stargan_both/models --result_dir stargan_both/results

# Test StarGAN using both CelebA and RaFD datasets

python main.py --mode test --dataset Both --image_size 256 --c_dim 5 --c2_dim 8

--sample_dir stargan_both/samples --log_dir stargan_both/logs

--model_save_dir stargan_both/models --result_dir stargan_both/results要在您自己的数据集上训练Stargan,请以与RAFD相同的格式创建一个文件夹结构,然后运行命令:

# Train StarGAN on custom datasets

python main.py --mode train --dataset RaFD --rafd_crop_size CROP_SIZE --image_size IMG_SIZE

--c_dim LABEL_DIM --rafd_image_dir TRAIN_IMG_DIR

--sample_dir stargan_custom/samples --log_dir stargan_custom/logs

--model_save_dir stargan_custom/models --result_dir stargan_custom/results

# Test StarGAN on custom datasets

python main.py --mode test --dataset RaFD --rafd_crop_size CROP_SIZE --image_size IMG_SIZE

--c_dim LABEL_DIM --rafd_image_dir TEST_IMG_DIR

--sample_dir stargan_custom/samples --log_dir stargan_custom/logs

--model_save_dir stargan_custom/models --result_dir stargan_custom/results要下载预训练的模型检查点,请在下面运行脚本。预先训练的模型检查点将下载并保存到./stargan_celeba_128/models目录中。

$ bash download.sh pretrained-celeba-128x128要使用预训练模型翻译图像,请在下面运行评估脚本。翻译的图像将保存到./stargan_celeba_128/results目录中。

$ python main.py --mode test --dataset CelebA --image_size 128 --c_dim 5

--selected_attrs Black_Hair Blond_Hair Brown_Hair Male Young

--model_save_dir= ' stargan_celeba_128/models '

--result_dir= ' stargan_celeba_128/results ' 如果您发现这项工作对您的研究有用,请引用我们的论文:

@inproceedings{choi2018stargan,

author={Yunjey Choi and Minje Choi and Munyoung Kim and Jung-Woo Ha and Sunghun Kim and Jaegul Choo},

title={StarGAN: Unified Generative Adversarial Networks for Multi-Domain Image-to-Image Translation},

booktitle={Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition},

year={2018}

}

这项工作主要是在第一作者在Naver的Clova AI Research进行研究实习时完成的。我们感谢Naver的所有研究人员,尤其是Donghyun Kwak的所有研究人员,都进行了深刻的讨论。