최근 Hangzhou Qunkeng 기술은 오픈 소스 공간 이해 모델 SpatialLM을 통해 기술 커뮤니티의 초점이되었습니다. 이 혁신적인 모델은 Google이 연구 논문에서 구체적으로 언급했으며 로봇 교육의 주요 획기적인 발전을 표시했습니다. SpatialLM의 핵심 기능은 로봇이 일반 비디오를 통해 물리적 세계의 기하학적 관계를 이해할 수 있도록하여 로봇 훈련에 완전히 새로운 가능성을 제공한다는 것입니다.

SpatialLM은 휴대 전화로 캡처 한 비디오를 정확한 3 차원 공간 레이아웃 정보로 변환 할 수 있다는 점에서 독특합니다. 사용자는 휴대 전화로 집에서 장면을 녹음하면되며 SpatialLM은 방 구조, 가구의 위치 및 채널의 폭을 포함한 자세한 3D 모델을 생성 할 수 있습니다. 이 기술은 로봇 교육 비용을 크게 줄일뿐만 아니라 교육 효율성을 크게 향상시켜 로봇 기술의 대중화 및 적용을위한 길을 열어줍니다.

GTC2025 컨퍼런스에서 CNK 기술은 가상 교육 플랫폼 Spatialverse를 선보였습니다. 이 플랫폼은 SpatialLM에 의해 생성 된 데이터를 결합하여 로봇이 시뮬레이션 된 환경에서 장애물 회피 및 잡기와 같은 복잡한 작업을 훈련시켜 인식에서 행동에 이르기까지 완전히 폐쇄 된 루프를 달성 할 수 있도록합니다. 이 시스템을 통해 로봇은 공간 레이아웃을 "참조"할뿐만 아니라 복잡한 환경에서 작동하는 방법을 이해할 수 있으며, 이는 실제 세계에서 로봇 적용에 대한 강력한 기술 지원을 제공합니다.

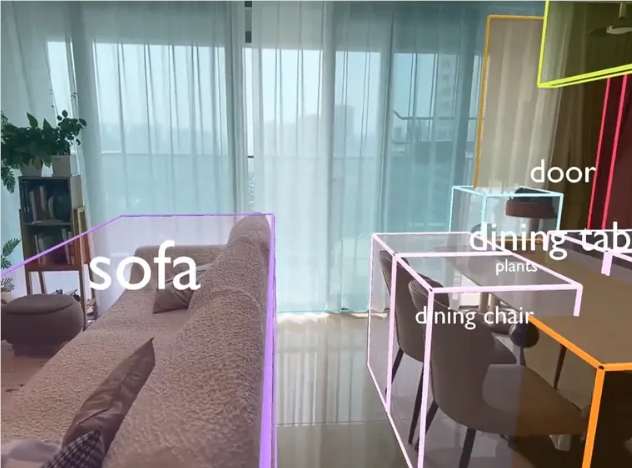

SpatialLM의 작동 원리는 MAST3R-SLAM 기술을 기반으로하며 비디오를 수많은 프레임으로 분해하고 소파 및 테이블과 같은 객체의 세부 사항을 추출하여 포인트 클라우드 모델로 빌드합니다. 그런 다음 모델은이 데이터를 구조화 된 3D 레이아웃으로 변환하여 크기 및 위치와 같은 각 객체에 대한 주요 정보를 기록합니다. SpatialLM은 기존의 훈련 방법과 비교할 때 시간과 자원을 절약 할뿐만 아니라 로봇의 공간인지 능력을 크게 향상시켜 복잡한 환경에 더 잘 적응할 수 있습니다.

이 기술의 독특한 점은 로봇이 인간과 같은 복잡한 환경 변화를 이해하고 처리 할 수 있다는 것입니다. 주택 생활의 일상적인 아이템이든 직장의 도구이든 Spatiallm은 로봇이 빠르게 적응하고 작업을 수행하는 데 도움이됩니다. 이 기능은 실제 환경, 특히 현재 구체화 된 지능 분야에서 로봇의 성능을 향상시키는 데 중요합니다. 많은 기술이 여전히이를 구현하는 데 어려움을 겪고 있습니다.

CNK는 오픈 소스 Spatiallm 및 Spatialverse를 통해 로봇 훈련의 미래를 재구성하여 실제 세계의 도전에 유연하게 대응할 수있게 해줍니다. 이 기술의 광범위한 적용은 로봇 공학 기술의 추가 개발을 촉진 할뿐만 아니라 인간의 삶에 더 편의를 가져다 줄 것입니다.

프로젝트 주소 : https://top.aibase.com/tool/spatiallm