最近、Hangzhou Qunkengテクノロジーは、オープンソースの空間理解モデルSpatiallmを使用して、再びテクノロジーコミュニティの焦点になりました。この革新的なモデルは、Googleが研究論文で特別に言及し、ロボットトレーニングの主要なブレークスルーをマークしました。 Spatiallmのコア機能は、ロボットが通常のビデオを通じて物理的世界の幾何学的関係を理解できるようにし、ロボットトレーニングにまったく新しい可能性を提供できることです。

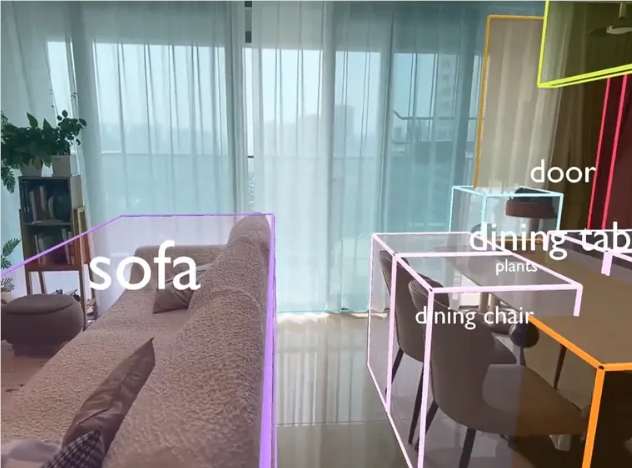

Spatiallmは、携帯電話でキャプチャされたビデオを正確な3次元空間レイアウト情報に変換できるという点でユニークです。ユーザーは携帯電話で自宅でシーンを録音するだけで、Spatiallmは部屋の構造、家具の場所、チャネルの幅など、詳細な3Dモデルを生成できます。このテクノロジーは、ロボットトレーニングのコストを大幅に削減するだけでなく、トレーニング効率を大幅に改善し、ロボットテクノロジーの普及と適用への道を開いています。

GTC2025会議では、CNKテクノロジーも仮想トレーニングプラットフォームのSpatialverseを披露しました。このプラットフォームは、Spatiallmによって生成されたデータを組み合わせて、ロボットが障害物の回避やシミュレートされた環境でつかむなどの複雑なタスクをトレーニングできるようにし、それにより認知から行動への完全なクローズドループを実現します。このシステムを通じて、ロボットは空間レイアウトを「見る」だけでなく、複雑な環境で動作する方法を理解することもできます。これは、現実世界でのロボットの適用に強力な技術サポートを提供します。

SPATIALLMの作業原則は、ビデオを無数のフレームに分解し、ソファやテーブルなどのオブジェクトの詳細を抽出し、それらをポイントクラウドモデルに組み込むMAST3R-SLAMテクノロジーに基づいています。このモデルは、このデータを構造化された3Dレイアウトに変換し、サイズや位置などの各オブジェクトに関する重要な情報を記録します。従来のトレーニング方法と比較して、Spatiallmは時間とリソースを節約するだけでなく、ロボットの空間認知能力を大幅に改善し、複雑な環境によりよく適応できるようにします。

このテクノロジーのユニークな点は、ロボットが人間のような複雑な環境変化を理解して処理できるようにすることです。ホームライフの日常的なアイテムであろうと、職場でのツールであろうと、Spatiallmはロボットが迅速に適応し、タスクを実行するのに役立ちます。この機能は、実際の環境、特に現在の具体化されたインテリジェンスの分野でロボットのパフォーマンスを改善するために重要です。

オープンソースのSpatiallmとSpatialverseを通じて、CNKはロボットトレーニングの未来を再構築し、現実の世界で課題に柔軟に対応できるようにしています。この技術の広範なアプリケーションは、ロボット工学技術のさらなる開発を促進するだけでなく、人間の生活により多くの利便性をもたらします。

プロジェクトアドレス:https://top.aibase.com/tool/spatiallm