AI 시각적 대상 포지셔닝 기술은 항상 정확도 병목 현상에 직면 해 있습니다. 일리노이 테크, Cisco Research Institute 및 Central Florida University의 연구원들은이 문제를 해결하고 AI에게 "고화질 비전"을 제공하기위한 SEGVG 프레임 워크를 개발했습니다. SEGVG의 핵심은 픽셀 레벨 디테일 처리이며, AI 용 "고 정의 안경"을 착용하는 것과 같이 경계 박스 정보를 세분화 신호로 변환하여 대상의 모든 픽셀을 명확하게 식별 할 수 있습니다.

AI Vision 분야에서 대상 포지셔닝은 항상 어려운 문제였습니다. 전통적인 알고리즘은 "근시"와 비슷하며 "프레임"으로 대상을 대략적으로 동그라 할 수 있지만 내부에서는 세부 사항을 볼 수 없습니다. 친구에게 사람을 묘사하고 자신의 대략적인 높이와 체형에 대해 이야기 할 때 친구가 사람을 찾으면 이상합니다!

이 문제를 해결하기 위해 일리노이 기술 대학교 (Illinois University of Technology)의 Bigwigs, Cisco Research Institute와 Central Florida University는 SEGVG라는 새로운 시각적 포지셔닝 프레임 워크를 개발하여 AI가 "근시"에 작별 인사를 할 수 있다고 주장했습니다!

SEGVG의 핵심 비밀은 다음과 같습니다. "Pixel-Level"세부 사항은 AI에 AI에 모호한 그림자를 제공하는 것과 같습니다. SEGVG는 경계 박스 정보를 세분화 신호로 변환하는데, 이는 AI에 "고화질 안경"을 넣는 것과 동일하며 AI는 대상의 모든 픽셀을 명확하게 볼 수있게합니다!

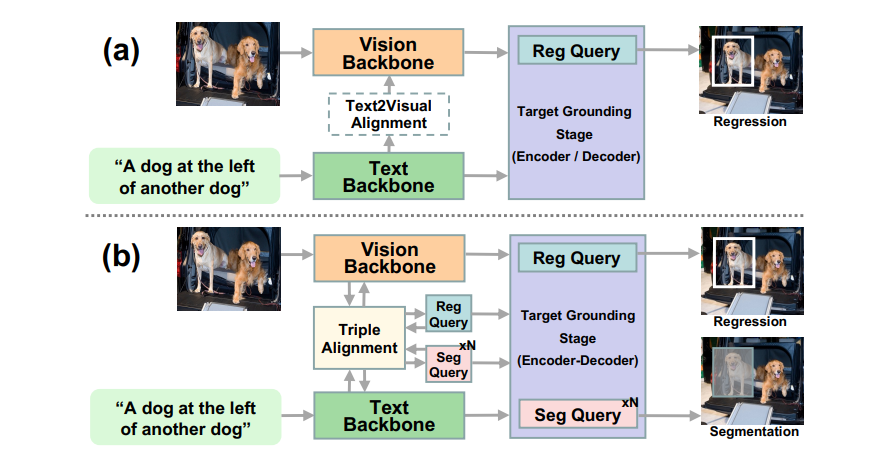

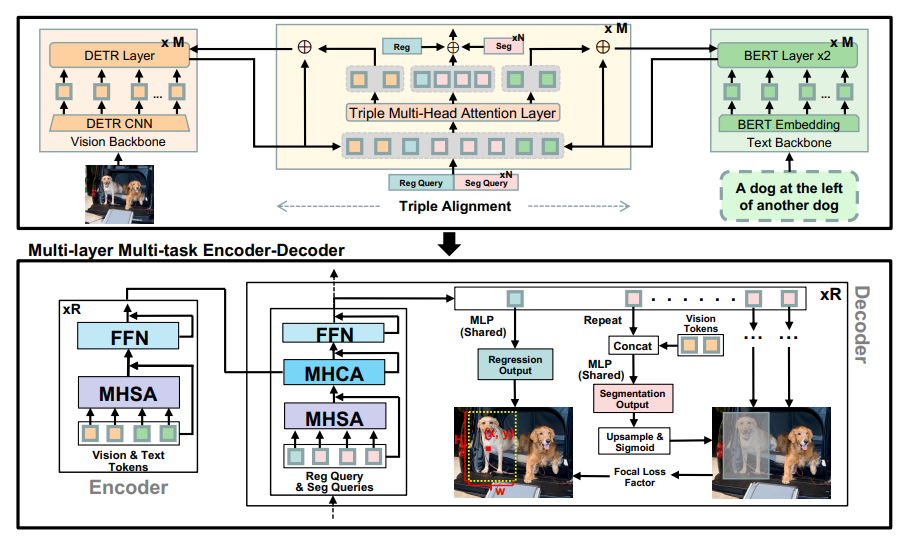

구체적으로, SEGVG는 "다층 멀티 태스킹 인코더-디코더"를 채택합니다. 이 이름은 복잡하게 들리지만 실제로 회귀를위한 쿼리를 포함하는 초 충전 "현미경"으로 이해하고 세분화를위한 여러 쿼리로 이해할 수 있습니다. 간단히 말해서, 다른 "렌즈"를 사용하여 경계 박스 회귀 및 세분화 작업을 수행하고 대상을 반복적으로 관찰하며보다 세련된 정보를 추출하는 것입니다.

더 놀라운 점은 SEGVG가 "Ternal Alignment Module"을 도입했다는 것입니다. 이는 AI에 모델 사전 훈련 매개 변수와 Query Embedding 사이의 "언어 막힘"문제를 구체적으로 해결하기 위해 "번역기"를 장착하는 것과 같습니다. 3 배의주의 메커니즘을 통해이 "번역기"는 쿼리, 텍스트 및 시각적 기능을 동일한 채널로 "번역"할 수 있으므로 AI는 대상 정보를 더 잘 이해할 수 있습니다.

SEGVG의 효과는 일반적으로 사용되는 5 개의 데이터 세트에 대한 실험을 수행했으며, SEGVG의 성능은 특히 DataSet의 두 가지 유명한 "어려움"에서 많은 전통적인 알고리즘을 이겼습니다. 획기적인 결과를 얻었습니다!

SEGVG는 정확한 포지셔닝 외에도 모델에 의해 예측 된 신뢰 점수를 출력 할 수 있습니다. 간단히 말해서, AI는 자신을 판단하는 것이 얼마나 자신감인지 알려줄 것입니다. 예를 들어 AI를 사용하여 의료 이미지를 식별하려면 AI의 신뢰가 높지 않으면 오진을 피하기 위해 수동 검토가 필요합니다.

SEGVG의 오픈 소스는 AI Vision의 전체 분야에 큰 이점이 있습니다!

종이 주소 : https://arxiv.org/pdf/2407.03200

코드 링크 : https://github.com/weitaikang/segvg/tree/main

SEGVG의 출현은 AI 시각적 대상 포지셔닝 기술과 오픈 소스 특성이 많은 분야에 혁신을 가져올 것이며 향후 적용 및 개발을 기대할 가치가 있습니다.