rc cnn dailymail

1.0.0

논문 코드 :

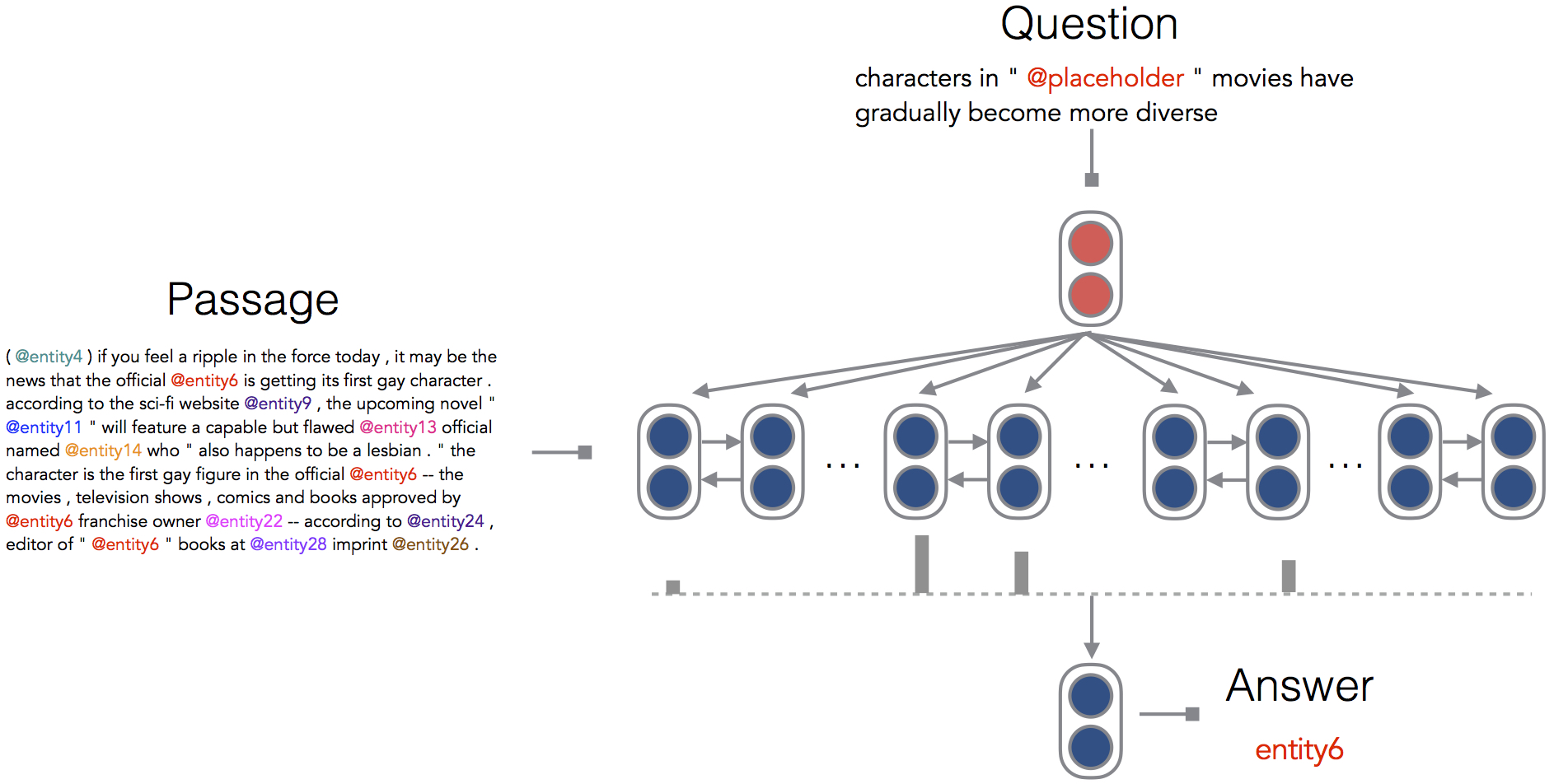

CNN/Daily Mail Reading 이해 작업에 대한 철저한 조사.

두 개의 처리 된 RC 데이터 세트 :

원래 데이터 세트는 https://github.com/deepmind/rc-data 또는 http://cs.nyu.edu/~kcho/dmqa/에서 다운로드 할 수 있습니다. 우리의 처리 된 것은 단순히 모든 데이터 인스턴스를 연결하고 입력에 대해서만 문서, 질문 및 답변을 유지합니다.

단어 임베딩 :

THEANO_FLAGS=mode=FAST_RUN,device=gpu,floatX=float32

python main.py --train_file /u/nlp/data/deepmind-qa/cnn/train.txt

--dev_file /u/nlp/data/deepmind-qa/cnn/dev.txt

--embedding_file /u/nlp/data/deepmind-qa/word-embeddings/glove.6B.100d.txt

relabeling : 기본값은 사실입니다.hidden_size : 기본값은 128입니다.bidir : 기본값은 사실입니다.num_layers : 기본값은 1입니다.rnn_type : 기본값은 "Gru"입니다.att_func : 기본값은 "bilinear"입니다.batch_size : 기본값은 32입니다.num_epoches : 기본값은 100입니다.eval_iter : 기본값은 100입니다.dropout_rate : 기본값은 0.2입니다.optimizer : 기본값은 "SGD"입니다.learning_rate : 기본값은 0.1입니다.grad_clipping : 기본값은 10입니다. @inproceedings{chen2016thorough,

title={A Thorough Examination of the CNN/Daily Mail Reading Comprehension Task},

author={Chen, Danqi and Bolton, Jason and Manning, Christopher D.},

booktitle={Association for Computational Linguistics (ACL)},

year={2016}

}

MIT