Magic CLI는 LLM을 사용하여 Amazon Q (Prev. 그림 터미널) 및 CLI 용 Github Copilot과 같은 프로젝트에서 영감을 얻은 명령 줄을보다 효율적으로 사용하는 데 도움이되는 명령 줄 유틸리티입니다.

magic-cli LLM 상호 작용 (실행, 오케스트레이션, 모델 정렬 등)을위한 오케이 라이브러리에 의존합니다.

공지 블로그 게시물을 읽으십시오.

주의

이 프로젝트는 여전히 초기 개발 중입니다.

변경 및 버그를 깨뜨릴 것으로 예상하고 발생하는 문제를보고하십시오.

감사합니다!

메모

Magic CLI를 설치하는 방법에 대한 자세한 옵션은 설치하려는 버전의 릴리스 페이지를 참조하십시오.

curl -LsSf https://github.com/guywaldman/magic-cli/releases/download/0.0.6/magic-cli-installer.sh | shbrew install guywaldman/tap/magic-clipowershell - c " irm https://github.com/guywaldman/magic-cli/releases/download/0.0.6/magic-cli-installer.ps1 | iex "플랫폼의 바이너리에 대한 릴리스 페이지를 참조하십시오.

~/.bashrc 또는 ~/.zshrc 에 함수를 추가하여 터미널의 프롬프트를 더 쉽게 포맷 할 수 있도록합니다 (따옴표가 필요하지 않음).

예를 들어:

function mcs {

model_prompt= " $* "

magic-cli suggest " $model_prompt "

}

function mcf {

model_prompt= " $* "

magic-cli search " $model_prompt "

}

function mca {

model_prompt= " $* "

magic-cli ask " $model_prompt "

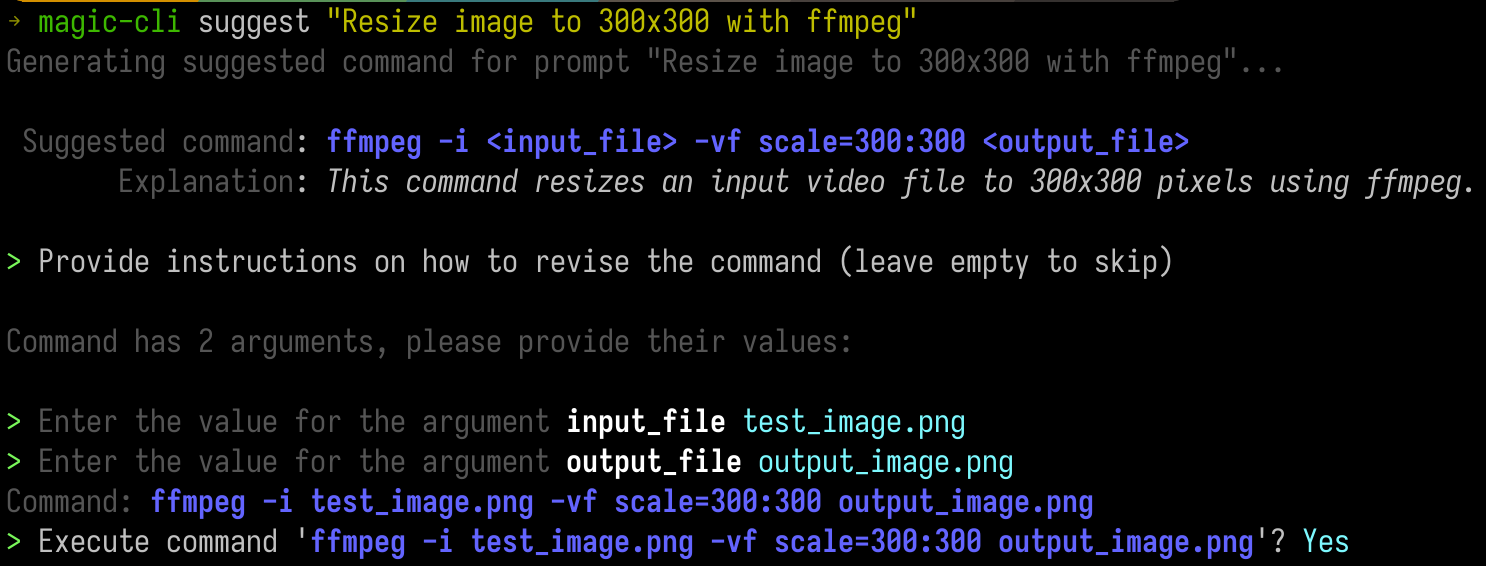

} 명령을 실행하도록 제안을 받으려면 프롬프트를 제공하십시오.

이것은 당신이 원하는 것을 대략 알고 (그리고 아마도 도구)를 알고 있지만 정확한 주장이나 순서를 기억하지 않는 시나리오에 유용합니다.

이것은 ffmpeg 또는 kubectl 과 같은 CLI 도구에 특히 유용합니다.

magic-cli suggest " Resize test_image.png to 300x300 with ffmpeg " Usage: magic-cli suggest <PROMPT>

Arguments:

<PROMPT> The prompt to suggest a command for (e.g., "Resize image to 300x300 with ffmpeg")

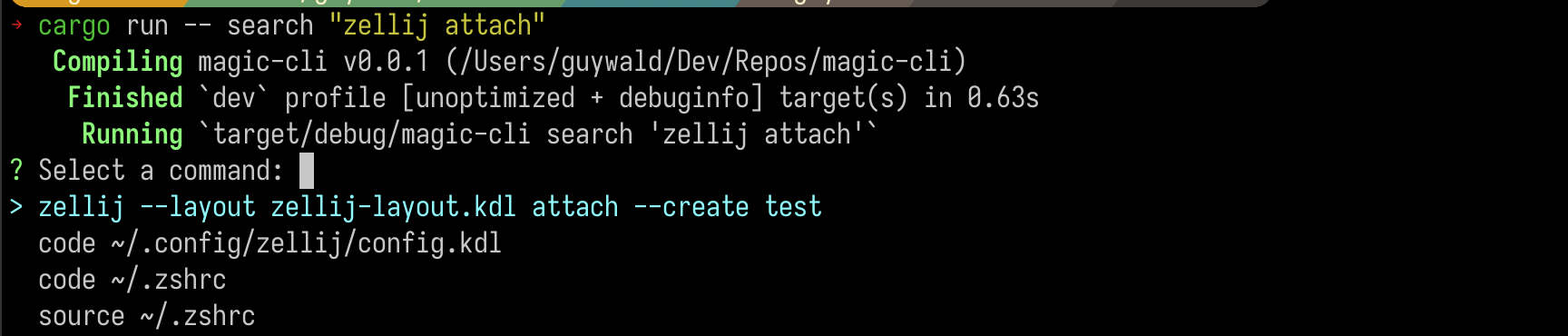

쉘 기록에서 명령을 검색하고 상단 결과 목록을 얻으십시오.

magic-cli search " zellij attach " Usage: magic-cli search [OPTIONS] <PROMPT>

Arguments:

<PROMPT> The prompt to search for

중요한

현명한 말 : 비 국소 LLM을 사용하는 경우, 특히 긴 쉘 역사의 경우 임베딩 비용에 대해 조심하십시오.

모델이 수행하려는 작업과 함께 프롬프트를 제공하고 목표를 달성하기 위해 실행하도록 명령을 제안하려고합니다. 더 많은 컨텍스트가 필요한 경우 명령을 실행하는 길을 따라 가면됩니다.

magic-cli ask " Set up the dev environment as described in the README " Usage: magic-cli ask <PROMPT>

Arguments:

<PROMPT> The prompt to ask for (e.g., "Set up the development environment")

Magic CLI는 두 LLM 제공 업체를 지원합니다.

ollama : Ollama는 지역 LLM 제공 업체입니다. 이 명령은 Ollama가 로컬 컴퓨터에 설치 및 실행할 것으로 기대합니다.openai : OpenAi는 Cloud LLM 제공 업체입니다. API 토큰을 구성하고 Magic Cli는 OpenAI API와 함께 사용합니다. Magic Cli는 ~/.config/magic_cli/config.json 의 구성을 저장합니다.

magic-cli config 사용하여 (옵션을 확인하고, magic-cli config --help 사용하여) 구성 옵션을 설정하십시오.

Usage: magic-cli config <COMMAND>

Commands:

set Set a value

get Get a value

list List the configurations

reset Reset the configurations to the default values

path Get the path to the configuration file

현재 공급 된 구성 옵션은 다음과 같습니다.

llm : 응답 생성에 사용할 LLM. 지원되는 가치 : "Ollama", "Openai"ollama.base_url : Ollama API의 기본 URL (기본값 : "http : // localhost : 11434")ollama.embedding_model : 임베딩 생성에 사용할 모델 (기본값 : "nomic-embed-text : little")ollama.model : 응답 생성에 사용할 모델 (기본값 : "Codestral : 최신")openai.api_key (Secret) : OpenAI API의 API 키openai.embedding_model : 임베딩 생성에 사용할 모델 (기본값 : "Text-embedding-ADA-002")openai.model : 응답 생성에 사용할 모델 (기본값 : "GPT-4O")suggest.add_to_history : 제안 된 명령을 쉘 기록에 추가할지 여부 (기본값 : False)suggest.mode : 제안 명령에 사용하는 모드. 지원되는 값 : "Clipboard"(클립 보드에 복사 명령), "안전하지 않은 실행"(현재 쉘 세션에서 실행) (기본값 : "안전하지 않은 실행")참고 :

unsafe-executionCLI가 현재 쉘 세션에서 명령을 실행한다는 것을 분명히하기 위해 이름을 따서 명명되었습니다. 이 모드를 사용할 때 매우 조심하십시오 - Magic CLI는 제안 된 명령 실행에 대한 책임이 없습니다.

Windows 지원 (PowerShell은 지원되지만 Windows는 제대로 테스트되지 않았습니다)

더 많은 LLM 제공 업체 지원 (예 : 인류)

로컬 임베딩 인덱스 향상 (현재 JSON으로 순진하게 저장되어 벡터 확장으로 Sqllite를 살펴 보았습니다)

더 많은 테스트 범위

보안은 진지하게 받아 들여지고 모든 취약점은 최대한의 관리와 우선 순위로 처리됩니다.

저장된 데이터의 관점에서, 현재 Magic CLI가 처리하는 민감한 데이터는 다음과 같습니다.

~/.config/magic_cli ) 내의 구성에 저장됩니다.이 토큰을 시스템의 안전한 키 저장소에 저장할 계획이 있지만 아직 구현되지 않았습니다.

~/.config/magic_cli ) 내의 구성에 저장된 magic-cli search 명령에 대한 쉘 기록의 임베딩은 LLM 선택한 공급자를 사용하여 생성됩니다.자세한 내용은 Security.md를 참조하고 잠재적 인 취약점을보고하는 방법에 대한 지침을 참조하십시오.

기부금을 환영합니다!

자세한 내용은 Contributing.md를 참조하십시오.

내 유일한 요청은 풀 요청이 문제를 따르는 것입니다. 따라서 맥락이나 필요성이 부족하여 귀하의 노력이 받아 들여지지 않는 상황을 피합니다.