Bytedanceは最近、最新のAibrix Reasoning Systemのオープンソースを発表しました。これは、人工知能の分野でのさらなるブレークスルーを示す動きです。 AIBRIXシステムは、VLLM推論エンジン向けに設計されており、企業にスケーラブルで費用対効果の高い推論制御対照を提供し、増加するAIニーズを満たしています。このシステムの立ち上げは、AIテクノロジーにおけるBytedanceの深い蓄積を実証するだけでなく、企業により効率的なAIソリューションを提供します。

AIBRIXの発売は、AI推論インフラストラクチャの新しい開発段階を示しています。プロジェクトチームは、このオープンソースプロジェクトを通じてスケーラブルな推論インフラストラクチャを構築するための強固な基盤を築くことを望んでいます。このシステムは、大規模な言語モデルの展開、管理、およびスケーリング機能の最適化に専念するCloud-Nativeソリューションの完全なセットを提供します。特に、ユーザーがより効率的なサービスを使用するときに、より効率的なサービスを享受できるようにするために、エンタープライズレベルのニーズを深く適応させます。このイノベーションは、AIモデルの運用効率を改善するだけでなく、企業により柔軟なAIアプリケーションシナリオを提供します。

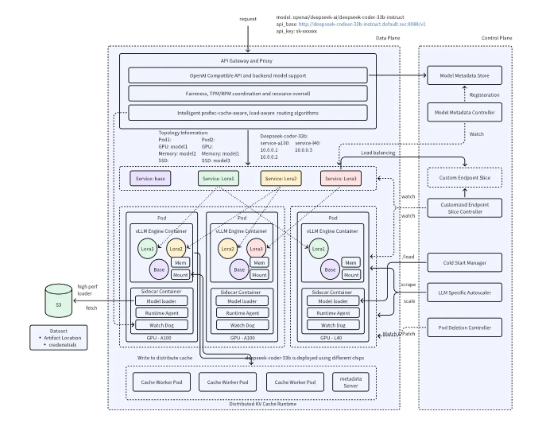

機能の観点から、AIBRIXの最初のバージョンは、いくつかのコア機能に焦点を当てています。 1つ目は、高密度のLORA(低ランク適応)管理です。これは、軽量モデルの適応サポートを簡素化するように設計された機能であり、ユーザーがモデルをより簡単に管理できるようにします。第二に、AIBRIXは、トラフィックを複数のモデルとレプリカに効率的に管理および割り当てるLLMゲートウェイとルーティング機能を提供し、リクエストがターゲットモデルに迅速かつ正確に到達できるようにします。さらに、LLMアプリケーション用の自動エクステンダーは、リアルタイムの要件に応じて推論リソースを動的に調整し、システムの柔軟性と応答速度を改善することもできます。これらの関数の組み合わせにより、AIRはAI推論の分野で大きな利点があります。

BytedanceのAibrixチームは、分散型KVキャッシュを拡張し、従来のリソース管理の原則を導入し、パフォーマンス分析に基づいてコンピューティング効率を改善することにより、システムの進化と最適化を引き続き促進する予定であると述べました。この一連の技術革新は、AIBRIXのパフォーマンスをさらに向上させるだけでなく、AIアプリケーションにより多くの可能性を企業に提供します。将来的には、AIBRIXはAI推論の分野で重要なツールになると予想され、AIテクノロジーの広範なアプリケーションと普及を促進します。