ビデオ生成テクノロジーは近年大きな進歩を遂げていますが、既存のモデルには、複雑な動きと物理現象のキャプチャに依然として制限があります。メタの研究チームは、共同外観モーション表現を通じてビデオ生成モデルの動きの表現性を高めることを目指して、VideoJamフレームワークを提案しました。

ビデオ生成の分野では、近年の大きな進歩にもかかわらず、既存の生成モデルは、現実に複雑な動き、動的、物理現象を捉えるのに苦労しています。この制限は、主に従来のピクセル再構成の目的から生じます。これは、外観のリアリズムを改善し、動きの一貫性を無視する傾向があります。

この問題に対処するために、Metaの研究チームはVideoJamと呼ばれる新しいフレームワークを提案しました。これは、モデルが共同外観モーション表現を学習することを奨励することにより、効果的な動きをビデオ生成モデルに注入することを目的としています。

VideoJamフレームワークには、2つの補完的なユニットが含まれています。トレーニング段階では、フレームワークが目標を拡張して、生成されたピクセルと対応する動きの両方を、両方とも単一の学習表現から予測します。

推論段階で、研究チームは、モデル自身の進化するモーション予測を動的ガイダンス信号として利用することにより、生成プロセスを一貫した動き方向に向けて導く「本質的なガイダンス」と呼ばれるメカニズムを導入しました。トレーニングデータを変更したり、モデルを拡張したりせずに、VideoJamを任意のビデオ生成モデルに適用できることに注意してください。

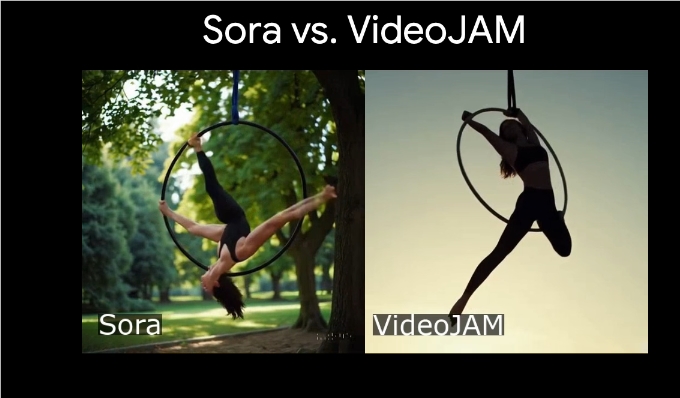

VideoJamは、動きの一貫性における業界をリードするレベルであることが証明されており、複数の非常に競争力のある独自モデルを上回り、生成された画像の視覚的品質を向上させています。この研究は、外観と動きの間の補完的な関係を強調しており、2つが効果的に組み合わされたときに、ビデオ生成の視覚効果と動きの一貫性を大幅に改善できます。

さらに、研究チームは、スケートボーダーがジャンプしたり、湖で回転するバレエダンサーなどのシーンなど、複雑なスポーツタイプの生成においてVideoJam-30Bの優れたパフォーマンスを実証しました。 BibaseモデルDIT-30Bを比較することにより、この研究では、VideoJamがモーション生成の品質を大幅に改善したことがわかりました。

プロジェクトの入り口:https://hila-chefer.github.io/videojam-paper.github.io/

キーポイント:

VideoJamフレームワークは、共同外観モーション表現を通じてビデオ生成モデルの動きの表現性を高めます。

トレーニング中、VideoJamはピクセルとモーションを同時に予測し、生成されたコンテンツの一貫性を高めることができます。

VideoJamは、動きの一貫性と視覚品質の両方で複数の競争モデルを上回ることが証明されています。

MetaのVideoJamフレームワークは、ビデオ生成の表現を組み合わせて、ビデオ生成の一貫性と視覚的品質を大幅に改善し、ビデオ生成テクノロジーの将来の開発のための新しい方向性を提供しました。