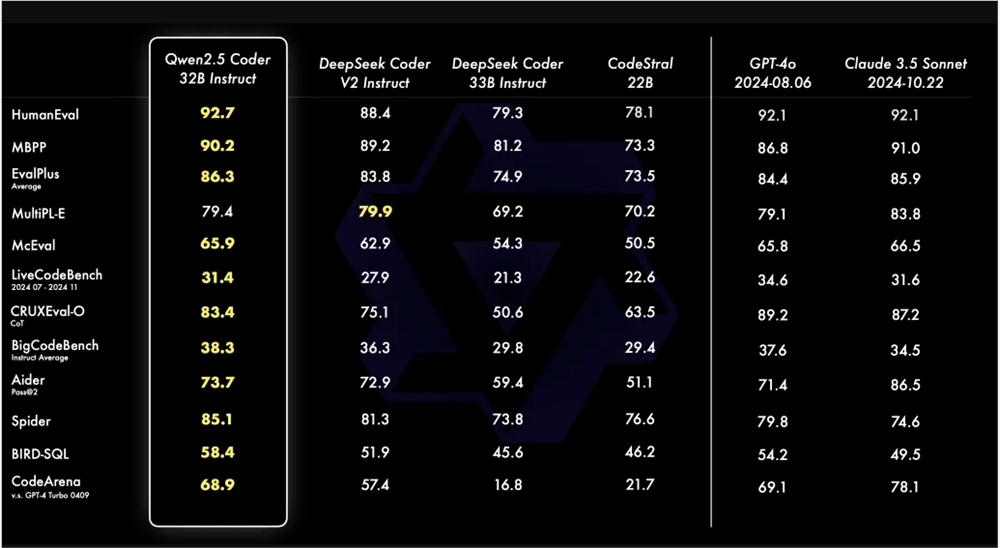

Tongyi Qianwenチームは、4つのサイズのモデルを含む最新のコードモデルQWEN2.5-CODERシリーズのSourcedを開設しました:0.5B/3B/14B/32B、および2つのバージョンのベースと指示。この動きは、オープンソースコードモデルの開発を促進し、開発者により多くの選択肢を提供することを目的としています。 QWEN2.5-Coder-32B-Instructモデルは、コード生成、修理、推論で優れたパフォーマンスを発揮し、特にHaskellやRacketなどのプログラミング言語では、GPT-4oに匹敵する複数のベンチマークでSOTAレベルに達しました。 。このモデルは、内部コード選好評価ベンチマークコードアリーナによってもテストされています。これは、人間の好みの調整における利点を証明しています。

QWEN2.5-Coderは40を超えるプログラミング言語をサポートし、McEvalで65.9ポイントを獲得し、MDEVALベンチマークで75.2スコア75.2をスコアリングし、最初にランキングします。トレーニング前の段階での独自のデータクリーニングとプロポーションは、その優れたパフォーマンスの重要な要因の1つです。 0.5B/1.5B/7B/14B/32BモデルはApache2.0によってライセンスされており、3Bモデルは研究のみによってライセンスされています。チームは、異なるサイズモデルのパフォーマンスを評価することにより、コードLLMSに対するスケーリングの有効性を確認しました。 QWEN2.5コーダーのオープンソースは、間違いなくプログラミング言語モデルテクノロジーの開発と適用を促進します。

今回のQWEN2.5-CODERシリーズのオープンソースは、開発者に強力で使いやすいプログラミングモデルの選択を提供し、オープンソースコミュニティの開発をさらに促進します。さまざまなサイズのモデルがさまざまなニーズを満たし、ベースと指示バージョンはそれぞれモデルの微調整と直接アプリケーションを提供します。モデルリンクが提供されており、開発者はそれをダウンロードして使用し、オープンソースコミュニティに貢献できます。

QWEN2.5-CODERモデルリンク:https://modelscope.cn/collections/qwen25-coder-9d375446e8f5814a