Hedra Labs a récemment publié une version préliminaire de recherche de Character-1, un incroyable outil de génération de vidéo IA. Il peut générer des vidéos dynamiques réalistes basées sur des photos et du contenu vocal fournis par les utilisateurs, donnant vie aux personnages des photos, parlant ou chantant, et la forme de leurs lèvres, leurs expressions et leurs gestes sont parfaitement synchronisés avec la voix. Cette technologie révolutionne les méthodes de production vidéo traditionnelles et offre des possibilités infinies à la création de contenu. Son fonctionnement pratique et sa sortie de haute qualité offrent aux utilisateurs une expérience sans précédent.

Récemment, Hedra Labs a lancé une version préliminaire de recherche de Character-1, une technologie qui permet aux utilisateurs de générer des vidéos dynamiques d'individus parlant et chantant, à partir de photos et du contenu vocal de n'importe quelle personne.

Imaginez que vous téléchargez une photo d'une personne et ajoutez n'importe quel contenu vocal, et qu'une vidéo dynamique puisse être générée en un instant, donnant l'impression que la personne sur la photo prend vie, commence à parler ou à chanter, ainsi que la forme des lèvres, l'expression, et la posture sont toutes cohérentes avec le contenu vocal qui correspond parfaitement. Êtes-vous un peu excité ?

Vidéo de démonstration officielle de Hedra Labs

Principales caractéristiques et points forts fonctionnels :

Compatibilité multiplateforme : les utilisateurs peuvent facilement utiliser Character-1 sur les appareils de bureau et mobiles.

Génération de durée illimitée : la version d'aperçu ouverte actuelle prend en charge la génération vidéo de 30 secondes. Si le H100 est en quantité suffisante, 90 secondes de contenu peuvent être générées toutes les 60 secondes.

Prend en charge plusieurs formes d'expression : Character-1 prend non seulement en charge le dialogue, mais peut également gérer des formes d'expression telles que le chant et le rap.

Hedra fournit une interface conviviale afin que même les non-experts puissent démarrer rapidement. Les utilisateurs peuvent visiter le site officiel de Hedra, utiliser la fonction de synthèse vocale ou télécharger directement des fichiers audio, saisir une description de personnage, puis générer une vidéo dynamique.

La technologie d'IA de Hedra garantit la haute qualité et la fidélité du contenu vidéo, qu'il s'agisse de l'expression, de la posture ou de la synchronisation vocale du personnage, elle peut obtenir des résultats satisfaisants.

À en juger par les cas officiels, Character-1 peut parfaitement jouer des rôles de chant, d'acteur et d'expression avec différentes émotions. La technologie ne se limite pas aux personnages humains, mais peut même générer des objets inanimés expressifs, à condition qu’ils présentent des traits faciaux distincts.

La méthode d'utilisation est également très simple, les étapes spécifiques sont les suivantes :

Adresse de l'expérience Open Hedra : https://top.aibase.com/tool/hedra

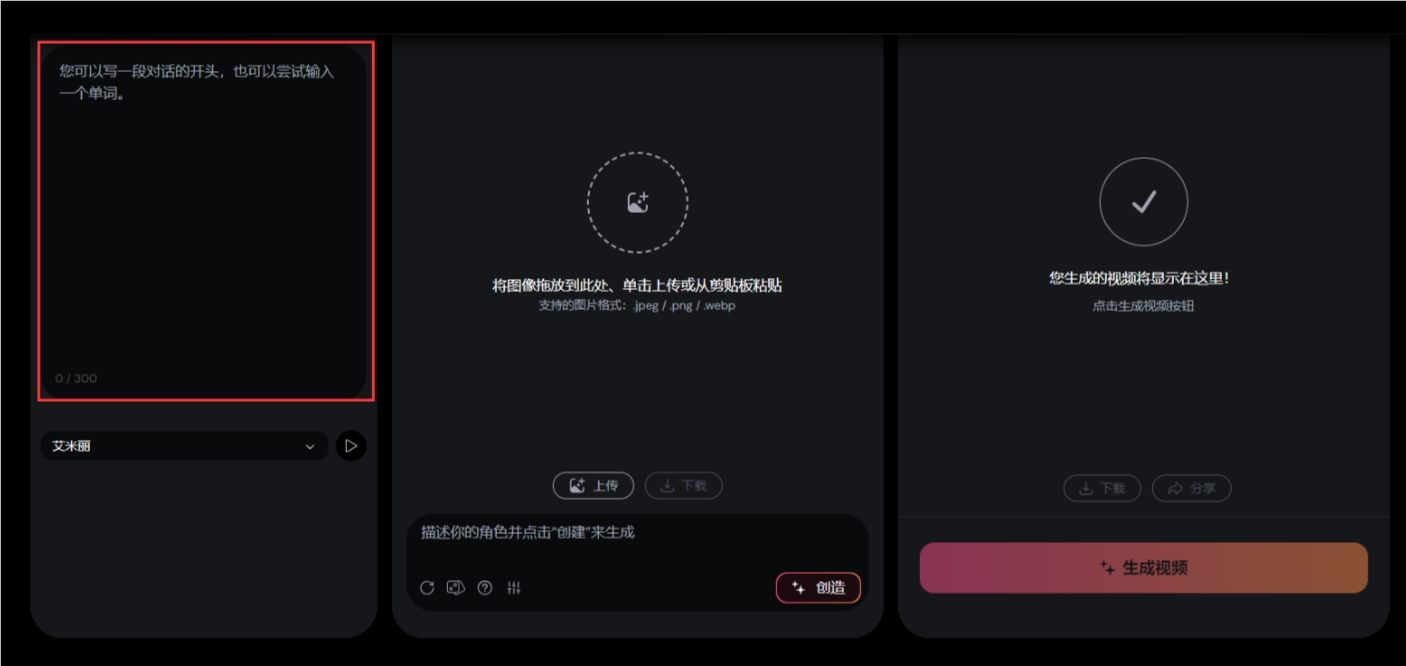

Après être entré dans la page, vous pouvez voir cette interface d'opération

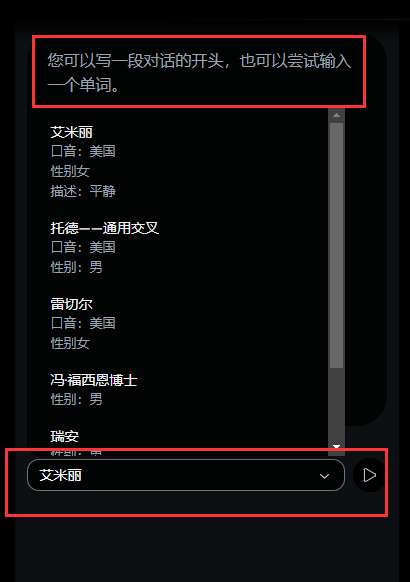

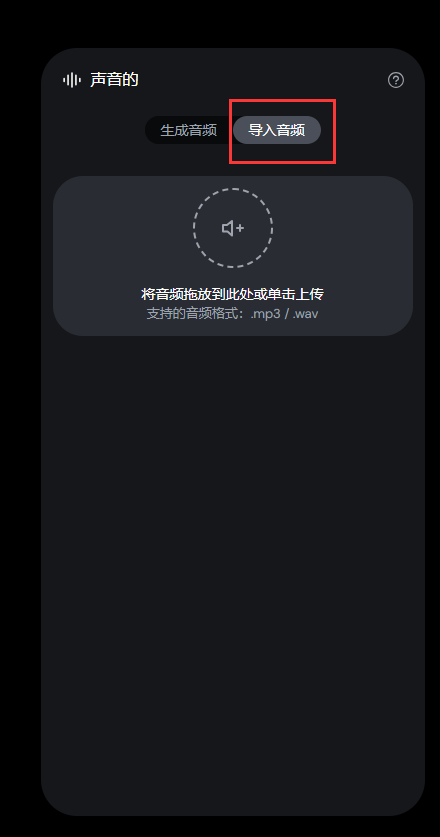

L'interface est très simple. Dans la première case, entrez les lignes de votre personnage et sélectionnez une voix. Bien sûr, si vous ne souhaitez pas utiliser l'audio généré, vous pouvez également importer votre propre audio.

Ici, je tape simplement "Bonjour, ceci est une vidéo parlante créée par AIbase. Aujourd'hui, je vais vous montrer Hedra, qui rend la génération de vidéo aussi simple que respirer."

Téléchargez ensuite la photo dont je veux parler dans la deuxième case, et téléchargez ici une photo d'une belle femme que j'ai prise auparavant.

Si vous n'avez pas d'image prête à l'emploi, vous pouvez saisir directement votre personnage dans la zone de texte ci-dessous et cliquer sur Créer pour la générer.

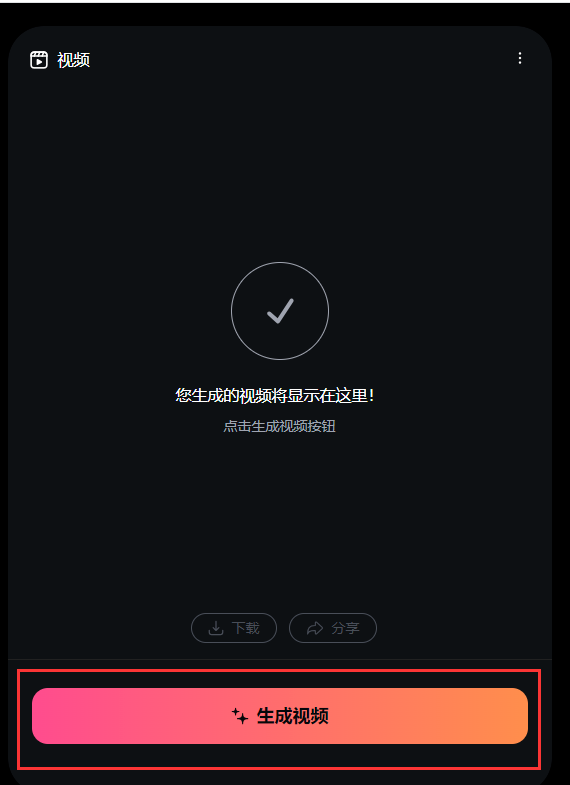

Une fois l'image téléchargée, cliquez sur Générer une vidéo sous la troisième case.

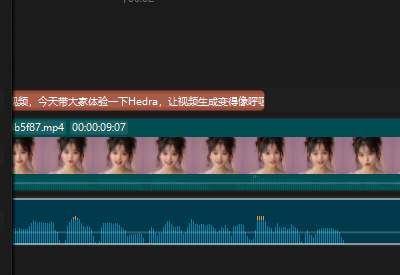

Voici l'effet vidéo obtenu :

On peut voir que dans la vidéo parlante générée par Hedra, les personnages sont relativement agiles. Non seulement la bouche bouge, mais d'autres parties du corps bougent également, et il y a aussi des expressions. Cependant, comme la plateforme propose très peu de voix, l'accent de l'étranger ne correspond pas très bien au personnage de ma photo. Un autre inconvénient est que la vidéo générée est beaucoup plus floue que ma photo originale. J'espère que la plateforme améliorera l'image. dans le futur.

Ici, j'ai moi-même téléchargé un audio. J'ai généré l'audio directement à l'aide d'un clipping, j'ai sélectionné la voix d'une fille, j'ai directement saisi le texte puis je l'ai lu à haute voix.

Essayez à nouveau :

Sélectionnez importer l'audio

L'effet généré est le suivant :

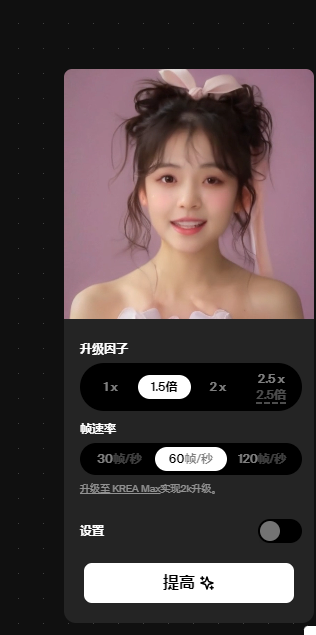

Ensuite, le problème de flou peut être résolu à l'aide de la fonction d'amélioration vidéo de krea ai. Cependant, veuillez noter que pour un essai gratuit, la durée de la vidéo ne peut pas dépasser 10 secondes. Si elle dépasse, vous ne pouvez la recadrer que vous-même. Et ne choisissez pas une fréquence d'images trop élevée. J'ai choisi 60 images par seconde. À mi-chemin, j'ai dû payer pour la mise à niveau et je me suis évanoui dans les toilettes à force de pleurer.

Dans l'ensemble, Character-1 montre le grand potentiel de la technologie de l'IA dans le domaine de la génération vidéo. Même si certaines lacunes subsistent, ses perspectives de développement futur méritent d'être attendues. Je pense qu'à mesure que la technologie continue de s'améliorer, Character-1 nous apportera plus de surprises.