Bahri Batuhan Bilecen, Yigit Yalin, Ning Yu et Aysegul Dundar

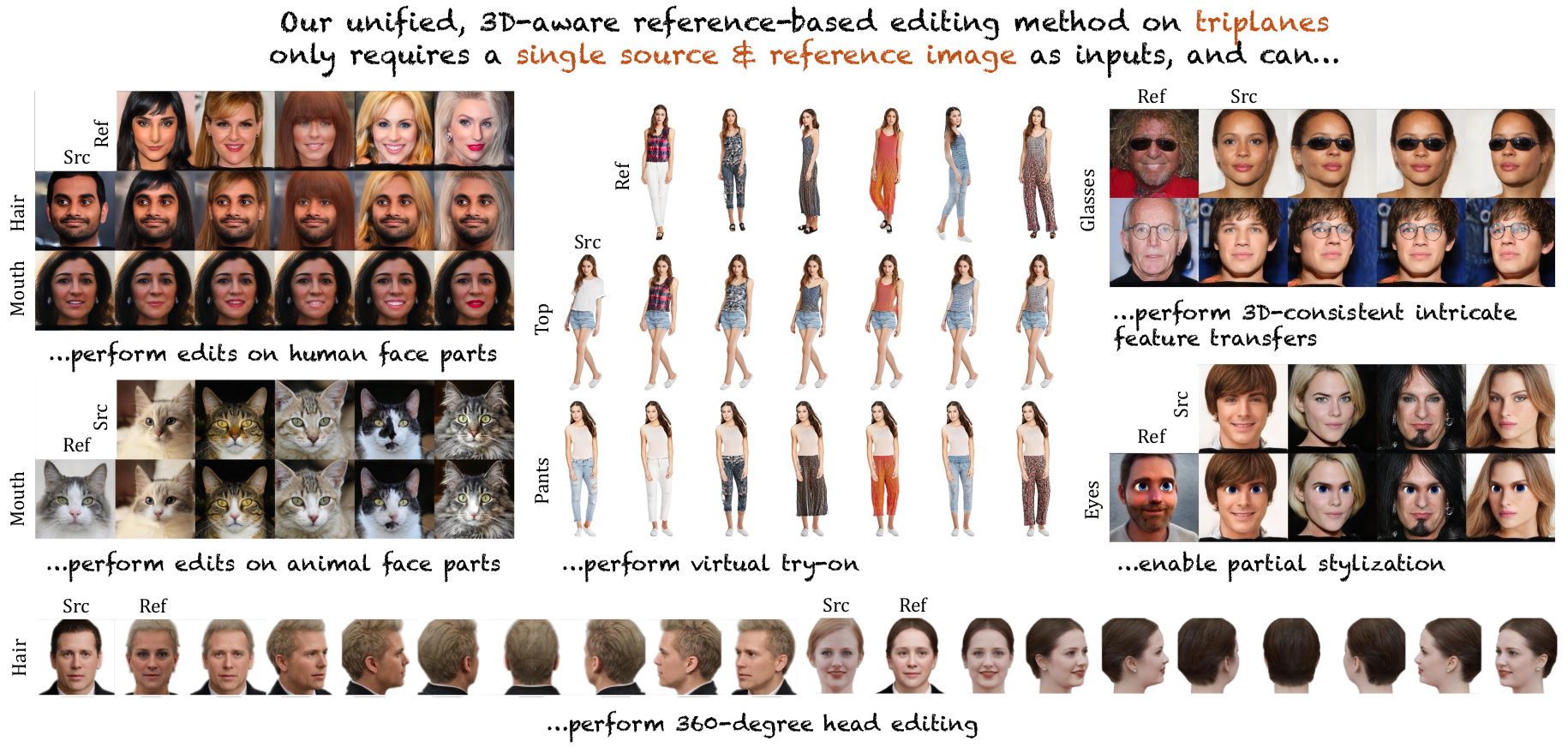

Les réseaux adversaires génératifs (GAN) sont devenus des outils puissants pour la génération d'images de haute qualité et l'édition réelle d'images en manipulant leurs espaces latents. Les avancées récentes dans GANS comprennent des modèles de 3D tels que EG3D, qui présentent des architectures efficaces basées sur des triplanes capables de reconstruire la géométrie 3D à partir d'images uniques. Cependant, une attention limitée a été accordée à la fourniture d'un cadre intégré pour l'édition d'image basée sur les références de haute qualité et de haute qualité. Cette étude comble cette lacune en explorant et en démontrant l'efficacité de l'espace triplane pour les modifications avancées basées sur les références. Notre nouvelle approche intègre le codage, la localisation automatique, le démontage spatial des caractéristiques triplane et l'apprentissage de la fusion pour réaliser les modifications souhaitées. De plus, notre cadre démontre la polyvalence et la robustesse dans divers domaines, prolongeant son efficacité aux modifications du visage animal, des modifications partiellement stylisées comme les faces de dessin animé, les modifications des vêtements complètes et les modifications de tête à 360 degrés. Notre méthode montre des performances de pointe sur la direction latente, le texte et les méthodes de diffusion 2D et 3D 2D et 3D, guidés par l'image, à la fois qualitativement et quantitativement.

git clone --recursive https://github.com/three-bee/triplane_edit.gitcd ./triplane_edit && pip install -r requirements.txt Nous suivons la préparation de l'ensemble de données d'EG3D pour l'extraction de la pose et l'alignement du visage. Assurez-vous de ne pas ignorer la configuration de Deep3dfaceCeCon_pytorch. Ensuite, exécutez le code de prétraitement dans le monde:

cd ./dataset_preprocessing/ffhq

python preprocess_in_the_wild.py --indir=YOUR_INPUT_IMAGE_FOLDER

Cela générera des images alignées et un dataset.json contenant des matrices de caméra dans YOUR_INPUT_IMAGE_FOLDER/preprocessed/ .

Nous avons inclus des exemples d'images et de poses dans ./example/ .

Mettez tous les fichiers téléchargés dans ./checkpoints/ .

| Réseau | Nom de fichier |

|---|---|

| Générateur rééquilibré EG3D | ffhqrebalanced512-128.pkl |

| Encodeurs EG3D-GOAE | encoder_FFHQ.pt & afa_FFHQ.pt |

| Encodeur de fusion à finet | encoder_FFHQ_finetuned.pt |

| Segmentation du biset | 79999_iter.pth |

| IR-SE50 pour la perte d'identification | model_ir_se50.pth |

Exécutez demo.ipynb pour divers exemples d'édition.

Notre base de code utilise les grandes œuvres suivantes: EG3D, EG3D-GOAE, TRIPLANENETV2, BiseNet et Deep3dfaceCon_pytorch. Nous remercions les auteurs de les avoir fournis.

@misc{bilecen2024referencebased,

title={Reference-Based 3D-Aware Image Editing with Triplanes},

author={Bahri Batuhan Bilecen and Yigit Yalin and Ning Yu and Aysegul Dundar},

year={2024},

eprint={2404.03632},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

Copyright 2024 Bilkent DLR. Licencié sous la licence Apache, version 2.0 (la "licence").