Une API assistant intelligente AI à l'emploi

Anglais | 简体中文 | 日本語

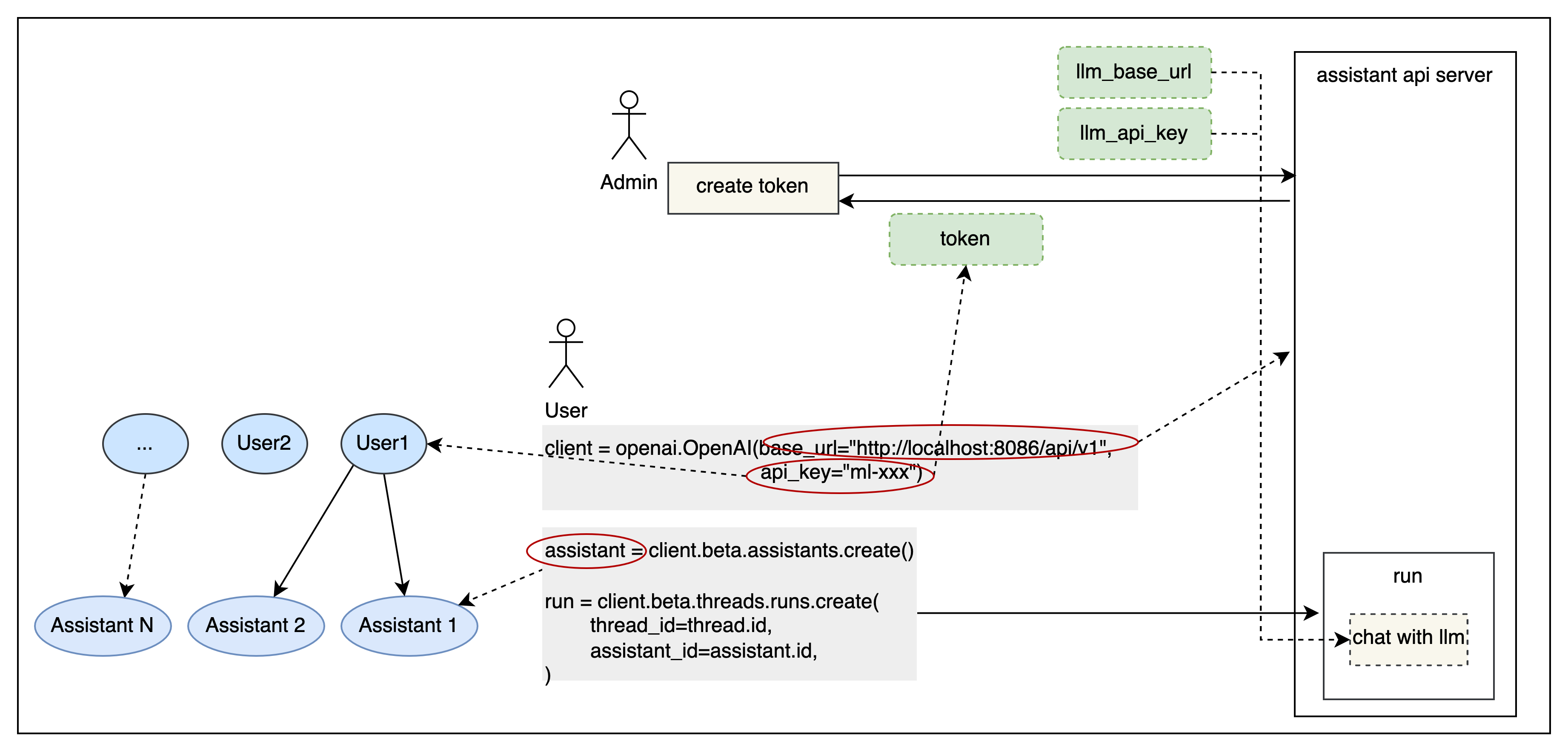

L'API adjointe ouverte est une API adjointe AI auto-hébergée et auto-hébergée, compatible avec l'interface OpenAI officielle. Il peut être utilisé directement avec le client OpenAI officiel pour créer des applications LLM.

Il prend en charge une API pour l'intégration avec des modèles plus commerciaux et privés.

Il prend en charge le moteur de chiffon R2R。

Vous trouverez ci-dessous un exemple d'utilisation de la bibliothèque officielle Openai Python openai :

import openai

client = openai . OpenAI (

base_url = "http://127.0.0.1:8086/api/v1" ,

api_key = "xxx"

)

assistant = client . beta . assistants . create (

name = "demo" ,

instructions = "You are a helpful assistant." ,

model = "gpt-4-1106-preview"

)| Fonctionnalité | API Assistant ouvert | API Assistant OpenAI |

|---|---|---|

| Stratégie de l'écosystème | Open source | Source fermée |

| Moteur de chiffon | Soutenir R2R | Soutenu |

| Recherche sur Internet | Soutenu | Non pris en charge |

| Fonctions personnalisées | Soutenu | Soutenu |

| Outil intégré | Extensible | Pas extensible |

| Interprète de code | En cours de développement | Soutenu |

| Multimodal | Soutenu | Soutenu |

| Support LLM | Prend en charge plus de LLM | Seulement GPT |

| Sortie de streaming de messages | Soutien | Soutenu |

| Déploiement local | Soutenu | Non pris en charge |

La façon la plus simple de démarrer l'API Assistant ouvert est d'exécuter le fichier docker-compose.yml. Assurez-vous que Docker et Docker Compose sont installés sur votre machine avant d'exécuter.

Accédez au répertoire racine du projet, Open docker-compose.yml , remplissez la touche de recherche Openai API_KEY et Bing (facultative).

# openai api_key (supports OneAPI api_key)

OPENAI_API_KEY= < openai_api_key >

# bing search key (optional)

BING_SUBSCRIPTION_KEY= < bing_subscription_key >Il est recommandé de configurer le moteur R2R Rag pour remplacer l'implémentation de chiffon par défaut pour fournir de meilleures capacités de chiffon. Vous pouvez en savoir plus et utiliser R2R via le référentiel GitHub R2R.

# RAG config

# FILE_SERVICE_MODULE=app.services.file.impl.oss_file.OSSFileService

FILE_SERVICE_MODULE=app.services.file.impl.r2r_file.R2RFileService

R2R_BASE_URL=http:// < r2r_api_address >

R2R_USERNAME= < r2r_username >

R2R_PASSWORD= < r2r_password >docker compose up -dURL de base de l'API: http://127.0.0.1:8086/API/v1

Adresse de documentation de l'interface: http://127.0.0.1:8086/docs

Dans cet exemple, un assistant AI est créé et exécuté à l'aide de la bibliothèque officielle OpenAI Client. Si vous devez explorer d'autres méthodes d'utilisation, telles que la sortie en streaming, les outils (web_search, la récupération, la fonction), etc., vous pouvez trouver le code correspondant dans le répertoire d'exemples. Avant d'exécuter, vous devez exécuter pip install openai pour installer la bibliothèque Python openai .

# !pip install openai

export PYTHONPATH= $( pwd )

python examples/run_assistant.py Un simple isolement des utilisateurs est fourni sur la base de jetons pour répondre aux exigences de déploiement SaaS. Il peut être activé en configurant APP_AUTH_ENABLE .

Authorization: Bearer *** dans l'en-tête d'authentification.APP_AUTH_ADMIN_TOKEN et par défaut "admin".Selon la spécification OpenAPI / Swagger, il permet l'intégration de divers outils dans l'assistant, autonomisant et améliorant sa capacité à se connecter avec le monde externe.

Rejoignez le canal Slack pour voir de nouvelles versions, discuter des problèmes et participer aux interactions communautaires.

Rejoignez le canal Discord pour interagir avec les autres membres de la communauté.

Rejoignez le groupe WeChat:

Nous nous sommes principalement mentionnés et nous sommes appuyés sur les projets suivants:

Veuillez lire notre document de contribution pour apprendre à contribuer.

Ce référentiel suit la licence open source du MIT. Pour plus d'informations, veuillez consulter le fichier de licence.