Eine aus dem Box intelligente Assistenten-AS-API-AS-Assistent

Englisch | 简体中文 | 日本語

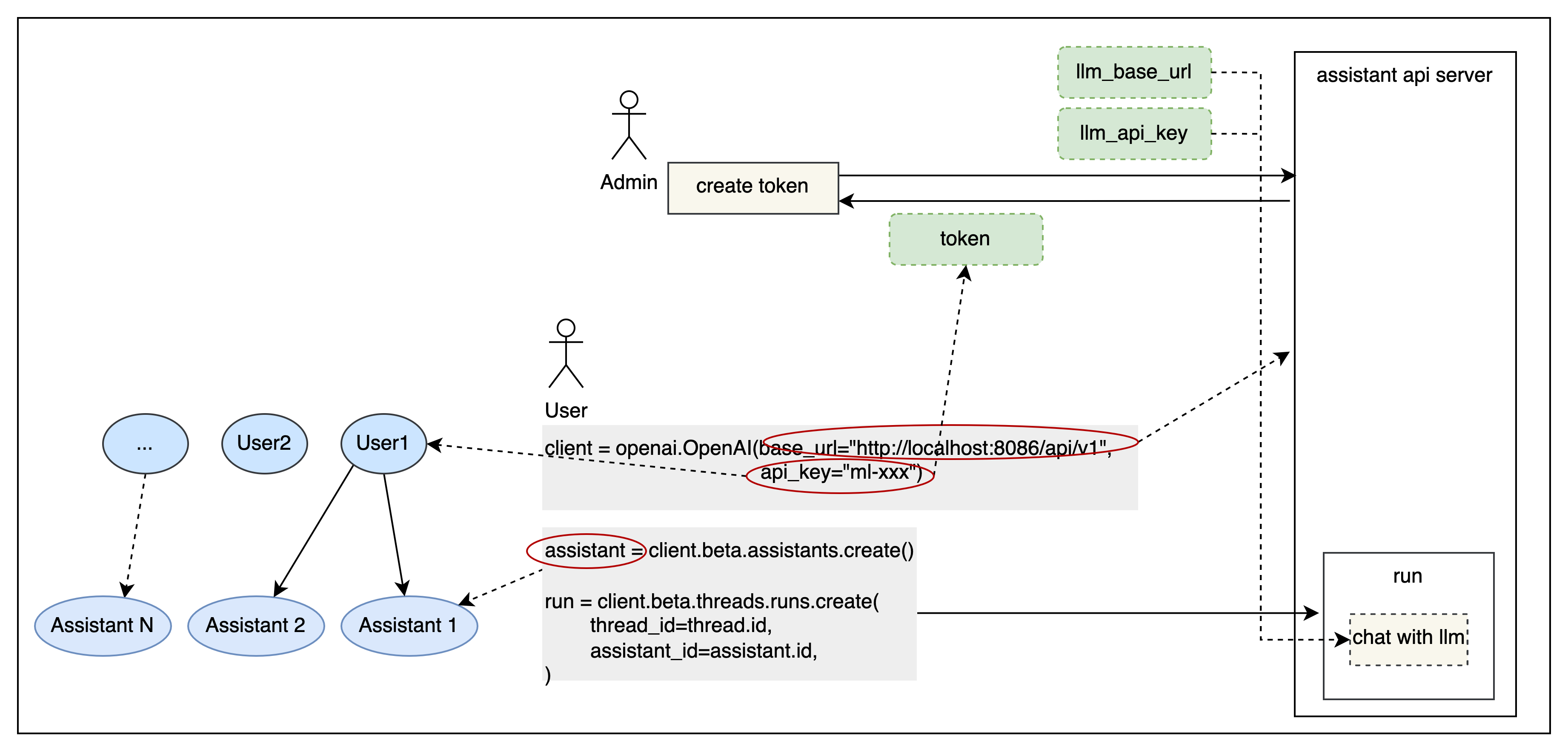

Open Assistant API ist eine Open-Source-API, die mit der selbst gehosteten AI-intelligenten Assistenten mit der offiziellen OpenAI-Schnittstelle kompatibel ist. Es kann direkt mit dem offiziellen OpenAI -Kunden verwendet werden, um LLM -Anwendungen zu erstellen.

Es unterstützt eine API für die Integration mit kommerzielleren und privaten Modellen.

Es unterstützt R2R -Lappenmotor。

Unten finden Sie ein Beispiel für die Verwendung der offiziellen OpenAI Python openai -Bibliothek:

import openai

client = openai . OpenAI (

base_url = "http://127.0.0.1:8086/api/v1" ,

api_key = "xxx"

)

assistant = client . beta . assistants . create (

name = "demo" ,

instructions = "You are a helpful assistant." ,

model = "gpt-4-1106-preview"

)| Besonderheit | Open Assistant API | OpenAI Assistant API |

|---|---|---|

| Ökosystemstrategie | Open Source | Geschlossene Quelle |

| Lappenmotor | Unterstützen Sie R2R | Unterstützt |

| Internet -Suche | Unterstützt | Nicht unterstützt |

| Benutzerdefinierte Funktionen | Unterstützt | Unterstützt |

| Integriertes Werkzeug | Erweiterbar | Nicht erweiterbar |

| Code -Interpreter | In der Entwicklung | Unterstützt |

| Multimodal | Unterstützt | Unterstützt |

| LLM -Unterstützung | Unterstützt mehr LLMs | Nur GPT |

| Message Streaming -Ausgabe | Unterstützung | Unterstützt |

| Lokale Bereitstellung | Unterstützt | Nicht unterstützt |

Der einfachste Weg, die Open Assistant API zu starten, besteht darin, die Datei docker-compose.yml auszuführen. Stellen Sie sicher, dass Docker und Docker Compose vor dem Ausführen auf Ihrem Computer installiert sind.

Gehen Sie zum Project Root Directory, Open docker-compose.yml , füllen Sie den OpenAI API_Key und den Bing-Suchschlüssel aus (optional).

# openai api_key (supports OneAPI api_key)

OPENAI_API_KEY= < openai_api_key >

# bing search key (optional)

BING_SUBSCRIPTION_KEY= < bing_subscription_key >Es wird empfohlen, die R2R -Lag -Engine so zu konfigurieren, dass sie die Standard -Lag -Implementierung ersetzt, um bessere Lag -Funktionen zu bieten. Sie können R2R über das R2R -Github -Repository kennenlernen und verwenden.

# RAG config

# FILE_SERVICE_MODULE=app.services.file.impl.oss_file.OSSFileService

FILE_SERVICE_MODULE=app.services.file.impl.r2r_file.R2RFileService

R2R_BASE_URL=http:// < r2r_api_address >

R2R_USERNAME= < r2r_username >

R2R_PASSWORD= < r2r_password >docker compose up -dAPI -Basis -URL: http://127.0.0.1:8086/api/v1

Schnittstellendokumentationsadresse: http://127.0.0.1:8086/docs

In diesem Beispiel wird ein AI -Assistent erstellt und mit der offiziellen OpenAI -Client -Bibliothek ausgeführt. Wenn Sie andere Verwendungsmethoden wie Streaming -Ausgaben, Tools (Web_search, Abrufen, Funktion) usw. untersuchen müssen, finden Sie den entsprechenden Code im Verzeichnis der Beispiele. Vor dem Laufen müssen Sie pip install openai ausführen, um die Python openai -Bibliothek zu installieren.

# !pip install openai

export PYTHONPATH= $( pwd )

python examples/run_assistant.py Eine einfache Benutzer -Isolation wird auf Token bereitgestellt, um die SAAS -Bereitstellungsanforderungen zu erfüllen. Es kann aktiviert werden, indem APP_AUTH_ENABLE konfiguriert wird.

Authorization: Bearer *** in den Header zur Authentifizierung.APP_AUTH_ADMIN_TOKEN konfiguriert ist und Standardeinstellungen zu "admin".Gemäß der OpenAPI/Swagger -Spezifikation ermöglicht es die Integration verschiedener Tools in den Assistenten, wodurch die Fähigkeit zur Verbindung mit der externen Welt stärkt und verbessert wird.

Schließen Sie sich dem Slack -Kanal an, um neue Veröffentlichungen zu sehen, Themen zu diskutieren und an Interaktionen der Community teilzunehmen.

Schließen Sie sich dem Discord -Kanal an, um mit anderen Community -Mitgliedern zu interagieren.

Treten Sie der Wechat -Gruppe bei:

Wir haben uns hauptsächlich auf folgende Projekte bezogen und sich auf die folgenden Projekte verlassen:

Bitte lesen Sie unser Beitragsdokument, um zu erfahren, wie man einen Beitrag leisten.

Dieses Repository folgt der MIT Open Source -Lizenz. Weitere Informationen finden Sie in der Lizenzdatei.