Esta es la implementación oficial de Pytorch de la síntesis de imágenes de glifo artístico a través de un aprendizaje de pocos disparos de una etapa .

papel | material complementario

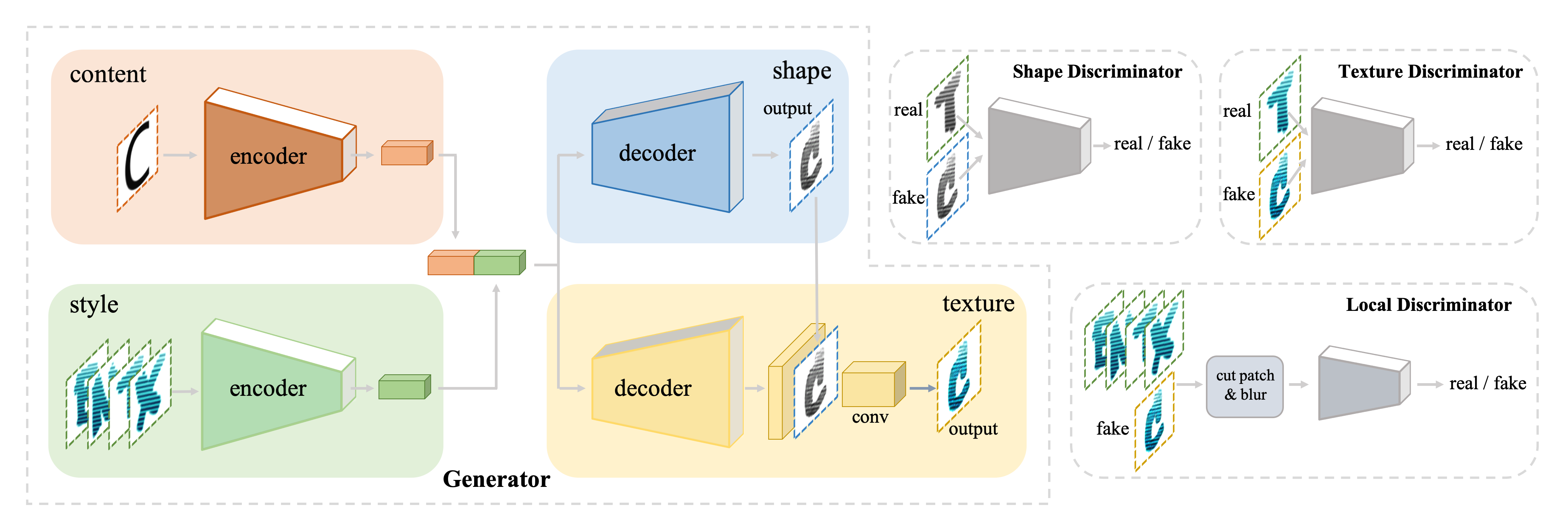

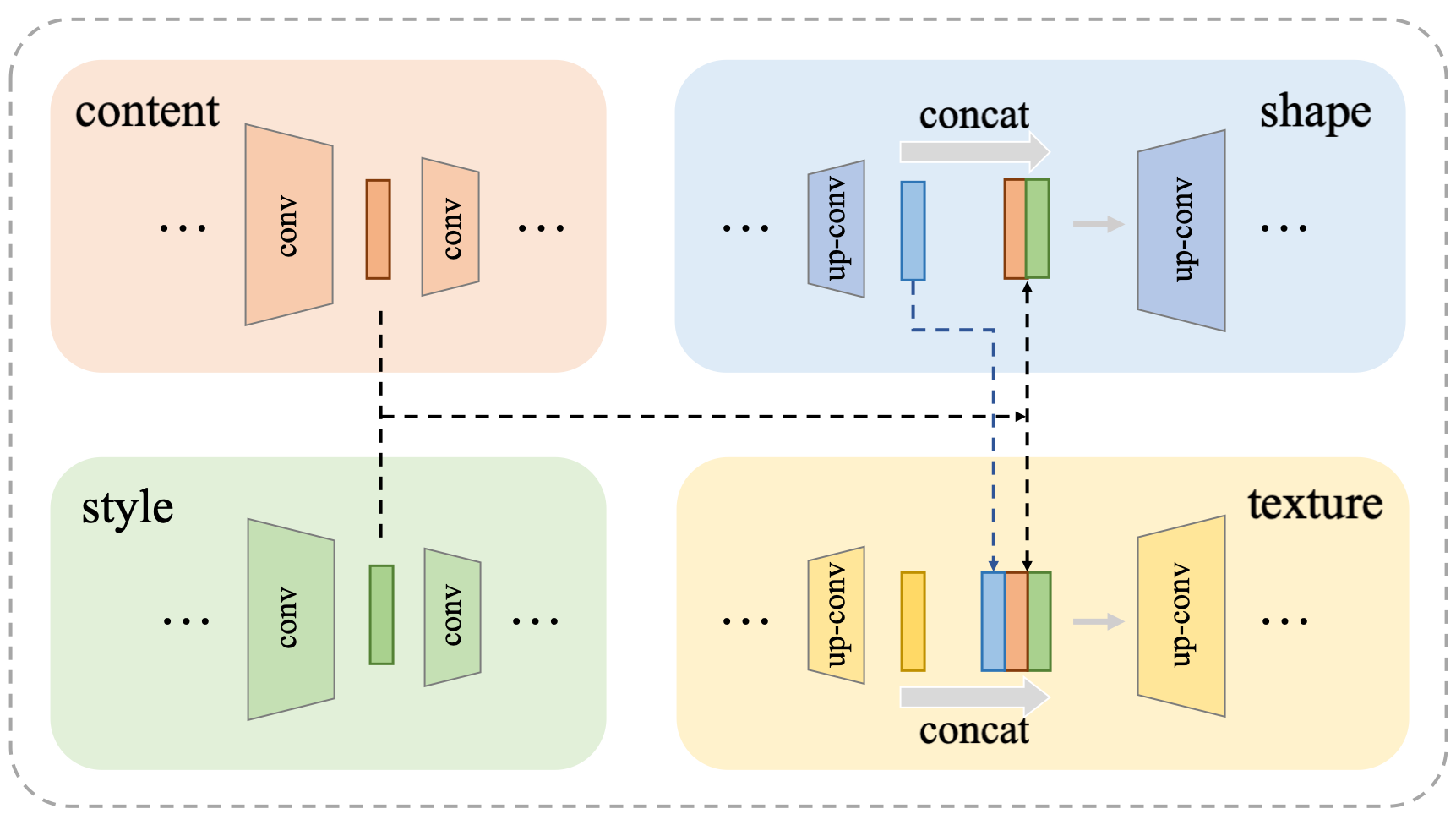

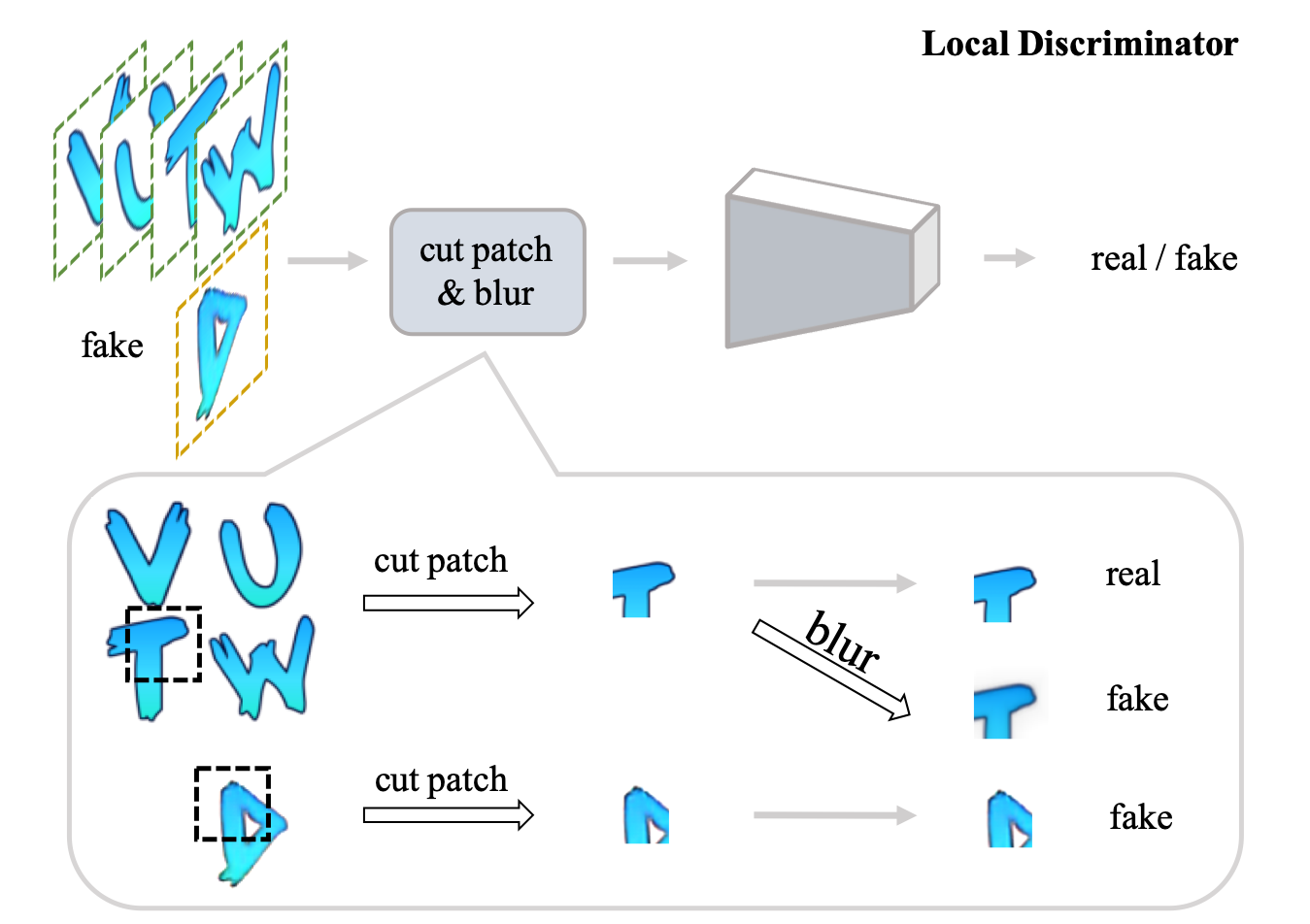

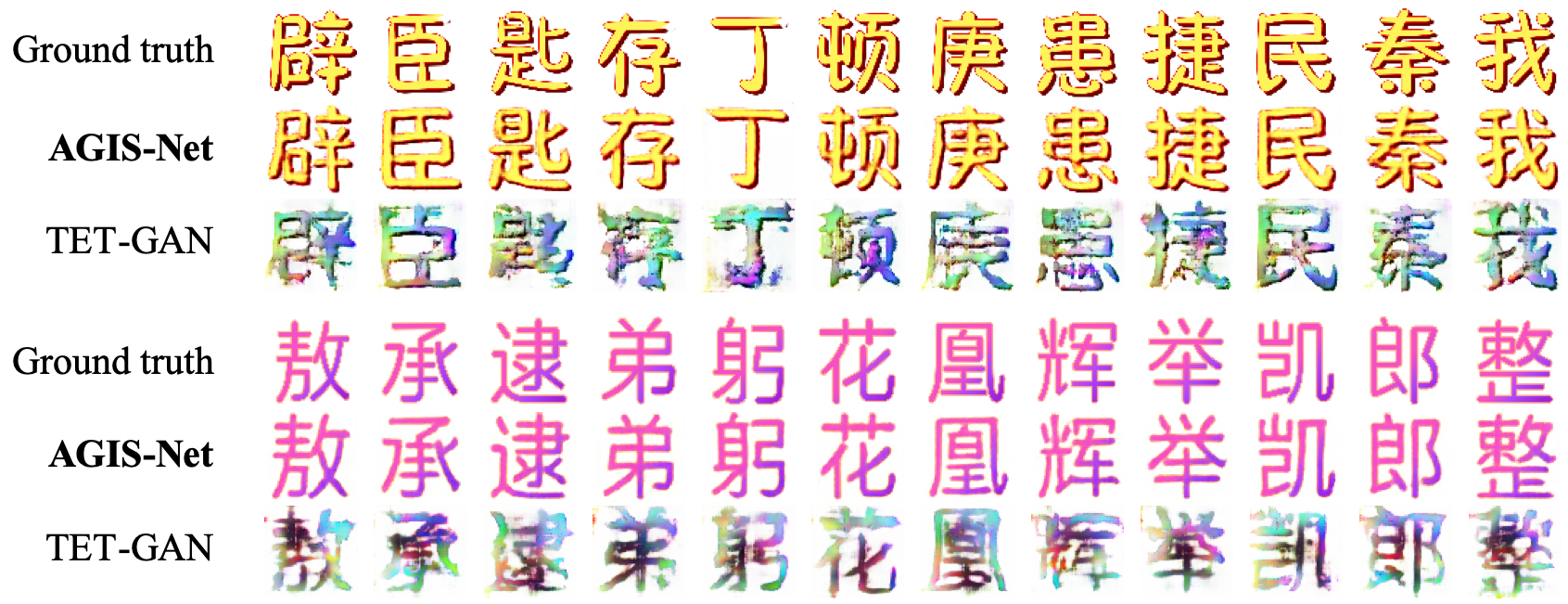

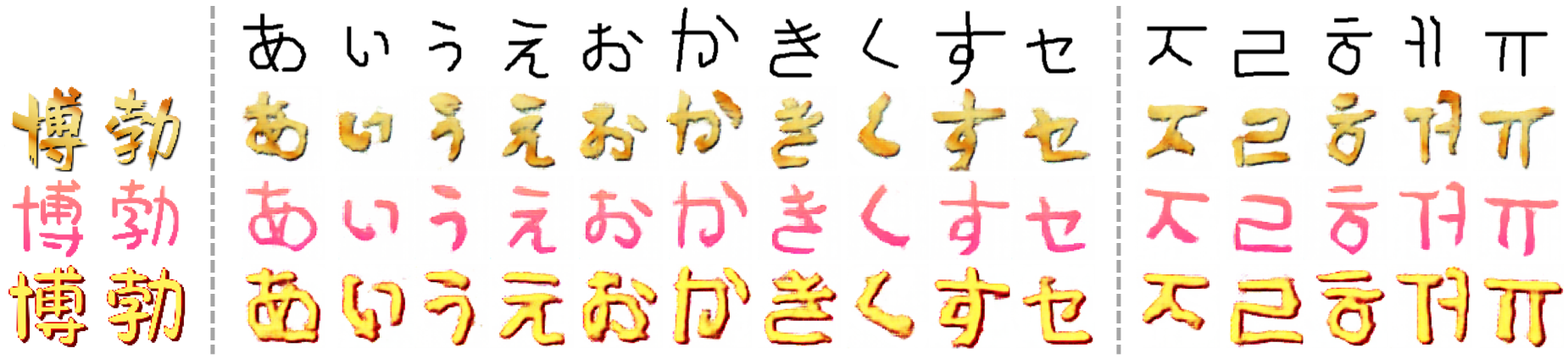

La generación automática de imágenes de glifo artístico es una tarea desafiante que atrae muchos intereses de investigación. Los métodos anteriores están diseñados específicamente para la síntesis de forma o se centran en la transferencia de textura. En este artículo, proponemos un modelo novedoso, Agis-Net, para transferir estilos de forma y textura en una etapa con solo unas pocas muestras estilizadas. Para lograr este objetivo, primero desenredamos las representaciones para el contenido y el estilo utilizando dos codificadores, asegurando la generación de múltiples contactos y de estilo múltiple. Luego utilizamos dos decodificadores de trabajo en colaboración para generar la imagen de forma del glifo y su imagen de textura simultáneamente. Además, presentamos una pérdida de refinamiento de textura local para mejorar aún más la calidad de las texturas sintetizadas. De esta manera, nuestro modelo de una etapa es mucho más eficiente y efectivo que otros métodos apilados en varias etapas. También proponemos un conjunto de datos a gran escala con imágenes de glifo chino en diversas formas y estilos de textura, renderizado a partir de 35 fuentes artísticas diseñadas por profesionales con 7,326 caracteres y 2,460 fuentes artísticas sintéticas con 639 caracteres, para validar la efectividad y la extensión de nuestro método. Experimentos extensos en los conjuntos de datos de imágenes de glifo artístico en inglés y chino demuestran la superioridad de nuestro modelo en la generación de imágenes de glifo estilizado de alta calidad contra otros métodos de última generación.

| Skip Connection | Discriminador local |

|---|---|

|  |

pip install visdom

pip install dominategit clone -b master --single-branch https://github.com/hologerry/AGIS-Net

cd AGIS-NetEl servidor de datos de datos está inactivo, puede descargar los conjuntos de datos desde el disco PKU, Dropbox o Mega. Descargue los conjuntos de datos utilizando el siguiente script, cuatro conjuntos de datos y la imagen de Glyph de estilo de fuente promedio en bruto están disponibles.

Puede llevar un tiempo, por favor, sea paciente

bash ./datasets/download_dataset.sh DATASET_NAME

base_gray_color English Synthesed Glyph Image DataSet, propuesto por MC-Gan.base_gray_texture English Artistic Glyph Image DataSet, propuesto por MC-Gan.skeleton_gray_color chino sintetizado de datos de datos de imágenes de glifo de gradiente por nosotros.skeleton_gray_texture El conjunto de datos de imágenes de glifo artístico chino propuesto por nosotros.average_skeleton Raw chino chino Avgerage Font Font (Skeleton) Glyph Image DataSet propuesto por nosotros.Consulte los datos para obtener más detalles sobre nuestros conjuntos de datos y cómo preparar sus propios conjuntos de datos.

Para entrenar un modelo, descargue las imágenes de entrenamiento (por ejemplo, transferencia de glifo artístico en inglés)

bash ./datasets/download_dataset.sh base_gray_color

bash ./datasets/download_dataset.sh base_gray_textureEntrenar un modelo:

Comience el visualizador Visdom

python -m visdom.server -port PORTEl puerto se especifica en

train.sh

Pretrain en el conjunto de datos de imágenes de glifo de gradiente sintetizado

bash ./scripts/train.sh base_gray_color GPU_IDGPU_ID indica qué GPU usar.

Fineture en el conjunto de datos de imágenes de glifo artístico

bash ./scripts/train.sh base_gray_texture GPU_ID DATA_ID FEW_SIZEData_id indica qué fuente artística está ajustada.

Pocos_size indica el tamaño del conjunto de pocos disparos.

Planteará un error diciendo:

FileNodeFoundError: [Error 2] No such file or directory: 'chechpoints/base_gray_texture/base_gray_texture_DATA_ID_TIME/latest_net_G.pth

Copiar el modelo previamente provocado a la ruta superior

cp chechpoints/base_gray_color/base_gray_color_TIME/latest_net_ * chechpoints/base_gray_texture/base_gray_texture_DATA_ID_TIME/Y comience a entrenar de nuevo. Funcionará bien.

Para probar un modelo, copie el modelo capacitado desde checkpoint a la carpeta pretrained_models (por ejemplo, transferencia de glifo artístico en inglés)

cp chechpoints/base_gray_color/base_gray_texture_DATA_ID_TIME/latest_net_ * pretrained_models/base_gray_texture_DATA_ID/Probar un modelo

bash ./scripts/test_base_gray_texture.sh GPU_ID DATA_IDEste código está inspirado en BicyClegan.

Un agradecimiento especial a los siguientes trabajos por compartir su código y conjunto de datos.

Si encuentra que nuestro trabajo es útil, cite nuestro documento:

@article{Gao2019Artistic,

author = {Gao, Yue and Guo, Yuan and Lian, Zhouhui and Tang, Yingmin and Xiao, Jianguo},

title = {Artistic Glyph Image Synthesis via One-Stage Few-Shot Learning},

journal = {ACM Trans. Graph.},

issue_date = {November 2019},

volume = {38},

number = {6},

year = {2019},

articleno = {185},

numpages = {12},

url = {http://doi.acm.org/10.1145/3355089.3356574},

publisher = {ACM}

}

El código y el conjunto de datos solo están permitidos para el uso personal y académico.