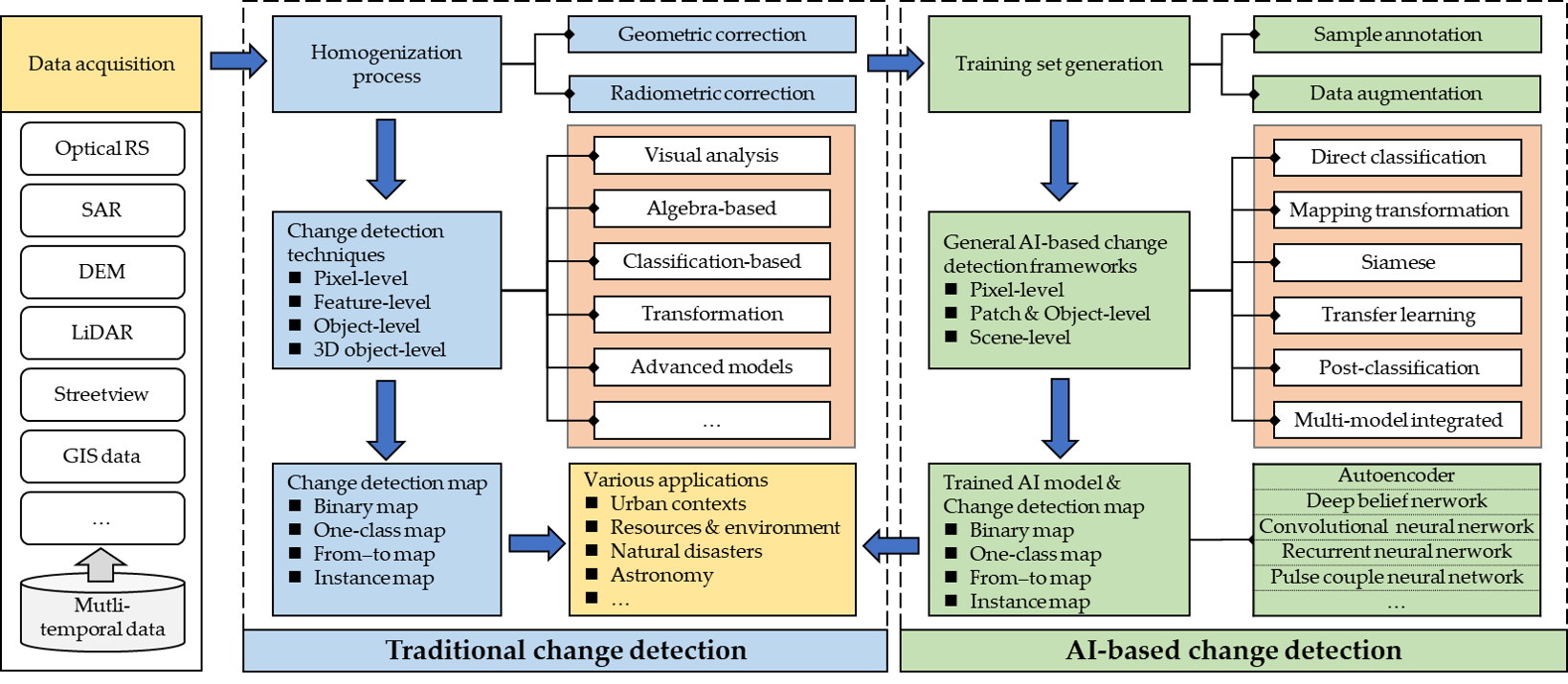

La detección de cambios basada en datos de teledetección (RS) es un método importante para detectar cambios en la superficie de la Tierra y tiene una amplia gama de aplicaciones en planificación urbana, monitoreo ambiental, investigación agrícola, evaluación de desastres y revisión de mapas. En los últimos años, la tecnología integrada de inteligencia artificial (IA) se ha convertido en un enfoque de investigación en el desarrollo de nuevos métodos de detección de cambios. Aunque algunos investigadores afirman que los enfoques de detección de cambios basados en IA superan los enfoques de detección de cambios tradicionales, no es inmediatamente obvio cómo y en qué medida la IA puede mejorar el rendimiento de la detección de cambios. Esta revisión se centra en los métodos de vanguardia, aplicaciones y desafíos de la IA para la detección de cambios. Específicamente, primero se introduce el proceso de implementación de la detección de cambios basada en IA. Luego, se presentan los datos de diferentes sensores utilizados para la detección de cambios, incluidos los datos ópticos RS, los datos de radar de apertura sintética (SAR), las imágenes de vistas a la calle y los datos heterogéneos combinados, y también se enumeran los conjuntos de datos abiertos disponibles. Los marcos generales de los métodos de detección de cambios basados en IA se revisan y analizan sistemáticamente, y los esquemas no supervisados utilizados en la detección de cambios basados en IA se analizan adicionalmente. Posteriormente, se describen las redes de IA para la detección de cambios comúnmente utilizadas. Desde un punto de vista práctico, los dominios de aplicación de los métodos de detección de cambios basados en IA se clasifican en función de su aplicabilidad. Finalmente, los principales desafíos y perspectivas de AI para la detección de cambios se discuten y delinean, incluyendo (a) procesamiento heterogéneo de big data, (b) IA sin supervisión y (c) la confiabilidad de la IA. Esta revisión será beneficiosa para los investigadores para comprender este campo.

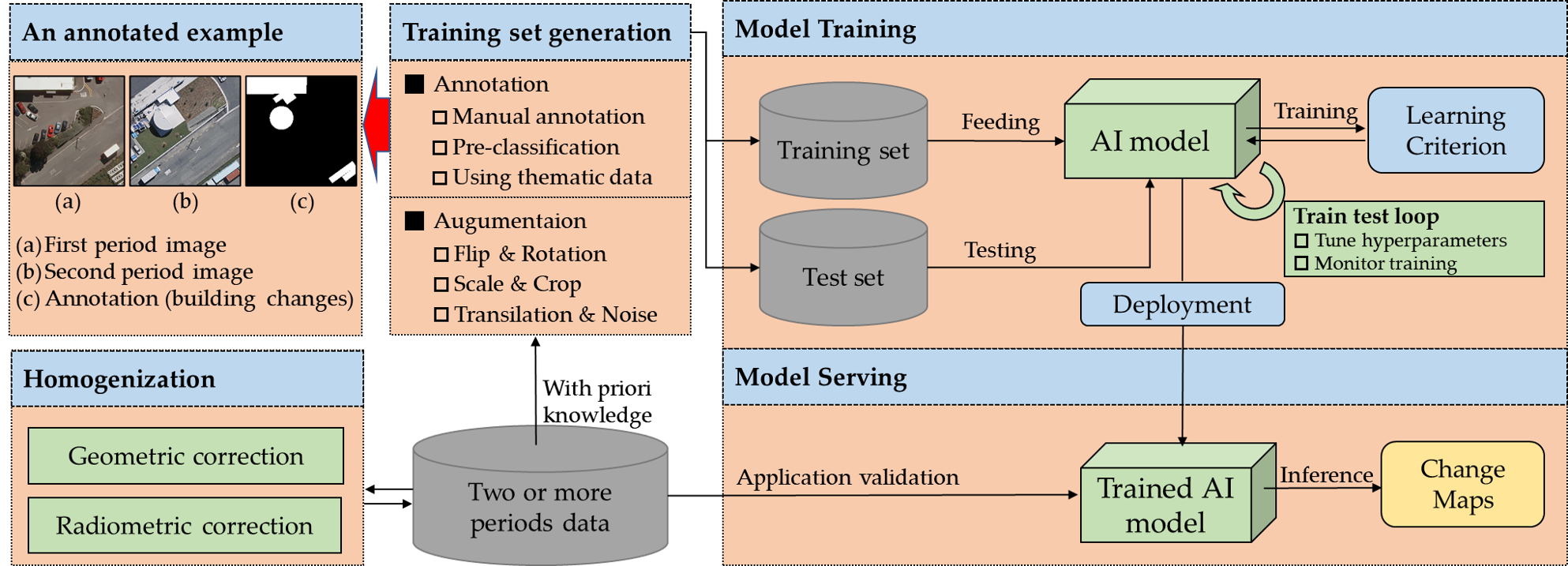

La Figura 2 proporciona un proceso de implementación general de detección de cambios basada en AI, pero la estructura del modelo de IA es diversa y debe estar bien diseñada de acuerdo con diferentes situaciones de aplicación y los datos de capacitación. Vale la pena mencionar que los marcos maduros existentes como TensorFlow, Keras, Pytorch y Caffe, ayudan a los investigadores a realizar más fácilmente el diseño, la capacitación y el despliegue de modelos de IA, y sus documentos de desarrollo proporcionan introducciones detalladas.

| Métodos | Palabras clave | Publicación | (Re) implementación |

|---|---|---|---|

| Srcdnet | CNN; Siamés; Atención; Super resolución; RS óptico | Red de detección de cambios basada en súper resolución con módulo de atención apilada para imágenes con diferentes resoluciones, TGRS, 2021. [Documento], [Código, DataSet] | Pytorch 1.2 |

| Escnet | CNN; Siamés; Superpíxel; RS óptico | Una red de detección de cambios mejorada con superpíxeles de extremo a extremo para imágenes de detección remota de muy alta resolución. Tnnls, 2021. [Documento], [Código] | Pytorch 1.3 |

| Kpcamnet | CNN; Siamés; KPCA; Sin supervisión; RS óptico | Detección de cambios sin supervisión en imágenes de VHR multitemporales basadas en la red de mapeo convolucional de núcleo profundo PCA, TCYB, 2021. [Documento], [Código] | Pitón |

| Seco | CNN (resnet); Transferir el aprendizaje; RS óptico | Contraste estacional: pre-entrenamiento no supervisado a partir de datos de detección remota no superada, ARXIV, 2021. [Documento], [código, conjunto de datos] | Pytorch 1.7 |

| Cápsula | Red cápsula (SEGCAPS); CVA; Siamés; RS óptico | Red de cápsula pseudo-samés para imágenes de detección de detección remota aérea, GRSL, 2020. [Documento 1], Cambiar la red de cápsulas para detección óptica de detección de imágenes de imágenes remotas, Rs, 2021. [Documento 2], [código, conjunto de datos] | Keras |

| Bit_cd | CNN (resnet18); Siamés; Atención; Transformador; RS óptico | Detección de cambio de imagen de detección remota con Transformers, TGRS, 2021. [Documento], [Código, conjunto de datos, modelo previamente entrenado] | Pytorch 1.6 |

| Iaug_cdnet | CNN (Gaugan+Unet); Siamés; Gan; Supervisado; RS óptico | Aumento de instancias adversas para la detección de cambios de edificio en imágenes de detección remota, TGRS, 2021. [Documento], [Código, conjunto de datos] | Pytorch |

| Ddnet | CNN; Di+fcm; Sin supervisión; Sar | Cambiar la detección de imágenes de radar de apertura sintética utilizando una red de doble dominio, GRSL, 2021. [Documento], [código, conjunto de datos] | Pytorch |

| Snunet-cd | CNN (Nestedunet); Siamés; Atención; Supervisado; RS óptico | Snunet-CD: una red siamesa densamente conectada para la detección de cambios de imágenes VHR, GRSL, 2021. [Documento], [Código, conjunto de datos, modelo previamente entrenado] | Pytorch 1.4 |

| DSMSCN | CNN; Siamés; Múltiple a escala; Sin supervisión/supervisado; RS óptico | Una red de fusión de imágenes profundamente supervisada para la detección de cambios en imágenes remotas bi-temporales de alta resolución, ARXIV, 2020. [Documento], [código, conjunto de datos] | TensorFlow 1.9 |

| Siamcrnn | CNN+RNN; Siamés; Múltiples fuentes; RS óptico | Detección de cambios en imágenes VHR multiosuperiores a través de la red neuronal recurrente de múltiples capas de múltiples siameses profundas, TGRS, 2020. [Documento], [Código, conjunto de datos] | TensorFlow 1.9 |

| Dsifn | CNN; Mecanismo de atención; RS óptico | Una red de fusión de imágenes profundamente supervisada para la detección de cambios en imágenes remotas bi-temporales de alta resolución, ISPRS, 2020. [Documento], [código, conjunto de datos] | Pytorch y Keras |

| CEECNET | CNN; Mecanismo de atención; Medida de similitud; RS óptico | ¿Buscas cambios? Rode los dados y la atención de la demanda, ARXIV, 2020. [Documento], [Código, conjunto de datos] | Mxnet + python |

| Lamboisenet | CNN (ligero unet ++); RS óptico | Detección de cambio en imágenes satelitales utilizando aprendizaje profundo, tesis maestra. [Código, conjunto de datos, modelo previamente entrenado] | Pytorch |

| Dtcdscn | CNN; siamés | Detección de cambio de edificio para imágenes de teledetección utilizando un modelo de red convolucional profundo siamés de doble tarea, experimentando una revisión. [Código, conjunto de datos] | Pytorch |

| Análisis de cobertura de tierras | CNN (unter); Post classificación; RS óptico | Uso de la tierra/Detección de cambios de cobertura de la tierra en áreas afectadas por ciclones utilizando redes neuronales convolucionales. [Informe], [código, conjunto de datos, modelo previamente entrenado] | TensorFlow+Keras |

| Corrfusionnet | CNN; Nivel de escena; Siamés; RS óptico | Red de fusión basada en correlación hacia la clasificación de la escena multitemporal y la detección de cambios, experimentando una revisión. [Código, modelo previamente entrenado], [conjunto de datos] | TensorFlow 1.8 |

| Sscdnet | CNN (resnet18); Siamés; Transferir el aprendizaje; Semántico; Visión de calle | Detección de cambio de escena semántica basada en la silueta débilmente supervisada, ICRA, 2020. [Documento] [Código, conjunto de datos, modelo previamente entrenado] | Pytorch+Python3.6 |

| Heterogéneo_cd | Ae (AE alineado con código); Sin supervisión; Transformación; Heterogéneo; RS óptico | Autoencoders alineados con código para detección de cambios no supervisado en imágenes de detección remota multimodal, ARXIV, 2020. [Documento] [Código, conjunto de datos] | Tensorflow 2.0 |

| Fdcnn | CNN (VGG16); Transferir el aprendizaje; Puro-diamante; Múltiple a escala; RS óptico | Un método de detección de cambio de cambio de red neuronal convolucional de diferencia de características, TGRS, 2020. [Documento] [Código, conjunto de datos, modelo previamente entrenado] | Caffe+Python2.7 |

| Stanet | CNN (resnet-18); Mecanismo de atención; Puro-diamante; Dependencia espacial -temporal; RS óptico | Un método basado en la atención espacial-temporal y un nuevo conjunto de datos para la detección de cambios de imagen de detección remota, RS, 2020. [Documento] [Código, conjunto de datos] | Pytorch+Python3.6 |

| Red | CNN; Sin supervisión; Transformación; Heterogéneo; RS óptico; Sar | Traducción de imagen profunda con un cambio basado en afinidad previamente para la detección de cambios multimodales no supervisados, 2020. [Documento] [Código, conjunto de datos] | TensorFlow 1.4 |

| Red | Ae (codificadores cíclicos adversos); Sin supervisión; Transformación; Heterogéneo; RS óptico; Sar | Traducción de imagen profunda con un cambio basado en afinidad previamente para la detección de cambios multimodales no supervisados, 2020. [Documento] [Código, conjunto de datos] | TensorFlow 1.4 |

| VGG_LR | CNN (VGG16); Transferir el aprendizaje; Puro-diamante; Slic; Rangos bajos; RS óptico | Detección de cambio basada en características profundas y bajo rango, GRSL, 2017. [Documento] [Código de reimplementación, conjunto de datos, modelo previamente entrenado] | Caffe+Matlab |

| Cdnet | CNN; Siamés; Datos multimodales; Datos de nubes de puntos | Detección de cambios en el edificio entre el escaneo láser en el aire y los datos fotogramétricos, Rs, 2019. [Documento], [Código] | Pytorch |

| SCCN | Ae (dae); Sin supervisión; Heterogéneo; RS óptico; Sar | Una red de acoplamiento convolucional profunda para la detección de cambios basada en imágenes ópticas y radares heterogéneas, TNNLS, 2018. [Documento] [Código de reimplementación] | Tensorflow 2.0 |

| CGAN | Gan (GaN condicional); Heterogéneo; RS óptico; Sar | Una red adversaria condicional para la detección de cambios en imágenes heterogéneas, Grsl, 2019. [Documento] [Código de reimplementación] | Tensorflow 2.0 |

| Dasnet | CNN (VGG16); Siamés; Mecanismo de atención; RS óptico | Dasnet: redes siamesas totalmente convolucionales de doble atención para la detección de cambios de imágenes satelitales de alta resolución, ARXIV, 2020. [Documento] [Código, conjunto de datos, modelo previamente capacitado] | Pytorch+Python3.6 |

| Unetlstm | CNN (unter); RNN (LSTM); Modelo integrado; RS óptico | Detección de cambios urbanos con redes neuronales recurrentes a partir de datos multitemporales Sentinel-2, Igarss, 2019. [Documento] [Código, conjunto de datos, modelo previamente entrenado] y [código] | Pytorch+Python3.6 |

| Net cdmi | CNN (unter); Puro-diamante; Aprendizaje de instancias múltiples; Mapeo de deslizamientos de tierra; RS óptico | Aprendizaje de instancia múltiple profunda para el mapeo de deslizamientos de tierra, GRSL, 2020. [Documento] [Código, Modelo previamente capacitado] | Pytorch+Python3.6 |

| Dsfanet | Dnn; Sin supervisión; Pre-clasificación; Análisis de características lentas; RS óptico | Análisis de características lentas profundas sin supervisión para la detección de cambios en imágenes de detección remota multitemporal, TGRS, 2019. [Documento] [Código, conjunto de datos] | TensorFlow 1.7 |

| CD-Unet ++ | CNN (UNET ++ mejorado); Clasificación directa; RS óptico | Detección de cambio de extremo a extremo para imágenes satelitales de alta resolución utilizando unet ++ mejorado, Rs, 2019. [Documento] [Código] | TensorFlow+Keras |

| Siamesenet | CNN (VGG16); Puro-diamante; RS óptico | Siamese Network con características de nivel múltiple para la detección de cambios basados en parches en imágenes satelitales, Globalsip, 2018. [Documento] [Código, conjunto de datos] | TensorFlow+Keras |

| RE3FCN | CNN (Convlstm); PCA; Convolución 3d; Cambios de clase múltiple; RS óptico; Hiperespectral | Detección de cambios en imágenes hiperespectrales utilizando redes totalmente convolucionales 3D recurrentes, Rs, 2018. [Documento] [Código, conjunto de datos] | TensorFlow+Keras |

| FC-EF, FC-SIAM-CONC, FC-SIAM-DIFF | CNN (unter); Puro-diamante; RS óptico | Redes siamesas totalmente convolucionales para la detección de cambios, ICIP, 2018. [Documento] [Código, conjunto de datos] | Pytorch |

| Cosmnet | CNN (DeepLab V2); Puro-diamante; Visión de calle | Aprender a medir los cambios: redes métricas siamesas totalmente convolucionales para la detección de cambios de escena, ARXIV, 2018. [Documento] [Código, conjunto de datos, modelo previamente entrenado] | Pytorch+Python2.7 |

| Máscara R-CNN | Máscara R-CNN (resnet-101); Transferir el aprendizaje; Post classificación; RS óptico | Segmentación y detección de cambios de barrios marginales: un enfoque de aprendizaje profundo, NIPS, 2018. [Documento] [Código, conjunto de datos, modelo previamente entrenado] | TensorFlow+Keras |

| Caffenet | CNN (Caffenet); Sin supervisión; Transferir el aprendizaje; RS óptico | Detección de cambios basado en características de la red neuronal convolucional en imágenes satelitales, IWPR, 2016. [Documento] [Código, conjunto de datos] | TensorFlow+Keras |

| CWNN | CNN (CWNN); Sin supervisión; Pre-clasificación; Sar | Detección de cambio de hielo en el mar en imágenes SAR basadas en redes neuronales de onda convolucional, GRSL, 2019. [Documento] [Código, conjunto de datos] | Matlab |

| Mlfn | CNN (Densenet); Transferir el aprendizaje; Sar | El aprendizaje profundo transferido para la detección del cambio de hielo marino a partir de imágenes de radar de apertura sintética, GRSL, 2019. [Documento] [Código, conjunto de datos] | Caffe+Matlab |

| Garborpcanet | CNN (pcanet); Sin supervisión; Pre-clasificación; Wavelets Gabor; Sar | Detección de cambio automático en imágenes de radar de apertura sintética basadas en Pcanet, GRSL, 2016. [Documento] [Código, conjunto de datos] | Matlab |

| MS-Capsnet | CNN (MS-Capsnet); Cápsula; Mecanismo de atención; Convolución de fusión adaptativa; Sar | Cambiar detección en imágenes SAR basadas en Multiscale Capsule Network, GRSL, 2020. [Documento] [Código, conjunto de datos] | Matlab+keras2.16 |

| Dcnet | CNN; Sin supervisión; Pre-clasificación; Sar | Cambiar la detección de imágenes de radar de apertura sintética basadas en la red de cascada profunda basada en la ponderación de canales, Jstars, 2019. [Documento] [Código, conjunto de datos] | Cafetería |

| Changenet | CNN; Siamés; Visión de calle | Changenet: una arquitectura de aprendizaje profundo para la detección de cambios visuales, ECCV, 2018. [Documento] [Código, conjunto de datos] | Pytorch |

| ¡Otros se agregarán pronto! | |||

| Métodos | Palabras clave | Publicación | Implementación |

|---|---|---|---|

| Varios métodos clásicos | CVA; DPCA; Diferencia de la imagen; Relación de imagen; Regresión de imagen; Ir-Mad; ENOJADO; PCAKMEANS; PCDA; Kmeans; OTSU; Umbral fijo | Una caja de herramientas para la detección de cambios de teledetección. [código] | Matlab |

| Detección de cambio de caja de herramientas de Matlab | Ir-Mad; IT-PCA; Erm; ICM | Una caja de herramientas para análisis de detección de cambios no supervisado, IJRS, 2016. [Documento] [Código] | Matlab |

| RFR, SVR, GPR | Sin supervisión; Regresión de imagen; Heterogéneo; RS óptico; Sar | Regresión de imagen no supervisada para la detección de cambios heterogéneos, TGRS, 2019. [Documento] [Código] | Matlab |

| HPT | Sin supervisión; Transformación; Heterogéneo; RS óptico; Sar | Detección de cambios en imágenes de teledetección heterogéneas a través de la transformación de píxeles homogéneas, Tip, 2018. [Documento] [Código de reimplementación] | Matlab |

| KCCA | Análisis de correlación canónica; Sensor cruzado; RS óptico | Alineación espectral de imágenes multitemporales de sensor cruzado con análisis de correlación de núcleo automatizado, IJPRS, 2015. [Documento] [Código] | Matlab |

| Ker. Dif. RBF | Sin supervisión; K-means; RS óptico | Detección de cambios sin supervisión con Kernels, GRSL, 2012. [Documento] [Código] | Matlab |

| FDA-RM | Basado en DI; Análisis de dominio de frecuencia; Multigraphs aleatorios; Sar | Detección de cambio de imagen de radar de apertura sintética basada en el análisis de dominio de frecuencia y multigraphs aleatorios, Jars, 2018. [Documento] [Código] | Matlab |

| CD-NR-ELM | Basado en DI; Pre-clasificación; Máquina de aprendizaje extrema; Sar | Cambiar la detección de imágenes de radar de apertura sintética basadas en la relación basada en el vecindario y la máquina de aprendizaje extremo, Jars, 2016. [Documento] [Código, conjunto de datos] | Matlab |

| Ninguno | Relación de probabilidad; Estadística de prueba; Sar | Detección de cambio en imágenes SAR polarimétricas, 2015. [Informe] [Código] | Pitón |

| PCA K-Means | Sin supervisión; Basado en DI; PCA; K significa; RS óptico | Detección de cambios sin supervisión en imágenes satelitales utilizando el análisis de componentes principales y la agrupación de K-means, GRSL, 2009. [Documento] [Código de reimplementación, conjunto de datos] o [Código de reimplementación] | Matlab |

| PTCD | Tensor; RS óptico hiperespectral | Detector de descomposición y reconstrucción de Tucker de tres orden para la detección de cambios hiperespectrales no supervisados. JSTARS, 2021. [Documento] [Código, conjunto de datos] | Matlab |

| GBF-CD | Fusión de datos; Gráfico; Em; Ki; | La fusión de datos basada en gráficos se aplica a: detección de cambios y estimación de biomasa en cultivos de arroz. Sensación remota, 2020 [documento] [código, conjunto de datos] | Matlab |

| ¡Otros se agregarán pronto! | |||

Actualmente, hay algunos conjuntos de datos disponibles gratuitamente para la detección de cambios, que pueden usarse como conjuntos de datos de referencia para capacitación de IA y evaluación de precisión en futuras investigaciones. La información detallada se presenta en la Tabla 3.

| Tipo | Conjunto de datos | Descripción |

|---|---|---|

| RS óptico | Conjunto de datos DSIFN [25] | 6 Imágenes de alta resolución bi-temporales de Google Earth. Hay 3600 pares de imágenes con un tamaño de 512 × 512 para entrenamiento, 340 para validación y 48 para la prueba. [Descargar] |

| S2MTCP [26] | 1520 pares de imágenes Sentinel-2 Nivel 1C centrados en áreas urbanas de todo el mundo, con una resolución espacial de 10 m y el tamaño de 600x600 píxeles. No se realizan correcciones geométricas o radiométricas. [Descargar] | |

| Sysu-cd [27] | 20000 pares de imágenes aéreas de 0.5 m de tamaño 256 × 256 tomados entre los años 2007 y 2014 en Hong Kong, incluidos 6 tipos de cambio: (a) edificios urbanos recién construidos; (b) dilatación suburbana; (c) basura antes de la construcción; (d) cambio de vegetación; (e) expansión de la carretera; (f) Construcción del mar. [Descargar] | |

| S2looking [28] | El conjunto de datos de detección de cambio de edificio consta de 5000 pares de imágenes bitemporales registrados (tamaño de 1024*1024, 0.5 ~ 0.8 m/píxel) de áreas rurales en todo el mundo y más de 65,920 instancias de cambio anotadas, lo que indica por separado el edificio recién construido y demolido [descargar] | |

| Conjunto de datos de imágenes sintéticas y reales [29] | La base de datos contiene 12,000 triples de imágenes sintéticas sin cambio de objeto, 12,000 triples de imágenes modelo con cambio de objeto y 16,000 triples de fragmentos de imágenes de teledetección reales. Las pruebas realizadas han demostrado que el CNN propuesto es lo suficientemente prometedor y eficiente en la detección de cambios en imágenes sintéticas y reales [descargar] | |

| Conjunto de datos de detección de cambio semántico (segundo) [24] | Un conjunto de datos de detección de cambio semántico anotado a nivel de píxel, que incluye 4662 pares de imágenes aéreas con 512 x 512 píxeles de varias plataformas y sensores, cubriendo Hangzhou, Chengdu y Shanghai. Se centra en 6 clases principales de cobertura terrestre, es decir, superficie del suelo no vegetada, árbol, vegetación baja, agua, edificios y parques infantiles, que con frecuencia están involucrados en cambios geográficos naturales y provocados por el hombre. [Descargar] | |

| Conjunto de datos de detección de cambio hiperespectral [1] | 3 escenas hiperespectrales diferentes adquiridas por AVIRIS o sensor Hyperion, con 224 o 242 bandas espectrales, etiquetadas 5 tipos de cambios relacionados con las transiciones de cultivos a nivel de píxeles. [Descargar] | |

| Conjunto de datos HSIS de río [2] | 2 HSIS en la provincia de Jiangsu, China, con 198 bandas, etiquetadas como cambiadas y sin cambios a nivel de píxeles. [Descargar] | |

| HRSCD [3] | 291 Los pares de imágenes aéreas RGB, con un cambio a nivel de píxel y anotaciones de cobertura del suelo, que proporcionan etiquetas de cambio de nivel jerárquico, por ejemplo, las etiquetas de nivel 1 incluyen cinco clases: sin información, superficies artificiales, áreas agrícolas, bosques, humedales y agua. [Descargar] | |

| Whu Building DataSet [4] | Imágenes aéreas de 2 períodos que contienen 12,796 edificios, proporcionados junto con mapas de vectores y ráster de edificio. [Descargar] | |

| Sztaki Air Change Benchmark [5, 6] | 13 pares de imágenes aéreas con resolución espacial de 1,5 m, etiquetada como cambiada y sin cambios a nivel de píxeles. [Descargar] | |

| OSCD [7] | 24 pares de imágenes multiespectrales adquiridas por Sentinel-2, etiquetadas como cambiadas y sin cambios a nivel de píxeles. [Descargar] | |

| Cambiar el conjunto de datos de detección [8] | 4 pares de imágenes multiespectrales con diferentes resoluciones espaciales, etiquetadas como cambiadas y sin cambios a nivel de píxeles. [Descargar] | |

| MTS-WH [9] | 2 imágenes de VHR de gran tamaño adquiridas por Ikonos Sensors, con 4 bandas y resolución espacial de 1 m, etiquetado con 5 tipos de cambios (es decir, estacionamiento, casas escasas, región residencial y región de vegetación) a nivel de escena. [Descargar] | |

| ABCD [10] | 16,950 pares de imágenes aéreas RGB para detectar edificios lavados por tsunami, etiquetados como edificios dañados a nivel de escena. [Descargar] | |

| XBD [11] | Las imágenes satelitales previas y posteriores al desastre para la evaluación de daños en el edificio, con más de 850,000 constructores de polígonos de 6 tipos de desastres, etiquetados a nivel de píxeles con 4 escalas de daño. [Descargar] | |

| AICD [12] | 1000 pares de imágenes aéreas sintéticas con cambios artificiales generados con un motor de representación, etiquetado como cambiado y sin cambios a nivel de píxeles. [Descargar] | |

| Base de datos de imágenes sintéticas y reales [13] | 24,000 imágenes sintéticas y 16,000 fragmentos de imágenes RS que varían en la temporada real obtenidas por Google Earth, etiquetadas como cambiadas y sin cambios a nivel de píxeles. [Descargar] | |

| Levir-CD [14] | 637 pareja de parche de imagen de Google Earth (GE) de muy alta resolución (VHR, 0.5M/píxel) con un tamaño de 1024 × 1024 píxeles y contiene un total de 31,333 instancias de construcción de cambios individuales, etiquetados como cambiados y sin cambios a nivel de píxel. [Descargar] | |

| Conjunto de datos de incendios de Bastrop [21] | 4 imágenes adquiridas por diferentes sensores sobre el condado de Bastrop, Texas (EE. UU.). Está compuesto por un Landsat 5 TM como la imagen previa al evento y un Landsat 5 TM, un EO-1 Ali y un Landsat 8 como imágenes posteriores al evento, etiquetadas como cambiadas y sin cambios a nivel de píxel, principalmente causados por el incendio forestal. [Descargar] | |

| Conjunto de datos de Google [23] | 19 Imágenes VHR variables de la temporada con 3 bandas de rojo, verde y azul, una resolución espacial de 0.55 m y el tamaño que oscila entre 1006 × 1168 píxeles hasta 4936 × 5224 píxeles. Los cambios en la imagen incluyen aguas, carreteras, tierras de cultivo, tierra desnuda, bosques, edificios, barcos, etc. Los edificios constituyen los principales cambios. Adquirido durante los períodos entre 2006 y 2019, cubriendo las áreas del suburbio de la ciudad de Guangzhou, China. [Descargar] | |

| Óptico RS y SAR | Conjunto de datos de California [22] | 3 imágenes, incluida una imagen RS capturada por Landsat 8 con 9 canales en 2017, una imagen SAR capturada por Sentinel-1a (registrada en polarisaciones VV y VH) después de la ocurrencia de una inundación, y un mapa de verdad terrestre. [Descargar] |

| Conjunto de datos de CD homogéneo [30] | 6 Escenarios: Escenario 1 con dos conjuntos de datos de polarizaciones individuales; Escenario 2 con dos conjuntos de datos de Polsar; Escenario 3 con dos conjuntos de datos de imágenes ópticas. HeterogeneUscd: escenario 4 con dos conjuntos de datos SAR/ópticos (multiespectrales); Escenario 5 con dos conjuntos de datos multiespectrales de diferentes bandas adquiridas de diferentes sensores; Escenario 6 con conjuntos de datos Twopolsar/ópticos (multiespectrales). [Descargar] | |

| Vista a la calle | VL-CMU-CD [15] | 1362 Se registraron pares de RGB e imágenes de profundidad, cambio de verdad del suelo etiquetado (por ejemplo, contenedor, signo, vehículo, basura, construcción, cono de tráfico, persona/ciclo, barrera) y máscaras de cielo a nivel de píxeles. [Descargar] |

| PCD 2015 [16] | 200 pares de imágenes panorámicas en el subconjunto "tsunami" y "GSV", con el tamaño de 224 × 1024 píxeles, etiqueta como se cambia y no cambia a nivel de píxel. [Descargar] | |

| Cambiar el conjunto de datos de detección [17] | Secuencias de imagen de las calles de la ciudad capturadas por una cámara montada en el vehículo en dos puntos de tiempo diferentes, con el tamaño de 5000 × 2500 píxeles, la estructura de la escena 3D etiquetada cambia a nivel de píxeles. [Descargar] | |

| CV | CDNET 2012 [18] | 6 Categorías de video con 4 a 6 secuencias de videos en cada categoría, y las imágenes de Troundtruth contienen 5 etiquetas, a saber: estática, sombra dura, región externa de interés, movimiento desconocido (generalmente alrededor de objetos en movimiento, debido a la semi-transparencia y el desenfoque de movimiento) y el movimiento. [Descargar] |

| CDNET 2014 [19,20] | 22 videos adicionales (∼70; 000 marcos anotados con píxeles) que abarcan 5 nuevas categorías que incorporan desafíos encontrados en muchas configuraciones de vigilancia, y proporciona una cámara realista capturada (sin CGI), diversos conjuntos de videos interiores y exteriores como el CDNET 2012. [Descargar] | |

| ChangeSim [31] | Un conjunto de datos desafiante dirigido a la detección de cambios en la escena en línea y más, recolectando entornos de simulación fotorealista con la presencia de variaciones ambientales no dirigidas, como la turbidez del aire y los cambios en la condición de la luz, así como los cambios de objetos específicos en los entornos de interior industrial. [Descargar] | |

| Más conjuntos de datos de video | ||

Se puede ver que la cantidad de conjuntos de datos abiertos que se pueden usar para tareas de detección de cambios es pequeña, y algunos de ellos tienen pequeños tamaños de datos. En la actualidad, todavía hay una falta de grandes conjuntos de datos SAR que se pueden usar para el entrenamiento de IA. La mayoría de los métodos de detección de cambios basados en IA se basan en varios conjuntos de datos SAR que contienen tipos limitados de cambios, por ejemplo, el conjunto de datos de Bern, el conjunto de datos Ottawa, el conjunto de datos del río amarillo y el conjunto de datos de México, que no pueden satisfacer las necesidades de detección de cambios en áreas con una compleja cubierta de tierra y varios tipos de cambios. Además, sus etiquetas no están disponibles gratuitamente. Los conjuntos de datos de visión de la calle generalmente se utilizan para la investigación de métodos de detección de cambios basados en IA en la visión por computadora (CV). En CV, la detección de cambios basada en imágenes o videos también es un campo de investigación candente, y la idea básica es consistente con la basada en datos RS. Por lo tanto, además de los conjuntos de datos de imágenes de vistas a la calle, varios conjuntos de datos de video en CV también se pueden utilizar para la investigación sobre métodos de detección de cambios basados en IA, como CDNET 2012 y CDNET 2014.

El desarrollo de técnicas de detección de cambios basadas en IA ha facilitado enormemente muchas aplicaciones y ha mejorado su automatización e inteligencia. La mayoría de la detección de cambios basada en IA genera mapas binarios, y estos estudios solo se centran en el algoritmo en sí, sin un campo de aplicación específico. Por lo tanto, se puede considerar que generalmente son adecuados para la detección de cambios de LULC. En esta sección, nos centramos en las técnicas asociadas con aplicaciones específicas, y pueden dividirse ampliamente en cuatro categorías:

Proporcionamos una visión general de las diversas técnicas de detección de cambios en la literatura para las diferentes categorías de aplicaciones. Los trabajos y tipos de datos asociados con estas aplicaciones se enumeran en la Tabla 4.

| Aplicaciones | Tipos de datos | Papeles | |

|---|---|---|---|

| Contextos urbanos | Expansión urbana | Imágenes satelitales | Lyu et.al (2018), Tong et.al (2007) |

| Imágenes sar | Iino et.al (2017) | ||

| Gestión del espacio público | Imágenes de vistas a la calle | Varghese et.al (2018) | |

| Superficie de la carretera | Imágenes de UAV | Truong et.al (2020) | |

| Detección de cambio de edificio | Imágenes aéreas | Ji et.al (2019), Sun et.al (2019), Nemoto et.al (2017) | |

| Imágenes satelitales | Huang et.al (2019), Zhu et.al (2018) | ||

| Imágenes satelitales/aéreas | Jiang et.al (2020), Ji et.al (2018), Saha et.al (2020) | ||

| Datos de escaneo láser en el aire e imágenes aéreas | Zhang et.al (2019) | ||

| Imágenes sar | Jaturapitpornchai et.al (2019) | ||

| Imágenes satelitales y mapa SIG | Ghaffarian et.al (2019) | ||

| Recursos y entorno | Cambios ambientales impulsados por los humanos | Imágenes satelitales | Chen et.al (2016) |

| Cambios hidroambientales | Imágenes satelitales | Nourani et.al (2018) | |

| Hielo marino | Imágenes sar | Gao et.al (2019), Gao et.al (2019) | |

| Aguas superficiales | Imágenes satelitales | Song et.al (2019), Rokni et.al (2015) | |

| Monitoreo forestal | Imágenes satelitales | Khan et.al (2017), Lindquist et.al (2016), Deilmai et.al (2014), Woodcock et.al (2001), Gopal et.al (1996) | |

| Desastres naturales | Mapeo | Imágenes aéreas | Fang et.al (2020), Lei et.al (2019) |

| Imágenes satelitales | Chen et.al (2018), Ding et.al (2016), Tarantino et.al (2006) | ||

| Evaluación de daños | Imágenes satelitales | causado por Tsunami [Sublime et.al (2019), Singh et.al (2015)], un incidente particular [Hedjam et.al (2019)], Flood [Peng et.al (2019)], o terremoto [Ji et.AL (2019)] | |

| Imágenes aéreas | causado por Tsunami [Fujita et.al (2017)] | ||

| Imágenes sar | causado por incendios [Planinšič et.al (2018)], o terremoto [Saha et.al (2018)] | ||

| Imágenes de vistas a la calle | causado por tsunami [Sakurada et.al (2015)] | ||

| Imágenes de vistas a la calle y mapa SIG | causado por Tsunami [Sakurada et.al (2017)] | ||

| Astronomía | Superficies planetarias | Imágenes satelitales | Kerner et.al (2019) |

Actualmente hay una gran cantidad de software con herramientas de detección de cambios, y tenemos un breve resumen de ellas, ver Tabla 5.

| Tipo | Nombre | Descripción |

|---|---|---|

| Comercial | Erdas imagina | Proporciona un verdadero valor, consolidación de teledetección, fotogrametría, análisis LiDAR, análisis vectorial básico y procesamiento de radar en un solo producto, incluida una variedad de herramientas de detección de cambios. |

| Arcgis | La detección de cambios se puede calcular entre dos conjuntos de datos de trama utilizando la herramienta de calculadora de ráster o el flujo de trabajo de aprendizaje profundo. | |

| Envío | Proporciona herramientas de análisis de detección de cambios y el módulo de aprendizaje profundo ENVI. | |

| ecognición | Se puede utilizar para una variedad de mapeo de cambios, y al aprovechar la tecnología de aprendizaje profundo de la biblioteca Google Tensorflow ™, EcoGnition permite a los clientes con herramientas de reconocimiento y correlación de patrones altamente sofisticadas que automatizan la clasificación de objetos de interés para resultados más rápidos y precisos, más. | |

| PCI Geomatica | Proporciona herramientas de detección de cambios y puede ser útil en numerosas circunstancias en las que es posible que desee analizar el cambio, como: daño por tormentas, daños por bosques, inundaciones, expansión urbana y más. | |

| De sensación | Senseremote soluciones inteligentes de teledetección | |

| Código abierto | QGIS | Proporciona muchas herramientas de detección de cambios. |

| ORFOO Toolbox | Detección de cambio por algoritmo de detector de alteración multivariante (MAD). | |

| Cambiar la caja de herramientas de detección | Matlab Toolbox para detección de cambios de teledetección. |

Los siguientes documentos son útiles para que los investigadores comprendan mejor este campo de detección de cambios de teledetección, ver Tabla 6.

| Año publicado | Documento de revisión |

|---|---|

| 1989 | Técnicas de detección de cambio digital utilizando datos de detección remota, IJRS. [papel] |

| 2004 | Métodos de detección de cambio digital en el monitoreo del ecosistema: una revisión, IJRS. [papel] |

| 2004 | Técnicas de detección de cambios, IJRS. [papel] |

| 2012 | Detección de cambio basada en objetos, IJRS. [papel] |

| 2013 | Cambiar la detección de imágenes de detección remota: de enfoques basados en píxeles a objetos basados en objetos, ISPRS. [papel] |

| 2016 | Detección de cambios 3D -ACCEARDOS Y APLICACIONES, ISPRS. [papel] |

| 2016 | Aprendizaje profundo para datos de teledetección Un tutorial técnico sobre el estado del arte, MGRS. [papel] |

| 2017 | Encuesta integral del aprendizaje profundo en la teledetección: teorías, herramientas y desafíos para la comunidad, JRS. [papel] |

| 2017 | Aprendizaje profundo en la teledetección, MGRS. [papel] |

| 2018 | Inteligencia computacional en el procesamiento de imágenes de teledetección óptica, ASOC. [papel] |

| 2019 | Una revisión de la detección de cambios en imágenes hiperespectrales multitemporales: técnicas actuales, aplicaciones y desafíos, MGRS. [papel] |

| 2019 | Aprendizaje profundo en aplicaciones de teledetección: un metaanálisis y revisión, ISPRS. [papel] |

| 2020 | Aprendizaje profundo para la detección de cambios en imágenes de teledetección: revisión integral y metanálisis, ARXIV. [papel] |

| 2020 | Detección de cambios basada en la inteligencia artificial: de vanguardia y desafíos, Rs. [papel] |

[1] conjunto de datos de detección de cambio hiperespectral. Disponible en línea: https://citius.usc.es/investiguncion/datasets/hyperspectral-change-detection-dataset (consultado el 4 de mayo de 2020).

[2] Wang, Q.; Yuan, Z.; Du, Q.; Li, X. Getnet: un marco CNN 2-D general de extremo a extremo para la detección de cambios de imagen hiperespectrales. IEEE Trans. Geosci. Remote Sens. 2018, 57, 3–13. [Google Scholar] [CrossRef]

[3] Daudt, RC; Le Saux, B.; Boulch, A.; Gousseau, Y. Aprendizaje multitarea para detección de cambios semánticos a gran escala. Computación. VIS. Imagen entendida. 2019, 187, 102783. [Google Scholar] [CrossRef]

[4] Ji, S.; Wei, S.; Lu, M. Redes totalmente convolucionales para la extracción de edificios de varios pasos de un conjunto de datos de imágenes aéreas y satelitales abiertas. IEEE Trans. Geosci. Remote Sens. 2018, 57, 574–586. [Google Scholar] [CrossRef]

[5] Benedek, C.; Sziranyi, T. Detección de cambio en imágenes aéreas ópticas por un modelo de Markov mixto condicional multicapa. IEEE Trans. Geosci. Remote Sens. 2009, 47, 3416–3430. [Google Scholar] [CrossRef]

[6] Benedek, C.; Sziranyi, T. Un modelo mixto de Markov para la detección de cambios en fotos aéreas con grandes diferencias de tiempo. En Actas de la 19a Conferencia Internacional de Reconocimiento de Patrones de 2008, Tampa, FL, EE. UU., 8-11 de diciembre de 2008; pp. 1–4. [Google Scholar]

[7] Daudt, RC; Le Saux, B.; Boulch, A.; Gousseau, Y. Detección de cambios urbanos para la observación de la Tierra multiespectral utilizando redes neuronales convolucionales. En Actas de la IEEE International Geoscience and Remote Sensing Simposio de IEEE 2018, Valencia, España, 22–27 de julio de 2018; pp. 2115–2118. [Google Scholar]

[8] Zhang, M.; Shi, W. Una diferencia de diferencia Método de detección de cambio de cambio de red neuronal convolucional. IEEE Trans. Geosci. Remoto sens. 2020, 1–15. [Google Scholar] [CrossRef]

[9] Wu, C.; Zhang, L.; Zhang, L. Un marco de detección de cambio de escena para imágenes de detección remota de muy alta resolución multitemporal. Proceso de señal. 2016, 124, 184–197. [Google Scholar] [CrossRef]

[10] Fujita, A.; Sakurada, K.; Imaizumi, T.; Ito, R.; Hikosaka, S.; Nakamura, R. Detección de daños a partir de imágenes aéreas a través de redes neuronales convolucionales. En Actas de la Decimocoria Conferencia Internacional de IAPR 2017 sobre aplicaciones de visión artificial (MVA), Nagoya Univ, Nagoya, Japón, 12-12 de mayo de 2017; pp. 5–8 [Google Scholar]

[11] Gupta, R.; Goodman, b.; Patel, N.; Hosfelt, R.; Sajeev, S.; Heim, E.; Doshi, J.; Lucas, K.; Choset, H.; Gaston, M. Creación de XBD: un conjunto de datos para evaluar la construcción de daños a partir de imágenes satelitales. En Actas de la Conferencia IEEE sobre Visión por Computadora y Talleres de reconocimiento de patrones, Long Beach, CA, EE. UU., 16–20 de junio de 2019; pp. 10-17. [Google Scholar]

[12] Bourdis, N.; Maraud, D.; SAHBI, H. Flujo óptico restringido para la detección del cambio de imagen aérea. En Actas del Simposio Internacional de Geosciencia Internacional y Sensación Remota 2011, Vancouver, BC, Canadá, 24–29 de julio de 2011; pp. 4176–4179. [Google Scholar] [CrossRef]

[13] Lebedev, MA; Vizilter, yv; Vygolov, OV; Knyaz, VA; Rubis, la detección de cambios de AY en imágenes de teledetección utilizando redes adversas condicionales. ISPRS INT. Arco. Fotograma. SENS remoto. Inf. Sci. 2018, 565–571. [Google Scholar] [CrossRef]

[14] Chen, H.; Shi, Z. Un método espacial basado en la atención temporal y un nuevo conjunto de datos para la detección de cambios de imagen de detección remota. Sensación remota, 12 (10), 1662. [Google Scholar] [CrossRef]

[15] Alcantarilla, PF; Stent, S.; Ros, G.; Arroyo, R.; Gherardi, R. Detección de cambio de visión de visión de la calle con redes deconvolutivas. Auton. Robot. 2018, 42, 1301–1322. [Google Scholar] [CrossRef]

[16] Sakurada, K.; Okatani, T. Cambiar detección de un par de imágenes de calle utilizando características de CNN y segmentación de superpíxeles. In Proceedings of the British Machine Vision Conference (BMVC), Swansea, UK, 7–10 September 2015; pp. 61.1–61.12. [Google Scholar]

[17] Sakurada, K.; Okatani, T.; Deguchi, K. Detecting changes in 3D structure of a scene from multi-view images captured by a vehicle-mounted camera. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Portland, OR, USA, 23–28 June 2013; pp. 137–144. [Google Scholar]

[18] Goyette, N.; Jodoin, P.-M.; Porikli, F.; Konrad, J.; Ishwar, P. Changedetection. net: A new change detection benchmark dataset. In Proceedings of the 2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops, Providence, RI, USA, 16–21 June 2012; pp. 1–8. [Google Scholar]

[19] Wang, Y.; Jodoin, P.-M.; Porikli, F.; Konrad, J.; Benezeth, Y.; Ishwar, P. CDnet 2014: An Expanded Change Detection Benchmark Dataset. In Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition Workshops, Columbus, OH, USA, 23–28 June 2014; pp. 393–400. [Google Scholar]

[20] Goyette, N.; Jodoin, P.-M.; Porikli, F.; Konrad, J.; Ishwar, P. A Novel Video Dataset for Change Detection Benchmarking. IEEE Trans. Image Process. 2014, 23, 4663–4679. [Google Scholar] [CrossRef]

[21] Volpi, Michele; Camps-Valls, Gustau; Tuia, Devis (2015). Spectral alignment of multi-temporal cross-sensor images with automated kernel canonical correlation analysis; ISPRS Journal of Photogrammetry and Remote Sensing, vol. 107, pp. 50-63, 2015. [CrossRef]

[22] LT Luppino, FM Bianchi, G. Moser and SN Anfinsen. Unsupervised Image Regression for Heterogeneous Change Detection. IEEE Transactions on Geoscience and Remote Sensing. 2019, vol. 57, no. 12, pp. 9960-9975. [CrossRef]

[23] D. Peng, L. Bruzzone, Y. Zhang, H. Guan, H. Ding and X. Huang, SemiCDNet: A Semisupervised Convolutional Neural Network for Change Detection in High Resolution Remote-Sensing Images. IEEE Transactions on Geoscience and Remote Sensing. 2020. [CrossRef]

[24] Yang, Kunping, et al. Asymmetric Siamese Networks for Semantic Change Detection. arXiv preprint arXiv:2010.05687 (2020). [CrossRef]

[25] Zhang, C., Yue, P., Tapete, D., Jiang, L., Shangguan, B., Huang, L., & Liu, G. A deeply supervised image fusion network for change detection in high resolution bi-temporal remote sensing images. ISPRS Journal of Photogrammetry and Remote Sensing. 2020. [CrossRef]

[26] LEENSTRA, Marrit, et al. Self-supervised pre-training enhances change detection in Sentinel-2 imagery. arXiv. 2021. [CrossRef]

[27] SHI, Qian, et al. A Deeply Supervised Attention Metric-Based Network and an Open Aerial Image Dataset for Remote Sensing Change Detection. IEEE Transactions on Geoscience and Remote Sensing. 2021. [CrossRef]

[28] SHEN, Li, et al. S2Looking: A Satellite Side-Looking Dataset for Building Change Detection. arXiv. 2021. [CrossRef]

[29] LEBEDEV, MA, et al. CHANGE DETECTION IN REMOTE SENSING IMAGES USING CONDITIONAL ADVERSARIAL NETWORKS. International Archives of the Photogrammetry, Remote Sensing & Spatial Information Sciences, 2018. [CrossRef]

[30] SUN, Yuli, et al. Structure Consistency-Based Graph for Unsupervised Change Detection With Homogeneous and Heterogeneous Remote Sensing Images. IEEE Transactions on Geoscience and Remote Sensing, 2021. [CrossRef]

[31] PARK, Jin-Man, et al. ChangeSim: Towards End-to-End Online Scene Change Detection in Industrial Indoor Environments. arXiv. 2021. [CrossRef]

If you find this review helpful to you, please consider citing our paper. [Open Access]

@Article{rs12101688,

AUTHOR = {Shi, Wenzhong and Zhang, Min and Zhang, Rui and Chen, Shanxiong and Zhan, Zhao},

TITLE = {Change Detection Based on Artificial Intelligence: State-of-the-Art and Challenges},

JOURNAL = {Remote Sensing},

VOLUME = {12},

YEAR = {2020},

NUMBER = {10},

ARTICLE-NUMBER = {1688},

URL = {https://www.mdpi.com/2072-4292/12/10/1688},

ISSN = {2072-4292},

DOI = {10.3390/rs12101688}

}

This list will be updated in time, and volunteer contributions are welcome. For questions or sharing, please feel free to contact us or make issues.