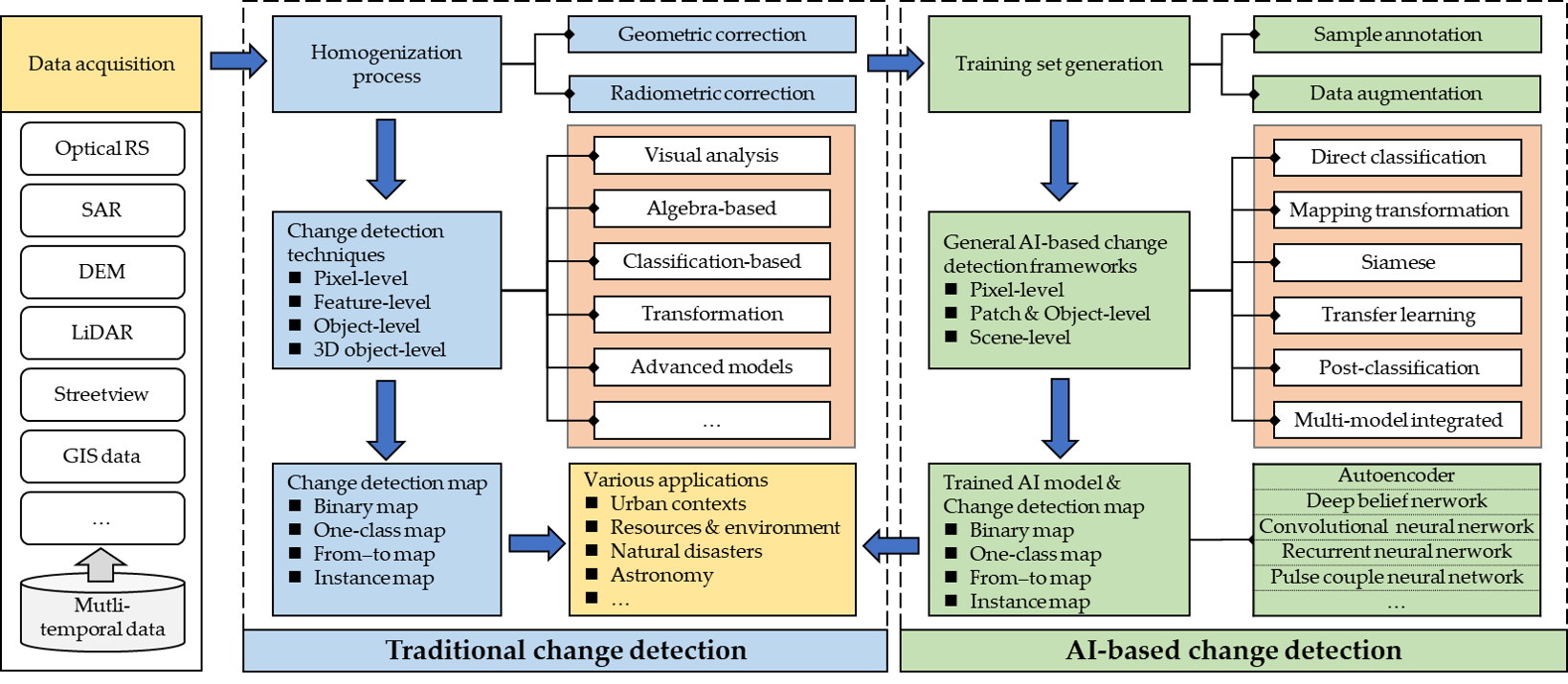

Die Änderungserkennung basierend auf den Daten der Fernerkundung (RS) ist eine wichtige Methode zur Erkennung von Änderungen auf der Erdoberfläche und hat eine breite Palette von Anwendungen in der Stadtplanung, der Umweltüberwachung, der Untersuchung der Landwirtschaft, der Katastrophenbewertung und der Kartendrehlegung. In den letzten Jahren hat sich die integrierte Technologie für künstliche Intelligenz (AI) zu einem Forschungsschwerpunkt bei der Entwicklung neuer Veränderungserkennungsmethoden entwickelt. Obwohl einige Forscher behaupten, dass die Ansätze zur Erkennung von Änderungen zur Erkennung von KI-basierten traditionellen Änderungen erfunden werden, ist es nicht sofort offensichtlich, wie und inwieweit KI die Leistung der Änderungserkennung verbessern kann. Diese Übersicht konzentriert sich auf die modernsten Methoden, Anwendungen und Herausforderungen der KI für die Erkennung von Veränderungen. Insbesondere wird zunächst der Implementierungsprozess der KI-basierten Änderungserkennung eingeführt. Anschließend werden die Daten aus verschiedenen Sensoren verwendet, die zur Änderungserkennung verwendet werden, einschließlich optischer RS -Daten, Daten der synthetischen Aperturradar (SAR), Straßenansichtsbilder und kombinierten heterogenen Daten, und die verfügbaren offenen Datensätze werden ebenfalls aufgeführt. Die allgemeinen Rahmenbedingungen von KI-basierten Änderungserkennungsmethoden werden systematisch überprüft und analysiert, und die bei der KI-basierten Änderungserkennung verwendeten unbeaufsichtigten Schemata werden weiter analysiert. Anschließend werden die häufig verwendeten Netzwerke in AI zur Änderungserkennung beschrieben. Aus praktischer Sicht werden die Anwendungsdomänen von AI-basierten Änderungserkennungsmethoden anhand ihrer Anwendbarkeit klassifiziert. Schließlich werden die größten Herausforderungen und Aussichten für KI zur Erkennung von Veränderungen erörtert und abgegrenzt, einschließlich (a) heterogener Big -Data -Verarbeitung, (b) unbeaufsichtigter KI und (c) die Zuverlässigkeit von AI. Diese Überprüfung wird für Forscher von Vorteil sein, um dieses Gebiet zu verstehen.

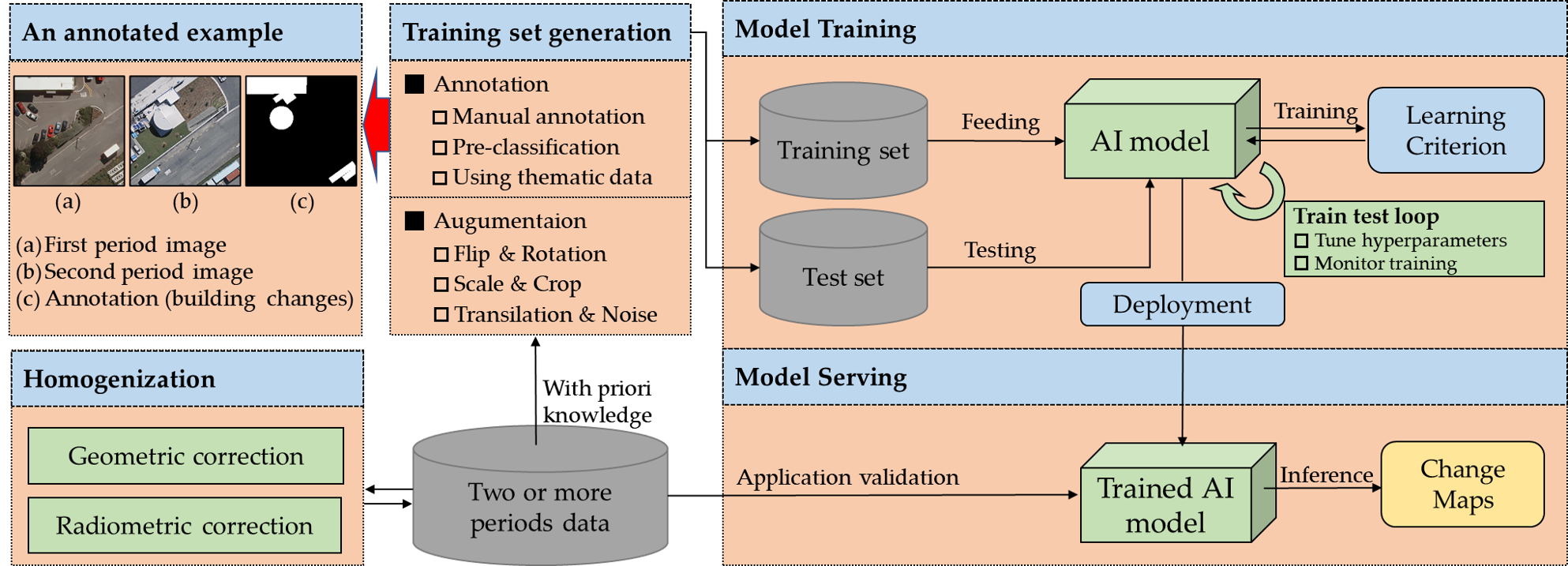

Abbildung 2 liefert einen allgemeinen Implementierungsprozess der KI-basierten Änderungserkennung, aber die Struktur des KI-Modells ist vielfältig und muss nach verschiedenen Anwendungssituationen und den Schulungsdaten gut gestaltet werden. Es ist erwähnenswert, dass vorhandene reife Frameworks wie Tensorflow, Keras, Pytorch und Caffe den Forschern helfen, das Design, das Training und die Bereitstellung von KI -Modellen leichter zu erkennen, und ihre Entwicklungsdokumente liefern detaillierte Einführungen.

| Methoden | Schlüsselwörter | Veröffentlichung | (RE) Implementierung |

|---|---|---|---|

| Srcdnet | CNN; Siamese; Aufmerksamkeit; Superauflösung; Optischer Rs | Superauflösungsbasiertes Änderungserkennungsnetzwerk mit gestapeltem Aufmerksamkeitsmodul für Bilder mit unterschiedlichen Auflösungen, TGRs, 2021. [Papier], [Code, Datensatz] | Pytorch 1.2 |

| Escnet | CNN; Siamese; Superpixel; Optischer Rs | Ein End-to-End-Superpixel-verstärkter Änderungserkennungsnetzwerk für Remote-Erfassungsbilder mit sehr hoher Auflösung. Tnnls, 2021. [Papier], [Code] | Pytorch 1.3 |

| Kpcamnet | CNN; Siamese; KPCA; Unbeaufsichtigt; Optischer Rs | Unüberwachte Änderungserkennung in multitemporalen VHR -Bildern basierend auf dem Tiefenkern -PCA -Faltungskartendetzwerk, TCYB, 2021. [Papier], [Code] | Python |

| Seco | CNN (resnet); Transferlernen; Optischer Rs | Saisonaler Kontrast: unbeaufsichtigtes Vorbild von nicht abgelegenen Fernerkundungsdaten, Arxiv, 2021. [Papier], [Code, Datensatz] | Pytorch 1.7 |

| Capsnet | Kapselnetz (Segcaps); CVA; Siamese; Optischer Rs | Pseudo-Samese-Kapselnetz für Luftfernerfassungsbilder ändern die Erkennung, GRSL, 2020. [Papier 1], Änderung des Kapselnetzwerks für optische Fernerkundungen Imagechange Detection, RS, 2021. [Papier 2], [Code, Datensatz] | Keras |

| Bit_cd | CNN (resnet18); Siamese; Aufmerksamkeit; Transformator; Optischer Rs | Remote-Erfassungsbild-Änderungserkennung mit Transformatoren, TGRs, 2021. [Papier], [Code, Datensatz, vorgebildetes Modell] | Pytorch 1.6 |

| IAG_CDNET | CNN (Gaugan+unet); Siamese; Gan; Beaufsichtigt; Optischer Rs | Übergreifende Instanzvergrößerung zum Erstellen von Änderungserkennung in Fernerkundungsbildern, TGRS, 2021. [Papier], [Code, Datensatz] | Pytorch |

| DDNET | CNN; Di+fcm; Unbeaufsichtigt; Sar | Ändern Sie die Erkennung in Radarbildern der synthetischen Apertur mit einem Dual-Domain-Netzwerk, GRSL, 2021. [Papier], [Code, Datensatz] | Pytorch |

| Snunet-CD | CNN (Nestedunet); Siamese; Aufmerksamkeit; Beaufsichtigt; Optischer Rs | SNUNET-CD: Ein dicht verbundenes siamesisches Netzwerk zur Änderung der Erkennung von VHR-Bildern, GRSL, 2021. [Papier], [Code, Datensatz, vorgebildetes Modell] | Pytorch 1.4 |

| DSMSCN | CNN; Siamese; Multi-Scale; Unbeaufsichtigt/überwacht; Optischer Rs | Ein tief betreutes Bildfusionsnetzwerk zur Änderungserkennung in hochauflösenden BI-Temporal Remote SENING-Bildern, Arxiv, 2020. [Papier], [Code, Datensatz] | Tensorflow 1.9 |

| Siamcrnn | CNN+RNN; Siamese; Multi-Source; Optischer Rs | Erkennung in Multisource-VHR-Bildern über tiefe siamesische Faltungsfaltungsmultiples-mehrschichtiger neuronales Netzwerk, TGRS, 2020. [Papier], [Code, Datensatz] | Tensorflow 1.9 |

| DSifn | CNN; Aufmerksamkeitsmechanismus; Optischer Rs | Ein tief beaufsichtigter Bildfusionsnetzwerk zur Änderungserkennung in hochauflösenden BI-Temporal Remote SENING-Bildern, ISPRS, 2020. [Papier], [Code, Datensatz] | Pytorch & Keras |

| CEECNET | CNN; Aufmerksamkeitsmechanismus; Ähnlichkeitsmaßnahme; Optischer Rs | Auf der Suche nach Veränderungen? Rollen Sie die Würfel und fordern Sie Aufmerksamkeit, Arxiv, 2020. [Papier], [Code, Datensatz] | Mxnet + Python |

| Lamboisenet | CNN (Licht unet ++); Optischer Rs | Ändern Sie die Erkennung in Satellitenbildern mit Deep Learning, Master Thesis. [Code, Datensatz, vorgebildetes Modell] | Pytorch |

| Dtcdscn | CNN; Siamese | Erstellen von Änderungen Erkennung für Fernerkundungsbilder mithilfe eines doppelten Tiefse -Faltungsnetzwerkmodells, der überprüft wird. [Code, Datensatz] | Pytorch |

| Landbedeckungsanalyse | CNN (unet); Postklassifizierung; Optischer Rs | Die Erkennung von Landnutzung/Landbedeckung in Zyklon betroffenen Gebiete unter Verwendung von Faltungsnetzwerken. [Bericht], [Code, Datensatz, vorgebildetes Modell] | Tensorflow+Keras |

| Corrfusionnet | CNN; Szenenebene; Siamese; Optischer Rs | Korrelationsbasiertes Fusionsnetzwerk zur multi-zeitlichen Szenenklassifizierung und Änderungserkennung, Untersuchung. [Code, vorgebildetes Modell], [Datensatz] | Tensorflow 1.8 |

| SSCDNET | CNN (resnet18); Siamese; Transferlernen; Semantisch; StreetView | Schwach beaufsichtigte Silhouette-basierte semantische Szenenänderungserkennung, ICRA, 2020. [Papier] [Code, Datensatz, vorgebildetes Modell] | Pytorch+Python3.6 |

| Heterogenous_cd | AE (Code-ausgerichtete AE); Unbeaufsichtigt; Transformation; Heterogen; Optischer Rs | Code-ausgerichtete Autocoder für unbeaufsichtigte Änderungserkennung in multimodalen Fernerkundungsbildern, Arxiv, 2020. [Papier] [Code, Datensatz] | Tensorflow 2.0 |

| Fdcnn | CNN (VGG16); Transferlernen; Reinseamesische; Multi-Scale; Optischer Rs | Eine Merkmalsdifferenz-Faltungsverkleidung der neuronalen Netzwerk-basierten Änderungserkennungsmethode, TGRS, 2020. [Papier] [Code, Datensatz, vorgebildetes Modell] | Kaffe+Python2.7 |

| Stanet | CNN (Resnet-18); Aufmerksamkeitsmechanismus; Reinseamesische; Räumlich -zeitliche Abhängigkeit; Optischer Rs | Eine räumlich-zeitlich aufmerksamkeitsbasierte Methode und ein neuer Datensatz für die Erkennung von Remote-Sensing-Bildänderungen, RS, 2020. [Papier] [Code, Datensatz] | Pytorch+Python3.6 |

| X-net | CNN; Unbeaufsichtigt; Transformation; Heterogen; Optischer RS; Sar | Deep-Image-Übersetzung mit einer affinitätsbasierten Änderung Prior für unbeaufsichtigte multimodale Änderungserkennung, 2020. [Papier] [Code, Datensatz] | Tensorflow 1.4 |

| ACE-NET | AE (kontroverse zyklische Encoder); Unbeaufsichtigt; Transformation; Heterogen; Optischer RS; Sar | Deep-Image-Übersetzung mit einer affinitätsbasierten Änderung Prior für unbeaufsichtigte multimodale Änderungserkennung, 2020. [Papier] [Code, Datensatz] | Tensorflow 1.4 |

| VGG_LR | CNN (VGG16); Transferlernen; Reinseamesische; Slic; Niedrige Ränge; Optischer Rs | Änderungserkennung basierend auf tiefen Merkmalen und niedrigem Rang, GRSL, 2017. [Papier] [Reimplementierungscode, Datensatz, vorgebildetes Modell] | Kaffe+Matlab |

| CDNET | CNN; Siamese; Multimodale Daten; Punktwolkendaten | Erkennung von Gebäudenwechsel zwischen in der Luft befindlichen Laser -Scan- und photogrammetrischen Daten, RS, 2019. [Papier], [Code] | Pytorch |

| SCCN | Ae (dae); Unbeaufsichtigt; Heterogen; Optischer RS; Sar | Ein tiefes Faltungskupplungsnetzwerk zur Änderungserkennung basierend auf heterogenen optischen und Radarbildern, TNNLS, 2018. [Papier] [Reimplementationscode] | Tensorflow 2.0 |

| Cgan | Gan (bedingte Gan); Heterogen; Optischer RS; Sar | Ein bedingter kontroverses Netzwerk zur Änderungserkennung in heterogenen Bildern, GRSL, 2019. [Papier] [Reimplementationscode] | Tensorflow 2.0 |

| Dasnet | CNN (VGG16); Siamese; Aufmerksamkeitsmechanismus; Optischer Rs | DASNET: Doppelte aufmerksame, voll faltungsvolle siamesische Netzwerke zur Änderung der Erkennung hochauflösender Satellitenbilder, Arxiv, 2020. [Papier] [Code, Datensatz, vorgebildetes Modell] | Pytorch+Python3.6 |

| Unetlstm | CNN (unet); RNN (LSTM); Integriertes Modell; Optischer Rs | Erkennen städtischer Veränderungen mit wiederkehrenden neuronalen Netzwerken aus multitemporalen Sentinel-2-Daten, Igars, 2019. [Papier] [Code, Datensatz, vorgebildetes Modell] und [Code] | Pytorch+Python3.6 |

| CDMI-NET | CNN (unet); Reinseamesische; Multiple Instance -Lernen; Landslide -Kartierung; Optischer Rs | Tiefes mehrfaches Instanzlernen für Erdrutsch-Mapping, GrSL, 2020. [Papier] [Code, vorgebildetes Modell] | Pytorch+Python3.6 |

| Dsfanet | DNN; Unbeaufsichtigt; Vorklassifizierung; Langsame Merkmalsanalyse; Optischer Rs | Unbewegte Tiefe langsame Merkmalsanalyse zur Änderungserkennung in multi-zeitlichen Fernerkundungsbildern, TGRS, 2019. [Papier] [Code, Datensatz] | Tensorflow 1.7 |

| CD-Unet ++ | CNN (verbesserte Unet ++); Direkte Klassifizierung; Optischer Rs | End-to-End-Änderungserkennung für hochauflösende Satellitenbilder mit verbesserten Unet ++, RS, 2019. [Papier] [Code] | Tensorflow+Keras |

| Siamesenet | CNN (VGG16); Reinseamesische; Optischer Rs | Siamese-Netzwerk mit Multi-Level-Funktionen für die Patch-basierte Änderungserkennung in Satellitenbildern, GlobalSIP, 2018. [Papier] [Code, Dataset] | Tensorflow+Keras |

| Re3fcn | CNN (Convlstm); PCA; 3D -Faltung; Veränderungen mit mehreren Klassen; Optischer RS; Hyperspektral | Erkennung in hyperspektralen Bildern mit rezidivierenden 3D -Faltungsnetzwerken, RS, 2018. [Papier] [Code, Datensatz] | Tensorflow+Keras |

| FC-EF, FC-SIAM-CONC, FC-SIAM-DIFF | CNN (unet); Reinseamesische; Optischer Rs | Vollgeschnittene siamesische Netzwerke zur Änderungserkennung, ICIP, 2018. [Papier] [Code, Datensatz] | Pytorch |

| Cosimnet | CNN (Deeptlab V2); Reinseamesische; StreetView | Veränderungen lernen: vollständig faltungsvolle siamesische metrische Netzwerke für die Erkennung von Szenenänderungen, Arxiv, 2018. [Papier] [Code, Datensatz, vorgebildetes Modell] | Pytorch+Python2.7 |

| Mask R-CNN | Mask R-CNN (Resnet-101); Transferlernen; Postklassifizierung; Optischer Rs | Slumsegmentierung und Änderungserkennung: Ein Deep-Learning-Ansatz, NIPS, 2018. [Papier] [Code, Datensatz, vorgebildetes Modell] | Tensorflow+Keras |

| Kaffeet | CNN (Caffenet); Unbeaufsichtigt; Transferlernen; Optischer Rs | Faltungsverkleidung neuronaler Netzwerkfunktionen basiert Änderungserkennung in Satellitenbildern, IWPR, 2016. [Papier] [Code, Datensatz] | Tensorflow+Keras |

| Cwnn | CNN (CWNN); Unbeaufsichtigt; Vorklassifizierung; Sar | Die Erkennung von Meereisänderungen in SAR-Bildern basierend auf Neuralnetzwerken mit Faltungswavelet, GRSL, 2019. [Papier] [Code, Datensatz] | Matlab |

| Mlfn | CNN (Densenet); Transferlernen; Sar | Übertragte Deep -Lernen für Meereisänderung Erkennung von synthetischen Apertur -Radarbildern, Grsl, 2019. [Papier] [Code, Datensatz] | Kaffe+Matlab |

| Garborpcanet | CNN (pcanet); Unbeaufsichtigt; Vorklassifizierung; Gabor Wavelets; Sar | Automatische Änderungserkennung in Radarbildern der synthetischen Apertur basierend auf PCANET, GRSL, 2016. [Papier] [Code, Datensatz] | Matlab |

| Ms-capsnet | CNN (MS-CAPSNet); Kapsel; Aufmerksamkeitsmechanismus; Adaptive Fusion -Faltung; Sar | Erkennung in SAR -Bildern basierend auf Multiscale Capsule Network, GRSL, 2020. [Papier] [Code, Datensatz] | MATLAB+Keras2.16 |

| DCNET | CNN; Unbeaufsichtigt; Vorklassifizierung; Sar | Änderung der Erkennung aus synthetischen Apertur-Radarbildern basierend auf Kanalgewichten basierendem Deep Cascade-Netzwerk, JStar, 2019. [Papier] [Code, Datensatz] | Kaffe |

| Veränderung | CNN; Siamese; StreetView | Changenet: Eine tiefe Lernarchitektur für die Erkennung visueller Änderung, ECCV, 2018. [Papier] [Code, Datensatz] | Pytorch |

| Andere werden bald hinzugefügt! | |||

| Methoden | Schlüsselwörter | Veröffentlichung | Durchführung |

|---|---|---|---|

| Mehrere klassische Methoden | CVA; DPCA; Bilddifferenzierung; Bildverhältnis; Bildregression; Ir-mad; VERRÜCKT; Pcakmeans; PCDA; Kmeans; OTSU; Feste Schwelle | Eine Toolbox für die Erkennung von Fernerkundungen. [Code] | Matlab |

| MATLAB Toolbox -Erkennung ändern | Ir-mad; IT-PCA; Ähm; ICM | Eine Toolbox für unbeaufsichtigte Änderungserkennungsanalyse, IJRS, 2016. [Papier] [Code] | Matlab |

| RFR, SVR, GPR | Unbeaufsichtigt; Bildregression; Heterogen; Optischer RS; Sar | Unüberwachte Bildregression zur heterogenen Änderungserkennung, TGRS, 2019. [Papier] [Code] | Matlab |

| Hpt | Unbeaufsichtigt; Transformation; Heterogen; Optischer RS; Sar | Änderung der Nachweis in heterogenen Fernerkundungsbildern über homogene Pixeltransformation, Tipp, 2018. [Papier] [Papierpapier | Matlab |

| KCCA | Kanonische Korrelationsanalyse; Cross-Sensor; Optischer Rs | Spektrale Ausrichtung von multitemporalen Quer-Sensor-Bildern mit automatisierter Kernelkorrelationsanalyse, IJPRS, 2015. [Papier] [Code] | Matlab |

| Ker. Diff. RBF | Unbeaufsichtigt; K-means; Optischer Rs | Unüberwachte Änderungserkennung mit Kernels, GrSL, 2012. [Papier] [Code] | Matlab |

| FDA-RM | DI-basiert; Frequenzdomänenanalyse; Zufällige Multigraphen; Sar | Erkennung von Synthetic Aperture Radar Bildänderung basierend auf der Frequenzdomänenanalyse und zufälligen Multigraphen, Jars, 2018. [Papier] [Code] | Matlab |

| CD-nr-elm | DI-basiert; Vorklassifizierung; Extreme Lernmaschine; Sar | Änderung der Erkennung von Radarbildern der synthetischen Apertur basierend auf dem nachbarschaftsbasierten Verhältnis und extremer Lernmaschine, Jars, 2016. [Papier] [Code, Datensatz] | Matlab |

| Keiner | Wahrscheinlichkeitsverhältnis; Teststatistik; Sar | Erkennung ändern in polarimetrischen SAR -Bildern, 2015. [Bericht] [Code] | Python |

| PCA K-Means | Unbeaufsichtigt; DI-basiert; PCA; K bedeutet; Optischer Rs | Unüberwachte Änderungserkennung in Satellitenbildern unter Verwendung der Hauptkomponentenanalyse und der K-Mittel-Clustering, GRSL, 2009. [Papier] [Wiederauflagencode, Datensatz] oder [Neuauflagencode] | Matlab |

| PTCD | Tensor; Hyperspektrale optische Rs | Tucker-Zersetzung und Rekonstruktionsdetektor für nicht überwachte hyperspektrale Änderungserkennung. JStars, 2021. [Papier] [Code, Datensatz] | Matlab |

| GBF-CD | Datenfusion; Graph; Em; Ki; | Graph-basierte Datenfusion angewendet auf: Erkennung und Biomasseschätzung in Reispflanzen. Fernerkundung, 2020 [Papier] [Code, Datensatz] | Matlab |

| Andere werden bald hinzugefügt! | |||

Derzeit gibt es einige frei verfügbare Datensätze zur Änderungserkennung, die als Benchmark -Datensätze für die AI -Schulung und die Genauigkeitsbewertung in zukünftigen Forschung verwendet werden können. Detaillierte Informationen sind in Tabelle 3 dargestellt.

| Typ | Datensatz | Beschreibung |

|---|---|---|

| Optischer Rs | DSIFN -Datensatz [25] | 6 Bi-Temporale hochauflösende Bilder von Google Earth. Es gibt 3600 Bildpaare mit einer Größe von 512 × 512 für das Training, 340 für die Validierung und 48 für den Test. [Herunterladen] |

| S2MTCP [26] | 1520 Sentinel-2 Level 1C-Bildpaare konzentrierten sich auf städtische Gebiete auf der ganzen Welt mit einer räumlichen Auflösung von 10 m und der Größe von 600 x 600 Pixel. Geometrische oder radiometrische Korrekturen werden nicht durchgeführt. [Herunterladen] | |

| Sysu-cd [27] | 20000 Paare von 0,5-m-Luftbildern der Größe 256 × 256 zwischen den Jahren 2007 und 2014 in Hongkong, einschließlich 6 Veränderungsarten: (a) neu gebaute städtische Gebäude; (b) Vorortdilatation; (c) Grundlagen vor dem Bau; (d) Vegetationswechsel; (e) Straßenerweiterung; (f) Meeresbau. [Herunterladen] | |

| S2looking [28] | Der Datensatz zur Erstellung von Änderungserkennungen besteht aus 5000 registrierten Bitemporal -Bildpaaren (Größe von 1024*1024, 0,5 ~ 0,8 m/Pixel) ländlicher Gebiete weltweit und mehr als 65.920 annotierte Änderungsinstanzen, wobei das neu gebaute und abgerissene Gebäude getrennt angibt [Download] | |

| Datensatz für synthetische und reale Bilder [29] | Die Datenbank enthält 12.000 dreifache synthetische Bilder ohne Objektverschiebung, 12.000 Dreifachmodellbilder mit Objektverschiebung und 16.000 Dreifachfragmente realer Fernerkundungsbilder. Durchführte Tests haben gezeigt, dass der vorgeschlagene CNN vielversprechend und effizient genug ist, um die Erkennung von Veränderungen auf synthetischen und realen Bildern zu erkennen [Download] | |

| Semantische Änderungserkennungsdatensatz (zweite) [24] | Ein annotierter semantischer Änderungserkennungsdatensatz auf Pixelebene, einschließlich 4662 Paare von Luftbildern mit 512 x 512 Pixel von mehreren Plattformen und Sensoren, die Hangzhou, Chengdu und Shanghai abdecken. Es konzentriert sich auf 6 Haupt-Land-Cover-Klassen, dh nicht vegetierte Bodenoberfläche, Baum, niedrige Vegetation, Wasser, Gebäude und Spielplätze, die häufig an natürlichen und künstlichen geografischen Veränderungen beteiligt sind. [Herunterladen] | |

| Hyperspektraländerungserkennungsdatensatz [1] | 3 verschiedene hyperspektrale Szenen, die von Aviris oder Hyperionsensor mit 224 oder 242 Spektralbändern erfasst wurden, markierten 5 Arten von Änderungen, die mit Ernteübergängen auf Pixelebene zusammenhängen. [Herunterladen] | |

| River HSIS -Datensatz [2] | 2 HSIS in der Provinz Jiangsu, China, mit 198 Bands, die als verändert und unverändert auf Pixelebene bezeichnet werden. [Herunterladen] | |

| HRSCD [3] | 291 Co-registrierte Paare von RGB-Luftbildern mit Veränderung und Landbedeckungsanmerkungen auf Pixelebene, die hierarchische Veränderungsbezeichnungen bereitstellen. Zu den Etiketten der Stufe 1 gehören fünf Klassen: Keine Informationen, künstliche Oberflächen, landwirtschaftliche Gebiete, Wälder, Feuchtgebiete und Wasser. [Herunterladen] | |

| WHU BAU -Datensatz [4] | 2-periodische Luftbilder mit 12.796 Gebäuden sowie Gebäudevektor- und Rasterkarten. [Herunterladen] | |

| Sztaki Air Change Benchmark [5, 6] | 13 Luftbildpaare mit einer räumlichen Auflösung von 1,5 m, auf Pixelebene als verändert und unverändert. [Herunterladen] | |

| OSCD [7] | 24 Paare von multispektralen Bildern, die von Sentinel-2 aufgenommen wurden und auf Pixelebene als verändert und unverändert gekennzeichnet sind. [Herunterladen] | |

| Erkennungsdatensatz ändern [8] | 4 Paare von multispektralen Bildern mit unterschiedlichen räumlichen Auflösungen, die auf Pixelebene als verändert und unverändert gekennzeichnet sind. [Herunterladen] | |

| MTS-WH [9] | 2 große VHR-Bilder, die von Ikonos-Sensoren mit 4 Bändern und einer räumlichen Auflösung von 1 M aufgenommen wurden, markierten 5 Arten von Änderungen (dh Parkplätze, spärliche Häuser, Wohnregion und Vegetationsregion) auf Szene. [Herunterladen] | |

| ABCD [10] | 16.950 Paare von RGB -Luftbildern zum Erkennen gewaschener Gebäude durch Tsunami, gekennzeichnete beschädigte Gebäude auf Szene. [Herunterladen] | |

| XBD [11] | Satelliten-Imagerien vor und nach der Entlassung zur Bewertung von Gebäudenschäden mit über 850.000 Gebäuden von Polygonen aus 6 Katastertypen, die auf Pixelebene mit 4 Schadensskalen gekennzeichnet sind. [Herunterladen] | |

| AICD [12] | 1000 Paare von synthetischen Luftbildern mit künstlichen Änderungen, die mit einer Rendering -Engine erzeugt werden, die als verändert und unverändert auf Pixelebene gekennzeichnet ist. [Herunterladen] | |

| Datenbank mit synthetischen und realen Bildern [13] | 24.000 synthetische Bilder und 16.000 Fragmente realer Saison-variierender RS-Bilder, die von Google Earth erhalten wurden und auf Pixelebene als verändert und unverändert bezeichnet werden. [Herunterladen] | |

| Levir-CD [14] | 637 Sehr hochauflösende (VHR, 0,5 m/Pixel) Google Earth (GE) -Pick-Patch-Paare mit einer Größe von 1024 × 1024 Pixel und enthält insgesamt 31.333 individuelle Änderungen, die als geändert und unverändert auf Pixelebene gekennzeichnet sind. [Herunterladen] | |

| Bastrop Fire Dataset [21] | 4 Bilder, die von verschiedenen Sensoren über den Bastrop County, Texas (USA), aufgenommen wurden. Es besteht aus einem Landsat 5 TM als Vorabbild und einem Landsat 5 TM, einem EO-1 ALI und einem Landsat 8 als nach dem Ereignis, die als verändert und unverändert auf Pixelebene gekennzeichnet sind und hauptsächlich durch Wildfire verursacht wurden. [Herunterladen] | |

| Google -Datensatz [23] | 19 Saisonvariante VHR-Bilder Paare 3 Bänder aus Rot, Grün und Blau, eine räumliche Auflösung von 0,55 m und die Größe zwischen 1006 × 1168 Pixel bis 4936 × 5224 Pixel. Die Bildänderungen umfassen Gewässer, Straßen, Ackerland, nacktes Land, Wälder, Gebäude, Schiffe usw. Gebäude bilden die Hauptänderungen. In den Zeiträumen zwischen 2006 und 2019 übernommen und umfasst die Vorortgebiete von Guangzhou City, China. [Herunterladen] | |

| Optischer RS & SAR | California Dataset [22] | 3 Bilder, darunter ein RS-Bild von Landsat 8 mit 9 Kanälen zu 2017, einem SAR-Bild, das von Sentinel-1A (in Polarisations VV und VH aufgezeichnet) nach dem Auftreten einer Flut und einer Bodenwahrscheinungskarte aufgenommen wurde. [Herunterladen] |

| Homogener CD -Datensatz [30] | 6 Szenarien: Szenario 1 mit zwei Einzelpolarisationsdatensätzen; Szenario 2 mit zwei Polsar -Datensätzen; Szenario 3 mit zwei optischen Bilddatensätzen. Heterogenouscd: Szenario 4 mit zwei SAR/optischen (multispektralen) Datensätzen; Szenario 5 mit zwei multispektralen Datensätzen verschiedener von verschiedenen Sensoren; Szenario 6 mit Twopolsar/Optical (multispektralen) Datensätzen. [Herunterladen] | |

| Street View | VL-CMU-CD [15] | 1362 Co-registrierte Paare von RGB- und Tiefenbildern, markierte Bodenwahrheitsänderung (z. B. Bin, Zeichen, Fahrzeug, Abfall, Bau, Verkehrskegel, Person/Zyklus, Barriere) und Sky-Masken auf Pixelebene. [Herunterladen] |

| PCD 2015 [16] | 200 Panorama -Bildpaare in "Tsunami" und "GSV" -Subset mit der Größe von 224 × 1024 Pixel, die auf Pixelebene verändert und unverändert sind. [Herunterladen] | |

| Erkennungsdatensatz ändern [17] | Bildsequenzen von Stadtstraßen, die von einer mit Fahrzeug montierten Kamera zu zwei verschiedenen Zeitpunkten aufgenommen wurden, wobei die Größe von 5000 × 2500 Pixel mit der Bezeichnung der 3D-Szenenstruktur auf Pixelebene ändert. [Herunterladen] | |

| Cv | CDnet 2012 [18] | 6 Videokategorien mit 4 bis 6 Videossequenzen in jeder Kategorie, und die Bodentruth-Bilder enthalten 5 Beschriftungen, nämlich statisch, harter Schatten, außerhalb der Interesse, unbekannte Bewegung (normalerweise um bewegliche Objekte, aufgrund von Halbtransparenz und Bewegungsunschärfe) und Bewegung. [Herunterladen] |

| CDNET 2014 [19,20] | 22 zusätzliche Videos (~ 70; 000 Pixel-Weise kommentierte Frames), die 5 neue Kategorien umfassen, die in vielen Überwachungseinstellungen Herausforderungen enthalten und realistische, Kamera erfasst (ohne CGI), eine vielfältige Reihe von Indoor- und Outdoor-Videos wie CDNE 2012. [Download] | |

| Änderungsim [31] | Ein herausfordernder Datensatz, der auf die Erkennung von Online-Szenen und mehr abzielt, um in foto-realistischen Simulationsumgebungen mit nicht-zielgerichteten Variationen wie Lufttrübung und leichten Zustandsänderungen sowie zielgerichteten Objektänderungen in industriellen Innenumgebungen zu sammeln. [Herunterladen] | |

| Weitere Video -Datensätze | ||

Es ist ersichtlich, dass die Menge der offenen Datensätze, die zur Änderungserkennungsaufgaben verwendet werden können, gering ist und einige von ihnen kleine Datengrößen haben. Gegenwärtig mangelt es immer noch an großen SAR -Datensätzen, die für das KI -Training verwendet werden können. Die meisten KI-basierten Änderungserkennungsmethoden basieren auf mehreren SAR-Datensätzen, die nur begrenzte Arten von Änderungen enthalten, z. B. der Bern-Datensatz, den Ottawa-Datensatz, den gelben Flussdatensatz und den Datensatz von Mexiko, der den Anforderungen der Änderungserkennung in Bereichen mit komplexen Landbedeckungen und verschiedenen Änderungen nicht erfüllen kann. Darüber hinaus sind ihre Etiketten nicht frei verfügbar. Street-View-Datensätze werden im Allgemeinen zur Erforschung von AI-basierten Änderungserkennungsmethoden in Computer Vision (CV) verwendet. In CV ist die Änderung der Erkennung basierend auf Bildern oder Videos auch ein heißes Forschungsfeld, und die Grundidee steht im Einklang mit dieser basierend auf RS -Daten. Neben Street View-Bilddatensätzen können auch mehrere Videodatensätze in CV für die Forschung zu KI-basierten Änderungserkennungsmethoden wie CDNE 2012 und CDNE 2014 verwendet werden.

Die Entwicklung von KI-basierten Veränderungserkennungstechniken hat viele Anwendungen stark erleichtert und ihre Automatisierung und Intelligenz verbessert. Die meisten KI-basierten Änderungenerkennung erzeugen Binärkarten, und diese Studien konzentrieren sich nur auf den Algorithmus selbst, ohne ein bestimmtes Anwendungsfeld. Daher kann berücksichtigt werden, dass sie im Allgemeinen für die Erkennung von LULC -Änderungen geeignet sind. In diesem Abschnitt konzentrieren wir uns auf die Techniken, die mit bestimmten Anwendungen verbunden sind, und sie können weitgehend in vier Kategorien unterteilt werden:

Wir bieten einen Überblick über die verschiedenen Änderungserkennungstechniken in der Literatur für die verschiedenen Anwendungskategorien. Die mit diesen Anwendungen zugeordneten Arbeitstypen und Datentypen sind in Tabelle 4 aufgeführt.

| Anwendungen | Datentypen | Papiere | |

|---|---|---|---|

| Urbane Kontexte | Städtische Expansion | Satellitenbilder | Lyu et al. (2018), Tong ET.Al (2007) |

| SAR Bilder | Iino et al. (2017) | ||

| Öffentliches Raumfahrtmanagement | Street View -Bilder | Varghese et al. (2018) | |

| Straßenoberfläche | UAV -Bilder | Truong ET.Al (2020) | |

| Erkennung von Veränderungen | Luftbilder | JI et al. (2019), Sun et al. (2019), Nemoto et al. (2017) | |

| Satellitenbilder | Huang et al. (2019), Zhu et al. (2018) | ||

| Satelliten-/Luftbilder | Jiang et al. (2020), Ji et al. (2018), Saha et al. (2020) | ||

| Laser -Scandaten und Luftbilder in der Luft in der Luft befestigt | Zhang et al. (2019) | ||

| SAR Bilder | Jaturapitpornchai et al. (2019) | ||

| Satellitenbilder und GIS -Karte | Ghaffarian ET.Al (2019) | ||

| Ressourcen und Umgebung | Umweltveränderungen von Menschen | Satellitenbilder | Chen et al. (2016) |

| Hydro-Umweltveränderungen | Satellitenbilder | Nourani et al. (2018) | |

| Meereis | SAR Bilder | Gao et al. (2019), Gao et al. (2019) | |

| Oberflächenwasser | Satellitenbilder | Song ET.AL (2019), Rokni et al. (2015) | |

| Waldüberwachung | Satellitenbilder | Khan et al. (2017), Lindquist et al. (2016), Deilmai et al. (2014), Woodcock ET. | |

| Naturkatastrophen | Landslide -Kartierung | Luftbilder | Fang et al. (2020), Lei et al. (2019) |

| Satellitenbilder | Chen et al. (2018), Ding et al. (2016), Tarantino et al. (2006) | ||

| Schadensbewertung | Satellitenbilder | verursacht durch Tsunami [Sublime et al. | |

| Luftbilder | verursacht durch Tsunami [Fujita et al. (2017)] | ||

| SAR Bilder | verursacht durch Brände [Planinšič et al. (2018)] oder Erdbeben [Saha et al. (2018)] | ||

| Street View -Bilder | verursacht durch Tsunami [Sakurada et al. (2015)] | ||

| Street View -Bilder und GIS -Karte | verursacht durch Tsunami [Sakurada et al. (2017)] | ||

| Astronomie | Planetenflächen | Satellitenbilder | Kerner et al. (2019) |

Derzeit gibt es eine große Anzahl von Software mit Änderungserkennungstools, und wir haben eine kurze Zusammenfassung davon, siehe Tabelle 5.

| Typ | Name | Beschreibung |

|---|---|---|

| Kommerziell | Erdas stellen sich vor | bietet echten Wert, Konsolidierung der Fernerkundung, Photogrammetrie, Lidar -Analyse, grundlegende Vektoranalyse und Radarverarbeitung in ein einzelnes Produkt, einschließlich einer Vielzahl von Änderungserkennungswerkzeugen. |

| Arcgis | Die Änderungserkennung kann zwischen zwei Raster -Datensätzen berechnet werden, indem der Raster -Taschenrechner -Tool oder den Deep -Learning -Workflow verwendet wird. | |

| Envi | Bietet Tools für Änderungserkennungsanalyse und das Envi Deep Learning Modul. | |

| Ecognition | Kann für eine Vielzahl von Veränderungen verwendet werden, und durch die Nutzung von Deep -Lern -Technologie aus der Google TensorFlow ™ -Bibliothek ermöglicht Ecognition Kunden mit hoch entwickelten Mustererkennungs- und Korrelations -Tools, die die Klassifizierung von Interessenobjekten für schnellere und genauere Ergebnisse automatisieren. | |

| PCI Geomatica | Bietet Änderungserkennungsinstrumente und kann unter zahlreichen Umständen nützlich sein, unter denen Sie möglicherweise Veränderungen analysieren möchten, wie z. | |

| Sensetime | Senseremote Fernerkundung intelligenter Lösungen | |

| Open Source | Qgis | Bietet viele Änderungserkennungswerkzeuge. |

| Orfeo Toolbox | Änderung der Erkennung durch multivariaten Veränderungsdetektor -Algorithmus (MAD). | |

| Erkennungswerkzeugkasten ändern | MATLAB TOOLBOX für die Erkennung von Fernerkundungen. |

Die folgenden Arbeiten sind für Forscher hilfreich, um dieses Feld der Erkennung von Remote -Erfassungsänderungen besser zu verstehen, siehe Tabelle 6.

| Veröffentlichtes Jahr | Überprüfungspapier |

|---|---|

| 1989 | Erkennungstechniken für digitale Veränderungen mit remote erfundenen Daten, IJRs. [Papier] |

| 2004 | Erkennungsmethoden für digitale Veränderungen bei der Überwachung von Ökosystemen: Eine Überprüfung, IJRS. [Papier] |

| 2004 | Erkennungstechniken ändern, ijrs. [Papier] |

| 2012 | Objektbasierte Änderungserkennung, IJRS. [Papier] |

| 2013 | Erkennung von remote erfundenen Bildern ändern: von pixelbasiert zu objektbasierten Ansätzen, ISPRS. [Papier] |

| 2016 | 3D -Änderungserkennung - Annahmen und Anwendungen, ISPRS. [Papier] |

| 2016 | Deep Learning for Remote Sensing -Daten Ein technisches Tutorial zum Stand der Technik, MGRS. [Papier] |

| 2017 | Umfassende Untersuchung des tiefen Lernens in der Fernerkundung: Theorien, Werkzeuge und Herausforderungen für die Community, JRS. [Papier] |

| 2017 | Tiefes Lernen in der Fernerkundung, MGRS. [Papier] |

| 2018 | Computational Intelligence in der optischen Fernerkundung Bildverarbeitung, ASOC. [Papier] |

| 2019 | Eine Überprüfung der Änderungserkennung in multitemporalen hyperspektralen Bildern: Aktuelle Techniken, Anwendungen und Herausforderungen, MGRs. [Papier] |

| 2019 | Deep Learning in Fernerkundungsanwendungen: Eine Metaanalyse und Überprüfung, ISPRS. [Papier] |

| 2020 | Deep Learning for Change-Erkennung in Fernerkundungsbildern: umfassende Überprüfung und Metaanalyse, Arxiv. [Papier] |

| 2020 | Änderungserkennung auf der Grundlage künstlicher Intelligenz: hochmoderne und Herausforderungen, Rs. [Papier] |

[1] Hyperspektrale Änderungserkennungsdatensatz. Online verfügbar: https://citius.usc.es/investigacion/datasets/hyperspectral-change-dection-dataset (zugegriffen am 4. Mai 2020).

[2] Wang, Q.; Yuan, Z.; Du, Q.; Li, X. getNet: Ein allgemeines End-to-End-2-D-CNN-Framework zur Erkennung hyperspektraler Bildänderung. IEEE Trans. Geosci. Remote Sens. 2018, 57, 3–13. [Google Scholar] [Crossref]

[3] Daudt, RC; Le saux, b.; Boulch, A.; Gousseau, Y. Multitasking-Lernen für groß angelegte semantische Veränderungserkennung. Computer. Vis Bild verstanden. 2019, 187, 102783. [Google Scholar] [Crossref]

[4] Ji, S.; Wei, S.; LU, M. Vollständige Faltungsnetzwerke für die Multisource -Building -Extraktion aus einem offenen Luft- und Satellitenbilder -Datensatz. IEEE Trans. Geosci. Remote Sens. 2018, 57, 574–586. [Google Scholar] [Crossref]

[5] Benedek, C.; Sziranyi, T. Erkennung in optischen Luftbildern durch ein multilayeres konditionales gemischtes Markov -Modell. IEEE Trans. Geosci. Remote Sens. 2009, 47, 3416–3430. [Google Scholar] [Crossref]

[6] Benedek, C.; Sziranyi, T. Ein gemischtes Markov -Modell zur Änderungserkennung auf Luftaufnahmen mit großen Zeitunterschieden. In Proceedings der 19. Internationalen Konferenz über Musteranerkennung 2008, Tampa, FL, USA, 8. bis 11. Dezember 2008; S. 1–4. [Google Scholar]

[7] Daudt, RC; Le saux, b.; Boulch, A.; Gousseau, Y. Erkennung von Städtischen Veränderungen zur multispektralen Erdbeobachtung unter Verwendung von Faltungsnetzwerken. In Proceedings of the Igars 2018 IEEE International Geowissenschaft und Fernerkundungssymposium, Valencia, Spanien, 22. bis 27. Juli 2018; S. 2115–2118. [Google Scholar]

[8] Zhang, M.; Shi, W. Ein Feature-Differenz-Faltungsverfahren für neuronale netzwerkbasierte Änderungserkennungsmethode. IEEE Trans. Geosci. Remote Sens. 2020, 1–15. [Google Scholar] [Crossref]

[9] Wu, C.; Zhang, L.; Zhang, L. Ein Szenenänderungs-Erkennungsrahmen für multi-zeitliche, sehr hochauflösende Fernerkundungsbilder. Signalprozess. 2016, 124, 184–197. [Google Scholar] [Crossref]

[10] Fujita, A.; Sakurada, K.; Imaizumi, T.; Ito, R.; Hikosaka, S.; Nakamura, R. Schadenserkennung durch Luftbilder über Faltungsnetze. In Proceedings of the 2017 Fifteenth IAPR International Conference on Machine Vision Applications (MVA), Nagoya Univ, Nagoya, Japan, 08. -12. Mai 2017; S. 5–8 [Google Scholar]

[11] Gupta, R.; Goodman, b.; Patel, N.; Hosfelt, R.; Sajeev, S.; Heim, e.; Doshi, J.; Lucas, K.; Choset, H.; Gaston, M. Erstellen von XBD: Ein Datensatz zur Beurteilung von Schäden aus den Satellitenbildern. In Proceedings of the IEEE Conference zu Workshops für Computer Vision und Mustererkennung, Long Beach, CA, USA, 16. bis 20. Juni 2019; S. 10–17. [Google Scholar]

[12] Bourdis, N.; Marraud, D.; Sahbi, H. eingeschränkte optische Fluss für die Erkennung von Luftbildänderungen. In Proceedings of the 2011 IEEE International Geowissenschaft und Fernerkundungssymposium, Vancouver, BC, Kanada, 24. bis 29. Juli 2011; S. 4176–4179. [Google Scholar] [Crossref]

[13] Lebedev, MA; Vizilter, YV; Vygolov, OV; Knyaz, VA; Rubis, ay ändern die Erkennung in Fernerkundungsbildern unter Verwendung von bedingten widersprüchlichen Netzwerken. Isprs int. Bogen. Photogramm. Remote Sens. Spat. Inf. Sci. 2018, 565–571. [Google Scholar] [Crossref]

[14] Chen, H.; Shi, Z. Eine räumlich-zeitlich aufmerksamkeitsbasierte Methode und ein neuer Datensatz für die Erkennung von Remote-Erfassungsbildänderungen. Fernerkundung, 12 (10), 1662. [Google Scholar] [Crossref]

[15] Alcantarilla, PF; Stent, S.; Ros, G.; Arroyo, R.; Gherardi, R. Street-View-Änderung der Erkennung von dekonvolutionellen Netzwerken. Auton. Roboter. 2018, 42, 1301–1322. [Google Scholar] [CrossRef]

[16] Sakurada, K.; Okatani, T. Change detection from a street image pair using CNN features and superpixel segmentation. In Proceedings of the British Machine Vision Conference (BMVC), Swansea, UK, 7–10 September 2015; pp. 61.1–61.12. [Google Scholar]

[17] Sakurada, K.; Okatani, T.; Deguchi, K. Detecting changes in 3D structure of a scene from multi-view images captured by a vehicle-mounted camera. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Portland, OR, USA, 23–28 June 2013; pp. 137–144. [Google Scholar]

[18] Goyette, N.; Jodoin, P.-M.; Porikli, F.; Konrad, J.; Ishwar, P. Changedetection. net: A new change detection benchmark dataset. In Proceedings of the 2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops, Providence, RI, USA, 16–21 June 2012; pp. 1–8. [Google Scholar]

[19] Wang, Y.; Jodoin, P.-M.; Porikli, F.; Konrad, J.; Benezeth, Y.; Ishwar, P. CDnet 2014: An Expanded Change Detection Benchmark Dataset. In Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition Workshops, Columbus, OH, USA, 23–28 June 2014; pp. 393–400. [Google Scholar]

[20] Goyette, N.; Jodoin, P.-M.; Porikli, F.; Konrad, J.; Ishwar, P. A Novel Video Dataset for Change Detection Benchmarking. IEEE Trans. Image Process. 2014, 23, 4663–4679. [Google Scholar] [CrossRef]

[21] Volpi, Michele; Camps-Valls, Gustau; Tuia, Devis (2015). Spectral alignment of multi-temporal cross-sensor images with automated kernel canonical correlation analysis; ISPRS Journal of Photogrammetry and Remote Sensing, vol. 107, pp. 50-63, 2015. [CrossRef]

[22] LT Luppino, FM Bianchi, G. Moser and SN Anfinsen. Unsupervised Image Regression for Heterogeneous Change Detection. IEEE Transactions on Geoscience and Remote Sensing. 2019, vol. 57, no. 12, pp. 9960-9975. [CrossRef]

[23] D. Peng, L. Bruzzone, Y. Zhang, H. Guan, H. Ding and X. Huang, SemiCDNet: A Semisupervised Convolutional Neural Network for Change Detection in High Resolution Remote-Sensing Images. IEEE Transactions on Geoscience and Remote Sensing. 2020. [CrossRef]

[24] Yang, Kunping, et al. Asymmetric Siamese Networks for Semantic Change Detection. arXiv preprint arXiv:2010.05687 (2020). [CrossRef]

[25] Zhang, C., Yue, P., Tapete, D., Jiang, L., Shangguan, B., Huang, L., & Liu, G. A deeply supervised image fusion network for change detection in high resolution bi-temporal remote sensing images. ISPRS Journal of Photogrammetry and Remote Sensing. 2020. [CrossRef]

[26] LEENSTRA, Marrit, et al. Self-supervised pre-training enhances change detection in Sentinel-2 imagery. Arxiv. 2021. [CrossRef]

[27] SHI, Qian, et al. A Deeply Supervised Attention Metric-Based Network and an Open Aerial Image Dataset for Remote Sensing Change Detection. IEEE Transactions on Geoscience and Remote Sensing. 2021. [CrossRef]

[28] SHEN, Li, et al. S2Looking: A Satellite Side-Looking Dataset for Building Change Detection. Arxiv. 2021. [CrossRef]

[29] LEBEDEV, MA, et al. CHANGE DETECTION IN REMOTE SENSING IMAGES USING CONDITIONAL ADVERSARIAL NETWORKS. International Archives of the Photogrammetry, Remote Sensing & Spatial Information Sciences, 2018. [CrossRef]

[30] SUN, Yuli, et al. Structure Consistency-Based Graph for Unsupervised Change Detection With Homogeneous and Heterogeneous Remote Sensing Images. IEEE Transactions on Geoscience and Remote Sensing, 2021. [CrossRef]

[31] PARK, Jin-Man, et al. ChangeSim: Towards End-to-End Online Scene Change Detection in Industrial Indoor Environments. Arxiv. 2021. [CrossRef]

If you find this review helpful to you, please consider citing our paper. [Open Access]

@Article{rs12101688,

AUTHOR = {Shi, Wenzhong and Zhang, Min and Zhang, Rui and Chen, Shanxiong and Zhan, Zhao},

TITLE = {Change Detection Based on Artificial Intelligence: State-of-the-Art and Challenges},

JOURNAL = {Remote Sensing},

VOLUME = {12},

YEAR = {2020},

NUMBER = {10},

ARTICLE-NUMBER = {1688},

URL = {https://www.mdpi.com/2072-4292/12/10/1688},

ISSN = {2072-4292},

DOI = {10.3390/rs12101688}

}

This list will be updated in time, and volunteer contributions are welcome. For questions or sharing, please feel free to contact us or make issues.