Implementación de Pytorch de GOLE AL PROGUNO: Resumen con redes de Generator Pointer

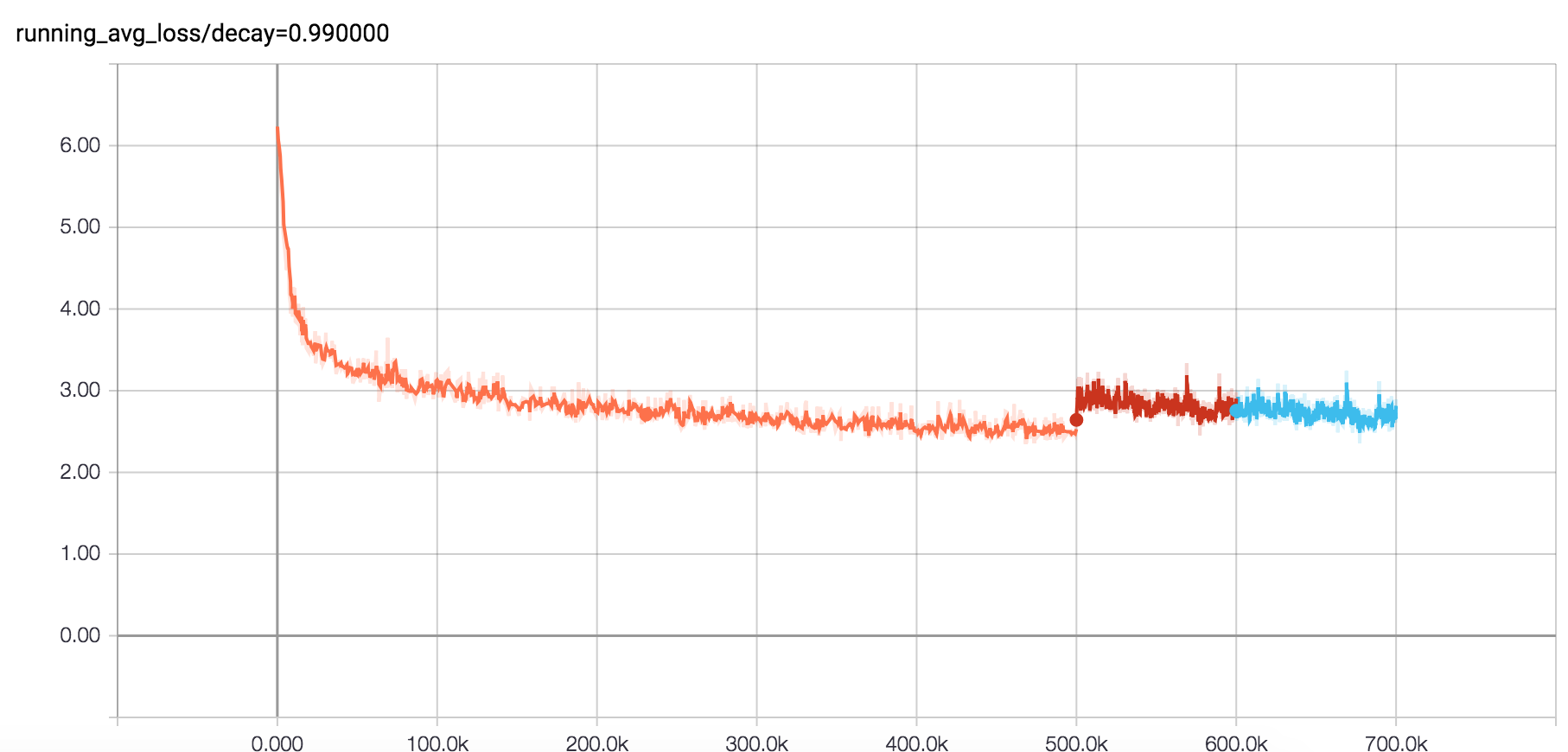

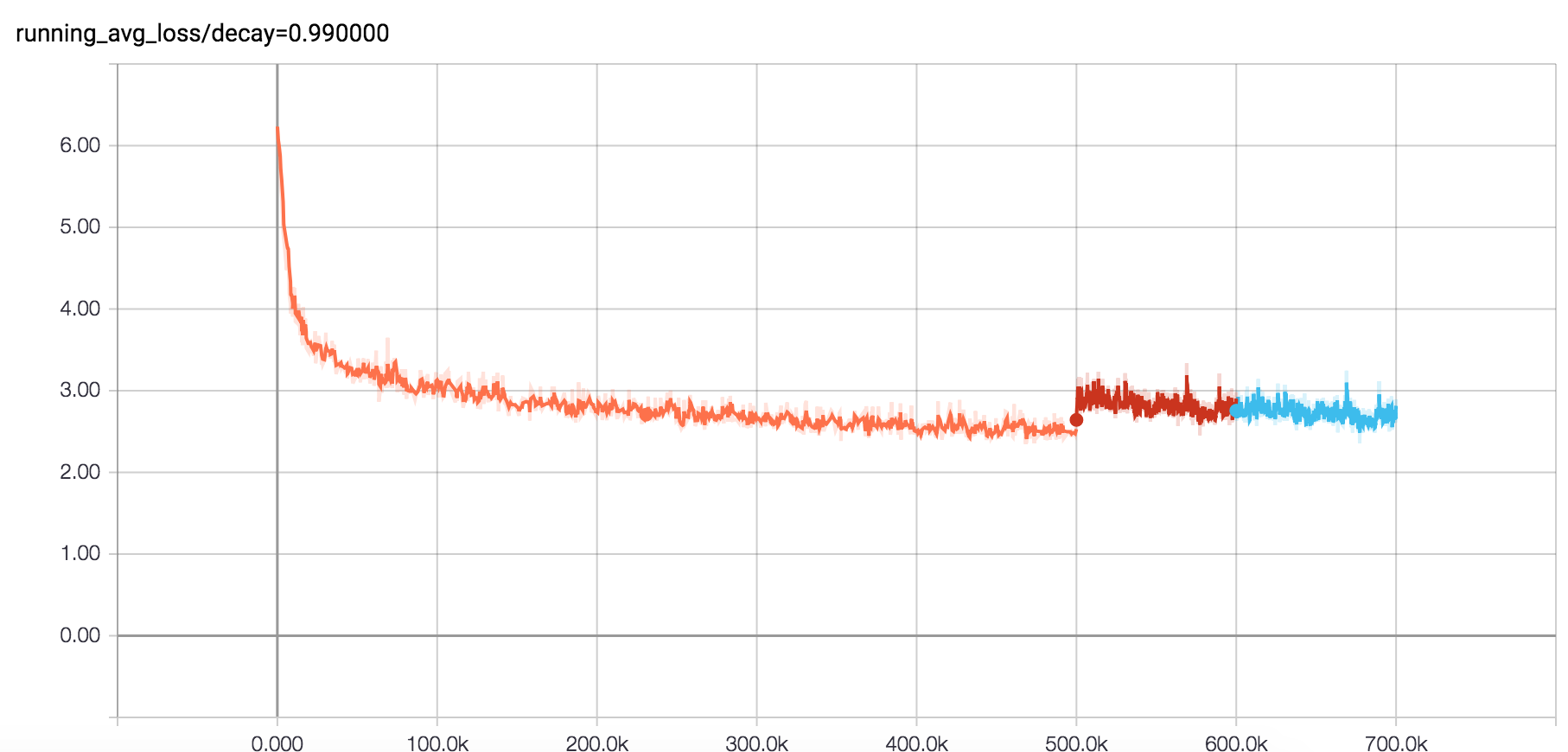

- Entrena con generación de puntero y pérdida de cobertura habilitada

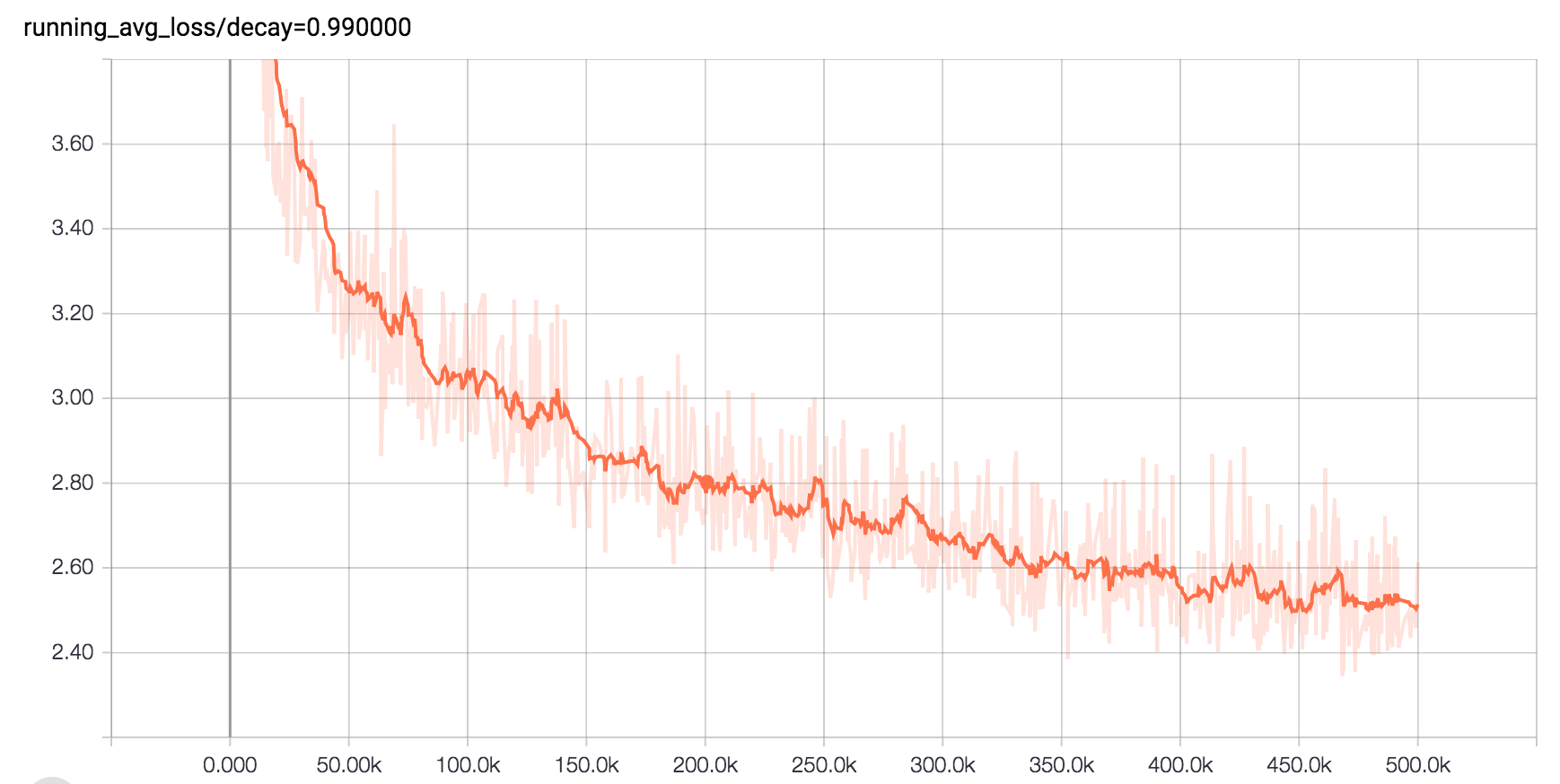

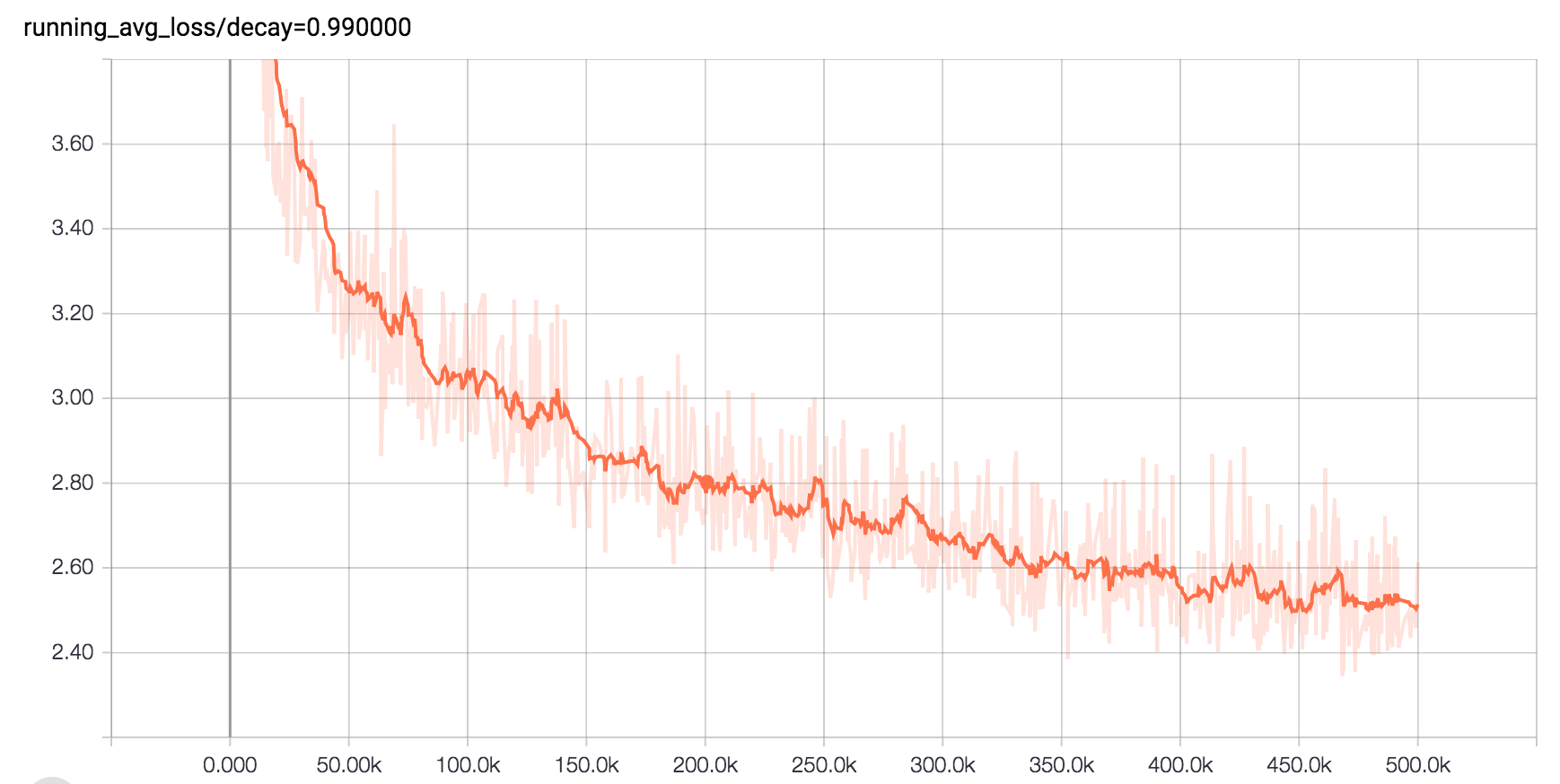

- Entrenamiento con generación de puntero habilitado

- Cómo ejecutar el entrenamiento

- Documentos que usan este código

Entrena con generación de puntero y pérdida de cobertura habilitada

Después del entrenamiento para 100k iteraciones con pérdida de cobertura habilitada (tamaño de lote 8)

ROUGE-1:

rouge_1_f_score: 0.3907 with confidence interval (0.3885, 0.3928)

rouge_1_recall: 0.4434 with confidence interval (0.4410, 0.4460)

rouge_1_precision: 0.3698 with confidence interval (0.3672, 0.3721)

ROUGE-2:

rouge_2_f_score: 0.1697 with confidence interval (0.1674, 0.1720)

rouge_2_recall: 0.1920 with confidence interval (0.1894, 0.1945)

rouge_2_precision: 0.1614 with confidence interval (0.1590, 0.1636)

ROUGE-l:

rouge_l_f_score: 0.3587 with confidence interval (0.3565, 0.3608)

rouge_l_recall: 0.4067 with confidence interval (0.4042, 0.4092)

rouge_l_precision: 0.3397 with confidence interval (0.3371, 0.3420)

Entrenamiento con generación de puntero habilitado

Después del entrenamiento para 500k iteraciones (tamaño de lote 8)

ROUGE-1:

rouge_1_f_score: 0.3500 with confidence interval (0.3477, 0.3523)

rouge_1_recall: 0.3718 with confidence interval (0.3693, 0.3745)

rouge_1_precision: 0.3529 with confidence interval (0.3501, 0.3555)

ROUGE-2:

rouge_2_f_score: 0.1486 with confidence interval (0.1465, 0.1508)

rouge_2_recall: 0.1573 with confidence interval (0.1551, 0.1597)

rouge_2_precision: 0.1506 with confidence interval (0.1483, 0.1529)

ROUGE-l:

rouge_l_f_score: 0.3202 with confidence interval (0.3179, 0.3225)

rouge_l_recall: 0.3399 with confidence interval (0.3374, 0.3426)

rouge_l_precision: 0.3231 with confidence interval (0.3205, 0.3256)

Cómo ejecutar el entrenamiento:

- Siga la instrucción de generación de datos desde https://github.com/abisee/cnn-dailymail

- Ejecute start_train.sh, es posible que deba cambiar alguna ruta y parámetros en data_util/config.py

- Para el entrenamiento, ejecute start_train.sh, para decodificar ejecutar start_decode.sh y para evaluar run_eval.sh

Nota:

En el modo de decodificación, el lote de búsqueda del haz debe tener solo un ejemplo replicado al tamaño del lote https://github.com/atulkum/pointer_summarizer/blob/master/training_ptr_gen/decode.py#l109 https://github.com/atulkum/pointer_summarizer/blob/data_utolil/bathypy.pypy.pypy.pypy.pypy.pypy.

Se prueba en Pytorch 0.4 con Python 2.7

Necesitas configurar Pyrouge para obtener el puntaje Rouge

Documentos que usan este código:

- Síntesis de programas automáticos de programas largos con un recopilador de basura erudito Neuroips 2018 https://github.com/amitz25/pccoder

- Modificación automática de oraciones guiadas por hechos AAAI 2020 https://github.com/darsh10/split_encoder_pointer_summarizer

- Resucitar la submodularidad en el resumen de abstracción neuronal

- Structsum: resumen a través de representaciones estructuradas EACL 2021

- Red de puntero conceptual para resumen abstracto EMNLP'2019 https://github.com/wprojectsn/codes

- Versión de paddlepaddle

- Modelo abstracto basado en VAE-PGN en arquitectura de varias etapas para resumen de texto INLG2019

- Clickbait? Generación de titulares sensacional con aprendizaje de refuerzo automático EMNLP'2019 https://github.com/hltchkust/sensational_headline

- Resumen de documentos hablados de abstractive utilizando un modelo jerárquico con interpelo de optimización de diversidad de atención en varias etapas Interspepo 2020

- Nutribullets híbrido: resumen de salud de múltiples documentos NAACL 2021

- Un corpus de resúmenes científicos muy cortos conlle 2020

- Hacia la fidelidad en la generación de tabla a texto de dominio abierto desde una visión centrada en la entidad AAAI 2021

- CDEVALSUMM: Un estudio empírico de la evaluación entre dataset para los resultados de los sistemas de resumen neuronal de EMNLP2020

- Un estudio sobre SEQ2SEQ para la compresión de las oraciones en el Pacéjo Vietnamita 2020

- ¡Otros roles importan! Mejora de la resumen del diálogo orientado a roles a través de interacciones de roles ACL 2022