Offizieller Code für das Papier " Segelflugzeug: Globaler und lokaler anlehender Expertenrouter ". Unsere Codebasis basiert auf Phatgoose.

SLIDER -LOLVE-IN/-OUT-Aufgaben mit einer Sammlung von spezialisierten Experten wie Lora gleichzeitig!

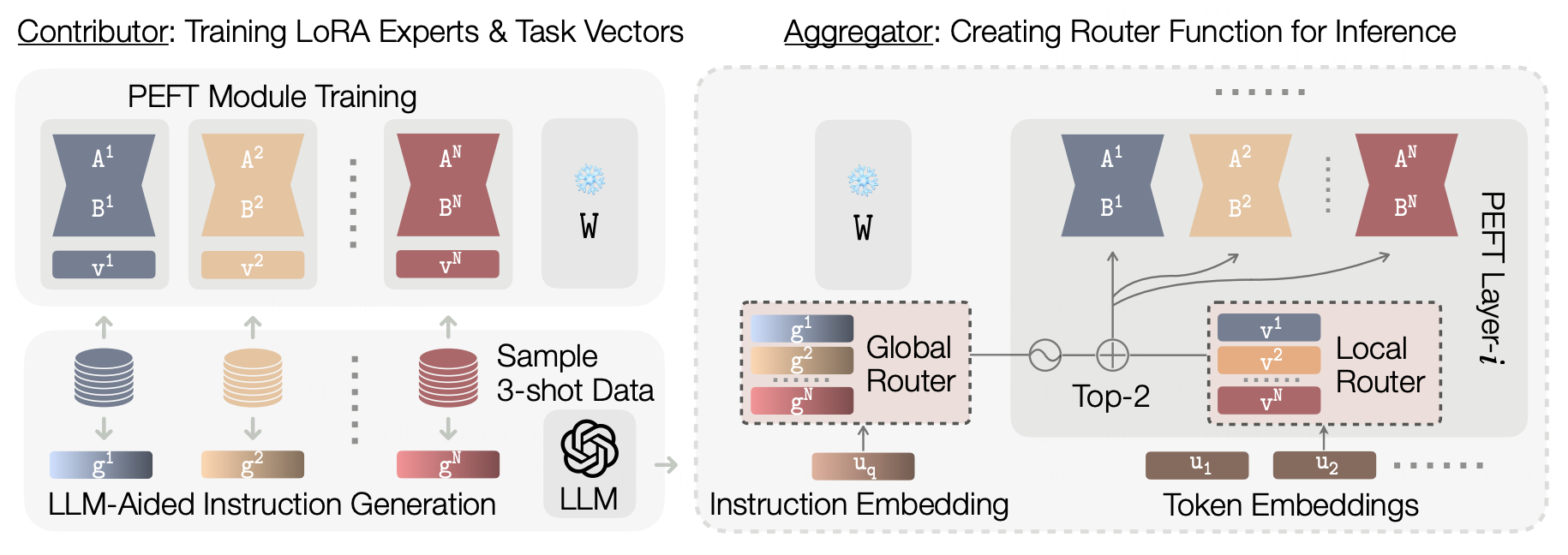

Die Verfügbarkeit von vorgebildeten Modellen mit Performanten hat zu einer Verbreitung von fein abgestimmten Expertenmodellen geführt, die auf bestimmte Domänen spezialisiert sind. Dies hat die Erstellung leistungsstarker und adaptiver Routing-basierter "Modell Moerging" -Methoden ermöglicht, um Expertenmodule zu verwenden, um ein aggregiertes System mit verbesserter Leistung oder Generalisierung zu erstellen. Vorhandene Moerging-Methoden priorisieren jedoch die Verallgemeinerung jedoch häufig auf unsichtbare Aufgaben auf Kosten der Leistung bei den Aufgaben, was die praktische Anwendbarkeit in realen Bereitstellungsszenarien einschränkt. Wir beobachten, dass die aktuellen Routing-Mechanismen auf Token-Ebene den globalen semantischen Kontext der Eingabeaufgabe vernachlässigen. Diese token- und unabhängige Unabhängigkeit behindert die wirksame Auswahl der Experten für Aufgaben, da Routing-Entscheidungen die semantischen Eigenschaften der Aufgabe nicht einbeziehen. Um dies zu beheben, schlagen wir einen globalen und lokalen unterrichtsgetriebenen Expertenrouter (Glider) vor, der einen multi-skalierigen Routing-Mechanismus integriert, der einen semantischen globalen Router und einen gelehrten lokalen Router umfasst. Der globale Router nutzt die fortschrittlichen Argumentationsfunktionen von LLM für semantische Kontexte zur Verbesserung der Expertenauswahl. Angesichts der Input -Abfrage und der LLM generiert der Router semantische Aufgabenanweisungen, die das Abrufen der relevantesten Experten in allen Ebenen leiten. Diese globale Anleitung wird durch einen lokalen Router ergänzt, der Routing-Entscheidungen auf Token-Ebene in jedem Modul erleichtert und eine feinere Kontrolle und eine verbesserte Leistung bei unsichtbaren Aufgaben ermöglicht. Unsere Experimente mit T5-basierten Modellen für T0- und FLAN-Aufgaben zeigen, dass Segelflugzeuge eine wesentlich verbesserte Leistung in der Heldin erzielt und gleichzeitig eine starke Verallgemeinerung bei ausgehaltenen Aufgaben aufrechterhalten. Wir führen auch Ablationen -Experimente durch, um tiefer in die Komponenten des Segelflugzeugs einzutauchen. Unsere Experimente unterstreichen die Bedeutung unseres mehrstufigen Routings, das LLM-gesteuerte semantische Argumentation für Moerging-Methoden nutzt.

conda create -n glider python=3.9

conda activate glider

conda install git-lfs

pip install -r requirements.txt

pip uninstall peft -y cd src && mkdir saved_runs && cd saved_runs

git lfs install

# Glider LLM-Generated task embeddings

git clone https://huggingface.co/MoE-UNC/gpt-generated-instruction-nomic-embeddings

# P3 LoRA checkpoints (derived from Phatgoose)

git clone https://huggingface.co/MoE-UNC/p3-lora-checkpoints

# FLAN LoRA checkpoints (derived from Phatgoose)

git clone https://huggingface.co/MoE-UNC/flan-lora-checkpoints

# Baseline- Arrow checkpoints

git clone https://huggingface.co/MoE-UNC/p3-lora-checkpoints-arrow

# Baseline - Merged Experts checkpoints (derived from Phatgoose)

git clone https://huggingface.co/MoE-UNC/phatgoose-checkpoints Bitte überprüfen Sie die Befehle und Kommentare in src/scripts/paper-eval.sh um Ergebnisse zu reproduzieren.

@misc { li2024glidergloballocalinstructiondriven ,

title = { Glider: Global and Local Instruction-Driven Expert Router } ,

author = { Pingzhi Li and Prateek Yadav and Jaehong Yoon and Jie Peng and Yi-Lin Sung and Mohit Bansal and Tianlong Chen } ,

year = { 2024 } ,

eprint = { 2410.07172 } ,

archivePrefix = { arXiv } ,

primaryClass = { cs.LG } ,

url = { https://arxiv.org/abs/2410.07172 } ,

}