Offizielle Implementierung des MSMC-TTS-Systems von Papieren

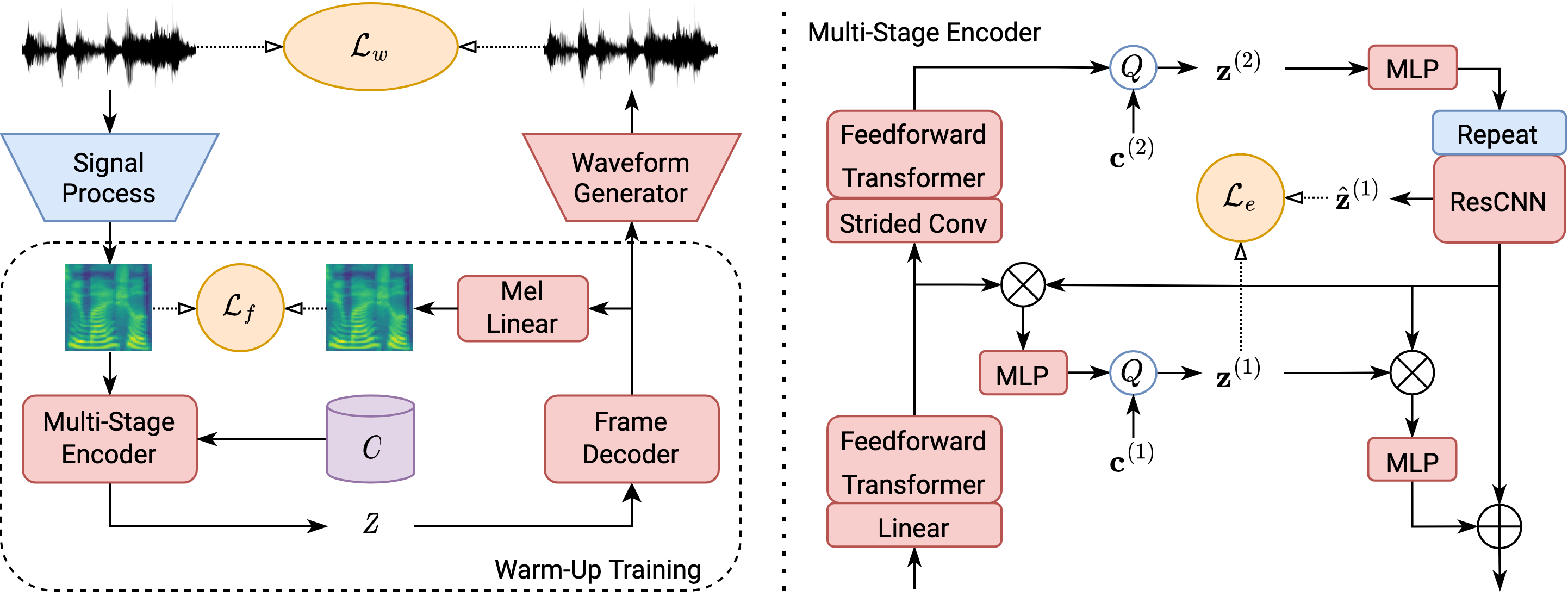

Die neuesten MSMC-TTs (MSMC-TTS-V2) sind mit einem Autocoder-basierten MSMC-VQ-GAN-Basis optimiert, der MSMC-VQ-VAE und HiFigan kombiniert. Der mehrstufige Prädiktor wird weiterhin als akustisches Modell zur Vorhersage von MSMCRs für die TTS-Synthese angewendet.

[2024.04.10] (in Arbeit) Die Implementierung von QS-TTs ist unter Beispielen/CSMSC/Konfigurationen verfügbar

[2022.10.20] Wir veröffentlichen die neueste Version von MSMC-TTS (MSMC-TTS-V2) basierend auf MSMC-VQ-GAN. In unserem neuesten Artikel "in Richtung hochwertiger neuronaler TTs für Sprachen mit niedrigem Ressourcen, indem Sie kompakte Repräsentation lernen"

[2022.10.18] Wir werden den Code aller Versionen von MSMC-TTs in diesem Repo veröffentlichen. Und jeder, der sich für diese Arbeit interessiert, ist herzlich eingeladen, sich uns anzuschließen, um nützliche Sprachdarstellungen für die Sprachsynthese zu untersuchen.

[2022.9.22] "Ein mehrstufiger Multi-CodeBook-VQ-VAE-Ansatz für Hochleistungsneural-TTs" wird unter Interspeech 2022 veröffentlicht.

# Install

pip -r requirements.txt

# Train (Take the example of CSMSC, please refer to the example of CSMSC to prepare your training data)

python train.py -c examples/csmsc/configs/msmc_vq_gan.yaml

python train.py -c examples/csmsc/configs/msmc_vq_gan_am.yaml

# Multi-GPU Training

python train_dist.py -c examples/csmsc/configs/msmc_vq_gan.yaml

python train_dist.py -c examples/csmsc/configs/msmc_vq_gan_am.yaml

# Test -- Analysis-Synthesis

python infer.py -c examples/csmsc/configs/msmc_vq_gan.yaml -m examples/csmsc/checkpoints/msmc_vq_gan/model_800000 -t examples/csmsc/data/test_ae.yaml -o analysis_synthesis

# Test -- TTS-Synthesis

python infer.py -c examples/csmsc/configs/msmc_vq_gan_am.yaml -m examples/csmsc/checkpoints/msmc_vq_gan_am/model_200000 -t examples/csmsc/data/test_tts.yaml -o tts

Helfen Sie Ihnen, Ihre Modelle besser zu trainieren!

@inproceedings{guo2022msmc,

title={A Multi-Stage Multi-Codebook VQ-VAE Approach to High-Performance Neural TTS},

author={Guo, Haohan and Xie, Fenglong and Soong, Frank K and Wu, Xixin and Meng, Helen},

booktitle={Proc. INTERSPEECH},

year={2022}

}