Whispermesh ist Ihr hochmoderner Chatbot, der nahtlos Sprach- und Textinteraktionen kombiniert und ein reichhaltiges, intuitives Gesprächserlebnis erzeugt. Mit der Leistung von LLM -Modellen und einer ausgefeilten Vektordatenbank versteht WhisperMesh Ihre Anforderungen wie nie zuvor und liefert maßgeschneiderte Antworten, die Ihre Abfragen ansprechen.

Unsere App nutzt das Rag-Framework von Haystack und zeichnet relevante Informationen aus und sorgt dafür, dass jede Interaktion nicht nur ansprechend, sondern auch datengesteuert ist. Egal, ob Sie es vorziehen, zu sprechen oder zu tippen, Whispermesh passt sich Ihrem Stil an und verwandelt Ihre Eingabe in aufschlussreiche Antworten mit einer persönlichen Note.

Schließen Sie sich dem Gespräch mit Whispermesh an, wo Ihre Stimme wichtig ist, und lassen Sie sich von uns durch eine Welt des Wissens und der Entdeckung führen! ?

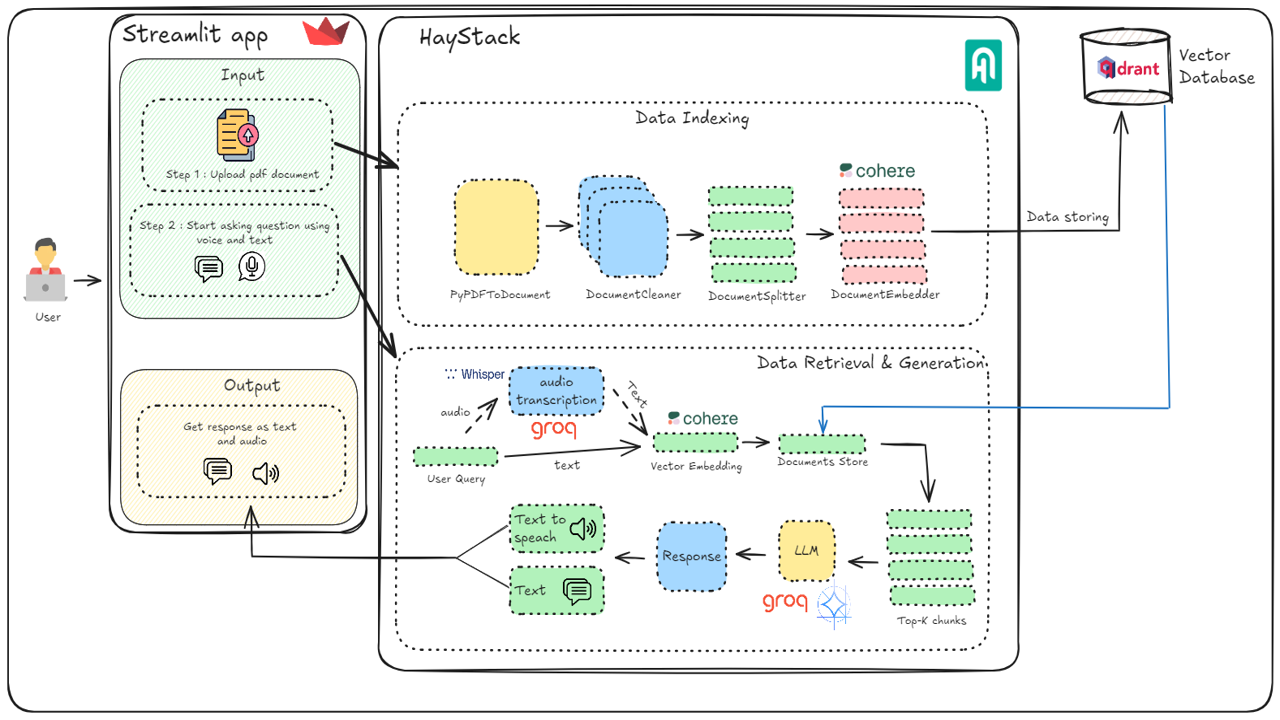

Die Architektur skizziert eine in das Haystack -Framework integrierte optimale Anwendung, um das Hochladen, Abfragen und die Reaktionsgenerierung von Dokumenten zu erleichtern. Benutzer laden PDF -Dokumente über die App hoch, die dann von Haystack -Komponenten verarbeitet und indiziert werden, einschließlich Dokumentenreiniger, Splitter und Einbetten, die Dokumente unter Verwendung des in der QDRant Vector -Datenbank gespeicherten Cohere -Modells in Vektordarstellungen umwandeln. Wenn ein Benutzer eine Sprachabfrage einreicht, wird er in Text transkribiert, in einen Vektor eingebettet und gegen die gespeicherten Dokumentvektoren angepasst, um relevante Teile abzurufen. Diese Brocken werden in das Genma 7B -Generative -Modell eingespeist, um eine kohärente Antwort zu generieren, die dann für die Benutzerausgabe in Audio umgewandelt wird. Dieses System nutzt erweiterte NLP -Techniken, um ein effizientes und genaues Abrufen von Dokumenten und die Reaktionsgenerierung zu gewährleisten.

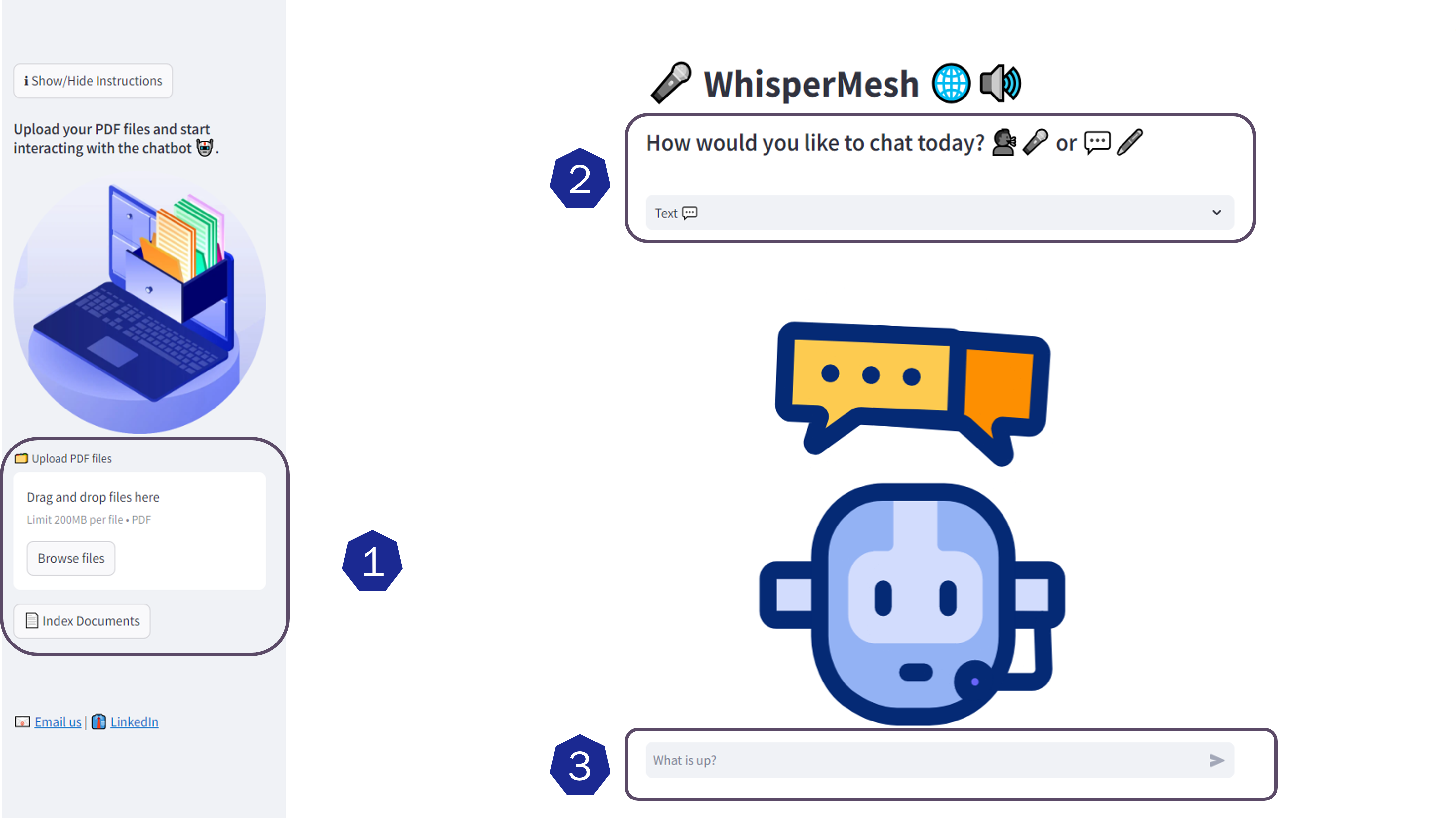

WhisperMesh bietet ein modernes Gesprächserlebnis, indem Sie Sprach- und Texteingaben mischen, sodass Sie so kommunizieren können, wie Sie es am besten entsprechen.

WhisperMesh wird von hochmodernen Großsprachmodellen (LLMs) angetrieben. Er versteht Ihre Bedürfnisse zutiefst und bietet maßgeschneiderte Antworten, die Ihre Anfragen ansprechen.

Die Verwendung von QDRANT als unsere Vektor-Datenbank verwaltet und ruft relevante Informationen effizient verwaltet und ruft, um datengesteuerte Interaktionen sicherzustellen, die das Einbindung des Benutzers verbessern.

Unsere Anwendung nutzt das Cohere -Einbettungsmodell für ein effektives semantisches Verständnis und sorgt dafür, dass jede Interaktion aufschlussreich und kontextuell bewusst ist.

Mit dem Flüsterlarge-V3- Modell aus der GROQ-Cloud zeichnet sich Whispermesh bei der Konvertierung von Sprache in Text aus und macht Sprachinteraktionen reibungslos und genau.

Unsere App verwendet das Gemma-7b-It- Modell aus COQ Cloud und generiert personalisierte Antworten und fügt jeder Gespräch eine einzigartige Note hinzu.

Nutzung des Rahmens für Lappen (retrieval-augmented Generation) von Haystack zeichnet sich aus, um relevante Informationen zu extrahieren, um sicherzustellen, dass Ihre Interaktionen ansprechend und informativ sind.

git clone https://github.com/Mouez-Yazidi/WhisperMesh.git

cd WhisperMesh Erstellen Sie eine .env -Datei und fügen Sie die folgenden Variablen gemäß den Anmeldeinformationen hinzu, die Sie von den erforderlichen Plattformen erhalten haben:

COHERE_API_KEY=

GROQ_API=

GROQ_KEY=

QDRANT_API=

QDRANT_KEY=

Navigieren Sie zum lokalen Verzeichnis und installieren Sie die erforderlichen Abhängigkeiten:

cd local

pip install -r requirements.txtUm die App lokal auszuführen, führen Sie den folgenden Befehl aus:

streamlit run ../app/main.py --environment localSie sollten jetzt in der Lage sein, auf die App unter http: // localhost: 8501 zugreifen zu können.

Wenn Sie es vorziehen, die App in einem Docker -Container auszuführen, befolgen Sie die folgenden Schritte:

docker build -t whispermesh -f Dockerfile ..docker run -p 8501:8501 whispermesh streamlit run main.py --environment localStellen Sie sicher, dass Ihr Code in ein Github -Repository gedrückt wird.

COHERE_API_KEY = " "

GROQ_API = " "

GROQ_KEY = " "

QDRANT_API = " "

QDRANT_KEY = " "Streamlit Cloud wird:

? Sie sind alle gesetzt! Ihre App wird jetzt live in der streamlosen Cloud sein!

Wenn Sie dieses Projekt zu schätzen wissen, wäre ich dankbar, wenn Sie es auf Github einen Stern geben könnten. Ihre Unterstützung motiviert uns, unsere Arbeit zu verbessern und zu erweitern!

Dieses Projekt ist unter der MIT -Lizenz lizenziert. Weitere Informationen finden Sie in der Lizenzdatei.

Wenn Sie Fragen oder Vorschläge haben, können Sie sich gerne ein Problem eröffnen oder uns unter [email protected] kontaktieren.