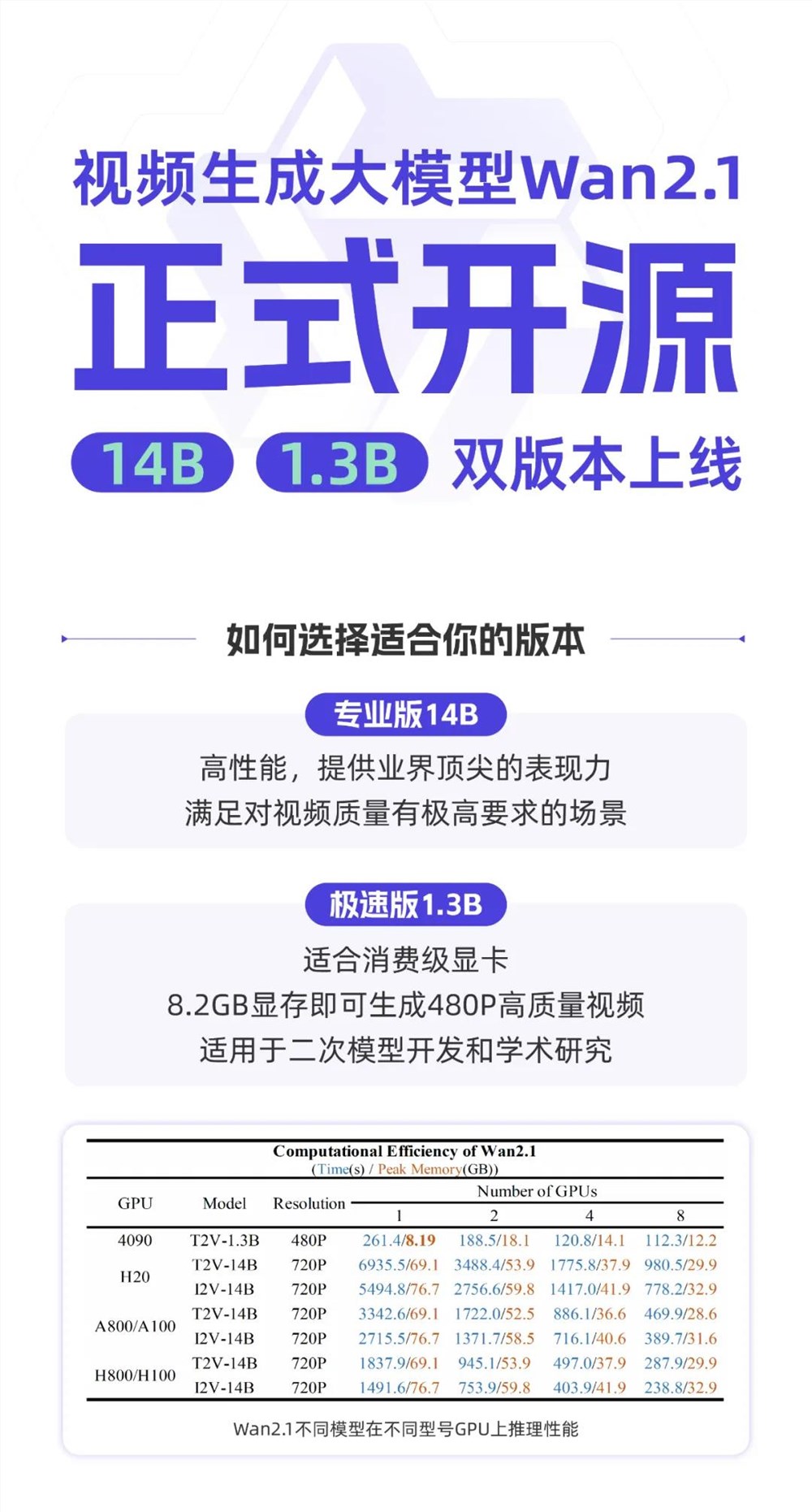

阿里巴巴近日宣布全面开源其视频生成模型——万相2.1,推出了14B和1.3B两个版本。14B版本作为专业版,具备高性能,能够提供业界顶尖的视频表现力,适用于对视频质量要求极高的场景;而1.3B版本则作为极速版,适合消费级显卡,仅需8.2GB显存即可生成480P的高质量视频,非常适合二次模型开发和学术研究。

据官方介绍,万相2.1在处理复杂运动、还原真实物理规律、提升影视质感及优化指令遵循方面表现出色,能够满足创作者、开发者和企业用户的多样化需求。通过通义万相,用户可以轻松实现高质量的视频生成,尤其在广告和短视频领域,满足了对创意的高要求。

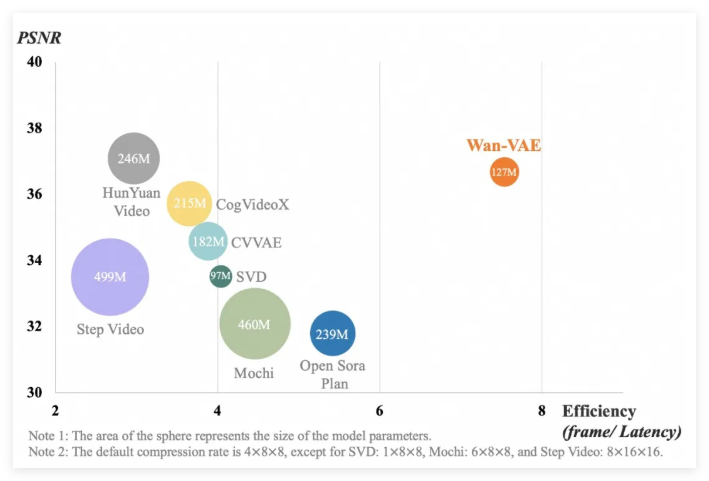

在权威评测集VBench中,通义万相以总分86.22%的成绩高居榜首,远超Sora、Minimax、Luma等国内外其他视频生成模型。该评测基于主流的DiT和线性噪声轨迹Flow Matching范式,通过一系列技术创新提升了模型的生成能力。特别是自研的高效3D因果VAE模块,成功实现了256倍无损视频隐空间压缩,支持任意长度视频的高效编码与解码。

通义万相在生成视频的过程中,采用了基于主流DiT结构的Full Attention机制,有效建模时空依赖性,确保生成视频的高质量与一致性。模型的训练策略采用6阶段分步训练法,从初步的低分辨率数据训练逐步引入高分辨率数据,以保证模型在不同条件下的优异表现。此外,通义万相在数据处理方面也采取了严格的清洗流程,以确保训练数据的高质量。

在训练与推理效率优化方面,通义万相采用了多种先进技术,如分布式训练策略、激活值优化和显存管理,确保模型训练的稳定性与推理效率。通过与阿里云训练集群的智能调度结合,模型在训练过程中能够自动识别故障并快速重启,确保训练过程的顺利进行。

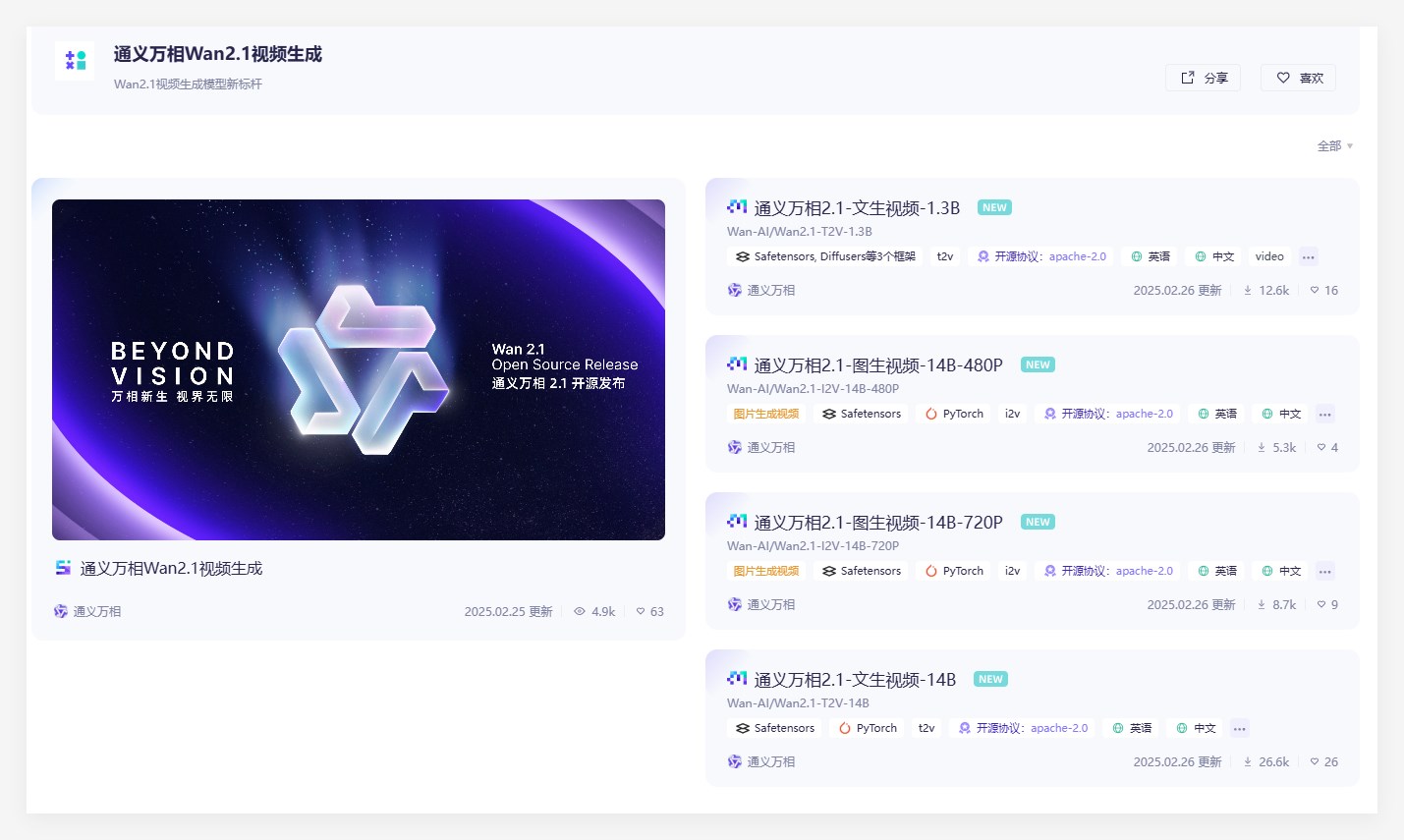

通义万相2.1已在GitHub、Hugging Face等平台开源,支持多种主流框架,为开发者和研究者提供了便利的使用体验。无论是快速原型开发还是高效生产部署,通义万相都能满足不同用户的需求,为视频生成技术的发展注入了新的活力。

魔塔社区入口:https://modelscope.cn/organization/Wan-AI

划重点:

通义万相2.1开源,支持多样化视频生成需求。

在VBench评测中以86.22%高分获胜,领先其他模型。

采用分步训练及多项技术优化,提升了生成效率和质量。