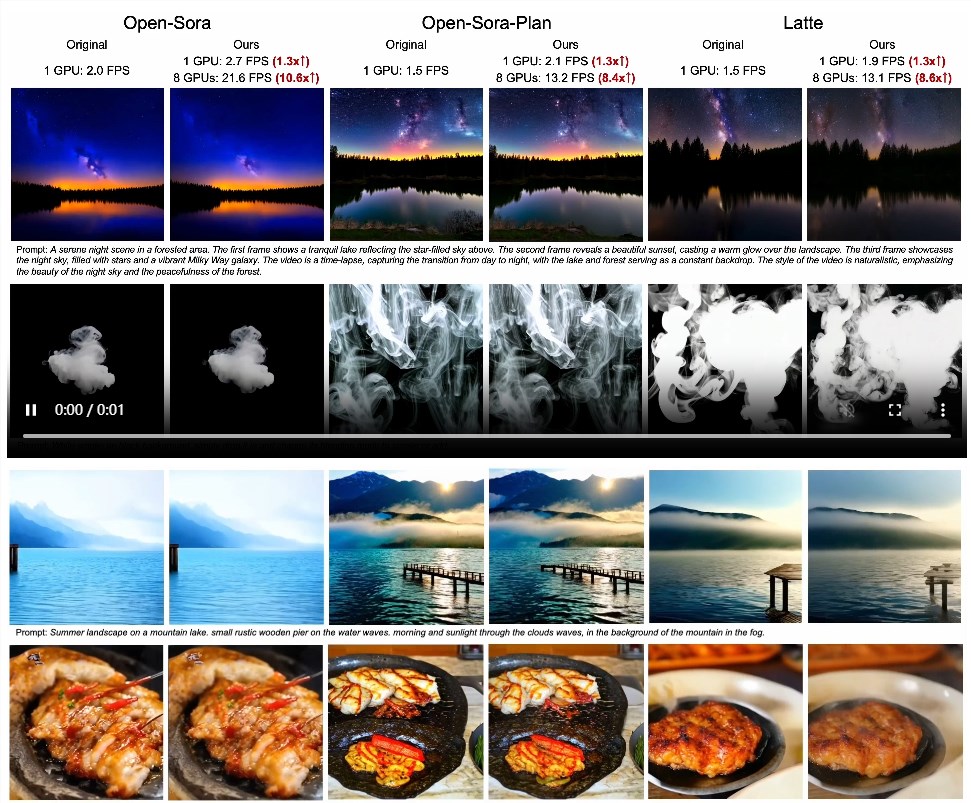

新加坡国立大学和普渡大学的研究人员研发了一种名为PAB的突破性技术,实现了基于扩散式转换的视频生成的实时处理。这项技术基于Diffusion Transformer(DiT)模型,通过减少冗余的注意力计算,将视频生成速度提升了10.6倍,达到惊人的21.6帧每秒。 PAB无需额外训练,即可应用于多个流行的DiT视频生成模型,例如Open-Sora、Open-Sora-Plan和Latte,为未来的实时视频生成技术奠定了坚实的基础。它不仅大幅提高了处理速度,而且在保证视频质量的同时,还显着降低了多GPU间的通信开销,为实时视频生成提供了更有效率的分布式推断能力。以下是对PAB技术更详细的解读。

近日,新加坡国立大学和普渡大学的研究人员成功提PAB技术,实现了基于扩散式转换的视频生成的实时处理。

产品入口:https://top.aibase.com/tool/pab

这项技术是基于Diffusion Transformer(DiT)的视频生成模型的首次尝试,通过减少冗余的关注计算,实现了高达21.6帧每秒的生成速度,加速了10.6倍,而且在不牺牲质量的情况下适用于多个热门的DiT 视频生成模型,包括Open-Sora、Open-Sora-Plan 和Latte。 PAB 是一种无需训练的方法,可以为未来的DiT 视频生成模型赋予实时生成的能力。 PAB 无需经过训练,能够赋予未来任何基于扩散式转换的视频生成模型实时处理的能力。

重要功能特点:

PAB关注广播通过减少冗余的关注计算,显着提高了视频生成的速度,实现了实时生成。

根据关注的稳定性和差异性,PAB 为不同类型的关注设置了不同的广播范围,从而在保证计算效率的同时最小化了质量损失。

通过改进序列并行处理技术,PAB 减少了多GPU 之间的通信开销,进一步提高了视频生成的速度和效率。

研究人员发现,视频扩散式转换模型中的注意力机制存在着明显的时间步骤间的差异,通过这一发现,提出了PAB以减轻不必要的注意力计算。在稳定的中间部分,PAB 将一个扩散步骤的注意力输出广播到后续的多个步骤,从而显着减少了计算成本。此外,为了更高效的计算和最小化质量损失,针对不同的注意力类型设置了不同的广播范围。

为了进一步提高视频生成速度,研究人员改进了基于动态序列并行(DSP)的并行处理方法,通过广播时间注意力,消除了大部分通信开销,实现了超过50% 的通信开销降低,为实时视频生成提供了更加高效的分布式推断能力。

划重点:

⭐ PAB技术实现了实时视频生成,加速了10.6倍的处理速度。

⭐ 通过观察视频扩散式转换模型的注意力机制差异,提出了PAB 以减轻不必要的注意力计算。

⭐ 通过改进并行处理方法,大幅降低了通信开销,为实时视频生成提供了更高效的分布式推断能力。

PAB技术的出现,标志着实时视频生成技术取得了重大突破,为未来基于扩散式转换的视频生成模型提供了强大的实时处理能力,进一步拓展了人工智能在视频领域的应用前景。相信PAB技术将会在未来视频生成领域发挥越来越重要的作用。