การใช้งาน Pytorch อย่างเป็นทางการของ Baselines ง่ายๆสำหรับการฟื้นฟูภาพ (ECCV2022)

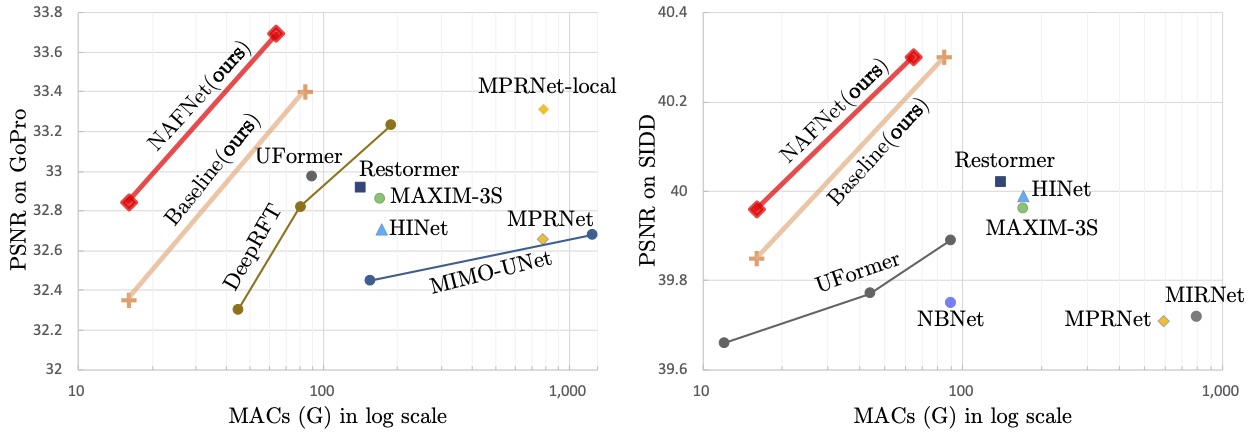

แม้ว่าจะมีความก้าวหน้าอย่างมีนัยสำคัญในด้านการฟื้นฟูภาพเมื่อเร็ว ๆ นี้ความซับซ้อนของระบบของวิธีการที่ทันสมัย (SOTA) ก็เพิ่มขึ้นเช่นกันซึ่งอาจขัดขวางการวิเคราะห์ที่สะดวกและการเปรียบเทียบวิธีการ ในบทความนี้เราเสนอพื้นฐานอย่างง่ายที่เกินวิธี SOTA และมีประสิทธิภาพในการคำนวณ เพื่อลดความซับซ้อนของพื้นฐานเราเปิดเผยว่าฟังก์ชั่นการเปิดใช้งานแบบไม่เชิงเส้นเช่น sigmoid, relu, gelu, softmax ฯลฯ ไม่จำเป็น : พวกเขาสามารถถูกแทนที่ด้วยการคูณหรือลบออก ดังนั้นเราจึงได้รับเครือข่ายฟรีการเปิดใช้งานแบบไม่เชิงเส้นคือ NAFNET จากพื้นฐาน ผลลัพธ์ของ SOTA นั้นเกิดขึ้นได้จากเกณฑ์มาตรฐานที่ท้าทายเช่น 33.69 dB PSNR บน GoPro (สำหรับการทำลายภาพ) เกินกว่า SOTA 0.38 dB ก่อนหน้านี้โดยมีค่าใช้จ่ายในการคำนวณเพียง 8.4% 40.30 dB PSNR บน SIDD (สำหรับภาพ denoising) เกิน SOTA ก่อนหน้า 0.28 dB โดยมีค่าใช้จ่ายในการคำนวณน้อยกว่าครึ่งหนึ่ง

|  |  |

|---|---|---|

| ชาวเดนิส | deblur | Stereosr (NAFSSR) |

2022.08.02 The Baseline รวมถึงรุ่นที่ผ่านการฝึกอบรมและการกำหนดค่ารถไฟ/ทดสอบมีให้บริการแล้ว

2022.07.03 งานที่เกี่ยวข้องการปรับปรุงการฟื้นฟูภาพโดยการรวมการรวมข้อมูลทั่วโลก (TLC, AKA TLSC ในบทความของเรา) ได้รับการยอมรับจาก ECCV2022 หรือไม่? - รหัสมีอยู่ที่ https://github.com/megvii-research/tlc

2022.07.03 บทความของเราได้รับการยอมรับจาก ECCV2022 ?

2022.06.19 NAFSSR (เป็นผู้ชนะที่ท้าทาย) ถูกเลือกสำหรับการนำเสนอด้วยวาจาที่ CVPR 2022, NTire Workshop? วิดีโอการนำเสนอสไลด์และโปสเตอร์มีให้บริการแล้ว

2022.04.15 อิมเมจสเตอริโออิงภาพสเตอริโอที่ใช้ NAFNET (NAFSSR) ได้รับ รางวัลอันดับที่ 1 ใน NTIRE 2022 สเตอริโอภาพความท้าทายระดับความละเอียดสูง! คำแนะนำการฝึกอบรม/การประเมินผลดูที่นี่

การใช้งานนี้ขึ้นอยู่กับ BasicsR ซึ่งเป็นกล่องเครื่องมือโอเพ่นซอร์สสำหรับงานการคืนภาพและวิดีโอและ HINET

python 3.9 .5

pytorch 1.11 .0

cuda 11.3 git clone https://github.com/megvii-research/NAFNet

cd NAFNet

pip install -r requirements.txt

python setup.py develop --no_cuda_ext

python basicsr/demo.py -opt options/test/SIDD/NAFNet-width64.yml --input_path ./demo/noisy.png --output_path ./demo/denoise_img.png

python basicsr/demo.py -opt options/test/REDS/NAFNet-width64.yml --input_path ./demo/blurry.jpg --output_path ./demo/deblur_img.png

--input_path : เส้นทางของภาพที่เสื่อมโทรม--output_path : เส้นทางที่จะบันทึกภาพที่คาดการณ์ไว้ python basicsr/demo_ssr.py -opt options/test/NAFSSR/NAFSSR-L_4x.yml

--input_l_path ./demo/lr_img_l.png --input_r_path ./demo/lr_img_r.png

--output_l_path ./demo/sr_img_l.png --output_r_path ./demo/sr_img_r.png

--input_l_path : เส้นทางของภาพซ้ายที่เสื่อมโทรม--input_r_path : เส้นทางของภาพขวาที่เสื่อมโทรม--output_l_path : เส้นทางที่จะบันทึกภาพซ้ายที่คาดการณ์ไว้--output_r_path : เส้นทางที่จะบันทึกภาพขวาที่คาดการณ์ไว้| ชื่อ | ชุดข้อมูล | PSNR | SSIM | นางแบบที่ได้รับการฝึกฝน | กำหนดค่า |

|---|---|---|---|---|---|

| Nafnet-Gopro-Width32 | GoPro | 32.8705 | 0.9606 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| Nafnet-Gopro-Width64 | GoPro | 33.7103 | 0.9668 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| nafnet-sidd-Width32 | Sidd | 39.9672 | 0.9599 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| nafnet-sidd-Width64 | Sidd | 40.3045 | 0.9614 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| Nafnet-Reds-Width64 | สีแดง | 29.0903 | 0.8671 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| nafssr-l_4x | Flickr1024 | 24.17 | 0.7589 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| nafssr-l_2x | Flickr1024 | 29.68 | 0.9221 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| Baseline-Gopro-Width32 | GoPro | 32.4799 | 0.9575 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| Baseline-Gopro-Width64 | GoPro | 33.3960 | 0.9649 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| Baseline-SIDD-WIDTH32 | Sidd | 39.8857 | 0.9596 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| Baseline-Sidd-Width64 | Sidd | 40.2970 | 0.9617 | Gdrive | 百度网盘 | รถไฟ | ทดสอบ |

| งาน | ชุดข้อมูล | คำแนะนำรถไฟ/ทดสอบ | ผลลัพธ์การสร้างภาพข้อมูล |

|---|---|---|---|

| ภาพ deblurring | GoPro | การเชื่อมโยง | Gdrive | 百度网盘 |

| ภาพ denoising | Sidd | การเชื่อมโยง | Gdrive | 百度网盘 |

| ภาพ deblurring ด้วยสิ่งประดิษฐ์ jpeg | สีแดง | การเชื่อมโยง | Gdrive | 百度网盘 |

| ภาพสเตอริโอความละเอียดสูง | Flickr1024+Middlebury | การเชื่อมโยง | Gdrive | 百度网盘 |

หาก NAFNET ช่วยวิจัยหรือทำงานของคุณโปรดพิจารณาอ้าง NAFNET

@article{chen2022simple,

title={Simple Baselines for Image Restoration},

author={Chen, Liangyu and Chu, Xiaojie and Zhang, Xiangyu and Sun, Jian},

journal={arXiv preprint arXiv:2204.04676},

year={2022}

}

หาก NAFSSR ช่วยวิจัยหรือทำงานของคุณโปรดพิจารณาอ้าง NAFSSR

@InProceedings{chu2022nafssr,

author = {Chu, Xiaojie and Chen, Liangyu and Yu, Wenqing},

title = {NAFSSR: Stereo Image Super-Resolution Using NAFNet},

booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) Workshops},

month = {June},

year = {2022},

pages = {1239-1248}

}

หากคุณมีคำถามใด ๆ โปรดติดต่อ [email protected] หรือ [email protected]