Это репо является дополнением к нашей серии блогов , объясненных: Learning Presention Graph . Следующие крупные статьи и соответствующие блоги были рассмотрены в рамках серии, и мы надеемся добавить блоги в несколько других важных работ в этой области.

Клонировать репозиторий GIT:

git clone https://github.com/dsgiitr/graph_nets.git

Python 3 с Pytorch 1.3.0 являются основными требованиями. Файл requirements.txt содержит список других зависимостей. Чтобы установить все требования, запустите следующее:

pip install -r requirements.txt

Неконтролируемый подход к онлайн -обучению, вдохновленный Word2VEC в NLP, но здесь цель состоит в том, чтобы сгенерировать встроенные узлы.

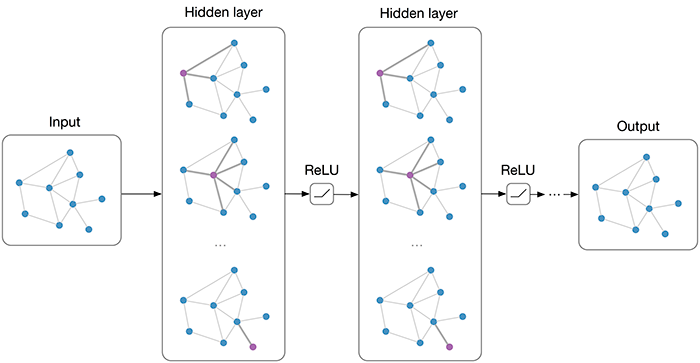

GCN опираются на идею свертки нейронных сетей, переопределяющих их для неяклидовой области данных. Они являются сверточными, потому что параметры фильтра, как правило, делятся во всех местах на графике, в отличие от типичных GNN.

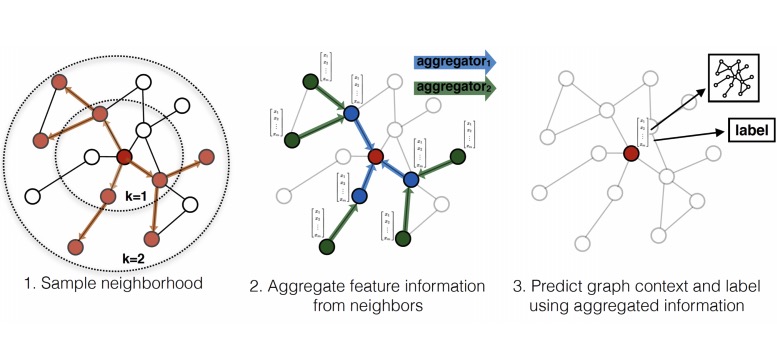

Предыдущие подходы являются трансдуктивными и не естественным образом обобщаются до невидимых узлов. График - это индуктивная структура, использующая информацию о функции узла для эффективного генерации встроенных узлов.

Chebnet - это формулировка CNN в контексте теории спектрального графа.

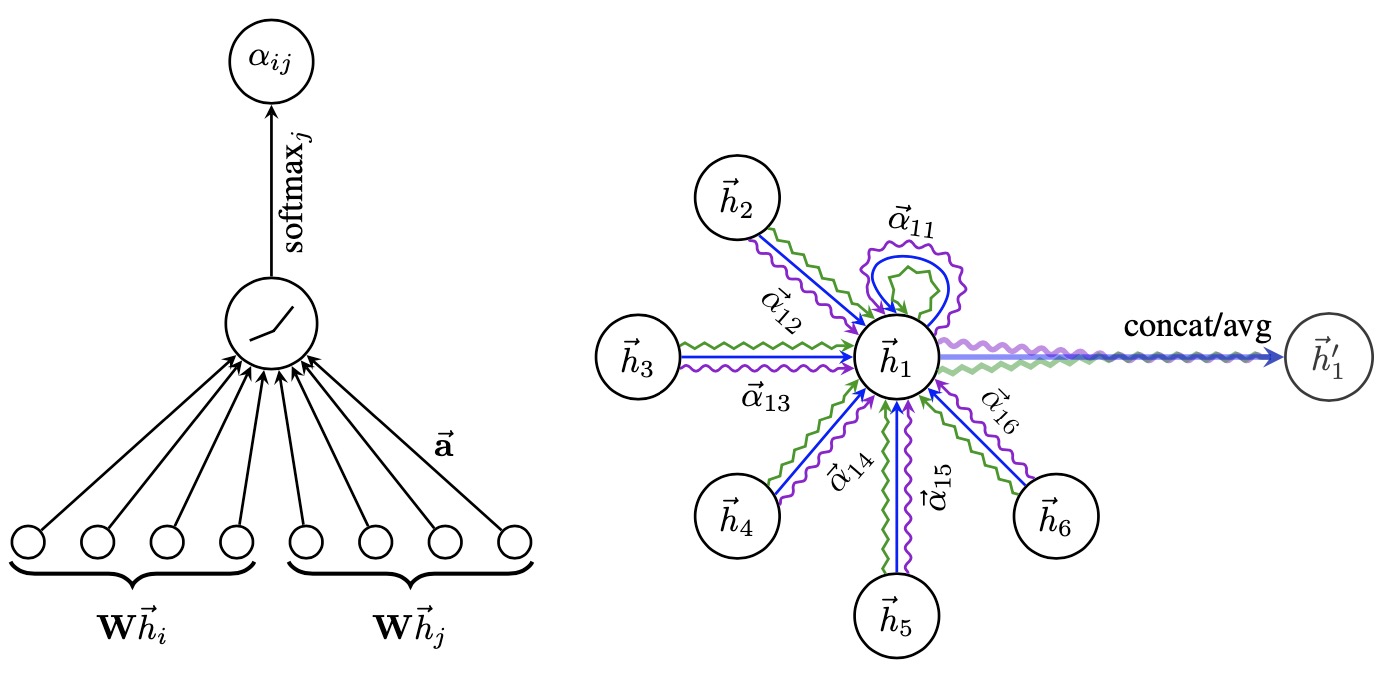

GAT может посещать функции своих районов, неявно указывая различные веса на разные узлы в районе, не требуя какой -либо дорогостоящей матрицы или в зависимости от знания структуры графа заранее.

Пожалуйста, используйте следующую запись для ссылки на блог.

@misc{graph_nets,

author = {A. Dagar and A. Pant and S. Gupta and S. Chandel},

title = {graph_nets},

year = {2020},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {url{https://github.com/dsgiitr/graph_nets}},

}