A Shanghai Jieyue Xingchen Intelligent Technology Co., Ltd. anunciou recentemente o código aberto de seu mais recente desenvolvimento do modelo de vídeo gráfico-Step-Video-Ti2V. Este modelo é baseado no treinamento de vide-video-T2V com parâmetros 30B. Pode gerar 102 quadros, 5 segundos e vídeos de resolução de 540p. Possui dois recursos principais: amplitude de movimento controlável e movimento de lente controlável, especialmente em termos de efeitos de animação. Comparado com o modelo de vídeo de código aberto existente, o Step-Video-Ti2V não apenas fornece um limite superior mais alto na escala de parâmetros, mas sua amplitude de movimento controlável também pode equilibrar a dinâmica e a estabilidade dos resultados da geração de vídeo, fornecendo aos criadores opções mais flexíveis.

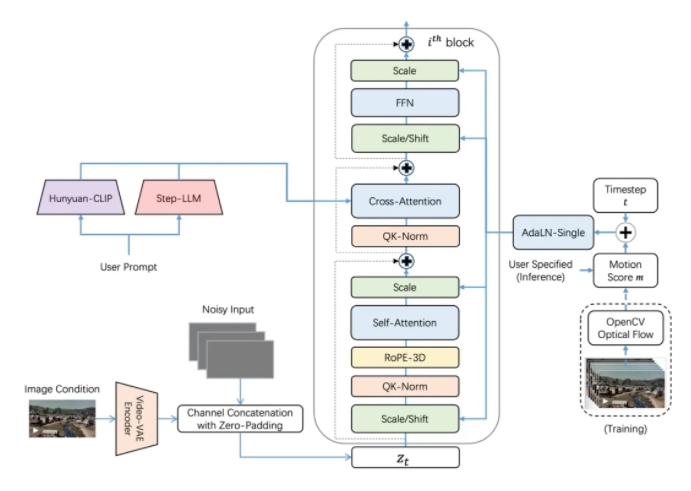

Durante o desenvolvimento do Step-Video-Ti2V, a equipe realizou duas otimizações principais. Primeiro, as condições da imagem são introduzidas para melhorar a consistência entre o vídeo gerado e a imagem original. Diferentemente do método tradicional de atendimento cruzado, o modelo adota uma maneira mais direta, unindo diretamente as dimensões do canal, conscientizando diretamente a representação do vetor correspondente ao primeiro quadro do DIT, para garantir que o vídeo gerado seja altamente consistente com a imagem de entrada. Em segundo lugar, o módulo Adaln apresenta informações de pontuação dinâmica em vídeo, para que os usuários possam especificar diferentes níveis de movimento ao gerar vídeos, controlar com precisão a amplitude dinâmica do vídeo, equilibrando assim a dinâmica, a estabilidade e a consistência. Além disso, a equipe também fez marcadores especiais e precisos dos movimentos de sujeitos e dos movimentos das lentes, melhorando ainda mais o desempenho do modelo na dinâmica dos sujeitos e nos efeitos do movimento espelhado.

Os principais recursos do passo-Video-TI2V incluem amplitude de movimento controlável, controle múltiplo de espelhos, excelentes efeitos de animação e suporte para geração de vários tamanho. Os usuários podem alternar livremente imagens dinâmicas e estáveis de acordo com suas necessidades criativas e gerar vídeos de push-pull básico, tremendo, levantando e abaixando para efeitos espelhados complexos no nível do filme. Este modelo é particularmente excelente nas tarefas de animação e é muito adequado para cenários de aplicação, como criação de animação e produção de vídeo curta. Ao mesmo tempo, suporta vários tamanhos de vídeos gerados por imagens, seja na tela horizontal, vertical ou quadrada, pode atender às necessidades de diferentes plataformas.

Endereço de experiência:

https://yuewen.cn/videos

Github:

https://github.com/stepfun-ai/step-video-ti2v

Github-comfyui:

https://github.com/stepfun-ai/comfyui-sepvideo