Este é o repositório oficial da IA generativa para a matemática: Parte I-MathPile: um corpus de pré-treinamento em escala de bilhões para matemática

Página inicial | Conjuntos de dados | Papel | Limitações | Declaração e licença | Citação | Apresentado por AK

Esteja ciente de que nosso corpus pode ser atualizado (vamos notificar após a liberação). É aconselhável usar a versão mais recente.

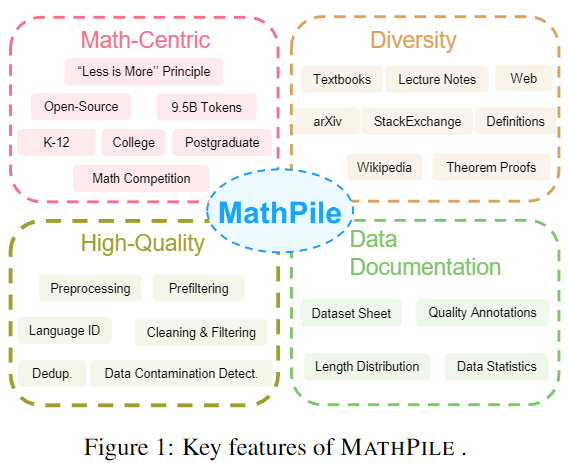

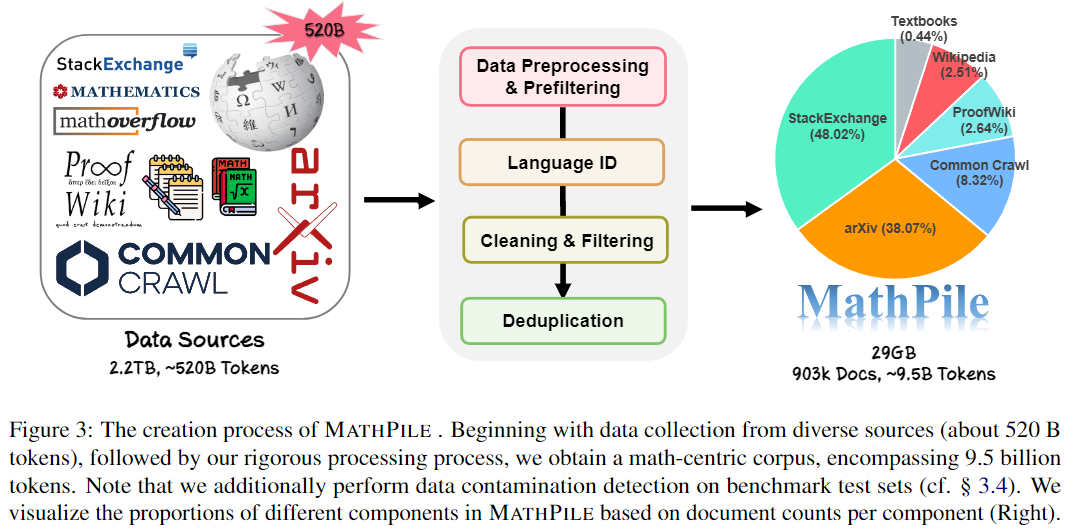

src Dir.v0.2 , uma versão mais limpa) do MathPile. Consulte nossa página inicial do conjunto de dados HF para obter mais detalhes.Corporadores de alta qualidade e em larga escala são a pedra angular da construção de modelos poderosos da fundação. Neste trabalho, apresentamos o MathPile um corpus diversificado e de alta qualidade, compreendendo cerca de 9,5 bilhões de tokens. Nosso trabalho é significativamente diferente do trabalho anterior nas seguintes características:

Matemática : Mathpile atende exclusivamente ao domínio matemático, diferentemente de corpora focada em domínio geral, como pilha e redpajama, ou focados multilíngues, como raízes e pilha. Embora existam corpora centrada em matemática, eles geralmente são de origem fechada, como o Minerva do Google e o Mathmix do Openai, ou não têm diversidade, como ProofPile e OpenWebmath.

Diversidade : o MathPile se baseia em uma ampla gama de fontes: livros didáticos (incluindo notas de aula), Arxiv , Wikipedia , Proofwiki , Stackexchange e páginas da web . Ele abrange o conteúdo matemático adequado para K-12, faculdade, níveis de pós-graduação e competições de matemática. Essa diversidade é a primeira, especialmente com a liberação de uma coleção significativa de livros didáticos de alta qualidade (~ 0,19b tokens).

Alta qualidade : aderimos ao princípio de menos é mais , acreditando firmemente na supremacia da qualidade dos dados sobre a quantidade, mesmo na fase de pré-treinamento. Nossos meticulosos esforços de coleta e processamento de dados incluíram um conjunto complexo de pré -processamento, pré -filtragem, limpeza, filtragem e desduplicação, garantindo a alta qualidade do nosso corpus.

Documentação de dados : Para melhorar a transparência, documentamos extensivamente o MathPile. Isso inclui uma folha de dados (consulte a Tabela 5 em nosso artigo) e anotações de qualidade para documentos de origem na Web, como pontuações de identificação de idiomas e proporções de símbolo / palavra. Isso oferece aos usuários flexibilidade para adaptar os dados às suas necessidades. Também realizamos a detecção de contaminação por dados para eliminar duplicatas de conjuntos de testes de benchmark, como matemática e MMLU-STEM.

Esperamos que nosso MathPile possa ajudar a aprimorar as habilidades de raciocínio matemático dos modelos de idiomas. Veja nosso artigo para obter mais detalhes técnicos.

Esses corpora inestimável são o culminar do intelecto humano e devem ser utilizados para a melhoria da humanidade, ajudando na melhoria da vida humana. Pedimos fortemente a todos os usuários que se abstenham de usar nosso corpus para quaisquer atividades que possam prejudicar a Seguridade Nacional ou Social ou violar a lei.

Fizemos o possível para garantir o uso legal e de alta qualidade dos dados. No entanto, questões imprevistas ainda podem surgir, incluindo, entre outros, as preocupações de segurança de dados e quaisquer riscos ou problemas decorrentes do uso indevido. Não seremos responsabilizados por tais problemas.

Se os dados de origem do MathPile forem regidos por uma licença mais restritiva que o CC BY-NC-SA 4.0, o MathPile adere a esse licenciamento mais rigoroso. Em todos os outros casos, opera sob a licença CC BY-NC-SA 4.0. Também planejamos lançar uma versão utilizável comercial do conjunto de dados em breve.

Abaixo estão alguns projetos que usam MathPile, cobrindo cenários, incluindo, entre outros, pré-treinamento, síntese de dados e benchmarking:

Se você achar nosso trabalho útil ou usar o MathPile, cite nosso artigo:

@article{wang2023mathpile,

title={Generative AI for Math: Part I -- MathPile: A Billion-Token-Scale Pretraining Corpus for Math},

author={Wang, Zengzhi and Xia, Rui and Liu, Pengfei},

journal={arXiv preprint arXiv:2312.17120},

year={2023}

}