Implementação oficial de Pytorch

Os vídeos que acompanham podem ser encontrados no YouTube. Para mais detalhes, consulte o artigo.

pip install -r requirements.txt

python train.py --cfg configs/mobile_stylegan_ffhq.json --gpus < n_gpus > Nossa estrutura suporta o formato Stylegan2 Points do rosinalidade/stylegan2-pytorch. Para converter o CKPT seu próprio ponto de verificação do Stylegan2 em nossa estrutura:

python convert_rosinality_ckpt.py --ckpt < path_to_rosinality_stylegan2_ckpt > --ckpt-mnet < path_to_output_mapping_network_ckpt > --ckpt-snet < path_to_output_synthesis_network_ckpt > --cfg-path < path_to_output_config_json >Para verificar se seu ponto de verificação é convertido corretamente, basta executar a visualização de demonstração:

python demo.py --cfg < path_to_output_config_json > --ckpt " " --generator teacherpython generate.py --cfg configs/mobile_stylegan_ffhq.json --device cuda --ckpt < path_to_ckpt > --output-path < path_to_store_imgs > --batch-size < batch_size > --n-batches < n_batches > Para avaliar a pontuação do FID, usamos uma versão modificada da Biblioteca Pytorch-FID:

python evaluate_fid.py < path_to_ref_dataset > < path_to_generated_imgs > Execute a visualização de demonstração usando o Mobilestylegan:

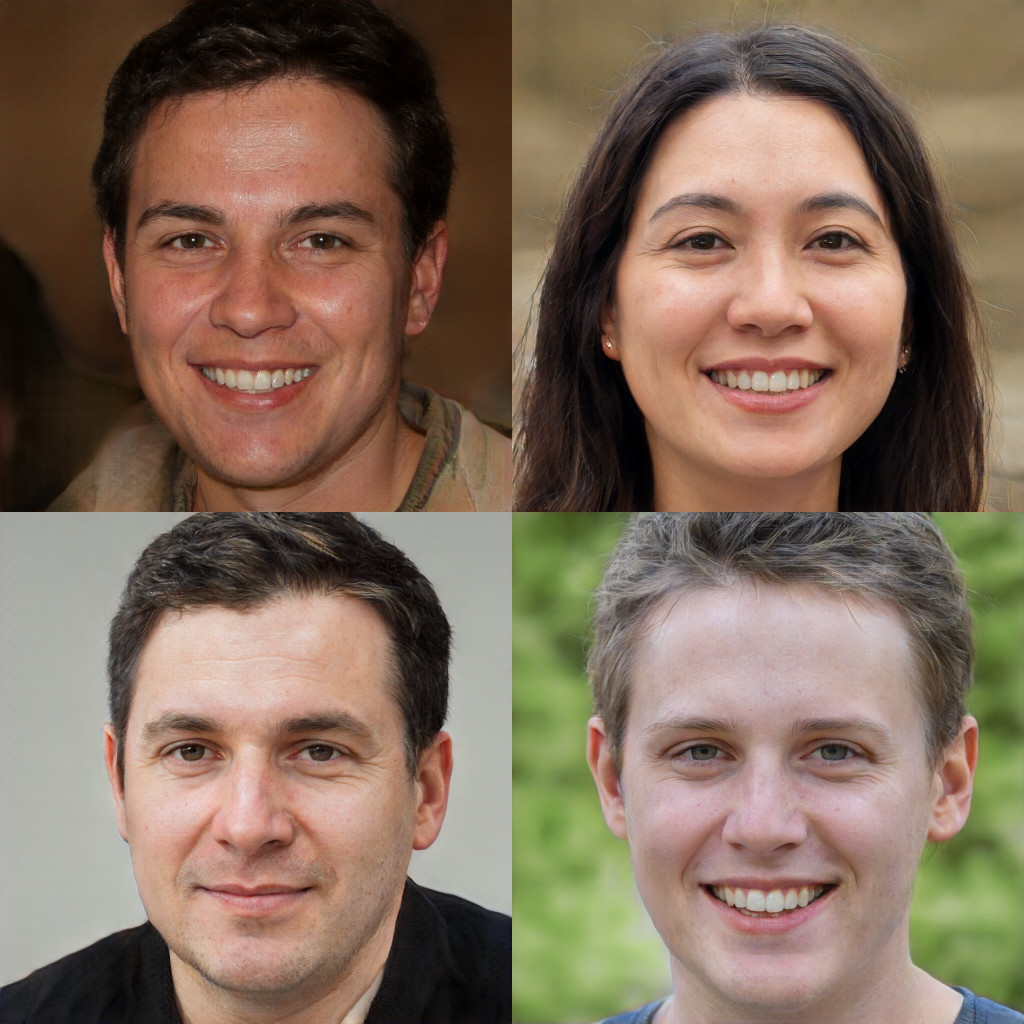

python demo.py --cfg configs/mobile_stylegan_ffhq.json --ckpt < path_to_ckpt >Execute a comparação visual usando Stylegan2 vs. Mobilestylegan:

python compare.py --cfg configs/mobile_stylegan_ffhq.json --ckpt < path_to_ckpt > python train.py --cfg configs/mobile_stylegan_ffhq.json --ckpt < path_to_ckpt > --export-model onnx --export-dir < output_dir > python train.py --cfg configs/mobile_stylegan_ffhq.json --ckpt < path_to_ckpt > --export-model coreml --export-dir < output_dir > Fornecemos biblioteca externa random_face como um exemplo de implantação de nosso modelo nos dispositivos Edge usando a estrutura OpenVino.

| Nome | Fid |

|---|---|

| mobilestylegan_ffhq.ckpt | 7.75 |

(*) Nossa estrutura suporta modelos de download automático pré -terenciado, basta usar --ckpt <pretrined_model_name> .

| Código | Fonte | Licença |

|---|---|---|

| Kernels CUDA personalizados | https://github.com/nvlabs/stylegan2 | Nvidia Licença |

| Blocos Stylegan2 | https://github.com/rosinality/stylegan2-pytorch | Mit |

Queremos agradecer às pessoas cujas obras contribuíram para o nosso projeto ::

Se você estiver usando os resultados e o código deste trabalho, cite -o como:

@misc{belousov2021mobilestylegan,

title={MobileStyleGAN: A Lightweight Convolutional Neural Network for High-Fidelity Image Synthesis},

author={Sergei Belousov},

year={2021},

eprint={2104.04767},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

@article{BELOUSOV2021100115,

title = {MobileStyleGAN.pytorch: PyTorch-based toolkit to compress StyleGAN2 model},

journal = {Software Impacts},

year = {2021},

issn = {2665-9638},

doi = {https://doi.org/10.1016/j.simpa.2021.100115},

url = {https://www.sciencedirect.com/science/article/pii/S2665963821000452},

author = {Sergei Belousov},

}