最近、Microsoftは人工知能の分野で重要な一歩を踏み出し、2つの新しいPHI-4シリーズモデルを開始しました:PHI-4 MultimodalとPhi-4 Mini。これらの2つのモデルのリリースは、MicrosoftのAIテクノロジーの別のブレークスルーを示し、さまざまなアプリケーションシナリオのより強力な処理機能を提供します。

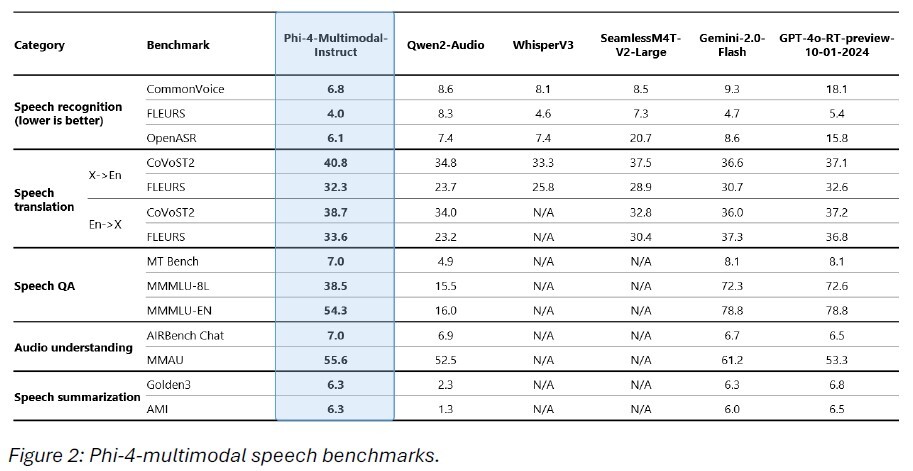

PHI-4マルチモーダルモデルは、音声、ビジョン、テキスト処理機能を統合し、5600万のパラメーターを統合するMicrosoftの最初の統一アーキテクチャモデルです。このモデルは、GoogleのGemini2.0シリーズなど、市場の多くの競合他社を上回る複数のベンチマークでうまく機能しました。特に自動音声認識(ASR)および音声翻訳(ST)タスクでは、PHI-4マルチモーダルモデルが特にうまく機能し、Whisperv3やSeamlessM4T-V2-Largeなどのプロの音声モデルを無効にし、ワードエラー率は6.14%で、ハギングフェイスランキングで最初にランキングしました。

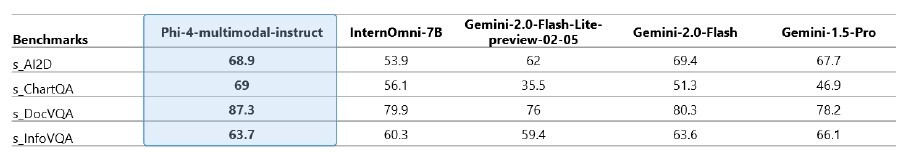

視覚処理の観点から、PHI-4マルチモーダルモデルも優れた機能を示しています。数学的および科学的推論タスクにおけるそのパフォーマンスは印象的であり、ドキュメント、チャート、光学的文字認識(OCR)を効果的に理解することを可能にします。 Gemini-2-Flash-Lite-PreviewやClaude-3.5-Sonnetなどの一般的なモデルと比較して、PHI-4マルチモーダルモデルは同等のパフォーマンスを発揮し、一部のタスクでさらに優れています。

新たにリリースされた別のPHI-4 Miniモデルは、3800万のパラメーターボリュームを備えたテキスト処理タスクに焦点を当てています。テキストの推論、数学の計算、プログラミング、および教育コンプライアンスの観点から、PHI-4 Miniは、多くの一般的な大手言語モデルを超えるように、驚くほどパフォーマンスを発揮します。新しいモデルのセキュリティと信頼性を確保するために、Microsoftは内部および外部のセキュリティの専門家を招待して包括的なテストを実施し、Microsoft人工知能REDチーム(AIRT)標準に従って最適化しました。

両方の新しいモデルは、さまざまな低コストおよび低遅延のアプリケーションシナリオに適したONNXランタイムを介してさまざまなデバイスに展開できます。これらは、Azure AI Foundry、Hugging Face、および開発者向けのNvidia APIディレクトリで利用できます。 PHI-4シリーズの新しいモデルが、Microsoftの効率的なAIテクノロジーの大きな進歩を示し、将来の人工知能アプリケーションの新しい可能性を開くことは間違いありません。