Aliの新しいオープンソース推論モデルQWQ-32B、DeepSeek-R1に匹敵するパフォーマンス、およびメモリの要件は小さくなります-AI記事

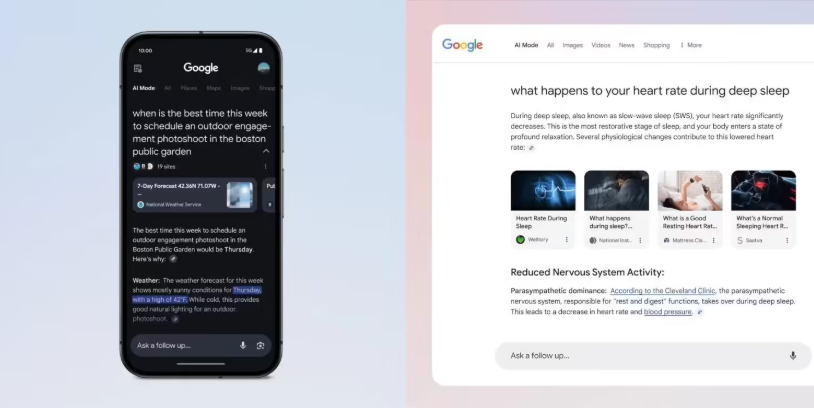

AlibabaのQwenチームは最近、最新のオープンソース大手言語モデル(LLM)家族メンバーであるQWQ -32Bを発表しました。 320億パラメーターを備えたこの推論モデルは、強化学習(RL)を通じて複雑な問題解決タスクのパフォーマンスを改善するように設計されています。報告によると、QWQ-32Bは顔とMを抱きしめています

2025-05-16