L'éditeur de Downcodes a appris que Zhipu AI avait open source son dernier modèle de graphique vincentien CogView3 et sa version améliorée CogView-3Plus-3B, faisant des vagues dans le domaine des graphiques vincentiens. En tant que premier modèle à utiliser la diffusion par relais, CogView3 a fait des percées en matière de qualité et d'efficacité d'image grâce à sa méthode de diffusion en cascade unique. Sa qualité de génération dépasse SDXL, mais sa vitesse d'inférence est plus rapide, même dans la version simplifiée. Cela offre sans aucun doute de nouvelles possibilités pour une génération d’images efficace et de haute qualité.

Récemment, Zhipu AI a rendu public son dernier chef-d'œuvre - CogView3 et sa version améliorée CogView-3Plus-3B, injectant une nouvelle vitalité dans le domaine du graphisme vincentien.

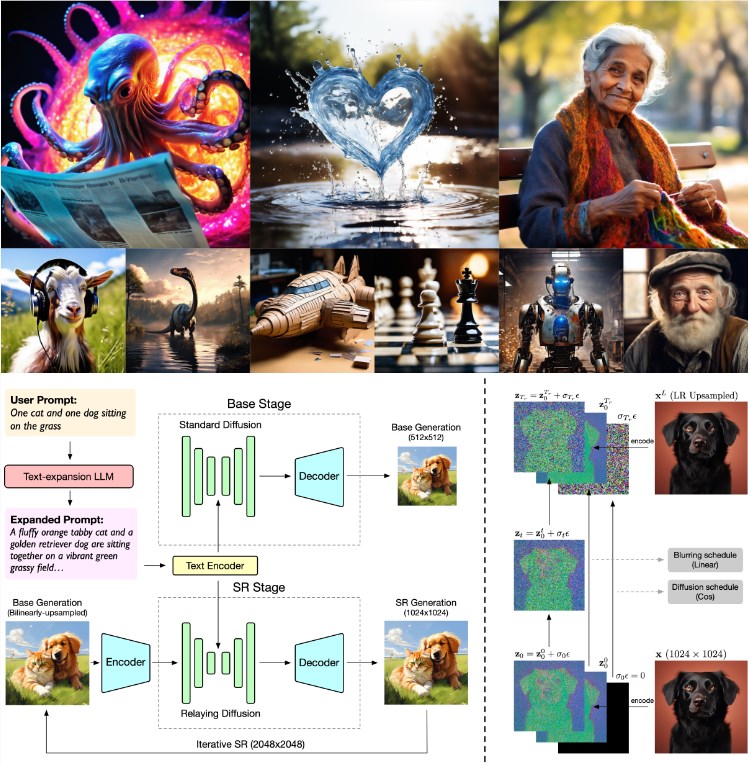

Le lancement de CogView3 constitue sans aucun doute une étape importante. En tant que premier modèle à mettre en œuvre la diffusion par relais dans le domaine de la génération texte-image, il adopte une méthode de diffusion en cascade unique. Cette approche innovante génère d’abord des images basse résolution, puis complète le résultat final grâce à une technologie de super-résolution basée sur des relais. Cela améliore non seulement considérablement la qualité des images générées, mais réduit également considérablement le coût de formation et d’inférence.

La chose la plus frappante est la performance de CogView3. Selon les résultats de l'évaluation humaine, CogView3 surpasse le modèle texte-image open source SDXL actuel en termes de qualité de génération, avec un taux de réussite de 77,0 %. Ce qui est encore plus impressionnant, c’est qu’il réalise cet exploit en seulement environ la moitié du temps d’inférence du SDXL. Si vous utilisez la version simplifiée de CogView3, vous pouvez toujours maintenir un niveau de performances comparable tout en n'occupant qu'un dixième du temps d'inférence de SDXL. Cette avancée ouvre sans aucun doute de nouvelles possibilités pour une génération d’images efficace et de haute qualité.

Dans le même temps, Zhipu AI a également lancé CogView-3Plus-3B, un modèle d'image basé sur le framework DiT (Diffusion Transformers). Bien que les résultats des tests spécifiques n'aient pas encore été annoncés, l'industrie est pleine d'attentes quant à son potentiel. CogView-3Plus-3B est encore optimisé sur la base de CogView3 et introduit des technologies avancées telles que la planification du bruit de diffusion Zero-SNR et un mécanisme d'attention conjoint texte-image. Ces améliorations réduisent non seulement les coûts de formation et d’inférence, mais maintiennent également de solides capacités de génération d’images.

Il convient de mentionner que CogView-3Plus-3B prend en charge une large gamme de résolutions d'image, allant de 512x512 à 2048x2048, ce qui augmente considérablement la flexibilité de ses scénarios d'application. Qu'il s'agisse d'un usage quotidien ou d'une création professionnelle, vous trouverez la bonne option de résolution.

Pour aider les utilisateurs à mieux utiliser ces modèles, Zhipu AI propose également des suggestions et des outils pratiques. Ils recommandent aux utilisateurs d'optimiser les mots d'invite via de grands modèles de langage (LLM), ce qui peut améliorer considérablement la qualité des images générées. Dans le même temps, Zhipu AI fournit également des exemples de scripts, ce qui réduit considérablement le seuil d'utilisation de l'utilisateur.

Adresse du projet : https://github.com/THUDM/CogView3

L'open source de CogView3 et CogView-3Plus-3B marque un autre grand pas en avant pour la technologie Wenshengtu. L'éditeur de Downcodes attend avec impatience qu'elle apporte d'autres surprises dans les applications futures ! J'espère que les développeurs pourront essayer activement de contribuer à son développement.