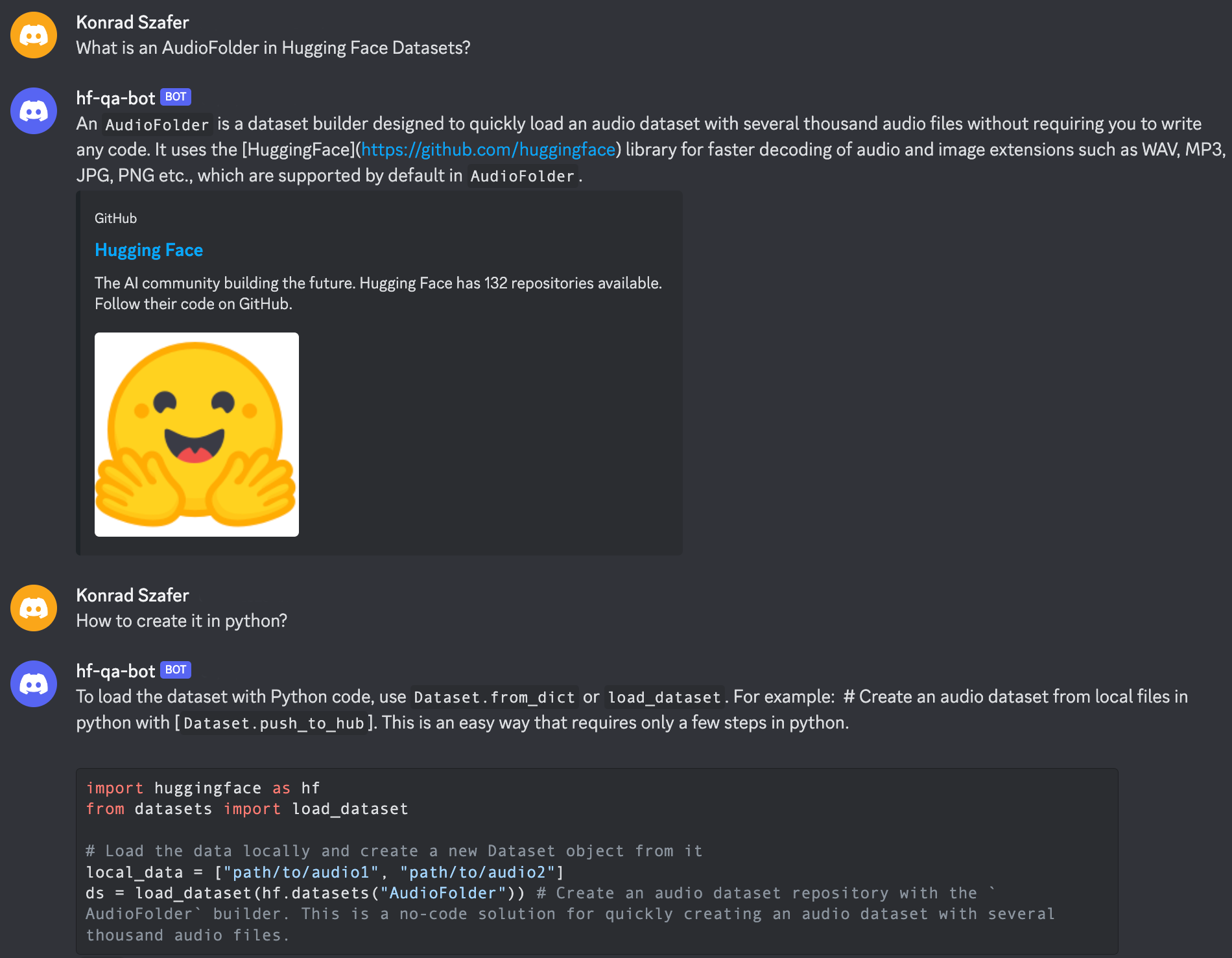

Un système de questions / réponses multi-interface qui utilise le LLM de l'étreinte et la génération augmentée (RAG) de Face Face pour étreindre la documentation des étreintes. Opérable en tant qu'API, Discord Bot ou Gradio App, il fournit également des liens vers la documentation utilisée pour formuler chaque réponse.

Pour exécuter l'une des interfaces disponibles, spécifiez les paramètres requis dans le fichier .env basé sur le .env.example situé dans le répertoire config/ . Alternativement, vous pouvez les définir comme des variables d'environnement:

QUESTION_ANSWERING_MODEL_ID - (str) Une chaîne qui spécifie l'ID de modèle du centre de face étreint ou le répertoire contenant les poids du modèleEMBEDDING_MODEL_ID - (STR) INDAGE ID du modèle du centre de face étreint. Nous vous recommandons d'utiliser le hkunlp/instructor-largeINDEX_REPO_ID - (STR) ID de référentiel du centre de face étreint où l'index est stocké. La liste des index les plus réelles peut être trouvée dans cette section: IndexPROMPT_TEMPLATE_NAME - (str) Nom du modèle de modèle modèle utilisé pour la réponse aux questions, les modèles sont stockés dans le répertoire config/api/prompt_templatesUSE_DOCS_FOR_CONTEXT - (bool) Utilisez des documents récupérés comme contexte pour une requête donnéeNUM_RELEVANT_DOCS - (int) Nombre de documents utilisés pour la fonction précédenteADD_SOURCES_TO_RESPONSE - (bool) inclure des sources des documents récupérés utilisés comme contexte pour une requête donnéeUSE_MESSAGES_IN_CONTEXT - (bool) Utilisez l'historique du chat pour une expérience conversationnelleDEBUG - (bool) fournit une journalisation supplémentaireInstallez les dépendances nécessaires à partir du fichier d'exigences:

pip install -r requirements.txt Après avoir terminé toutes les étapes décrites dans la section Configuration, spécifiez la variable d'environnement APP_MODE en tant que gradio et exécutez la commande suivante:

python3 app.py Par défaut, l'API est servie sur http://0.0.0.0:8000 . Pour le lancer, complétez toutes les étapes décrites dans la section de configuration, puis exécutez la commande suivante:

python3 -m api Pour interagir avec le système en tant que Discord Bot, ajoutez des variables d'environnement requises supplémentaires de la section Discord bot du fichier .env.example dans le répertoire config/ .

DISCORD_TOKEN - (STR) Clé API pour l'application BOTQA_SERVICE_URL - (STR) URL du service API. Nous vous recommandons d'utiliser: http://0.0.0.0:8000NUM_LAST_MESSAGES - (int) Nombre de messages utilisés pour le contexte dans les conversationsUSE_NAMES_IN_CONTEXT - (bool) Inclure des noms d'utilisateur dans le contexte de la conversationENABLE_COMMANDS - (bool) Autoriser les commandes, par exemple, le nettoyage des canauxDEBUG - (bool) fournit une journalisation supplémentaireAprès avoir terminé toutes les étapes, exécutez:

python3 -m bot Pour héberger le bot sur les espaces de face étreintes, spécifiez la variable d'environnement APP_MODE en tant que discord , et le bot sera exécuté automatiquement à partir du fichier app.py

La liste suivante contient les index les plus récents qui peuvent être utilisés pour le système:

Nous utilisons Python 3.10

Pour installer tous les packages Python nécessaires, exécutez la commande suivante:

pip install -r requirements.txtNous utilisons le pipreqsnb pour générer le fichier exigence.txt. Pour installer Pipreqsnb, exécutez la commande suivante:

pip install pipreqsnbPour générer le fichier exigence.txt, exécutez la commande suivante:

pipreqsnb --force .Pour exécuter des tests unitaires, vous pouvez utiliser la commande suivante:

pytest -o " testpaths=tests " --noconftest