Un marco de cambio de voz simple y fácil de usar basado en VITS

Registro de actualización | Preguntas frecuentes | AutoDL·50 centavos para entrenar al cantante de IA | Demostración en línea |

Inglés |中文简体|日本语| 한국어 ( coreano ) |

El modelo base se entrena utilizando casi 50 horas de conjunto de capacitación VCTK de código abierto y de alta calidad. No hay problemas de derechos de autor. No dude en utilizarlo.

Espere con ansias el modelo inferior de RVCv3, que tiene parámetros más grandes, datos más grandes, mejores resultados, básicamente la misma velocidad de inferencia y requiere menos datos de entrenamiento.

| Interfaz de inferencia de entrenamiento | Interfaz de cambio de voz en tiempo real |

|  |

| go-web.bat | go-realtime-gui.bat |

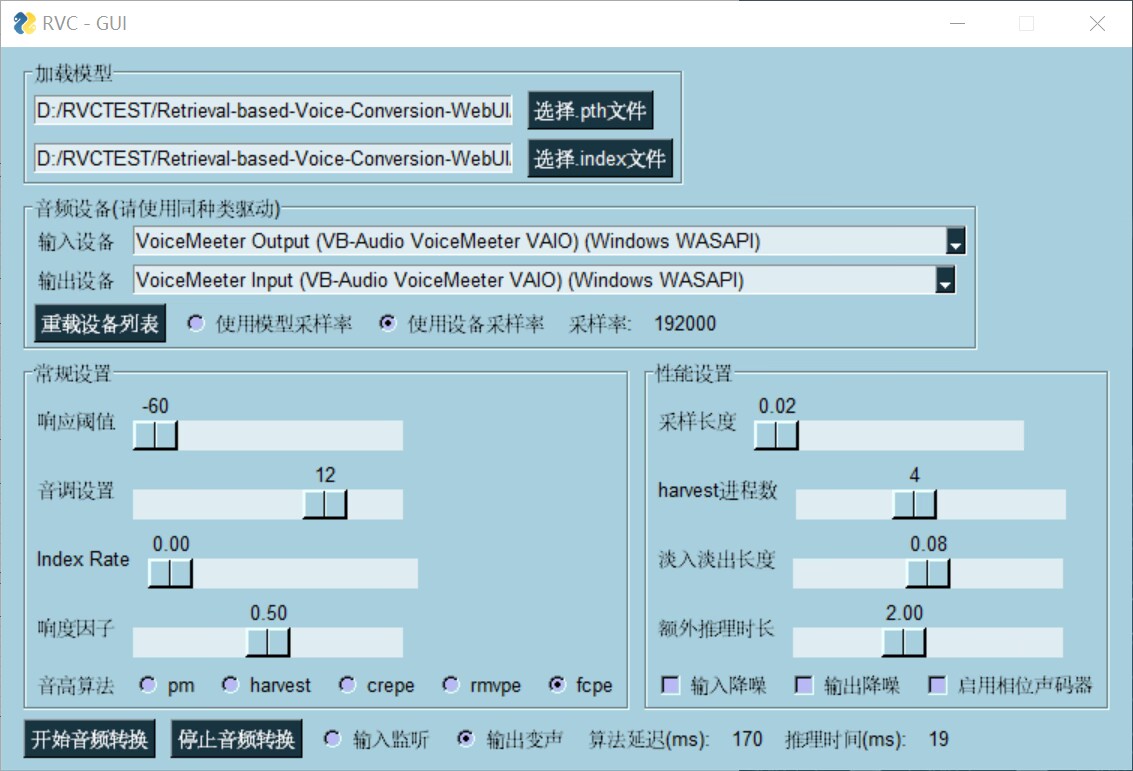

| Eres libre de elegir lo que quieres hacer. | Hemos logrado una latencia de extremo a extremo de 170 ms. Si utiliza dispositivos de entrada y salida ASIO, puede lograr una latencia de extremo a extremo de 90 ms, pero depende en gran medida de la compatibilidad con controladores de hardware. |

Este almacén tiene las siguientes características.

Utilice la búsqueda top1 para reemplazar las funciones de la fuente de entrada con funciones del conjunto de entrenamiento para evitar fugas de timbre

Entrenamiento rápido incluso en tarjetas gráficas relativamente pobres

Usar una pequeña cantidad de datos para el entrenamiento también puede producir mejores resultados (se recomienda recopilar al menos 10 minutos de datos de voz con poco ruido)

El timbre se puede cambiar mediante la fusión de modelos (con la ayuda de ckpt-merge en la pestaña de procesamiento de ckpt)

Interfaz web sencilla y fácil de usar.

Se puede llamar al modelo UVR5 para separar rápidamente las voces y el acompañamiento.

Utilice el algoritmo de extracción de tono de voz humana más avanzado, InterSpeech2023-RMVPE, para eliminar el problema de los sonidos mudos. Funciona mejor (significativamente) pero es más rápido y más pequeño que crepe_full

Soporte de aceleración de tarjeta I tarjeta

¡Haga clic aquí para ver nuestro vídeo de demostración!

Las siguientes instrucciones deben ejecutarse en un entorno con una versión de Python superior a 3.8.

Elija uno de los siguientes métodos.

Instale Pytorch y sus dependencias principales, omítalo si ya está instalado. Referencia de: https://pytorch.org/get-started/locally/

pip instalar antorcha torchvision torchaudio

Si es un sistema win + arquitectura Nvidia Ampere (RTX30xx), según la experiencia del n.° 21, debe especificar la versión de cuda correspondiente a pytorch

pip instalar antorcha torchvision torchaudio --index-url https://download.pytorch.org/whl/cu117

Instale las dependencias correspondientes según su propia tarjeta gráfica.

tarjeta n

instalación de pip -r requisitos.txt

Una tarjeta/yo tarjeta

instalación de pip -r requisitos-dml.txt

Una tarjeta ROCM (Linux)

instalación de pip -r requisitos-amd.txt

Tarjeta IIPEX (Linux)

instalación de pip -r requisitos-ipex.txt

Instale la herramienta de gestión de dependencias de Poetry, omítala si ya está instalada. Referencia de: https://python-poetry.org/docs/#installation

curl -sSL https://install.python-poetry.org |

Al instalar dependencias a través de Poetry, se recomienda que Python utilice las versiones 3.7-3.10. Otras versiones entrarán en conflicto al instalar llvmlite==0.39.0.

inicio de poesía -n env de poesía use "ruta a su python.exe" poesía ejecute pip install -r requisitos.txt

Las dependencias se pueden instalar a través de run.sh

sh ./run.sh

RVC requiere algunos otros modelos previos para la inferencia y el entrenamiento.

Puedes descargar estos modelos desde nuestro espacio Hugging Face.

A continuación se muestra una lista con los nombres de todos los modelos previos y otros archivos necesarios para RVC. Puede encontrar los scripts para descargarlos en la carpeta tools .

./assets/hubert/hubert_base.pt

./assets/preentrenado

./assets/uvr5_weights

Si desea utilizar el modelo de la versión v2, debe descargarlo adicionalmente.

./assets/pretrained_v2

Omita si ffmpeg y ffprobe ya están instalados.

sudo apto instalar ffmpeg

instalar cerveza ffmpeg

Después de la descarga, colóquelo en el directorio raíz.

Descargar ffmpeg.exe

Descargar ffprobe.exe

Si desea utilizar el último algoritmo de extracción de tono vocal RMVPE, debe descargar los parámetros del modelo de extracción de tono y colocarlos en el directorio raíz de RVC.

descargarrmvpe.pt

Descargarrmvpe.onnx

Si desea ejecutar RVC en un sistema Linux basado en la tecnología Rocm de AMD, primero instale aquí los controladores necesarios.

Si está utilizando Arch Linux, puede utilizar pacman para instalar los controladores necesarios:

pacman -S rocm-hip-sdk rocm-opencl-sdk

Para algunos modelos de tarjetas gráficas, es posible que necesite configurar adicionalmente las siguientes variables de entorno (por ejemplo: RX6700XT):

export ROCM_PATH=/opt/rocm export HSA_OVERRIDE_GFX_VERSION=10.3.0

También asegúrese de que su usuario actual esté en render y video :

sudo usermod -aG render $USERNAME sudo usermod -aG video $USERNAME

Utilice el siguiente comando para iniciar WebUI

Python inferir-web.py

Si anteriormente usó Poetry para instalar dependencias, puede iniciar WebUI de la siguiente manera

poesía ejecutar python infer-web.py

Descargue y descomprima RVC-beta.7z

Haga doble clic go-web.bat

sh ./run.sh

fuente /opt/intel/oneapi/setvars.sh